منع انهيار نموذج الذكاء الاصطناعي: معالجة المخاطر الكامنة في مجموعات البيانات الاصطناعية

نشرت: 2023-10-05لقد أحدث الذكاء الاصطناعي (AI) تحولًا كبيرًا في حياتنا اليومية من خلال اقتراح محتوى مخصص على منصات البث وتمكين المساعدين الرقميين على الهواتف الذكية. والآن أصبحت هذه التطورات ممكنة بفضل نماذج الذكاء الاصطناعي المتطورة التي تتعلم من كميات هائلة من البيانات.

وفقًا لتقارير مختلفة، أصبح المحتوى الناتج عن الذكاء الاصطناعي منتشرًا بشكل متزايد على الإنترنت، ومن المحتمل أن يشكل ما يصل إلى 90٪ من المعلومات عبر الإنترنت في السنوات القادمة.

مع هذا التدفق من المعلومات، يمكن للمرء أن يقول بسهولة أنه في عالم اليوم الغني بالبيانات، يواجه الذكاء الاصطناعي تحديا فريدا، وهو ما يخنق وفرة البيانات.

وتشير التقارير أيضًا إلى أن الكم الكبير من هذا المحتوى الناتج عن الذكاء الاصطناعي يمكن أن يربك الأشخاص بمعلومات زائدة، مما يجعل من الصعب عليهم تحديد ما هو جدير بالثقة وما هو من إنتاج الإنسان. بالإضافة إلى ذلك، هناك مخاوف بشأن احتمال فقدان الوظائف في المجالات الإبداعية مثل الفن والصحافة والكتابة، وكل ذلك لأن الذكاء الاصطناعي أصبح أكثر قدرة على إنتاج المحتوى الذي أنشأه البشر تقليديًا.

وفيما يتعلق بأنظمة الذكاء الاصطناعي نفسها، هناك قضايا ناشئة مثل "انهيار النموذج"، والتي تشير إلى مشكلة حيث تنتج نماذج الذكاء الاصطناعي التي يتم تدريبها على مجموعات كبيرة من البيانات مخرجات أقل جودة من خلال إعطاء الأولوية لاختيارات الكلمات الشائعة على البدائل الإبداعية. يعد "اضطراب الالتهام الذاتي النموذجي" أو "هابسبورج للذكاء الاصطناعي" مصدر قلق آخر حيث يمكن لأنظمة الذكاء الاصطناعي المدربة بشكل مفرط على مخرجات نماذج الذكاء الاصطناعي الأخرى أن تظهر ميزات غير مرغوب فيها أو قد يكون لها تحيزات.

يمكن أن تؤدي هذه التحديات إلى الإضرار بجودة وموثوقية المحتوى الناتج عن الذكاء الاصطناعي، مما يؤدي إلى تدمير الثقة في مثل هذه الأنظمة وتفاقم الحمل الزائد للمعلومات.

ستساعدك مدونتنا على فهم كل ما يتعلق بمعالجة منع انهيار نموذج الذكاء الاصطناعي. مع تقدم ثورة الذكاء الاصطناعي التوليدي، فإنها تطرح تحديات وشكوكًا كبيرة في مشهد المعلومات عبر الإنترنت. لذا، دعونا نتعمق في التفاصيل وجهاً لوجه.

فهم انهيار نموذج الذكاء الاصطناعي

في التعلم الآلي، يشير "انهيار النموذج" إلى الموقف الذي يفشل فيه نموذج الذكاء الاصطناعي في توفير مجموعة متنوعة من المخرجات المفيدة. وبدلاً من ذلك، فإنه ينتج مجموعة ضيقة من النتائج المتكررة أو ذات الجودة المنخفضة. يمكن أن تحدث هذه المشكلة في نماذج مختلفة، ولكن غالبًا ما يتم ملاحظتها أثناء تدريب النماذج المعقدة مثل شبكات الخصومة التوليدية (GANs). يمكن أن يؤدي انهيار النموذج إلى إعاقة قدرة النموذج على توليد مخرجات متنوعة وقيمة، مما يؤثر على أدائه العام.

دعونا نوضح مثال انهيار النموذج. تخيل طالب فنون متحمسًا للغاية يمثل نموذج الذكاء الاصطناعي الخاص بنا، والمكلف بإنشاء لوحات للحمير الوحشية. في البداية، كانت أعمالهم الفنية مثيرة للإعجاب وتشبه بشكل واضح الحمير الوحشية. ومع ذلك، تفقد لوحاتهم تدريجيًا تشابهها مع الحمير الوحشية مع استمرارها، وتتراجع الجودة. وهذا مشابه لـ "انهيار النموذج" في التعلم الآلي، حيث يكون أداء نموذج الذكاء الاصطناعي، مثل طالب الفنون لدينا، جيدًا في البداية ولكنه يكافح بعد ذلك للحفاظ على الخصائص الأساسية التي تم تصميمه من أجل أدائها.

وفقًا للتطورات الأخيرة في الذكاء الاصطناعي، أصبح الباحثون مهتمين جدًا باستخدام البيانات الاصطناعية أو الاصطناعية لتدريب نماذج الذكاء الاصطناعي الجديدة عندما يتعلق الأمر بإنشاء الصور والنصوص. ومع ذلك، هناك مفهوم يسمى "اضطراب الالتهام الذاتي النموذجي" (MAD) يقارن هذه العملية بحلقة التدمير الذاتي.

وما لم نستمر في إضافة بيانات جديدة من العالم الحقيقي بانتظام، فإن جودة وتنوع نماذج الذكاء الاصطناعي التي ننشئها باستخدام البيانات الاصطناعية قد تتدهور بمرور الوقت. لذلك، من الضروري تحقيق التوازن بين البيانات الاصطناعية والبيانات الحقيقية للحفاظ على أداء نماذج الذكاء الاصطناعي بشكل جيد.

يعد هذا التوازن أمرًا بالغ الأهمية لمنع انخفاض جودة النماذج وتنوعها أثناء استمرارها في التعلم. يعد اكتشاف كيفية استخدام البيانات الاصطناعية بشكل فعال لمنع انهيار نموذج الذكاء الاصطناعي تحديًا مستمرًا عندما يتعلق الأمر بتطور الذكاء الاصطناعي التوليدي واستخدام البيانات الاصطناعية.

وفقًا لصحيفة نيويوركر، إذا كان ChatGPT يعتبر إصدارًا مضغوطًا من الإنترنت، مشابهًا لملف JPEG الذي يضغط صورة فوتوغرافية، فإن تدريب روبوتات الدردشة المستقبلية على نتائج ChatGPT يعادل رقميًا عمل نسخ متكررة من النسخ الضوئية تمامًا مثل ايام زمان. ببساطة، لا بد أن تزداد جودة الصورة سوءًا مع كل تكرار.

وبالتالي، للتغلب على هذا التحدي، تحتاج المؤسسات إلى التركيز على تحسين أساليبها لضمان استمرار منتجات الذكاء الاصطناعي التوليدية في تقديم استجابات دقيقة في هذا المشهد الرقمي.

[اقرأ أيضًا: الذكاء الاصطناعي المسؤول – مواجهة تحديات التبني بالمبادئ التوجيهية والاستراتيجيات]

كيف يحدث انهيار نموذج الذكاء الاصطناعي؟

يحدث انهيار النموذج عندما يتم تدريب نماذج الذكاء الاصطناعي الجديدة باستخدام البيانات التي تم إنشاؤها بواسطة النماذج القديمة. تعتمد هذه النماذج الجديدة على الأنماط التي تظهر في البيانات التي تم إنشاؤها. يتجذر انهيار النموذج في فكرة أن النماذج التوليدية تميل إلى تكرار الأنماط التي تعلمتها بالفعل، وهناك حد للمعلومات التي يمكنها استخلاصها من هذه الأنماط.

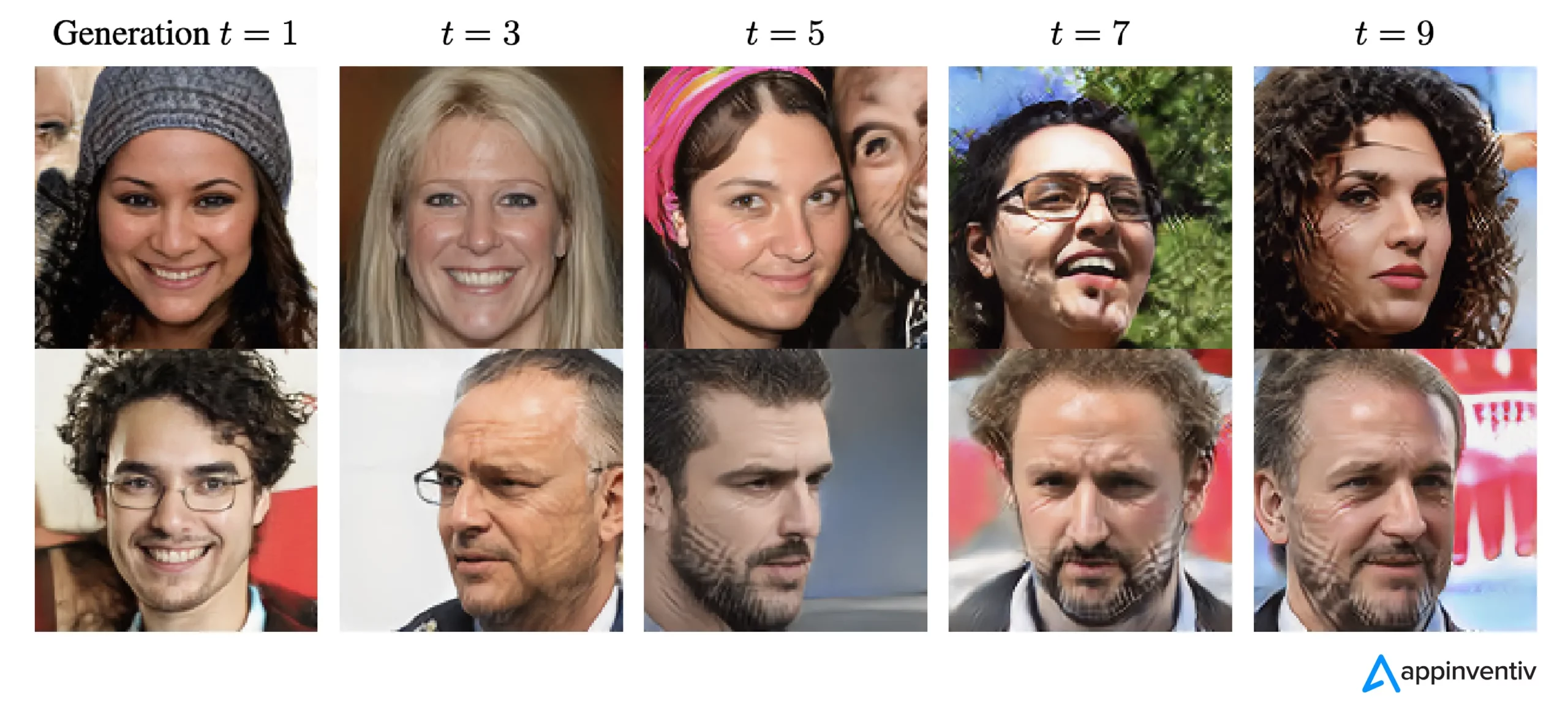

في حالات انهيار النموذج، يتم المبالغة في الأحداث التي من المحتمل حدوثها، في حين يتم التقليل من أهمية الأحداث الأقل احتمالا. على مدى أجيال متعددة، تهيمن الأحداث المحتملة على البيانات، وتتضاءل الأجزاء الأقل شيوعًا ولكنها لا تزال مهمة من البيانات، والتي تسمى الذيول. تعتبر هذه الذيول ضرورية للحفاظ على دقة وتنوع مخرجات النموذج. مع تقدم الأجيال، تتغلب الأخطاء على البيانات، ويسيء النموذج تفسيرها بشكل متزايد.

وفقا للبحث، هناك نوعان من انهيار النموذج: المبكر والمتأخر. يتضمن الانهيار المبكر للنموذج فقدان النموذج لمعلومات حول الأحداث النادرة. في انهيار النموذج المتأخر، يقوم النموذج بطمس الأنماط المميزة في البيانات، مما يؤدي إلى مخرجات لا تشبه البيانات الأصلية إلا قليلاً.

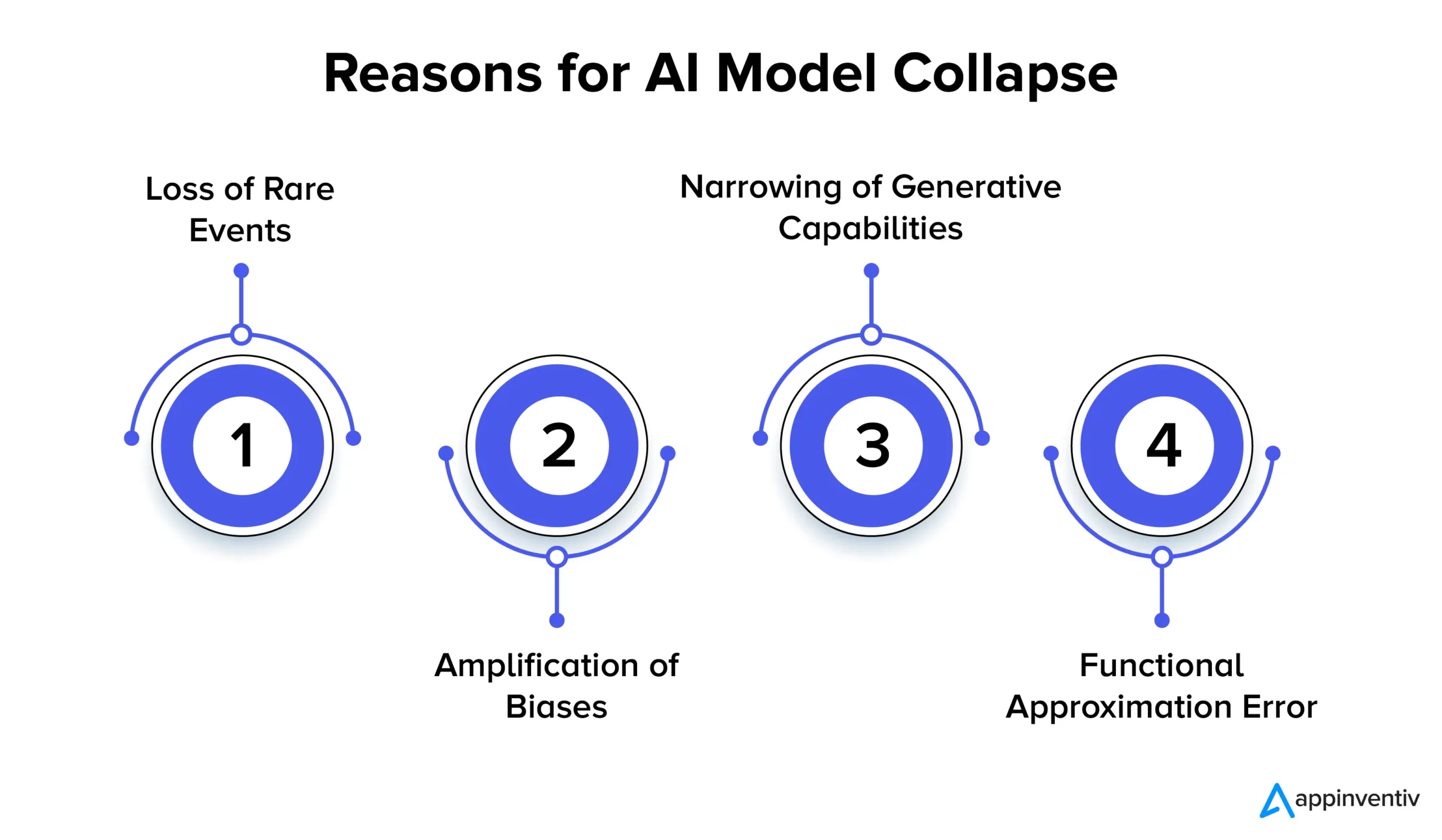

دعونا نلقي نظرة على الأسباب المتعددة لانهيار نموذج الذكاء الاصطناعي بالتفصيل أدناه:

فقدان الأحداث النادرة

عندما يتم تدريب نماذج الذكاء الاصطناعي بشكل متكرر على البيانات التي تم إنشاؤها بواسطة إصداراتها السابقة، فإنها تحاول التركيز على الأنماط الشائعة ونسيان الأحداث النادرة. تشبه هذه الظاهرة النماذج التي تفقد ذاكرتها طويلة المدى. غالبًا ما تحمل الأحداث النادرة أهمية كبيرة، مثل تحديد الحالات الشاذة في عمليات التصنيع أو اكتشاف المعاملات الاحتيالية. على سبيل المثال، عندما يتعلق الأمر باكتشاف الاحتيال، قد تشير أنماط لغة معينة إلى سلوك احتيالي، مما يجعل من الضروري الاحتفاظ بهذه الأنماط النادرة وتعلمها.

تضخيم التحيزات

كل تكرار تدريبي على البيانات الناتجة عن الذكاء الاصطناعي يمكن أن يؤدي إلى تضخيم التحيزات الموجودة في بيانات التدريب. وبما أن مخرجات النموذج تعكس عادة البيانات التي تم تدريبه عليها، فإن أي تحيزات داخل تلك البيانات يمكن تضخيمها مع مرور الوقت. يمكن أن يؤدي هذا إلى تضخيم التحيز في تطبيقات الذكاء الاصطناعي المختلفة. على سبيل المثال، يمكن أن تؤدي النتائج إلى قضايا مثل التمييز والتحيز العنصري ومحتوى الوسائط الاجتماعية المتحيز. وبالتالي، فإن تنفيذ الضوابط للكشف عن التحيز والتخفيف منه أمر ضروري للغاية.

تضييق القدرات التوليدية

مع استمرار نماذج الذكاء الاصطناعي في التعلم من البيانات التي تم إنشاؤها، يمكن أن تتقلص قدراتها الإنتاجية. ويصبح النموذج متأثرًا إلى حد ما بتفسيراته الخاصة للواقع، مما يؤدي إلى إنتاج محتوى مماثل بشكل متزايد يفتقر إلى التنوع وتمثيل الأحداث النادرة. هذا يمكن أن يؤدي إلى فقدان الأصالة. على سبيل المثال، عندما يتعلق الأمر بنماذج اللغات الكبيرة (LLMs)، فإن الاختلاف يضفي على كل كاتب أو فنان لهجته وأسلوبه المميز.

تشير الأبحاث ببساطة إلى أنه إذا لم تتم إضافة بيانات جديدة بانتظام أثناء عملية التدريب، فقد ينتهي الأمر بنماذج الذكاء الاصطناعي المستقبلية إلى أن تصبح أقل دقة أو تنتج نتائج أقل تنوعًا بمرور الوقت.

خطأ تقريبي وظيفي

يمكن أن يحدث خطأ تقريبي وظيفي عندما لا تكون أدوات تقريب الوظيفة المستخدمة في النموذج معبرة بدرجة كافية. في حين أنه يمكن التخفيف من هذا الخطأ من خلال استخدام نماذج أكثر تعبيرًا، إلا أنه يمكن أن يؤدي أيضًا إلى حدوث ضوضاء ويؤدي إلى التجاوز. يعد تحقيق التوازن الصحيح بين تعبير النموذج والتحكم في الضوضاء أمرًا بالغ الأهمية لمنع هذه الأخطاء.

الآثار المترتبة على انهيار النموذج: ما أهمية استقرار نموذج الذكاء الاصطناعي؟

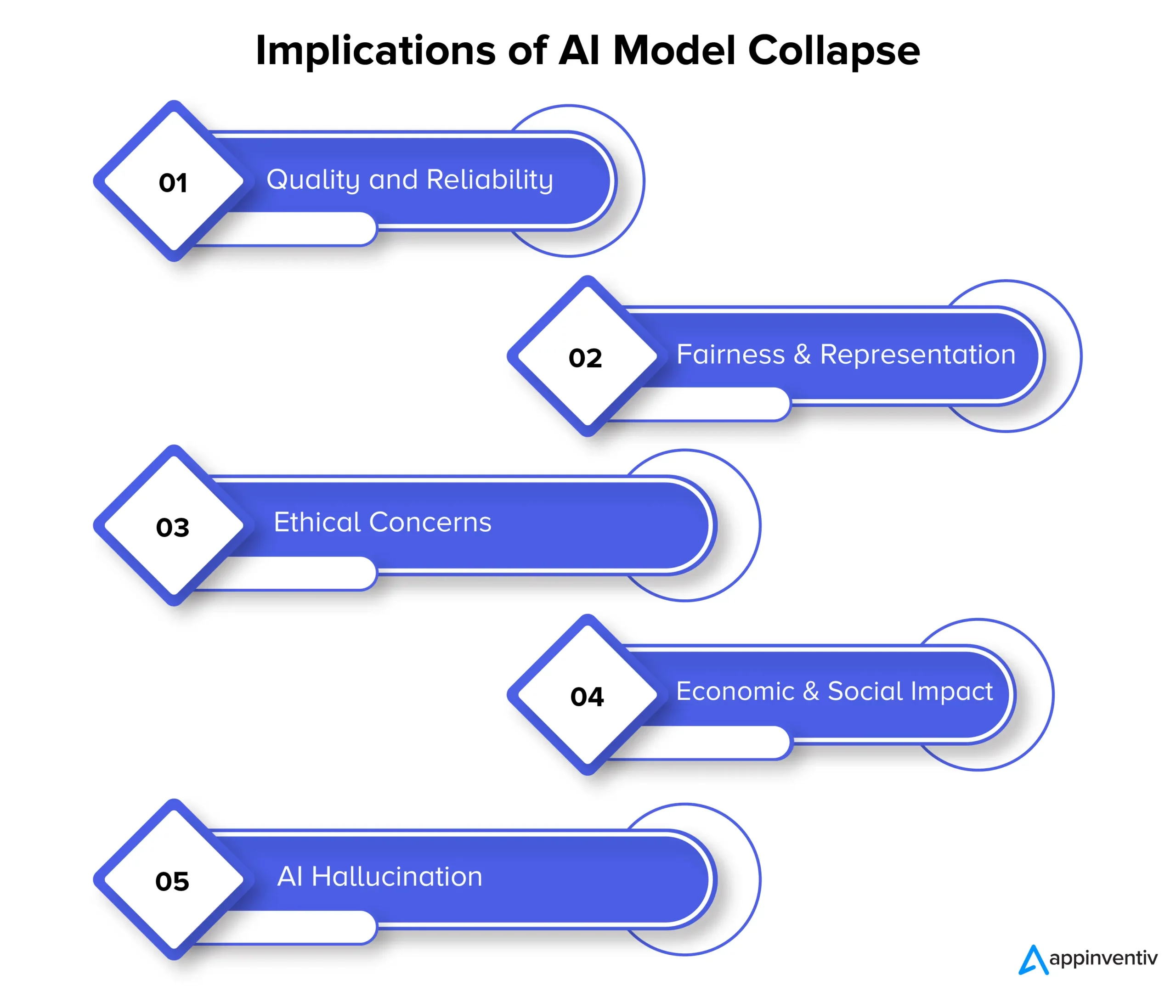

يمكن أن يؤثر انهيار النموذج في النهاية على جودة وموثوقية ونزاهة المحتوى الذي ينشئه الذكاء الاصطناعي، مما قد يشكل مخاطر عديدة على المؤسسات. دعونا نلقي نظرة على الآثار المترتبة على انهيار النموذج بالتفصيل أدناه:

الجودة والموثوقية

ومع تدهور نماذج الذكاء الاصطناعي في تعلمها، يصبح المحتوى الذي تنشئه أقل موثوقية، وتتدهور جودته. ويحدث هذا عندما تنفصل النماذج عن توزيع البيانات الأصلي وتعتمد أكثر على تفسيراتها الخاصة للواقع. على سبيل المثال، قد ينتج نموذج الذكاء الاصطناعي المصمم لتوليد الأخبار مقالات إخبارية غير دقيقة أو حتى ملفقة بالكامل.

العدالة والتمثيل

يعد انهيار النموذج أيضًا سببًا للقلق عندما يتعلق الأمر بالعدالة وتمثيل المحتوى الذي تم إنشاؤه. عندما تنسى النماذج الأحداث النادرة وتحد من قدراتها التوليدية، قد لا يتم تمثيل المحتوى المتعلق بالموضوعات الأقل شيوعًا بشكل كافٍ. وهذا يؤدي إلى التحيز والقوالب النمطية واستبعاد وجهات نظر معينة.

مخاوف أخلاقية

ويطرح انهيار النموذج مخاوف أخلاقية كبيرة، خاصة عندما يكون للمحتوى الناتج عن الذكاء الاصطناعي القدرة على التأثير على عملية صنع القرار. وتشمل عواقب انهيار النموذج انتشار المحتوى المتحيز وغير الدقيق، والذي يمكن أن يؤثر بشكل كبير على حياة الناس وآرائهم وإمكانية الوصول إلى الفرص.

الأثر الاقتصادي والاجتماعي

على المستوى الاقتصادي والاجتماعي، يمكن أن يؤثر انهيار النموذج على الثقة واعتماد تقنيات الذكاء الاصطناعي. إذا لم يكن من الممكن الاعتماد على المحتوى الناتج عن الذكاء الاصطناعي، فقد تتردد الشركات والمستهلكون في تبني هذه التقنيات. وقد يكون لذلك آثار اقتصادية، وبالتالي يمكن أن تعوق الثقة في تقنيات الذكاء الاصطناعي.

هلوسة الذكاء الاصطناعي

تحدث هلوسة الذكاء الاصطناعي عندما تقوم نماذج الذكاء الاصطناعي بإنشاء محتوى خيالي أو غير واقعي لا يتوافق مع الحقائق أو متماسك بأي شكل من الأشكال. يمكن أن يؤدي ذلك إلى معلومات غير دقيقة، مما قد يؤدي إلى معلومات خاطئة أو ارتباك. إنها مشكلة كبيرة في تطبيقات مثل توليد الأخبار أو تشخيص الحالات الطبية أو إنشاء مستندات قانونية حيث تكون الدقة والموثوقية أمرًا حيويًا للغاية.

دعونا نشرح السياق بمثال هلوسة الذكاء الاصطناعي. لنفترض أن هناك نموذجًا للذكاء الاصطناعي تم تدريبه على إنشاء صور للحيوانات. الآن، عند طلب صورة لحيوان، قد ينتج النموذج صورة "zebroid"، وهو هجين بين الحمار الوحشي والحصان. في حين أن هذه الصورة قد تبدو واقعية بصريًا، فمن الضروري أن نفهم أنها مجرد إبداع لخيال نموذج الذكاء الاصطناعي، حيث لا يوجد مثل هذا الحيوان في العالم الحقيقي.

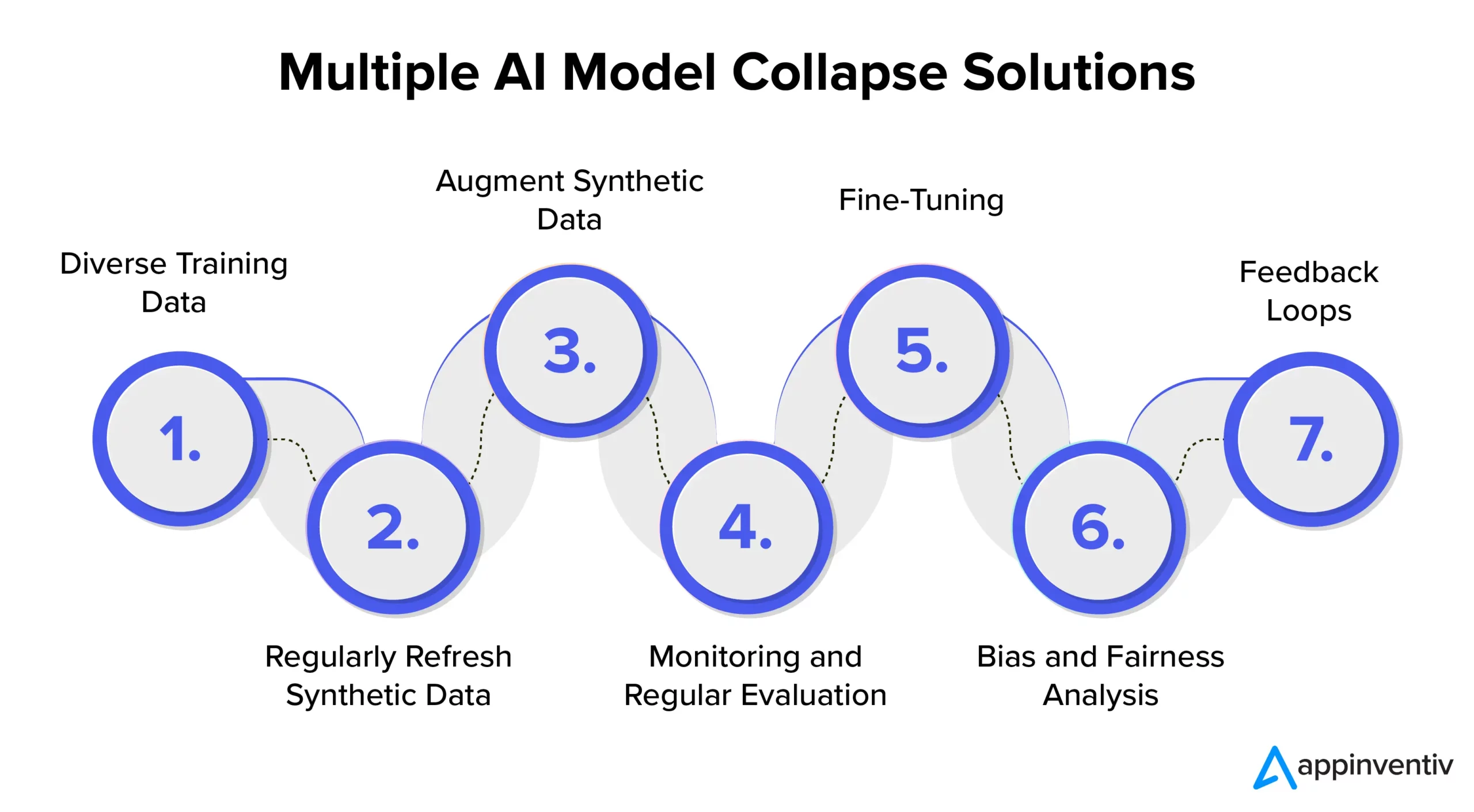

منع انهيار نموذج الذكاء الاصطناعي: فهم حلول انهيار نموذج الذكاء الاصطناعي

لضمان استقرار وموثوقية نموذج الذكاء الاصطناعي، من الضروري استكشاف الاستراتيجيات وأفضل الممارسات للتعامل بفعالية مع منع انهيار نموذج الذكاء الاصطناعي. وبالتالي، يوصى بالشراكة مع شركة متخصصة في تطوير الذكاء الاصطناعي مثل Appinventiv التي يمكنها توفير الخبرة والتوجيه في تنفيذ هذه التدابير الوقائية مع ضمان أن أنظمة الذكاء الاصطناعي الخاصة بك تقدم نتائج عالية الجودة باستمرار.

بيانات التدريب المتنوعة

لمعالجة انهيار نموذج الذكاء الاصطناعي بشكل فعال ومنع المخرجات غير المرغوب فيها، من الضروري تنظيم مجموعة بيانات تدريبية تتضمن مجموعة متنوعة من مصادر البيانات وأنواعها. يجب أن تتكون مجموعة البيانات هذه من البيانات الاصطناعية التي تم إنشاؤها بواسطة النموذج وبيانات العالم الحقيقي التي تمثل تعقيدات المشكلة بدقة. من المهم تحديث مجموعة البيانات هذه بانتظام بمعلومات جديدة وذات صلة. يتعرض النموذج لمجموعة واسعة من الأنماط من خلال دمج بيانات التدريب المتنوعة. وهذا يساعد في منع ركود البيانات.

قم بتحديث البيانات الاصطناعية بانتظام

يعد انهيار النموذج خطرًا عندما تعتمد نماذج الذكاء الاصطناعي بشكل كبير على البيانات التي تم إنشاؤها الخاصة بها. للتخفيف الفعال من المخاطر في الذكاء الاصطناعي، من المهم تقديم بيانات جديدة وحقيقية وواقعية بشكل منتظم في مسار التدريب. تضمن هذه الممارسة أن يظل النموذج قابلاً للتكيف ويتجنب الوقوع في حلقة متكررة. يمكن أن يساعد هذا في توليد مخرجات متنوعة وذات صلة.

زيادة البيانات الاصطناعية

يعد تعزيز البيانات الاصطناعية من خلال تقنيات زيادة البيانات طريقة مجربة لمنع انهيار النموذج. تقدم هذه التقنيات تباينًا في البيانات الاصطناعية باستخدام الاختلافات الطبيعية في بيانات العالم الحقيقي. إن إضافة ضوضاء يتم التحكم فيها إلى البيانات التي تم إنشاؤها يشجع النموذج على تعلم نطاق أوسع من الأنماط، مما يقلل من فرص توليد مخرجات متكررة.

الرصد والتقييم المنتظم

تعد المراقبة المنتظمة وتقييم أداء نموذج الذكاء الاصطناعي أمرًا بالغ الأهمية للكشف المبكر عن انهيار النموذج. ويضمن تنفيذ إطار MLOps المراقبة المستمرة والمواءمة مع أهداف المنظمة، وبالتالي تمكين التدخلات والتعديلات في الوقت المناسب.

[اقرأ أيضًا: كيفية تجنب انتهاكات الامتثال أثناء تطوير منتجات الذكاء الاصطناعي]

الكون المثالى

ومن المهم النظر في تنفيذ استراتيجيات الضبط الدقيق للحفاظ على استقرار النموذج ومنع الانهيار. تمكن هذه الاستراتيجيات لمنع فشل نموذج الذكاء الاصطناعي النموذج من التكيف مع البيانات الجديدة مع الحفاظ على معرفته السابقة.

تحليل التحيز والعدالة

يعد التحليل الدقيق للتحيز والعدالة أمرًا بالغ الأهمية في منع انهيار النموذج والقضايا الأخلاقية. ومن الضروري تحديد ومعالجة التحيزات في مخرجات النموذج. يمكنك الحفاظ على مخرجات نموذجية موثوقة وغير متحيزة من خلال معالجة هذه المخاوف بشكل فعال.

حلقات ردود الفعل

يعد تنفيذ حلقات التعليقات التي تتضمن تعليقات المستخدمين أمرًا بالغ الأهمية في منع انهيار النموذج. من خلال جمع رؤى المستخدم باستمرار، يمكن إجراء تعديلات مستنيرة على مخرجات النموذج. تضمن عملية التحسين هذه أن يظل النموذج ملائمًا وموثوقًا ومتوافقًا مع توقعات المستخدم.

كيف يمكن لـ Appinventiv المساعدة في تخفيف المخاطر في نماذج الذكاء الاصطناعي؟

في المشهد المتطور للذكاء الاصطناعي، كانت التحديات التي يفرضها انهيار النماذج مصدر قلق لكل من عمالقة التكنولوجيا والمبتكرين على حد سواء. لقد ترك التدهور طويل المدى لمجموعات بيانات نماذج اللغة والتلاعب بالمحتوى بصماته على هذا النظام البيئي الرقمي.

مع تقدم الذكاء الاصطناعي، من الضروري التمييز بين البيانات التي يتم إنشاؤها بشكل مصطنع والمحتوى الذي ينشئه الإنسان. أصبح الخط الفاصل بين المحتوى الأصلي وما يتم إنشاؤه بواسطة الآلة غير واضح بشكل متزايد.

الآن، وسط هذه التحديات ومنع فشل نموذج الذكاء الاصطناعي، يمكن أن توفر لك الشراكة مع شركة متخصصة في تطوير الذكاء الاصطناعي مثل Appinventiv العزاء الذي تحتاجه بشدة. بفضل الخبرة في تطوير نماذج الذكاء الاصطناعي والالتزام المخصص بممارسات الذكاء الاصطناعي الأخلاقية، يمكننا مساعدتك في التغلب على تعقيدات الذكاء الاصطناعي مع ضمان موثوقية وسلامة أنظمة الذكاء الاصطناعي لديك.

يمكن لخبرائنا العمل معك في معالجة منع انهيار نموذج الذكاء الاصطناعي بشكل فعال، وتعزيز الشفافية، وبناء مستقبل بمحتوى أصيل لا ينال من صحة المحتوى الذي ينشئه الإنسان.

نحن ندرك أن تدريب نماذج الذكاء الاصطناعي باستخدام بيانات جديدة ومتنوعة أمر ضروري لمنع تدهور النموذج. يعد تقييم نموذج الذكاء الاصطناعي خطوة محورية في عملية تطوير النموذج لدينا والتي تستخدم مقاييس لتقييم الأداء وتحديد نقاط الضعف وضمان التنبؤات المستقبلية الفعالة.

يمكن لفريق الخبراء لدينا المساعدة في ضمان استمرار أنظمة الذكاء الاصطناعي لديك في التعلم والتكيف مع المشهد الرقمي المتطور. تواصل مع خبرائنا للتخفيف من المخاطر المرتبطة بانهيار النموذج وضمان فعاليته.

الأسئلة الشائعة

س: ما هو انهيار نموذج الذكاء الاصطناعي؟

ج: يشير انهيار نموذج الذكاء الاصطناعي في التعلم الآلي إلى فشل نموذج الذكاء الاصطناعي في إنتاج مجموعة متنوعة من المخرجات المفيدة. وبدلاً من ذلك، فإنه يولد نتائج متكررة أو منخفضة الجودة. يمكن أن تحدث هذه المشكلة في أنواع مختلفة من النماذج، ولكن يتم ملاحظتها بشكل خاص أثناء تدريب النماذج المعقدة مثل شبكات الخصومة التوليدية (GANs).

س: ما هي الأسباب الشائعة لانهيار نموذج الذكاء الاصطناعي؟

ج: تشمل الأسباب الشائعة لانهيار نموذج الذكاء الاصطناعي فقدان الأحداث النادرة، وتضخيم التحيزات، وتضييق القدرات التوليدية، وأخطاء التقريب الوظيفي، وما إلى ذلك. يمكن أن تؤدي هذه العوامل إلى نماذج تنتج مخرجات دون المستوى الأمثل.

س: كيف يمكنني منع انهيار نموذج الذكاء الاصطناعي؟

ج. للوقاية الفعالة من انهيار نموذج الذكاء الاصطناعي، يعد استخدام بيانات تدريب مختلفة وشبيهة بالعالم الحقيقي أمرًا حيويًا، ومراقبة البيانات وتقييمها باستمرار، وإصلاح أي تحيزات، وتنفيذ اختبارات صارمة ومراقبة الجودة. يمكن أن توفر لك الشراكة مع خبراء الذكاء الاصطناعي في Appinventiv رؤى وحلول قيمة للتخفيف من مخاطر انهيار النموذج.