Audiogesteuerte KI: Was die Zukunft für Audio-KI bereithält

Veröffentlicht: 2024-03-20Inhalt des Artikels

Audio-KI verändert die Art und Weise, wie wir Inhalte erstellen und konsumieren. Es handelt sich bereits um eine Branche mit einem Wert von 4 Milliarden US-Dollar , deren Wert sich bis zum Ende des Jahrzehnts voraussichtlich verdreifachen wird.

Doch wie sieht der aktuelle Stand der Audio-KI eigentlich aus und wie verändert sich diese junge Branche?

Wir erläutern, welche Arten von Audio-KI-Tools es bereits gibt, wie Vermarkter und Unternehmen sie heute nutzen können und geben einige spannende Indikatoren dafür, wohin sich die Branche entwickelt.

Sind Sie bereit, ein paar Roboter reden zu hören? Lass uns anfangen.

Die aktuelle Landschaft der Audio-KI

Audio AI erzeugt Töne und Sprache mit künstlicher Intelligenz .

Zu den Produkten dieser Branche gehören Tools zum Umwandeln von Text in Sprache, zum Erstellen von Sprachrepliken für die Synchronisation und zum Betrieb von Sprachassistenten, die den menschlichen Ton und Rhythmus nachahmen können. Tools wie ElevenLabs und Resemble AI sind bereits in der Lage, hochwertige, realistische Audioinhalte zu produzieren.

Hier sind drei Möglichkeiten, wie Menschen diese bahnbrechende Technologie bereits nutzen.

Audio-KI für YouTuber

Audio-KI verändert die Erstellung von Inhalten, insbesondere wenn es um Inhaltstypen wie Hörbücher und Podcasts geht. Schöpfer haben jetzt die Möglichkeit, synthetische Stimmen zu verwenden, die menschliche Intonation und Emotionen nachbilden können, wodurch herkömmliche Aufnahmeeinrichtungen überflüssig werden. Dies könnte ihnen helfen, Produktionskosten und Zeit zu sparen.

Schauen Sie sich einfach dieses Video an – eine Kombination aus Audio- und Video-KI – erstellt vom CEO der Foundation, Ross Simmonds. Wofür er Stunden hätte brauchen können (Sitzen, Drehbuch schreiben, aufnehmen und bearbeiten), konnte er in wenigen Minuten fertigstellen.

Wochenendexperiment:

Erstelle ein Video von mir nur mit KI.

Hier ist das Ergebnis.

Sicher. Es braucht Arbeit. Aber es ist ziemlich nah...

WIE?

1) KI hat meine Stimme anhand alter Podcast-Aufnahmen rekonstruiert.

2) AI hat meinen alten Blog-Beitrag als Skript verwendet.

3) AI verwendete einen Screenshot aus einem alten Video von … pic.twitter.com/xmuRUotrjV— Ross Simmonds (@TheCoolestCool) 4. Juli 2023

Für Vermarkter und andere Geschäftsleute lohnt es sich darüber nachzudenken, wie dadurch mehr Arten von Audioinhalten möglich werden könnten. Dies gilt insbesondere für kleine Unternehmen mit begrenzten Ressourcen – vielleicht können Sie jetzt einen Podcast erstellen, der vorher zu teuer oder zu zeitaufwändig gewesen wäre.

Dieser Anwendungsfall ist nicht unumstritten. Kritiker äußern ethische Bedenken hinsichtlich Einwilligung und Entschädigung und argumentieren, dass dies den Beruf des Synchronsprechers untergraben könnte. Das Risiko von Deep-Fake-Audio und potenziellem Missbrauch ist ebenfalls groß, was die Notwendigkeit regulatorischer Rahmenbedingungen für einen verantwortungsvollen Umgang mit diesen neuen Technologien unterstreicht.

Eine Antwort auf die Risiken dieser Technologie ist die Sprachlizenzierung. Einige Synchronsprecher reagieren auf die Bedrohung ihres Berufs, indem sie ihre Stimmen für die Verwendung als Sprach-KI-Klone in Diensten wie der Sprachbibliothek von ElevenLabs lizenzieren. Dann erhalten sie jedes Mal eine Lizenzgebühr, wenn jemand ihre Stimme verwendet.

In den USA gilt jedoch nicht eine Stimme selbst als urheberrechtlich geschützt , sondern nur bestimmte Sprachaufnahmen. So wie die Verwendung eines „soundalike“ Sängers eine legale Möglichkeit ist, die Stimme einer Person nachzuahmen, kann dies auch für Deepfake-Audio gelten. Das Klonen von Stimmen und die Lizenzierung befinden sich damit in einer rechtlichen Grauzone, insbesondere da die entsprechende Rechtsprechung aus dem Jahr 1988 stammt. Nur weitere Fälle und die Verabschiedung von Gesetzen wie dem No AI Fraud Act werden dies klären können.

Audio-KI für Übersetzung und Synchronisation

Audio AI verändert auch die Übersetzungs- und Synchronisationsbranche. Diese Technologie kann Text-zu-Stimme- und Stimme-zu-Stimme-Interpretationen erstellen und strebt danach, den Ton und die Emotionen des ursprünglichen Sprechers möglichst genau nachzuahmen, um ein authentischeres Hörerlebnis zu erzielen.

Dieser virale Social-Media-Beitrag zeigt die Fähigkeit der KI-Synchronisation, selbst in der Musik Sprachbarrieren zu überwinden:

Bruder, ich bin tatsächlich in Tränen aufgelöst bei Lil Yachtys Vers️ pic.twitter.com/ZX6rqD0McE

— ₭ma (@KmaFr_) 20. Februar 2024

Diese Synchronisation vom Englischen ins Mandarin-Chinesisch hatte zum Zeitpunkt der Veröffentlichung 1,7 Millionen Aufrufe. Die meisten Leute, die den Beitrag kommentieren, sprechen nicht einmal die Sprache – sie sind einfach nur erstaunt über die Technologie.

Doch trotz ihres Potenzials sind mit KI-Übersetzung und -Synchronisierung immer noch Risiken verbunden. Es öffnet beispielsweise die Tür für einen Nuancenverlust in der Übersetzung sowie für kulturelle Fehlinterpretationen. Es wirft auch eine ethische Überlegung hinsichtlich der Nachbildung der Stimme einer Person ohne deren Zustimmung auf.

Es besteht auch die Gefahr, dass Leute es absichtlich manipulieren, um die tatsächlichen Worte einer Person falsch zu überspielen. Hier ist ein Beispiel dafür, wie jemand ein gefälschtes Video erstellt, in dem Morgan Freeman spricht, mit ziemlich überzeugenden Ergebnissen:

BREAKING: Die Bundeswahlkommission prüft möglicherweise eine Regulierung von KI-generierten Deepfake-Politikanzeigen vor der Wahl 2024.

Für diejenigen, die es nicht wissen: Bei einem Deep Fake handelt es sich in der Regel um einen von der KI erstellten Audioclip/Video, der eine Person zu zeigen scheint, die etwas sagt oder … pic.twitter.com/7lmlNht4QP

– Ed Krassenstein (@EdKrassen) 11. August 2023

Bei der Weiterentwicklung dieser Technologie ist es von entscheidender Bedeutung, Genauigkeit zu gewährleisten und die Rechte anderer zu respektieren, selbst zu entscheiden, wie ihre Stimme verwendet wird. Bei effektiver Nutzung könnte es eine Welt voller Möglichkeiten eröffnen, die es uns ermöglicht, Inhalte zu genießen, die früher unzugänglich waren, und sogar einfacher als zuvor mit anderen zu sprechen.

Audio-KI für Sprachassistenten

Sprachassistenten wie Siri, Alexa und Google Assistant basieren bereits auf Audio-KI und nutzen die Verarbeitung natürlicher Sprache, um Benutzerbefehle zu verstehen und darauf zu reagieren. Diese Assistenten stellen eine bedeutende Anwendung der Audio-KI dar, da sie Sprache sowohl erkennen als auch für die Interaktion mit Benutzern nutzen.

Sprachassistenten sind bereits beliebt, 62 % der erwachsenen Amerikaner geben an, dass sie einen verwenden.

Da sich die KI verbessert, ist es wahrscheinlich, dass sie in Zukunft nur noch genauer – und damit auch beliebter – werden. Da diese Zahl steigt, wird es für Unternehmen immer wichtiger, ihre Artikel und andere Online-Inhalte für die Sprachsuche zu optimieren.

Aber es gibt auch einige Bedenken bei ihnen. Gegen Google wurde bereits eine Klage eingereicht , in der behauptet wird, das Unternehmen habe die Gespräche von Personen, die versehentlich ihren Sprachassistenten aktiviert hatten, illegal aufgezeichnet und verbreitet.

Die Zukunft der Audio-KI

Diese drei Anwendungen für Audio-KI sind nur der Anfang.

Verstehen Sie mich nicht falsch, Text-to-Speech, Synchronisation und Sprachassistenten sind leistungsstarke Anwendungen. Aber es gibt noch mehr, was Audio-KI in Zukunft leisten könnte.

Hier sind drei Schlüsselbereiche, in denen wir Wachstum vorhersagen:

KI-Wachstum im Kundenservice

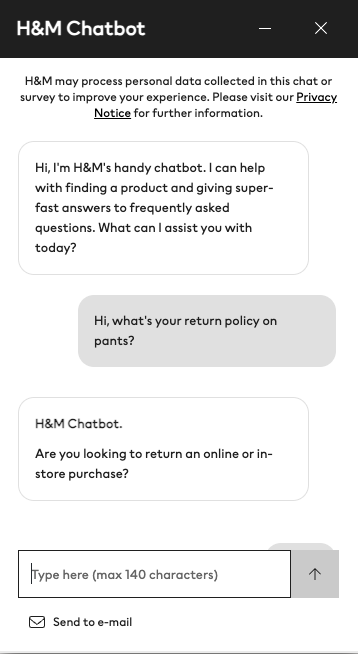

Die Integration von Sprach-KI in den Kundenservice hat das Potenzial, die Art und Weise, wie Unternehmen mit ihren Kunden interagieren, zu revolutionieren. Unternehmen nutzen bereits KI-Chatbots für den Kundenservice, daher wäre dies eine natürliche Erweiterung dieses bestehenden Anwendungsfalls

Beispielsweise könnte Audio-KI effektiv in der Lage sein, eine Audioversion dieser Interaktion mit dem Kundenservice-Chat von H&M zu erstellen:

Mit KI-gestützten Callcentern können Unternehmen große Mengen an Anfragen effizienter bearbeiten, Wartezeiten verkürzen und das Kundenerlebnis optimieren.

Was die Funktionen betrifft, gehen wir davon aus, dass Audio-KI mehr kann als nur Antworten zu automatisieren. In Zukunft wird Audio-KI wahrscheinlich in der Lage sein, die Kundenstimmung zu analysieren und Interaktionen an individuelle Bedürfnisse anzupassen. Dies könnte die allgemeine Servicequalität in einem Umfang verbessern, der heute für viele Unternehmen unerschwinglich wäre.

Als Teil davon kann die KI-Sprachanalyse den Kundendienstmitarbeitern Echtzeit-Feedback liefern. Das Aufzeigen der Frustration oder Verwirrung der Kunden, die möglicherweise nicht offen zum Ausdruck gebracht werden, ermöglicht einen differenzierteren und einfühlsameren Ansatz. KI-Tools wie Einstein von Salesforce können bereits häufige Trends in Kundendaten erkennen, sodass Audio-KI in Zukunft möglicherweise in der Lage sein wird, dasselbe mit Kundenanrufaufzeichnungen zu tun.

Voice AI könnte auch zum Hauptkontaktpunkt des Kunden mit einem Unternehmen werden. Derzeit verwenden Unternehmen Spracherkennungssoftware mit vorab aufgezeichneten Antworten, um die häufigsten Probleme ihrer Kunden zu lösen. Mit KI könnten diese natürlicher in ein Gespräch mit dem Kunden integriert werden.

Allerdings bringt dieser Technologiesprung auch Herausforderungen mit sich. Frühe Probleme bei der Implementierung von KI im Kundenservice, wie zum Beispiel, dass Chatbots komplexe Kundenanfragen nicht verstehen oder nicht angemessen darauf reagieren konnten, haben die Grenzen aktueller KI-Technologien deutlich gemacht.

Tatsächlich hat ein KI-Chatbot für den Kundendienst eine Fluggesellschaft Geld gekostet, weil sie Versprechungen über ihre Rückerstattungsrichtlinien gemacht hat, die nicht wahr waren.

Dies ist eine Technologie, mit der Unternehmen vorsichtig sein müssen. Auch wenn wir von einem vollständig KI-gestützten Kundenservice noch weit entfernt sind, können wir bereits beobachten, dass Unternehmen Schritte in diese Richtung unternehmen.

KI-Wachstum in der Geschäftskommunikation

Audio AI wird die Berufslandschaft verändern, nicht nur durch die Automatisierung von Routineaufgaben wie der täglichen internen Kommunikation und des Papierkrams, sondern auch durch die Neudefinition der Art der Arbeit und Zusammenarbeit innerhalb von Organisationen.

Beispielsweise könnte Audio-KI frühe Einstellungsgespräche automatisieren und so für einen effizienteren Auswahlprozess sorgen. Dies ermöglicht es Personalvermittlern, sich auf Kandidaten zu konzentrieren, die anhand ihrer Antworten bestimmte Kriterien erfüllen, und trägt zur Rationalisierung des Einstellungsprozesses bei. Es würde auch das Risiko menschlicher Vorurteile verringern, potenzielle Kandidaten fälschlicherweise abzuwerten.

Audio-KI könnte auch bei der internen Kommunikation helfen, Nachrichten in Echtzeit in verschiedene Sprachen übersetzen und sicherstellen, dass globale Teams auf dem gleichen Stand bleiben, und zwar durch Technologien, wie sie ElevenLabs bereits entwickelt hat . Dies könnte die Kommunikation und Zusammenarbeit in immer vielfältigeren und verteilteren Arbeitsumgebungen erheblich erleichtern.

Durch die Zusammenführung von Menschen, die unterschiedliche Sprachen sprechen, wird Audio-KI es Unternehmen erleichtern, hervorragende Leute einzustellen, unabhängig davon, wo sie leben oder welche Sprache sie sprechen. Das wird zu mehr sprachlicher und geografischer Vielfalt führen und die interne Kommunikation wird einfacher, selbst zwischen Mitarbeitern, die kein Wort der Muttersprache des anderen sprechen.

Allerdings ist die Integration von Audio-KI in den Arbeitsplatz nicht ohne Risiken. Zu den Bedenken gehört die Möglichkeit einer Fehlinterpretation bei automatisierten Interviews, bei denen sprachliche Nuancen oder nonverbale Hinweise übersehen werden könnten. Der Einsatz von KI für die interne Kommunikation und Kundeninteraktionen könnte auch dazu führen, dass die persönliche Note verloren geht, die echte Verbindungen zwischen Menschen fördert.

KI-Wachstum in der Unterhaltung

Unterhaltung ist ein weiterer Bereich, in dem sich Audio-KI in Zukunft wahrscheinlich dramatisch verändern wird. Damit können Menschen schneller und einfacher als je zuvor neue Musik und Podcasts erstellen.

Audiogesteuerte KI wird eine Menge Anwendungsfälle haben.

Hier sind ein paar (und ich weiß, dass einige Leute diese hassen werden, weil sie so vielen Dingen das *menschliche* Element nehmen), von denen ich denke, dass sie alles verändern werden:

– Mit synthetischen Stimmen erstellte Hörbücher

– Podcasts laufen mit…— Ross Simmonds (@TheCoolestCool) 30. November 2023

KI-gestützte Tools könnten Podcast-Erstellern auch dabei helfen, zahlreiche Aspekte der Produktion zu automatisieren, wie im Beispiel unten, und so Produktionszeiten und -kosten zu reduzieren.

️ Podcaster-Anwendungsfall für ChatGPT.

Lassen Sie AI Audiodateien konvertieren und zusammenführen.

Fügen Sie einer Episode Intros/Outros hinzu. pic.twitter.com/u8DSqHUq5h— Troy Tessalone | Automation Ace ️ (@AutomationAce_) 27. Oktober 2023

Eine der faszinierendsten und umstrittensten Anwendungen der Audio-KI ist ihre Fähigkeit, Musik im Stil bestehender oder früherer Künstler zu produzieren. Projekte wie die Jukebox von OpenAI , die Musik in verschiedenen Stilrichtungen von Grund auf generiert, verdeutlichen sowohl das Potenzial als auch die aktuellen Grenzen von KI in kreativen Prozessen.

Während die Ergebnisse für eine so frühe Technologie beeindruckend sind, fehlt ihnen die emotionale Tiefe und Komplexität der von menschlichen Künstlern geschaffenen Musik. Auch wenn dies in der Zukunft bahnbrechend sein könnte, ersetzt es menschliche Künstler noch nicht.

In Zukunft könnte KI Künstlern helfen, indem sie es ihnen ermöglicht, neue Genres, Stile oder Konzepte zu erkunden, ohne tagelange Arbeit zu investieren. Es könnte als „Proof of Concept“ für einen Künstler dienen, der sich noch mit einer Idee beschäftigt.

Es könnte Podcastern auch helfen, indem es Voiceovers automatisiert und Hintergrundsoundeffekte und Musik generiert, sobald diese Funktionen entwickelt sind.

Die Vorschriften hinken hier den Anträgen hinterher, obwohl es der Universal Music Group gelungen ist, einen KI-generierten Song zu entfernen , der eine Zusammenarbeit zwischen Drake und The Weeknd imitiert.

Ethische und rechtliche Bedenken entstehen auch, wenn KI verwendet wird, um die Stimmen oder Stile bestehender und früherer Künstler nachzuahmen. Die Debatte über posthume Veröffentlichungen und die Authentizität von KI-geschaffenen Werken unterstreicht die Notwendigkeit klarer Richtlinien und ethischer Standards für den Einsatz von KI in der Unterhaltung.

Die Anwendungen von Audio AI mit Unterhaltung werden dazu führen, dass Technologie und Kreativität aufeinandertreffen. Während die KI-Technologie ausgereifter wird und in ihrem Verständnis und ihrer Nachbildung menschlicher Kreativität immer differenzierter wird, wird sie weiterhin aktuelle Einschränkungen überwinden und sowohl neue Horizonte für Künstler als auch neue Risiken eröffnen, die es zu überwinden gilt.

So bereiten Sie sich auf neue und zukünftige Audio-KI-Anwendungen vor

Hier sind vier wichtige Schritte, die Sie unternehmen können, um mit Audio-KI erfolgreich zu sein.

1. Ethische Überlegungen und Politikentwicklung

Unternehmen müssen klare, ethische Richtlinien für den Einsatz von Audio-KI einführen und dabei der Transparenz gegenüber den Benutzern Priorität einräumen.

Wenn Sie eine KI-Stimme verwenden, die auf der Stimme einer anderen Person als Ihrer eigenen basiert, stellen Sie zunächst sicher, dass Sie deren Erlaubnis einholen. Wenn die KI mit einem Kunden kommuniziert, stellen Sie sicher, dass der Kunde weiß, dass es sich nicht um eine lebende Person handelt.

Sie sollten außerdem Sicherheitsmaßnahmen ergreifen, um den unbefugten Zugriff und die Nutzung Ihrer Sprachdaten zu verhindern. Das bedeutet, strenge Zugriffskontrollen dafür zu schaffen, wer die Daten nutzen darf, und bewährte Verfahren zur Verschlüsselung einzuhalten .

Ihre Richtlinien müssen auch das Potenzial für Fehlverhalten berücksichtigen und sicherstellen, dass Sie über einen Prozess zum Umgang mit jeder KI verfügen, die etwas sagt, das nicht in Ihren Unternehmensrichtlinien enthalten ist, wie zum Beispiel im vorherigen Beispiel einer Fluggesellschaft.

2. Investition in Audio-KI-Kompetenz

Um in die Audio-KI-Kompetenz zu investieren, können Unternehmen Bildungs- und Schulungsprogramme für ihre Teams zu den Funktionsweisen, Potenzialen und Einschränkungen von Audio-KI-Technologien priorisieren.

Erstellen Sie dazu Workshops, Seminare und Online-Kurse oder investieren Sie in diese, um das Verständnis zwischen Mitarbeitern auf allen Ebenen, vom technischen Personal bis hin zu Entscheidungsträgern, zu verbessern.

Bei Foundation erreichen wir dies, indem wir den Mitarbeitern zahlreiche Möglichkeiten zur beruflichen Weiterentwicklung bieten, beispielsweise durch die Übernahme der Kosten für die Teilnahme an Kursen. Andere Unternehmen tun dies möglicherweise durch Mentoring oder Peer-Education-Initiativen.

Diese Bildung kann dazu beitragen, die KI zu entmystifizieren und ein Umfeld zu schaffen, in dem jeder fundierte und strategische Entscheidungen darüber treffen kann, wie er sie ethisch und effektiv nutzt.

3. Experimentieren und Zusammenarbeit

Wenn Sie die ersten beiden Punkte befolgt haben, haben Sie bereits Richtlinien dafür erstellt, wie Menschen KI nutzensollten, und Aufklärung darüber, wie sie sie nutzenkönnen. Jetzt sollten Sie ein Umfeld schaffen, in dem sie sich frei für Innovationen fühlen. Auf diese Weisekönnensie ihr Potenzial optimal nutzen.

Im Gegensatz zu Startups, bei denen der Anreiz zur Innovation aus dem unternehmerischen Umfeld kommt, muss ein großer Konzern seine Umgebungen und Strukturen so gestalten, dass er Menschen inspiriert.

– Walter T. Rambwi (@hr_taurai) 18. Oktober 2021

Partnerschaften zwischen Ingenieuren und Mitarbeitern anderer Abteilungen können hier fruchtbar sein und den Menschen zeigen, wie Audio-KI zur Lösung bestehender Probleme beitragen kann.

Sie können dies sogar zu einem Projekt Ihrer Personalabteilung machen, um eine allgemeine Kultur der Zusammenarbeit zu fördern und abteilungsübergreifende Tage zu schaffen, an denen Menschen gemeinsam ihre Erkenntnisse über KI austauschen können.

4. Geschäftsmodelle anpassen

Mit der Weiterentwicklung der Möglichkeiten der Audio-KI sollte sich auch Ihr Geschäftsmodell weiterentwickeln. Sie können Audio-KI auf verschiedene Arten nutzen, wie zum Beispiel:

- Nutzung seiner Möglichkeiten zur Inhaltserstellung und Unterhaltung, um mit neuen Formen des Content-Marketings zu experimentieren

- Nutzen Sie es für eine effizientere Kommunikation innerhalb einer globalen Belegschaft

- Nutzen Sie es im Kundenservice für Effizienz und Skalierbarkeit

Um damit zu beginnen, während die Technologie ausgereift ist, richten Sie ein System von Pilotprojekten ein, um Audio-KI-Anwendungen zu testen. Sie sollten Ihr Augenmerk auf die Bereiche legen, in denen das größte potenzielle Wertpotenzial für Ihr Unternehmen besteht – beispielsweise die Analyse von Kundendaten zur Personalisierung von Interaktionen.

Dieser Ansatz wird Ihnen helfen, in einer technologischen Landschaft, die sich ständig verändert und KI akzeptiert, wettbewerbsfähig und relevant zu bleiben.

Bleiben Sie auf dem neuesten Stand der Fortschritte in Technologie und KI

Audio-KI ist bereits da und wird immer weiter fortgeschritten. Es verändert die Art und Weise, wie wir Inhalte erstellen, überspielen und suchen. In Zukunft werden die Anwendungen noch vielfältiger und Unternehmen dabei helfen, ihren Kundenservice, ihre interne Kommunikation und ihre Unterhaltungsprodukte zu verbessern.

Aus diesem Grund erläutern wir, wie die fortschrittlichsten Marketingorganisationen im Technologiebereich Innovationen hervorbringen und immer einen Schritt voraus sind.

Interessiert? Hier können Sie auf unsere vollständige Bibliothek mit Fallstudien und Aufschlüsselungen zugreifen .