Cómo evitar infracciones de cumplimiento durante el desarrollo de productos de IA

Publicado: 2023-06-12La inteligencia artificial se ha mantenido como la principal tendencia tecnológica durante varios años a través de sus contribuciones en sectores intensivos en datos y máquinas, como la fabricación, la atención médica y las finanzas. Sin embargo, es solo en los últimos dos años que la tecnología ha sido testigo de un gran interés por parte de los usuarios finales. Con aplicaciones como generadores de imágenes y texto, las personas ahora pueden producir imágenes y textos con un solo clic.

Si bien parece que estas plataformas de IA están produciendo material desde cero, ese no es el caso: estas plataformas de IA han sido entrenadas en fragmentos de preguntas y lagos de datos que funcionan mediante el procesamiento de archivos de texto e imágenes de Internet. Aunque es útil para los usuarios finales, el enfoque conlleva riesgos legales como la infracción de derechos de autor, el incumplimiento de las licencias de código abierto y la infracción de la propiedad intelectual, etc. con nuevas reglas y sanciones en torno a modelos de IA poco éticos.

Para una empresa que se prepara para lanzar su proyecto de IA, es fundamental que comprenda los riesgos y construya un sistema que no caiga bajo el radar legal detrás de estos problemas éticos. En este artículo, vamos a sumergirnos en las muchas facetas del cumplimiento de la IA durante el desarrollo de software: los tipos de problemas legales, las formas de prepararse para la regulación de la IA y los actos de IA seguidos por diferentes regiones.

¿Qué es el cumplimiento de la IA?

Es un proceso que garantiza que las aplicaciones impulsadas por IA cumplan con las regulaciones y leyes de la región en la que opera. Estos son los diferentes factores en los que consiste la verificación del cumplimiento de IA:

Los problemas legales con la inteligencia artificial

Si bien a un nivel micro puede parecer que los problemas con el uso de la IA por parte de los usuarios finales se limitan al plagio o al acceso a datos que no se pueden compartir, a un nivel macro el incumplimiento de la IA genera desafíos mayores.

Las amenazas derivadas del uso de un sistema de inteligencia artificial mal construido pueden afectar la competencia leal, la ciberseguridad, la protección del consumidor e incluso los derechos civiles. Por lo tanto, es fundamental que las empresas y los gobiernos construyan un modelo justo y ético.

Derechos de autor

Con el inicio de la IA generativa, las empresas han comenzado a crear material con derechos de autor a través de la tecnología. El problema con esto radica en la incapacidad de entender si los datos se han generado con la creatividad de un autor o si es la IA quien es el autor.

Para darle a esto un aspecto de cumplimiento legal, la Oficina de Derechos de Autor emitió una Guía sobre el examen y registro de obras que contienen material generado por IA. Dice lo siguiente:

- Los derechos de autor solo pueden proteger el material producido por la creatividad humana.

- En el caso de obras con material basado en IA, se considerará si las contribuciones de IA son el resultado de una “reproducción mecánica” o son una “concepción original propia del autor, a la que le dieron forma visible a través de la IA.

- Los solicitantes tienen el deber de revelar la participación de contenido basado en IA en el material presentado para el registro.

Lea también: Costo de desarrollar una herramienta de detección de contenido de IA en 2023

Fuente abierta

Los generadores de código impulsados por IA a menudo usan IA para ayudar a los desarrolladores a completar automáticamente o sugerir código en la parte posterior de las pruebas o entradas de los desarrolladores. Aquí hay algunos desafíos asociados con el desarrollo de modelos de IA compatibles con los generadores de código:

- ¿El entrenamiento de modelos de IA con código abierto significa infracción?

- ¿Quién es responsable de cumplir con los criterios de cumplimiento de código abierto: el desarrollador o el usuario?

- ¿El uso de código basado en IA por parte de los desarrolladores que crean nuevo software requerirá que la aplicación tenga una licencia de código abierto?

infracción de PI

A nivel mundial, se han presentado múltiples demandas por infracción contra las herramientas de IA, acusándolas del hecho de que están entrenando sus modelos o generando resultados sobre la base de contenido protegido por IP de terceros.

Sesgo ético

Ha habido numerosos incidentes en los que la tecnología de reconocimiento facial de IA ha llevado a la discriminación racial. Ya sea el caso en el que en 2020, personas negras fueron arrestadas debido a un error informático o Google Photos etiquetando a las personas negras como "gorila". Independientemente de cuán inteligente sea la tecnología, no se puede ignorar que está construida por humanos con prejuicios.

Para las empresas que buscan crear soluciones similares, es crucial que no permitan que estos sesgos entren en el sistema.

Cumplimiento del RGPD para proyectos de IA

Dicho esto, es crucial entender por qué las empresas no pueden construir modelos de IA compatibles a pesar de las estrictas regulaciones. Puede haber varias razones detrás de esto, que van desde la incapacidad de conocer el cumplimiento, la falta de comprensión de los desarrolladores y, a veces, la simple ignorancia. Sin embargo, también puede haber algunas razones funcionales detrás de esto.

Analicemos algunos de ellos desde la perspectiva del cumplimiento de GDPR para proyectos de IA.

Limitación de propósito

El principio del RGPD obliga a las empresas a informar a los interesados sobre la finalidad para la que se recopila y procesa su información. El desafío con esto es que la tecnología usa datos para encontrar patrones y obtener nuevos conocimientos, pero ese podría no ser el propósito real de esos datos.

Discriminación

GDPR requiere que los desarrolladores de IA tomen medidas contra el impacto discriminatorio que puede tener la tecnología. Si bien es una necesidad ética del momento, para un desarrollador que opera un escenario social que cambia rápidamente, preparar el modelo de IA contra toda discriminación y salida inmoral puede convertirse en un desafío.

Minimización de datos

GDPR dice que la información recopilada debe ser "adecuada, limitada y relevante". Esto significa que los equipos de desarrollo de IA deben tener mucho cuidado al usar datos para sus modelos y deben tener claro la cantidad de datos necesarios para su proyecto.

Sin embargo, esto no es predecible, por lo que los equipos deben evaluar regularmente el tipo y la cantidad de datos que necesitan para abordar el requisito de minimización de datos.

Transparencia

Por último, los usuarios deben tener voz sobre cómo los terceros utilizan sus datos, para esto, las empresas deberán tener claro qué datos están utilizando y cómo.

El problema con esto es que la mayoría de los modelos de IA operan en cajas negras y no está claro cómo toman decisiones, especialmente cuando hablamos de software avanzado.

Aunque todos estos son problemas técnicos genuinos, cuando se trata de ética de TI, es fundamental que las empresas no los utilicen como escudos para desarrollar un modelo de IA defectuoso. Para garantizar que la práctica no se generalice, se han promulgado varias leyes de IA a escala mundial.

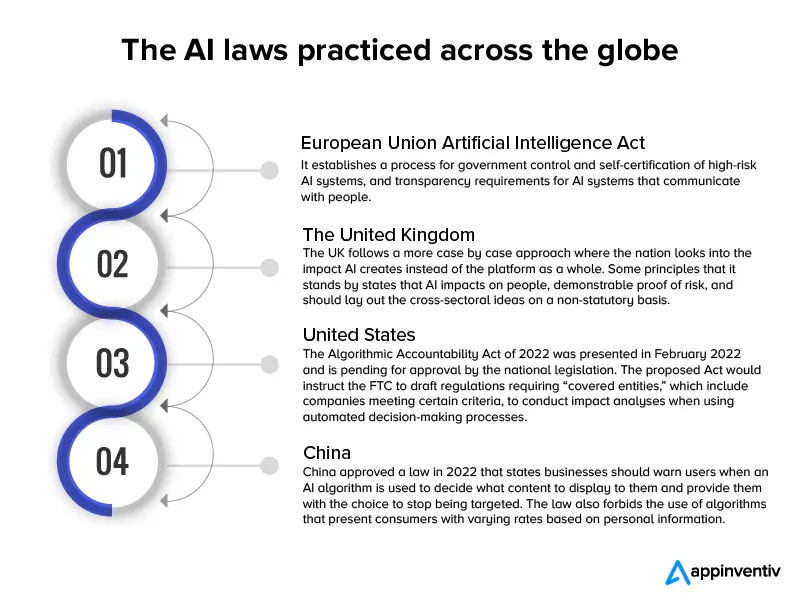

Casi 60 naciones han introducido leyes y regulaciones de inteligencia artificial desde 2017, una línea de acción que coincide con la velocidad a la que se implementan los nuevos modelos de IA.

Aquí hay una infografía que da una breve visión de esas leyes.

Ahora que hemos analizado los desafíos del desarrollo de IA desde el punto de vista legal y el borrador de las leyes aplicables a nivel mundial, pasemos a las formas en que puede crear una aplicación de IA compatible.

Lea también: ¿Cuánto cuesta desarrollar un chatbot que cumpla con la ley como ChatGPT?

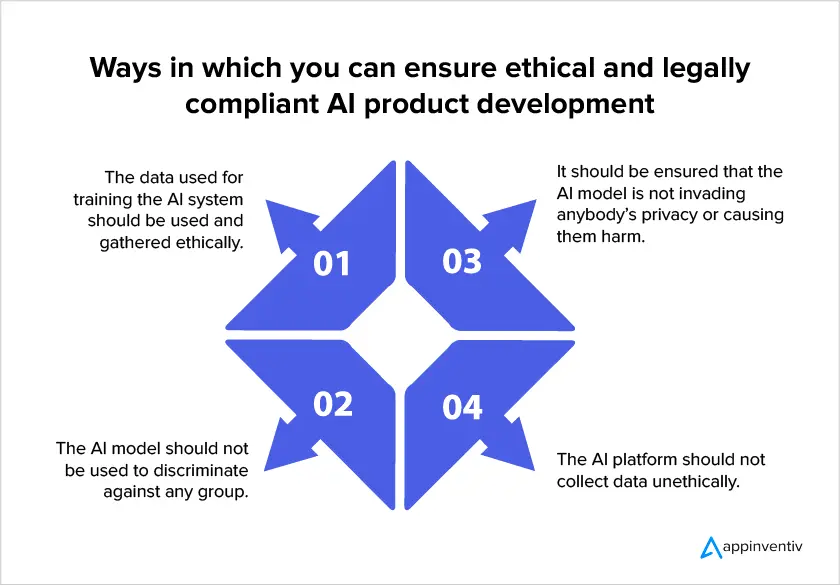

Cómo desarrollar un modelo de IA compatible con el cumplimiento

Debido al aumento de las regulaciones de IA a nivel mundial, se ha vuelto fundamental para las empresas centrarse en el cumplimiento legal cuando construyen modelos de IA. Aquí hay algunas formas en que las empresas pueden garantizar que su proyecto cumpla con la ley al invertir en servicios de desarrollo de IA.

- Asegúrese de que tiene permiso para usar los datos

Los cumplimientos de AI establecen que la privacidad de los usuarios debe ser el principio rector del diseño del modelo. Esto significa que debe mantener la cantidad de datos que necesita recopilar al mínimo, especificar el motivo exacto de la recopilación de datos, junto con el tiempo hasta el que utilizará sus datos. En última instancia, es importante tener en cuenta que los usuarios deben dar su consentimiento para la recopilación de datos.

- Métodos de IA explicables

Este enfoque ayuda a resolver el efecto de caja negra al ayudar a los humanos a comprender qué hay dentro de los sistemas de IA y cómo el modelo toma decisiones. Esto, a su vez, ayuda a los investigadores a conocer la cantidad exacta de datos que necesitarán para mejorar la precisión del modelo y cumplir con los requisitos de minimización de datos.

- Realizar un seguimiento de los datos recopilados

Los cumplimientos de IA requieren que las empresas conozcan la ubicación y el uso de la PII recopilada. Se necesita una categorización correcta de los datos para cumplir con el derecho de los usuarios a la información protegida. Además, las empresas deben tener un enfoque para saber qué información se almacena en qué conjunto de datos para preparar medidas de seguridad precisas.

- Comprender las reglas de transmisión de datos entre países

Cuando hay una transferencia de datos transfronteriza en un sistema de IA, los desarrolladores deben considerar las regulaciones que se aplicarán en los países receptores y construir mecanismos de transferencia de datos apropiados en consecuencia. Por ejemplo, si el RGPD es aplicable al procesamiento de datos y los datos personales se transfieren a un país fuera del EEE, se debe realizar una evaluación adecuada del impacto de la transferencia.

El uso de tales enfoques al desarrollar aplicaciones de IA contribuye en gran medida a garantizar que los riesgos asociados con la tecnología se aborden adecuadamente. Sin embargo, las empresas y los reguladores deben tener en cuenta el hecho de que es imposible salvaguardar la aplicación de todos los riesgos potenciales, ya que el contexto de la industria funciona según un modelo caso por caso. Debido a esto, el papel de los administradores de riesgos de IA seguirá siendo fundamental, ya que podrán evaluar cuándo se necesita una intervención.

Esperamos que el artículo lo haya ayudado a comprender qué esperar de la estructura legal que rodea la tecnología de IA en el futuro y las formas de prepararse para un modelo de IA compatible.

preguntas frecuentes

P. ¿Hay algún problema legal con la inteligencia artificial?

R. Sí. Puede haber una serie de problemas legales y éticos asociados con un modelo de inteligencia artificial mal construido.

- Derechos de autor

- Uso indebido de licencias de código abierto

- infracción de PI

- Sesgo ético como la discriminación racial.

P. ¿Por qué es difícil hacer un modelo de IA que cumpla con la ley?

R. Desde el punto de vista técnico, puede ser difícil crear una IA que cumpla con la ley porque, si bien la tecnología utiliza los datos de los clientes para encontrar patrones y obtener nuevos conocimientos, resulta difícil determinar el propósito real de esos datos. Luego, los equipos de desarrollo de IA nunca pueden estar seguros de la cantidad de datos necesarios para su proyecto. Por último, la mayoría de los modelos de IA operan en cajas negras y no está claro cómo toman decisiones, especialmente cuando hablamos de software avanzado.

P. ¿Cómo asegurar el cumplimiento legal en IA?

R. Si bien las leyes y regulaciones sobre el cumplimiento legal de la IA están en constante evolución, aquí hay algunas cosas que puede hacer para asegurarse de que su modelo esté más cerca de cumplir:

- Asegúrese de que tiene permiso para usar los datos

- Métodos de IA explicables

- Realizar un seguimiento de los datos recopilados

- Comprender las reglas de transmisión de datos entre países