Sous le code : analyse des risques fondamentaux de l'IA et de leurs contre-mesures

Publié: 2023-09-25Les organisations se lancent rapidement tête première dans le monde de l’IA pour dynamiser leurs processus et acquérir un avantage concurrentiel. Cependant, il est essentiel de comprendre que leur parcours en matière d’IA ne sera pas toujours ensoleillé et qu’il pourrait s’accompagner de certains risques et défis. Alors que la technologie de l’IA évolue à une vitesse sans précédent, les organisations doivent être prêtes à s’adapter à l’échelle mondiale. Afin de réussir dans cet écosystème numérique acharné, il est crucial de comprendre les pièges potentiels et d’adopter les meilleures pratiques pour naviguer dans le multivers de l’IA.

À mesure que l’intelligence artificielle progresse, on s’inquiète de plus en plus de ses dangers potentiels. Geoffrey Hinton, le « parrain de l’IA », connu pour ses travaux louables dans le domaine de l’apprentissage automatique et des réseaux neuronaux, a averti que les systèmes d’IA progressent à un rythme sans précédent et peuvent présenter un risque de prise de contrôle s’ils ne sont pas gérés avec une surveillance appropriée. Il a en outre souligné la nécessité vitale de traiter ces questions connexes de manière proactive.

Dans un autre cas, Elon Musk a également préconisé une pause dans les expériences d’IA à grande échelle. Ces préoccupations des dirigeants mondiaux concernant les risques potentiels de l’IA montrent que la communauté technologique doit examiner attentivement les implications et les défis éthiques qui peuvent survenir avec les progrès des capacités de l’IA.

Aujourd’hui, à mesure que le monde avance, l’IA générative tend à devenir très populaire. Étant donné qu’un grand pouvoir entraîne souvent des responsabilités inconditionnelles, la mise en œuvre de l’IA générative comporte également un certain degré de risque éthique.

Ainsi, en tant que propriétaire d’entreprise, il est grand temps de comprendre que l’IA peut apporter de grands avantages, mais qu’elle s’accompagne également de défis familiers qui surgissent lors de l’introduction de toute nouvelle technologie dans vos opérations quotidiennes.

Les organisations doivent donner la priorité à une utilisation responsable en garantissant l’exactitude, la sécurité, l’honnêteté, l’autonomisation et la durabilité. Face à certains défis et risques, ils peuvent s’appuyer sur les meilleures pratiques éprouvées qui se sont révélées efficaces pour adopter avec succès d’autres technologies. Ces stratégies peuvent constituer une base solide pour intégrer l’IA dans vos opérations commerciales et atténuer les risques liés à l’IA en cours de route.

Ce blog vous aidera à comprendre tout ce qui concerne les risques de l'IA pour votre entreprise et comment les atténuer. Alors, sans plus tarder, entrons directement dans les détails.

Comprendre les risques liés à l'IA

Selon AI RMF 1.0, le cadre de gestion des risques liés à l'intelligence artificielle, publié par le National Institute of Standards and Technology (NIST), les risques liés à l'IA englobent les dommages potentiels causés aux individus, aux organisations ou aux systèmes résultant du développement et du déploiement de systèmes d'IA. Ces risques peuvent résulter de divers facteurs, notamment des données utilisées pour entraîner l’IA, de l’algorithme d’IA, de son utilisation à des fins multiples et des interactions avec les personnes. Les exemples de risques et de contrôles de l’IA varient des outils de recrutement biaisés aux algorithmes provoquant des krachs boursiers.

La surveillance proactive des produits et services basés sur l’IA est cruciale pour garantir la sûreté et la sécurité des données et des individus. Ainsi, l'organisation croit en l'utilisation d'une solution de gestion des risques qui peut aider à trier, vérifier et atténuer efficacement ces risques.

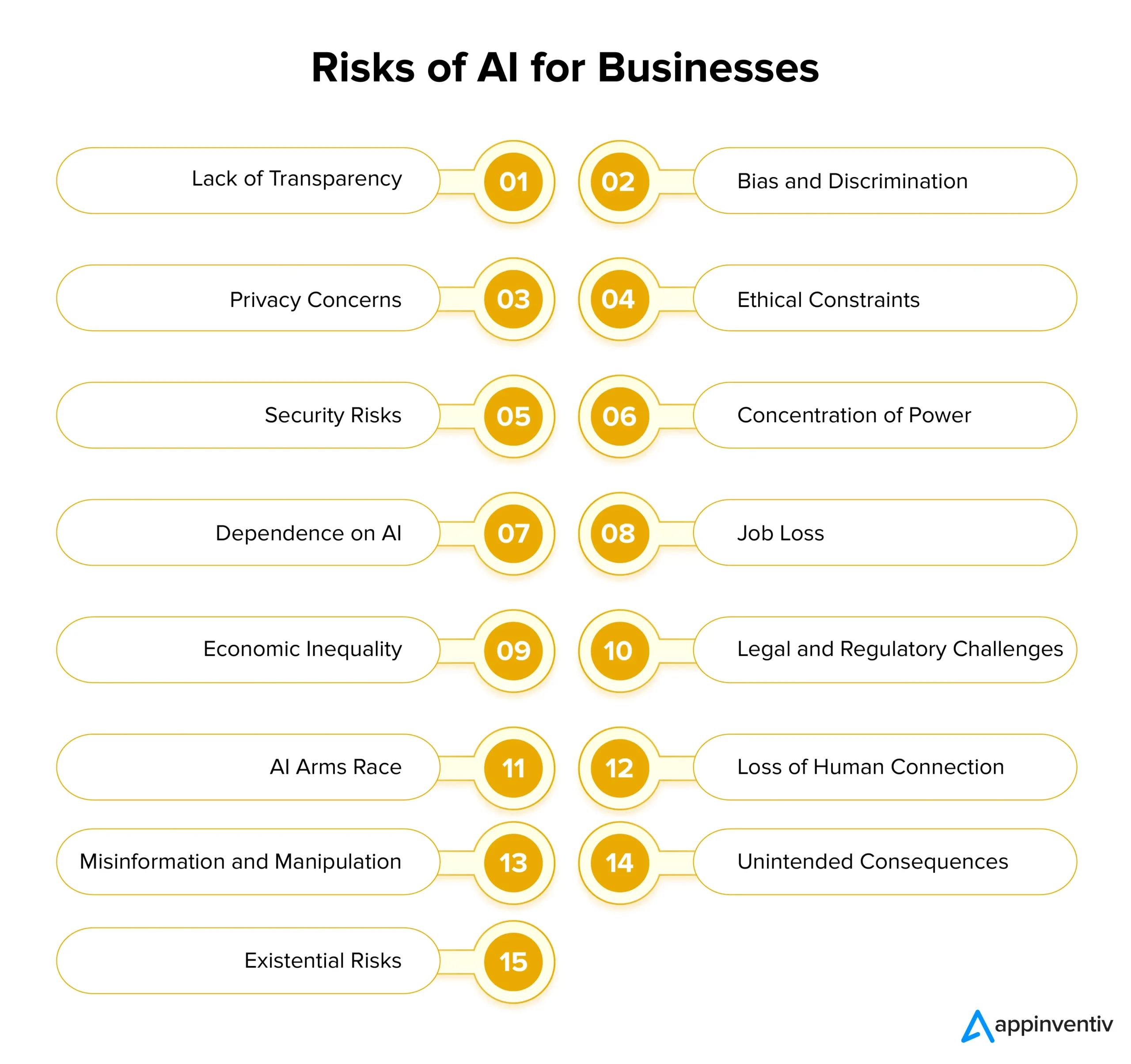

Identifier les risques et les défis de l'IA pour les entreprises

L’IA offre un immense potentiel aux entreprises mais comporte également des risques importants lors de sa mise en œuvre. Pour garantir une adoption responsable de l’IA, il est essentiel de comprendre et de relever ces défis au bon moment. Examinons en détail ci-dessous les risques et les solutions de l’IA pour les entreprises :

Manque de transparence

Les systèmes d’IA fonctionnent souvent de manière non transparente, ce qui rend difficile la compréhension de la manière dont ils prennent plusieurs décisions. Ce manque de transparence peut conduire à la méfiance des utilisateurs et des parties prenantes. Pour résoudre ce problème, les entreprises doivent donner la priorité à la transparence en concevant des modèles et des algorithmes d’IA qui fournissent des informations sur leurs processus décisionnels.

Cela peut être simplement facilité en utilisant une documentation claire, des techniques d’IA explicables et des outils pour visualiser les résultats basés sur l’IA. Il est important de comprendre que l’IA transparente renforce la confiance globale entre les parties et leurs décisions et contribue au respect de la réglementation.

Préjugés et discrimination

Les systèmes d’IA ont le potentiel de maintenir facilement les préjugés sociétaux trouvés dans leurs données de formation. Cela peut conduire à des prises de décision biaisées, à de la discrimination et à un traitement injuste de certains groupes. Pour faire face à ces risques liés à l’IA, les organisations doivent prioriser l’investissement dans des données de formation diverses et représentatives qu’elles peuvent analyser.

En outre, la mise en œuvre d’algorithmes de détection et de correction des biais et la réalisation d’audits réguliers des modèles d’IA peuvent aider à identifier et à éliminer les biais des systèmes existants. Le développement éthique de l’IA doit donner la priorité à l’équité et à l’impartialité comme principes fondamentaux.

Problèmes de confidentialité

L’un des plus grands risques et défis de l’IA est la menace pour la vie privée. L’IA nécessite souvent de collecter et d’analyser de grandes quantités de données personnelles, ce qui soulève des problèmes de confidentialité et de sécurité. Les entreprises doivent donner la priorité à la protection des données en adhérant à des réglementations strictes en matière de confidentialité, en mettant en œuvre des mesures de cybersécurité robustes et en adoptant des techniques de cryptage des données. Cela peut aider à protéger la confidentialité des utilisateurs et à maintenir la confiance.

Contraintes éthiques

Les systèmes d’IA impliqués dans des prises de décision critiques sont souvent confrontés à des dilemmes éthiques qui peuvent en outre avoir des impacts sociétaux préjudiciables. Les organisations doivent établir des lignes directrices et des principes éthiques pour le développement et le déploiement de l’IA afin de répondre à ce risque. Les considérations éthiques devraient être l’une des composantes essentielles des projets d’IA, garantissant que l’IA s’aligne sur les valeurs sociétales et les normes éthiques.

Risques de sécurité

À mesure que les technologies de l’IA progressent, les risques de sécurité évoluent également. Les activités malveillantes peuvent exploiter les systèmes d’IA et créer des cyberattaques plus dangereuses, représentant une menace importante pour les entreprises. Les organisations doivent mettre en œuvre des mesures de sécurité robustes pour atténuer les risques de sécurité, notamment le chiffrement, les protocoles d’authentification et les systèmes de détection des menaces basés sur l’IA. Une surveillance continue et des contrôles réguliers des vulnérabilités sont essentiels pour garantir le déploiement des systèmes d’IA.

Concentration du pouvoir

Lorsque seules quelques grandes entreprises et gouvernements contrôlent le développement de l’IA, cela peut rendre les choses injustes et réduire la diversité des utilisations de l’IA. Pour éviter cela, les entreprises devraient s’efforcer de partager plus largement le développement de l’IA entre plusieurs groupes. Ils peuvent y parvenir en soutenant les petites startups, en encourageant les nouvelles idées et en aidant les projets d’IA open source. De cette façon, l’IA devient plus accessible à tous.

Dépendance à l'IA

Une dépendance excessive à l’égard des systèmes d’IA peut entraîner une perte de créativité, de pensée critique et d’intuition humaine. Il est essentiel de trouver un équilibre entre la prise de décision assistée par l’IA et le jugement humain. Par exemple, les chercheurs ont souligné le problème de « l’effondrement du modèle », dans lequel les modèles d’IA génératifs formés sur des données synthétiques peuvent produire des résultats de moindre qualité parce qu’ils donnent simplement la priorité aux choix de mots courants plutôt qu’aux alternatives créatives.

Les entreprises doivent former leurs employés à travailler aux côtés de l’IA afin d’éviter les risques potentiels de l’IA. Encourager l’apprentissage continu peut aider les organisations à exploiter le potentiel de l’IA tout en préservant les compétences humaines. En plus de cela, l'utilisation de diverses données de formation et techniques de régularisation peut également aider à atténuer ces défis associés à l'effondrement du modèle.

Perte d'emploi

L’automatisation basée sur l’IA a le potentiel de déplacer des emplois dans divers secteurs, les travailleurs les moins qualifiés étant les principales cibles. Les organisations doivent relever ce défi de manière proactive en offrant à leur personnel la possibilité d'apprendre de nouvelles mesures et de croître avec les progrès technologiques. Promouvoir l’apprentissage tout au long de la vie et l’adaptabilité est essentiel pour atténuer les inquiétudes concernant la perte d’emplois dans plusieurs secteurs.

Inégalité économique

Les inégalités économiques constituent un autre risque et défi notable en matière d’IA dont les entreprises doivent être conscientes. L’IA peut potentiellement aggraver les inégalités économiques, car elle profite souvent aux riches et aux grandes entreprises. Pour rendre l’IA plus équitable, les décideurs politiques et les entreprises devraient réfléchir aux moyens d’inclure davantage de personnes dans le développement de l’IA. Ils peuvent y parvenir en créant des programmes permettant à davantage de personnes d’utiliser les outils d’IA.

Défis juridiques et réglementaires

L’IA introduit de nouvelles complexités juridiques et réglementaires, notamment des questions de responsabilité et de droits de propriété intellectuelle. Les cadres juridiques doivent évoluer afin de pouvoir suivre les progrès technologiques. Les organisations doivent rester informées des réglementations liées à l’IA et s’engager activement auprès des décideurs politiques pour façonner une gouvernance et des pratiques responsables en matière d’IA. Les entreprises peuvent utiliser l'IA pour les solutions de gestion des risques et de la conformité afin d'analyser facilement de grandes quantités d'informations et de données tout en identifiant les risques potentiels associés à la conformité.

[Lire aussi : Comment éviter les violations de conformité lors du développement de produits d'IA]

Course aux armements IA

Lorsque des pays se lancent dans une course aux armements en matière d’IA, cela peut signifier que la technologie de l’IA se développe trop rapidement, ce qui peut être dangereux. Pour prévenir ces risques liés à l’IA, il est important d’encourager le développement responsable de l’IA. Les pays devraient travailler ensemble et conclure des accords sur la manière dont l’IA peut être utilisée à des fins de défense. De cette façon, nous pouvons réduire le risque que l’IA cause des dommages dans la course à une technologie plus avancée que dans d’autres pays.

Perte de connexion humaine

Le recours croissant à la communication et aux interactions basées sur l’IA peut entraîner une diminution de l’empathie, des compétences sociales et des relations humaines. Les organisations doivent donner la priorité à une conception centrée sur l’humain, en soulignant l’importance de maintenir des interactions humaines significatives en plus de l’intégration de l’IA.

Désinformation et manipulation

Les contenus générés par l’IA comme les deepfakes présentent un risque important en contribuant à la diffusion de fausses informations et à la manipulation de l’opinion publique. La mise en œuvre d’outils basés sur l’IA pour détecter la désinformation et les campagnes de sensibilisation du public peuvent contribuer à préserver l’intégrité des informations dans cette ère numérique en évolution rapide.

Conséquences inattendues

En raison de leur complexité, les systèmes d’IA peuvent présenter des comportements inattendus ou prendre des décisions aux conséquences imprévues. Des processus rigoureux de tests, de validation et de surveillance continue sont essentiels pour identifier et résoudre ces problèmes avant qu’ils ne s’aggravent et ne causent des dommages.

Risques existentiels

Créer une intelligence générale artificielle (AGI) plus intelligente que les humains soulève de grandes inquiétudes. Les organisations doivent s'assurer qu'AGI partage ses valeurs et ses objectifs pour éviter de terribles conséquences. Cela nécessite une planification minutieuse à long terme, des règles éthiques strictes et une collaboration à l’échelle mondiale pour gérer les risques importants liés à l’AGI.

Après avoir examiné les multiples défis et risques imposés par la technologie de l’IA et la manière dont certains risques liés à l’IA peuvent être gérés, passons à autre chose et examinons en détail la gouvernance de l’IA.

Gouvernance de l’IA pour gérer les risques

Une gouvernance efficace de l’IA implique d’identifier et de gérer les risques de l’IA à travers trois approches clés :

Principes : ceux-ci impliquent des lignes directrices qui facilitent le développement de systèmes d’IA et leur utilisation. Celles-ci sont souvent alignées sur les normes législatives et sociétales.

Processus : Gérer les risques et les dommages potentiels résultant de défauts de conception et de structures de gouvernance inadéquates.

Conscience éthique : cette approche est motivée par le sentiment de ce qui est juste et bon. Cela implique de suivre des règles, de s'assurer que les choses sont faites correctement, de penser à sa réputation, d'être socialement responsable et de correspondre aux valeurs et aux croyances de l'organisation.

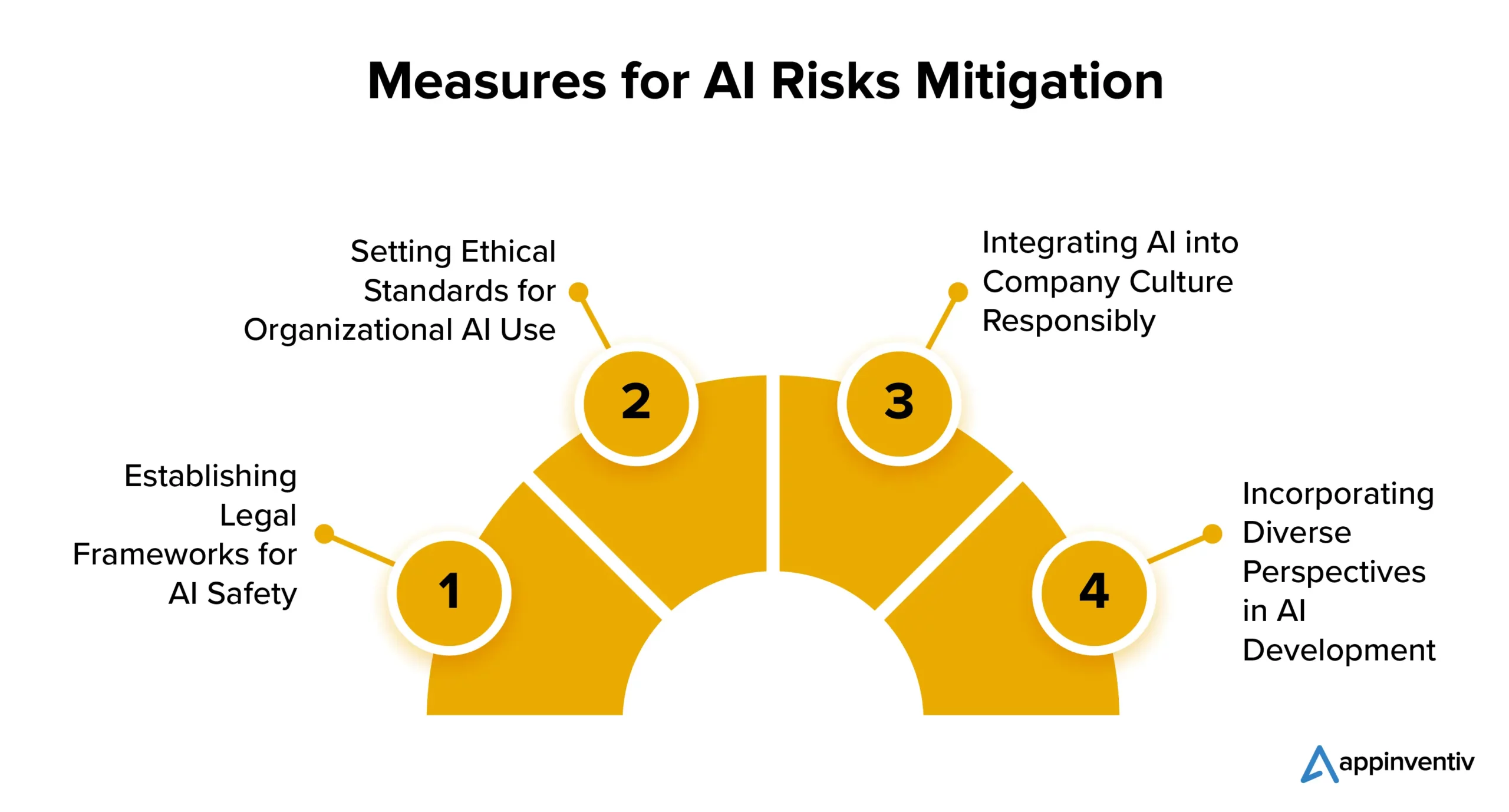

Atténuer les risques liés à l'IA : comment rester en sécurité grâce à l'intelligence artificielle

Voici plusieurs stratégies que les entreprises peuvent mettre en œuvre afin d’atténuer les risques liés à la mise en œuvre de l’IA :

Établir des cadres juridiques pour la sécurité de l'IA

De nombreux pays se concentrent sur la réglementation de l’IA. Les États-Unis et l’Union européenne travaillent sur un ensemble de règles claires pour contrôler la propagation et l’utilisation de l’IA. Même si certaines technologies d’IA peuvent être confrontées à des restrictions, cela ne devrait pas empêcher les entreprises d’explorer le potentiel de l’IA à leur profit.

Établir des normes éthiques pour l’utilisation organisationnelle de l’IA

Il est crucial d'équilibrer la réglementation et l'innovation. L’IA est essentielle au progrès, c’est pourquoi les organisations doivent établir des normes pour le développement et l’utilisation éthiques de l’IA. Cela devrait inclure la mise en œuvre d’algorithmes de surveillance, l’utilisation de données de haute qualité et la transparence sur les décisions en matière d’IA.

Intégrer l'IA dans la culture d'entreprise de manière responsable

L’une des stratégies recherchées pour atténuer les risques liés à l’IA consiste à introduire l’IA dans la culture d’entreprise elle-même. Les entreprises peuvent intégrer l’IA dans leur culture en établissant des lignes directrices acceptables en matière de technologies et de processus d’IA. Cela garantit que l’IA est utilisée de manière éthique et responsable au sein de l’organisation, atténuant ainsi les risques probables liés à l’IA.

Intégrer diverses perspectives dans le développement de l'IA

Les développeurs d’IA doivent prendre en compte diverses perspectives, notamment celles provenant d’horizons et de domaines différents comme le droit, la philosophie et la sociologie. Cette approche inclusive contribue à créer une IA responsable qui profite à tous.

Comment Appinventiv peut-il contribuer à garantir les meilleures pratiques pour le développement de l'IA

Même si l’adoption de l’IA continue de croître, la gestion efficace des risques reste à la traîne. Le défi réside dans le fait que les entreprises ne reconnaissent souvent pas la nécessité d’intervenir ainsi que les pratiques de développement durable de l’IA.

Selon un rapport du MIT Sloan Management Review et du Boston Consulting Group, 42 % des personnes interrogées considèrent l'IA comme une priorité stratégique majeure, tandis que seulement 19 % ont confirmé que leur organisation avait mis en place un programme d'IA responsable. Cet écart augmente le risque d’échec et rend les entreprises vulnérables aux problèmes réglementaires, financiers et de réputation causés par la mise en œuvre de l’IA.

Même si la gestion des risques liés à l’IA peut commencer à n’importe quelle étape du projet, il est essentiel d’établir un cadre de gestion des risques le plus tôt possible. Cela peut renforcer la confiance et permettre aux entreprises d’évoluer en toute confiance.

En tant que société dédiée au développement de l'IA, notre équipe possède des années d'expertise dans la création de solutions d'IA soutenues par un fort accent sur l'éthique et la responsabilité. Notre expérience éprouvée dans divers domaines industriels témoigne de notre engagement à aligner les solutions d’IA sur les valeurs fondamentales et les principes éthiques.

Nous sommes bien équipés pour vous aider à mettre en œuvre des mesures d’équité afin de garantir que vos solutions commerciales basées sur l’IA prennent systématiquement des décisions impartiales et impartiales.

Nous avons récemment développé YouComm, une application de soins de santé basée sur l'IA qui permet aux patients de se connecter avec le personnel hospitalier avec de simples gestes manuels et des commandes vocales. La solution est désormais mise en œuvre dans plus de 5 chaînes d’hôpitaux aux États-Unis.

Contactez nos experts pour comprendre complètement la gestion des risques d’IA associés à votre projet et comment vous pouvez les atténuer facilement.

FAQ

Q. Quels sont les risques de l’IA ?

R. L’IA comporte des risques inhérents, notamment des préjugés, des problèmes de confidentialité, des dilemmes éthiques et des menaces pour la sécurité. Cela peut également entraîner des suppressions d’emplois, aggraver les inégalités économiques et poser des problèmes juridiques et réglementaires. De plus, les progrès de l’IA superintelligente soulèvent des préoccupations existentielles quant à l’alignement sur les valeurs humaines. Pour garantir une utilisation responsable et bénéfique de la technologie et éviter les risques associés à l’IA, il est crucial de mettre en œuvre une gestion prudente, des considérations éthiques et des mesures réglementaires.

Q. Comment l’IA peut-elle être utilisée pour atténuer les risques liés à l’IA ?

A. L'IA joue un rôle important dans l'atténuation des risques liés à l'IA en facilitant la détection et la correction des biais, l'analyse prédictive, la surveillance de la sécurité, l'aide à la décision éthique, etc. Voyons en détail comment nous pouvons contribuer à atténuer les risques liés à l'IA :

- Les algorithmes d’IA peuvent identifier et rectifier les biais dans les données, réduisant ainsi les résultats biaisés de l’IA.

- L'analyse prédictive peut anticiper les risques et permettre des mesures préventives.

- Les outils de cybersécurité basés sur l'IA peuvent détecter et contrer les menaces basées sur l'IA.

- L’IA peut guider dans la prise de choix éthiques.

- L'automatisation peut garantir le respect des réglementations, réduisant ainsi les risques liés à la conformité.