Bagaimana AI yang Dapat Dijelaskan dapat Membuka Perkembangan Kecerdasan Buatan yang Akuntabel dan Etis

Diterbitkan: 2023-09-01Dengan momen transformatif yang memadukan inovasi dan kecerdikan, seperti peluncuran ChatGPT OpenAI pada November 2022, visi AI yang mengendalikan hidup kita bukan lagi fiksi ilmiah.

Momen penting dalam peluncuran ChatGPT mengantarkan pada apa yang disebut oleh industri sebagai 'Ledakan Kambrium AI'.

Namun, hal ini lebih dari sekedar penggunaan AI untuk keuntungan bisnis, yang saat ini menjadi titik fokus ledakan ini. Inti dari evolusi ini adalah seruan untuk fokus pada kemampuan menjelaskan AI. Hal ini akan memastikan bahwa kemajuan dalam AI bersifat kuat dan transparan—yang merupakan hal mendasar bagi pengembangan AI yang etis.

Kecerdasan buatan telah membuat keputusan bagi kita di banyak bidang. Namun tidak memahami bagaimana AI mengambil keputusan tersebut masih menjadi hambatan. Ini adalah salah satu manfaat AI yang tidak dapat diabaikan oleh pengusaha dan pakar teknologi.

Seiring dengan kemajuan teknologi, tantangan bagi para pakar teknologi ada dua: untuk mendorong batas-batas pencapaian AI sambil memastikan bahwa cara kerjanya transparan, akuntabel, dan masuk akal secara etis. Hal ini menyoroti peran AI yang dapat dijelaskan dalam teknologi modern.

Potensi Ekonomi AI

Potensi AI generatif untuk merevolusi produktivitas tidak hanya bersifat teoretis; hal ini diperkirakan akan mempunyai konsekuensi ekonomi yang nyata dalam skala global. Menurut laporan pada bulan Juni 2023 berjudul “Potensi ekonomi AI generatif: Perbatasan produktivitas berikutnya” yang diterbitkan oleh McKinsey, AI generatif dapat menambah nilai mulai dari $2,6 triliun hingga $4,4 triliun per tahun di 63 kasus penggunaan yang dianalisis. Terdapat juga kasus penggunaan AI yang dapat dijelaskan dan dapat memberikan manfaat bagi industri dalam berbagai cara baru.

Baca juga: Bagaimana AI Generatif untuk Bisnis Membentuk Industri

The Washington Post melaporkan bahwa lebih dari 11.000 perusahaan telah memanfaatkan alat OpenAI yang disediakan oleh divisi cloud Microsoft, sehingga menyoroti tren adopsi yang menyertai potensi ini. Angka-angka ini mewakili peluang dan tanggung jawab bagi para pemimpin teknologi dalam menavigasi lanskap yang terus berkembang ini.

Seiring dengan semakin nyatanya potensi transformatif AI, terdapat peningkatan penekanan pada prinsip-prinsip AI yang dapat dijelaskan, untuk memastikan alat canggih ini beroperasi dengan kejelasan, pengawasan, dan pertimbangan etis. Penerapan AI yang dapat dijelaskan diharapkan menjadi landasan dalam industri teknologi.

Namun, memahami manfaat AI yang dapat dijelaskan dan aspek terkait lainnya hanyalah permulaan. Oleh karena itu, sebelum kita membahas nuansa pengembangan AI yang Dapat Dijelaskan secara mendetail, pertama-tama kita harus memahami mengapa hal ini penting.

Misteri Model AI: Menavigasi 'Kotak Hitam'

Seperti semua kemajuan yang signifikan, AI membawa tantangan, beberapa di antaranya sangat terkait dengan strukturnya. Salah satu aspek dari misteri ini adalah 'kotak hitam'. Mewakili model operasional tertutup yang berfungsi, namun pengembangnya pun terkadang tidak mampu menjelaskan cara kerjanya. Hal ini dikenal sebagai teka-teki kotak hitam dalam industri AI.

Kurangnya transparansi ini tidak dapat diterima oleh banyak orang, terutama mereka yang bertanggung jawab atas keputusan-keputusan penting dalam bisnis atau kemasyarakatan. AI yang berfungsi tanpa penjelasan berisiko mengikis kepercayaan, terutama bila kerugian fisik dan materi mungkin terjadi.

Konsekuensi Tak Terduga: Ketika AI Keluar dari Rel

Konsekuensi dari keputusan AI yang tidak dapat dijelaskan dapat berkisar dari inefisiensi kecil hingga dampak sosial yang signifikan. Pertimbangkan sektor keuangan: sistem AI mungkin menolak pinjaman kepada seseorang tanpa memberikan alasan yang jelas.

Keputusan seperti itu, yang tidak transparan, dapat menimbulkan komplikasi hukum dan kerusakan reputasi. Dalam skala yang lebih besar, dalam layanan kesehatan, AI yang tidak dapat dipahami mungkin memprioritaskan satu pasien dibandingkan pasien lainnya untuk mendapatkan perawatan, dengan konsekuensi yang dapat mengubah hidup atau bahkan mengakhiri hidup.

Contoh Dunia Nyata dari Hasil dan Kecelakaan AI yang Tak Terduga

Beberapa insiden menyoroti konsekuensi AI yang tidak terduga. Insiden tragis tahun 2018 yang melibatkan mobil self-driving Uber menggarisbawahi implikasi mengerikan ketika AI salah menafsirkan lingkungannya. Algoritme layanan kesehatan terkemuka yang ditemukan memiliki bias rasial merupakan pengingat bahwa AI, betapapun canggihnya, dapat secara tidak sengaja melanggengkan bias manusia jika tidak dipahami dan dipantau secara memadai.

Daftarnya terus berlanjut, mulai dari Tay dari Microsoft, yang men-tweet hal-hal seperti “Hitler benar,” hingga seorang warga negara Amerika yang menerima tagihan kartu kredit dalam jumlah besar. Tanpa batasan dan kemampuan untuk menafsirkan keputusan yang dibuat oleh AI, kejadian seperti itu akan terus terjadi, oleh karena itu diperlukan penjelasan.

Kasus Bisnis: Manfaat AI yang Dapat Dijelaskan

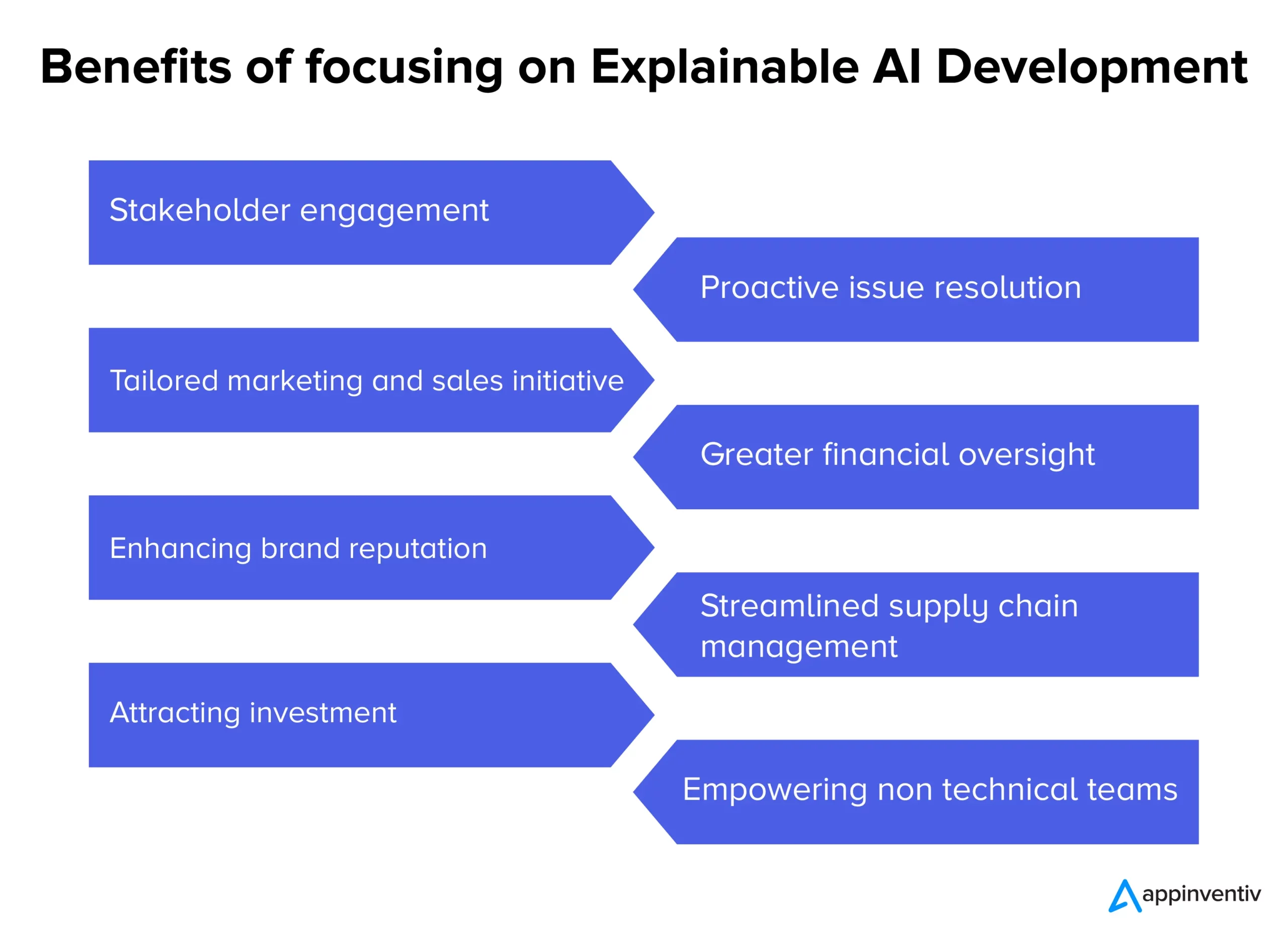

Ketika sistem AI semakin mendorong ambisi, ketidakjelasan yang melekat pada sistem tersebut telah memicu perbincangan seputar pentingnya transparansi. Selain wacana teknis, terdapat alasan bisnis kuat yang mendasari penerapan AI yang dapat dijelaskan. Berikut adalah berbagai manfaat AI yang dapat dijelaskan bagi bisnis di berbagai industri.

- Keterlibatan dan Keyakinan Pemangku Kepentingan: Proses pengambilan keputusan AI yang transparan dapat menumbuhkan rasa keterlibatan dan kepastian yang lebih mendalam di antara tim internal dan mitra eksternal.

- Penyelesaian Masalah yang Proaktif: Sebelum masalah meningkat, AI yang dapat dijelaskan dapat menyoroti potensi permasalahan, memungkinkan intervensi dan solusi tepat waktu.

- Inisiatif Pemasaran dan Penjualan yang Disesuaikan: Bisnis dapat merancang kampanye yang lebih personal dan efektif dengan memahami 'alasan' di balik wawasan konsumen yang digerakkan oleh AI.

- Pengawasan Keuangan yang Lebih Besar: Ketika model dan prakiraan keuangan berbasis AI bersifat transparan, potensi anomali atau area pertumbuhan dapat lebih mudah diidentifikasi dan diatasi.

- Meningkatkan Reputasi Merek: Perusahaan yang dikenal dengan penerapan AI yang etis dan transparan kemungkinan besar akan menikmati reputasi merek yang lebih tinggi.

- Manajemen Rantai Pasokan yang Efisien: Dengan wawasan jelas yang didorong oleh AI, proses rantai pasokan dapat dioptimalkan dengan lebih efektif, mulai dari manajemen inventaris hingga logistik.

- Menarik Investasi: Bagi investor, transparansi dalam AI dapat menandakan komitmen perusahaan terhadap inovasi yang bertanggung jawab, sehingga menjadikannya sebagai proposisi investasi yang lebih menarik.

- Memberdayakan Tim Non-Teknis: AI yang Dapat Dijelaskan memastikan bahwa wawasan dan keputusan yang didorong oleh AI dapat diakses dan ditindaklanjuti oleh tim yang tidak memiliki keahlian teknis yang mendalam, sehingga mendorong kolaborasi lintas departemen.

Ketika perusahaan menavigasi lanskap kompleks di era modern, mengandalkan solusi black-box bisa menjadi sebuah pertaruhan. Memasukkan transparansi ke dalam proses AI bukan sekadar peningkatan teknologi; hal ini merupakan kebutuhan bisnis, memastikan bahwa setiap langkah yang didukung AI sejalan dengan tujuan dan nilai-nilai organisasi yang lebih luas, yang menandakan peran AI yang dapat dijelaskan. Ini juga merupakan kasus penggunaan AI yang dapat dijelaskan dan biasanya menjadi fokus para pengusaha dan pengembang AI.

Cetak Biru untuk Model AI yang Dapat Dijelaskan

Kini, ketika dampak AI dalam kehidupan kita sehari-hari semakin terlihat jelas dari hari ke hari, penting untuk memastikan bahwa mesin yang kita percayai dalam pengambilan keputusan penting akurat dan transparan dalam cara kerjanya.

Mengembangkan model AI yang dapat dijelaskan bukan hanya tentang pengkodean; ini adalah proses yang melibatkan perencanaan strategis, pengujian ketat, dan penyempurnaan berulang berdasarkan prinsip AI yang dapat dijelaskan dan alat AI yang dapat dijelaskan. Berikut adalah panduan langkah demi langkah dan teknik AI yang dapat dijelaskan untuk memastikan bahwa model AI yang kami kembangkan dapat dijelaskan dan diinterpretasikan sekaligus mematuhi hukum.

- Memahami Domain Masalah: Sebelum mendalami pengembangan model, kami memahami dengan jelas domain masalah dan pemangku kepentingan yang terlibat. Apa yang diharapkan pengguna? Keputusan apa yang akan diambil oleh AI, dan dampak apa yang akan dihasilkan dari keputusan tersebut adalah beberapa pertanyaan yang dapat kami temukan jawabannya.

- Memilih Data yang Sesuai: Kualitas dan relevansi data secara langsung memengaruhi kemampuan AI untuk menjadi akurat dan dapat dijelaskan. Dalam pengembangan model AI, kami memastikan bahwa data bersih, beragam, dan bebas dari bias.

- Memilih Model yang Tepat: Meskipun beberapa model, seperti jaringan neural dalam, lebih kompleks dan sulit diinterpretasikan, model lainnya, seperti pohon keputusan atau regresi linier, dapat menawarkan lebih banyak transparansi. Kami memilih keseimbangan antara kompleksitas dan kejelasan sambil mengembangkan model AI yang dapat dijelaskan.

- Pengujian Berulang: Kami menguji model secara rutin dengan kumpulan data yang bervariasi untuk memastikan performa yang konsisten. Umpan balik dari pengujian ini dapat menginformasikan penyempurnaan dan peningkatan.

- Mengintegrasikan Alat Penjelasan: Alat seperti LIME atau SHAP membantu memecah prediksi model, menawarkan wawasan tentang fitur mana yang memengaruhi keputusan tertentu.

- Dokumentasi: Dokumentasi komprehensif membantu kami dalam verifikasi model, validasi, dan penerapan. Hal ini memastikan semua pemangku kepentingan memahami cara kerja dan keterbatasan AI, mulai dari pengembang hingga pengguna akhir.

Menyeimbangkan Performa Model dengan Interpretabilitas

Salah satu tantangan paling signifikan dalam pengembangan perangkat lunak AI yang dapat dijelaskan adalah menyeimbangkan performa model dan kemampuan interpretasi. Meskipun model yang kompleks mungkin memberikan akurasi yang lebih tinggi, model tersebut sering kali mengorbankan transparansi. Sebaliknya, model yang lebih sederhana mungkin lebih mudah dipahami tetapi mungkin tidak secara efektif menangkap perbedaan dalam data. Untuk mencapai keseimbangan yang tepat, kami mempertimbangkan hal berikut:

- Kesederhanaan Model vs. Kompleksitas: Kami menentukan tingkat kompleksitas minimum yang diperlukan untuk mencapai kinerja yang memuaskan. Jika model yang lebih sederhana sudah mencukupi, ini mungkin merupakan pilihan yang lebih baik untuk memastikan kemampuan menjelaskan.

- Penggunaan Teknik Penjelasan: Teknik seperti pemeringkatan kepentingan fitur atau metode model-agnostik dapat membantu membuat model yang kompleks lebih mudah diinterpretasikan.

- Putaran Umpan Balik: Kami mempertahankan putaran umpan balik yang berkelanjutan dengan pengguna akhir untuk memahami apakah keputusan AI sudah jelas dan apakah ada ruang untuk meningkatkan transparansi.

Meskipun perjalanan untuk mencapai AI yang dapat dijelaskan mungkin tampak rumit, hal ini penting. Saat kami semakin mengintegrasikan AI ke dalam sistem dan proses kami, memastikan model berperforma tinggi dan transparan ini akan sangat penting untuk menjaga kepercayaan dan efisiensi.

Bagaimana Appinventiv Dapat Membantu Anda Mengembangkan Model AI yang Dapat Dijelaskan?

Memiliki pengalaman hampir sembilan tahun dalam mengembangkan produk AI, kami di Appinventiv memahami berbagai seluk-beluk terkait pengembangan model AI dan manfaat AI yang dapat dijelaskan. Setelah mengembangkan berbagai platform dan aplikasi berbasis AI, termasuk Mudra (aplikasi keuangan pribadi yang didukung AI), teknisi kami memiliki keahlian domain dan pengawasan untuk bergerak menuju pengembangan AI yang dapat dijelaskan.

Apa pun proyek AI Anda, kami, sebagai perusahaan pengembangan AI terkemuka, dapat membuka kemampuan interpretasi dan penjelasan untuk model AI Anda sehingga Anda dapat mempercayai keputusan yang dibuat oleh model tersebut. Hubungi kami hari ini untuk memulai perjalanan menuju AI yang bertanggung jawab .

Pertanyaan yang sering diajukan

T. Apa yang dimaksud dengan AI yang dapat dijelaskan?

A. AI yang Dapat Dijelaskan adalah perubahan paradigma dalam pengembangan AI yang memerlukan pengembangan model AI sedemikian rupa sehingga keputusan yang dibuat oleh model AI dapat ditelusuri kembali dan pengguna dapat memahami bagaimana model AI mengambil keputusan.

T. Bagaimana cara kerja AI yang dapat dijelaskan?

A. AI yang Dapat Dijelaskan bekerja dengan mengintegrasikan elemen-elemen kunci yang dapat dijelaskan ke dalam model AI selama pengembangan yang dapat membantu menentukan bagaimana model AI mencapai keputusan tertentu.

T. Mengapa AI yang dapat dijelaskan itu penting?

A. AI yang dapat dijelaskan penting karena tidak memahami cara model AI mengambil keputusan dapat menimbulkan konsekuensi yang mengerikan dan dalam kasus terburuk, dapat menimbulkan kerugian nyata bagi perusahaan atau pengguna model AI tersebut.