Cara Menghindari Pelanggaran Kepatuhan Saat Mengembangkan Produk AI

Diterbitkan: 2023-06-12Kecerdasan buatan tetap menjadi tren teknologi teratas selama beberapa tahun melalui kontribusinya dalam sektor data dan intensif mesin seperti manufaktur, perawatan kesehatan, dan keuangan. Namun, hanya dalam dua tahun terakhir teknologi tersebut telah menyaksikan minat yang tinggi dari pengguna akhir. Dengan aplikasi seperti generator gambar dan teks, orang sekarang dapat menghasilkan visual dan teks dalam satu klik.

Meskipun tampaknya platform AI ini menghasilkan materi dari awal, sebenarnya tidak demikian – platform AI ini telah dilatih tentang cuplikan pertanyaan dan danau data yang bekerja dengan memproses arsip teks dan gambar dari internet. Meskipun berguna bagi pengguna akhir, pendekatan ini disertai dengan risiko hukum seperti pelanggaran hak cipta, ketidakpatuhan terhadap lisensi sumber terbuka, dan pelanggaran kekayaan intelektual, dll. Risiko yang ditimbulkan oleh AI generatif ini tidak terlihat oleh pemerintah di seluruh dunia yang terus-menerus datang. dengan aturan dan hukuman baru seputar model AI yang tidak etis.

Untuk perusahaan yang bersiap meluncurkan proyek AI mereka, sangat penting bagi mereka untuk memahami risikonya dan membangun sistem yang tidak berada di bawah radar hukum di belakang masalah etika ini. Pada artikel ini, kita akan menyelami banyak aspek kepatuhan AI selama pengembangan perangkat lunak – jenis masalah hukum, cara mempersiapkan regulasi AI, dan tindakan AI yang diikuti oleh berbagai wilayah.

Apa itu Kepatuhan AI?

Ini adalah proses yang memastikan aplikasi yang diberdayakan oleh AI mematuhi peraturan dan undang-undang di wilayah tempat ia beroperasi. Berikut adalah berbagai faktor yang terdiri dari pemeriksaan kepatuhan AI –

Masalah Hukum dengan Kecerdasan Buatan

Sementara pada tingkat mikro mungkin tampak bahwa masalah penggunaan AI oleh pengguna akhir terbatas pada plagiarisme atau akses ke data yang tidak dapat dibagikan, pada tingkat makro kepatuhan non AI menyebabkan tantangan yang lebih besar.

Ancaman yang berasal dari penggunaan sistem AI yang dibangun dengan buruk dapat memengaruhi persaingan yang sehat, keamanan dunia maya, perlindungan konsumen, dan bahkan hak-hak sipil. Oleh karena itu, sangat penting bagi perusahaan dan pemerintah untuk membangun model yang adil dan etis.

hak cipta

Dengan munculnya AI generatif, bisnis sudah mulai membuat materi hak cipta melalui teknologi. Masalahnya terletak pada ketidakmampuan untuk memahami apakah data telah dihasilkan dengan kreativitas seorang penulis atau apakah AI yang menjadi penulisnya.

Untuk memberikan kepatuhan hukum ini, Kantor Hak Cipta mengeluarkan Panduan tentang pemeriksaan dan pendaftaran karya yang mengandung materi yang dihasilkan AI. Ini menyatakan sebagai berikut -

- Hak cipta hanya dapat melindungi materi yang dihasilkan oleh kreativitas manusia.

- Dalam hal karya dengan materi berbasis AI, akan dipertimbangkan apakah kontribusi AI dihasilkan dari “reproduksi mekanis” atau merupakan “konsepsi orisinal milik pengarang, yang mereka berikan bentuk yang terlihat melalui AI.

- Pelamar berkewajiban untuk mengungkapkan keterlibatan konten berbasis AI dalam materi yang diajukan untuk pendaftaran.

Baca juga: Biaya pengembangan alat pendeteksi konten AI pada 2023

Sumber terbuka

Generator kode berbasis AI sering menggunakan AI untuk membantu pengembang dalam penyelesaian otomatis atau menyarankan kode di belakang pengujian atau masukan pengembang. Berikut adalah beberapa tantangan yang terkait dengan pengembangan model AI yang sesuai seputar pembuat kode –

- Apakah pelatihan model AI dengan kode sumber terbuka berarti pelanggaran?

- Siapa yang bertanggung jawab untuk memenuhi kriteria kepatuhan sumber terbuka – pengembang atau pengguna?

- Akankah kode berbasis AI yang digunakan oleh pengembang yang membuat perangkat lunak baru mengharuskan aplikasi untuk dilisensikan di bawah sumber terbuka?

Pelanggaran IP

Secara global, beberapa tuntutan hukum pelanggaran telah diajukan terhadap alat AI, menuduh mereka melatih model mereka atau menghasilkan output berdasarkan konten pihak ketiga yang dilindungi IP.

Bias Etis

Ada banyak insiden di mana teknologi pengenalan wajah AI telah menyebabkan diskriminasi rasial. Entah itu kasus di tahun 2020, orang kulit hitam ditangkap karena kesalahan komputer atau Google Foto melabeli orang kulit hitam sebagai "Gorila". Terlepas dari seberapa pintar teknologinya, tidak dapat diabaikan bahwa itu dibangun oleh manusia dengan bias

Bagi perusahaan yang ingin membangun solusi serupa, sangat penting bagi mereka untuk tidak membiarkan bias ini masuk ke dalam sistem.

Kepatuhan GDPR untuk Proyek AI

Dengan demikian, sangat penting untuk memahami mengapa bisnis gagal membangun model AI yang sesuai meskipun ada peraturan yang ketat. Ada beberapa alasan di baliknya, mulai dari ketidakmampuan untuk mengetahui kepatuhan, kurangnya pemahaman pengembang, dan terkadang ketidaktahuan sederhana. Namun, ada juga beberapa alasan fungsional di baliknya.

Mari kita lihat beberapa di antaranya dari prospek kepatuhan GDPR untuk proyek AI.

Batasan tujuan

Prinsip GDPR mewajibkan bisnis untuk memberi tahu subjek data tentang tujuan pengumpulan dan pemrosesan informasi mereka. Tantangannya adalah teknologi menggunakan data untuk menemukan pola dan mendapatkan wawasan baru, tetapi itu mungkin bukan tujuan sebenarnya dari data tersebut.

Diskriminasi

GDPR mengharuskan pengembang AI untuk mengambil langkah melawan dampak diskriminatif yang dapat dibawa oleh teknologi. Meskipun ini merupakan kebutuhan etis saat ini, bagi pengembang yang mengoperasikan skenario sosial yang berubah dengan cepat, menyiapkan model AI untuk melawan setiap diskriminasi dan hasil yang tidak bermoral dapat menjadi tantangan.

Minimalisasi data

GDPR mengatakan bahwa informasi yang dikumpulkan harus “memadai, terbatas, dan relevan”. Ini berarti tim pengembangan AI harus sangat berhati-hati saat menggunakan data untuk model mereka dan harus jelas tentang jumlah data yang diperlukan untuk proyek mereka.

Namun, hal ini tidak dapat diprediksi, sehingga tim harus secara teratur mengevaluasi jenis dan jumlah data yang diperlukan untuk memenuhi persyaratan minimalisasi data.

Transparansi

Terakhir, pengguna harus menentukan bagaimana data mereka digunakan oleh pihak ketiga, untuk ini, bisnis harus jelas tentang data apa yang mereka gunakan dan bagaimana caranya.

Masalahnya adalah sebagian besar model AI beroperasi dalam kotak hitam, dan tidak jelas bagaimana mereka membuat keputusan, terutama ketika kita berbicara tentang perangkat lunak tingkat lanjut.

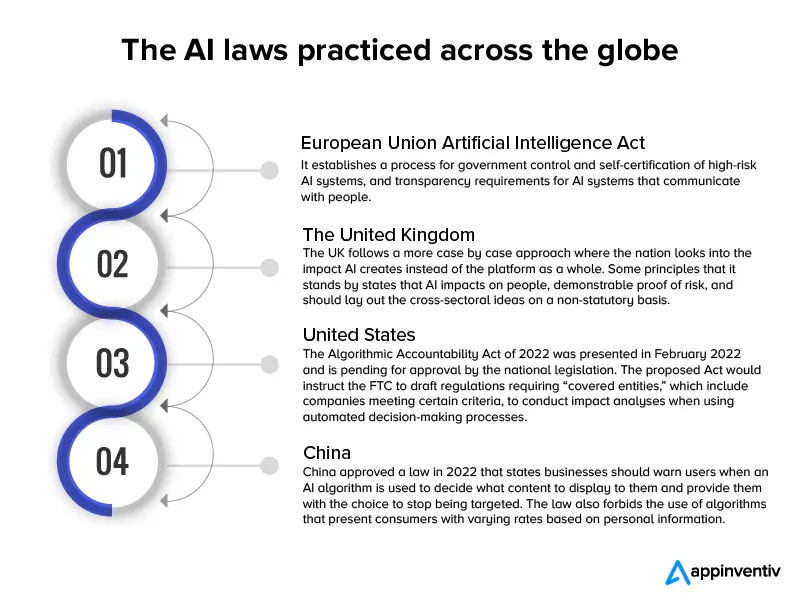

Meskipun ini semua adalah masalah teknis yang sebenarnya, ketika menyangkut etika TI, sangat penting bagi bisnis untuk tidak menggunakannya sebagai tameng untuk mengembangkan model AI yang rusak. Untuk memastikan bahwa praktik tersebut tidak menjadi arus utama, beberapa undang-undang AI telah diberlakukan dalam skala global.

Hampir 60 negara telah memperkenalkan undang-undang dan peraturan kecerdasan buatan sejak 2017, serangkaian tindakan yang sesuai dengan kecepatan penerapan model AI baru.

Berikut adalah infografik yang memberikan gambaran singkat tentang undang-undang tersebut.

Sekarang kita telah melihat tantangan pengembangan AI dari sudut pandang hukum dan draf kasar undang-undang yang berlaku di tingkat global, mari kita turun ke cara Anda dapat membangun aplikasi AI yang sesuai.

Baca juga: Berapa biaya untuk mengembangkan chatbot yang sesuai hukum seperti ChatGPT

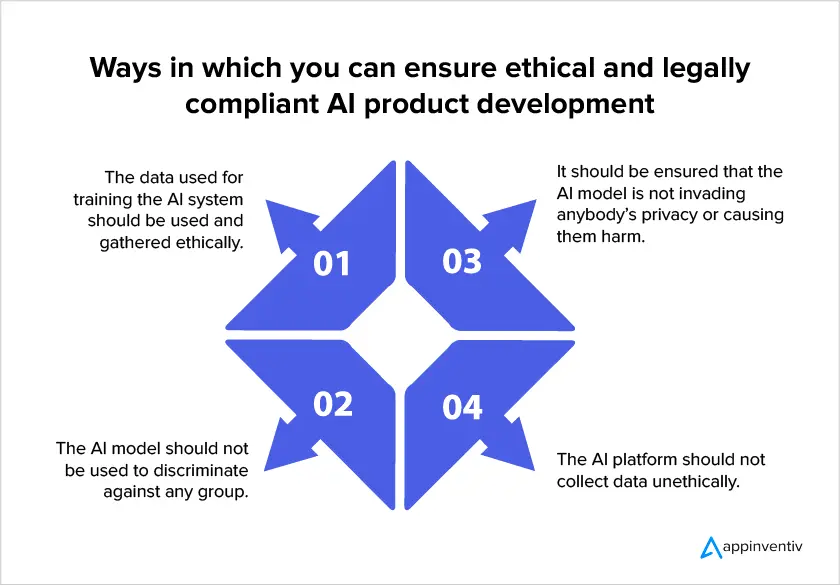

Cara Mengembangkan Model AI yang Ramah Kepatuhan

Karena meningkatnya peraturan AI di tingkat global, menjadi penting bagi bisnis untuk fokus pada kepatuhan hukum saat membuat model AI. Berikut adalah beberapa cara perusahaan dapat memastikan bahwa proyek mereka mematuhi hukum saat berinvestasi dalam layanan pengembangan AI.

- Pastikan Anda diizinkan untuk menggunakan data

Kepatuhan AI menyatakan bahwa privasi pengguna harus menjadi prinsip panduan desain model. Ini berarti bahwa Anda harus meminimalkan jumlah data yang perlu Anda kumpulkan, tentukan alasan yang tepat untuk pengumpulan data, beserta waktu hingga kapan Anda akan menggunakan data mereka. Pada akhirnya, penting untuk dicatat bahwa pengguna harus memberikan persetujuan mereka untuk pengumpulan data.

- Metode AI yang dapat dijelaskan

Pendekatan ini membantu memecahkan efek kotak hitam dengan membantu manusia memahami apa yang ada di dalam sistem AI dan bagaimana model membuat keputusan. Ini, pada gilirannya, membantu para peneliti mengetahui jumlah pasti data yang akan mereka perlukan untuk meningkatkan akurasi model guna memenuhi persyaratan minimalisasi data.

- Melacak data yang dikumpulkan

Kepatuhan AI mengharuskan bisnis untuk mengetahui lokasi dan penggunaan PII yang dikumpulkan. Kategorisasi data yang benar diperlukan untuk memenuhi hak pengguna atas informasi yang dilindungi. Selain itu, bisnis harus memiliki pendekatan untuk mengetahui informasi mana yang disimpan di kumpulan data mana untuk menyiapkan langkah-langkah keamanan yang akurat.

- Memahami aturan transmisi data antar negara

Ketika ada transfer data lintas batas dalam sistem AI, pengembang harus mempertimbangkan peraturan yang akan berlaku di negara penerima dan membangun mekanisme transfer data yang sesuai. Misalnya, jika GDPR berlaku untuk pemrosesan data dan data pribadi ditransfer ke negara non-EEA, penilaian dampak transfer yang tepat harus dilakukan.

Menggunakan pendekatan seperti itu saat mengembangkan aplikasi AI sangat membantu dalam memastikan bahwa risiko yang terkait dengan teknologi ditangani dengan benar. Namun, perusahaan dan regulator harus memperhatikan fakta bahwa tidak mungkin melindungi aplikasi dari setiap potensi risiko karena konteks industri bekerja berdasarkan model kasus per kasus. Oleh karena itu, peran manajer risiko AI akan tetap penting karena mereka dapat mengukur kapan intervensi diperlukan.

Kami harap artikel ini membantu Anda memahami apa yang diharapkan dari struktur hukum seputar teknologi AI di masa mendatang dan cara mempersiapkan diri Anda untuk model AI yang sesuai.

FAQ

T. Apakah ada masalah hukum dengan kecerdasan buatan?

A.Ya. Mungkin ada sejumlah masalah hukum dan etika yang terkait dengan model kecerdasan buatan yang dibangun dengan buruk.

- hak cipta

- Penyalahgunaan lisensi sumber terbuka

- Pelanggaran IP

- Bias etis seperti diskriminasi ras.

T. Mengapa sulit membuat model AI yang mematuhi hukum?

J. Di sisi teknis, mungkin sulit untuk membangun AI yang mematuhi hukum karena meskipun teknologi menggunakan data pelanggan untuk menemukan pola dan mendapatkan wawasan baru, sulit untuk memastikan tujuan sebenarnya dari data tersebut. Selanjutnya, tim pengembangan AI tidak pernah bisa memastikan jumlah data yang diperlukan untuk proyek mereka. Terakhir, sebagian besar model AI beroperasi dalam kotak hitam, dan tidak jelas bagaimana mereka membuat keputusan, terutama jika kita berbicara tentang perangkat lunak tingkat lanjut.

T. Bagaimana cara memastikan kepatuhan hukum di AI?

J. Meskipun undang-undang dan peraturan seputar kepatuhan hukum AI terus berkembang, berikut adalah beberapa hal yang dapat Anda lakukan untuk memastikan bahwa model Anda paling mendekati kepatuhan –

- Pastikan Anda diizinkan untuk menggunakan data

- Metode AI yang dapat dijelaskan

- Melacak data yang dikumpulkan

- Memahami aturan transmisi data antar negara