Come evitare violazioni della conformità durante lo sviluppo di prodotti AI

Pubblicato: 2023-06-12L'intelligenza artificiale è rimasta la principale tendenza tecnologica per diversi anni grazie ai suoi contributi in settori ad alta intensità di dati e macchine come la produzione, la sanità e la finanza. Tuttavia, è solo negli ultimi due anni che la tecnologia ha registrato un forte interesse da parte degli utenti finali. Con applicazioni come generatori di immagini e testo le persone sono ora in grado di produrre immagini e testi con un solo clic.

Anche se sembra che queste piattaforme di intelligenza artificiale stiano producendo materiale da zero, non è proprio così: queste piattaforme di intelligenza artificiale sono state addestrate su frammenti di domande e data lake che funzionano elaborando archivi di testo e immagini da Internet. Sebbene utile per gli utenti finali, l'approccio comporta rischi legali come violazione del copyright, mancato rispetto delle licenze open source e violazione della proprietà intellettuale, ecc. Questi rischi posti dall'IA generativa non sono invisibili ai governi di tutto il mondo che stanno costantemente arrivando con nuove regole e sanzioni relative a modelli di intelligenza artificiale non etici.

Per un'azienda che si prepara a lanciare il proprio progetto di intelligenza artificiale, è fondamentale comprendere i rischi e costruire un sistema che non cada sotto il radar legale alla base di questi problemi etici. In questo articolo, ci addentreremo nelle molte sfaccettature della conformità dell'IA durante lo sviluppo del software: i tipi di problemi legali, i modi per prepararsi alla regolamentazione dell'IA e gli atti di intelligenza artificiale seguiti da diverse regioni.

Che cos'è la conformità AI?

È un processo che garantisce che le applicazioni basate sull'intelligenza artificiale siano conformi alle normative e alle leggi della regione in cui sono operative. Ecco i diversi fattori in cui consiste il controllo della conformità AI:

I problemi legali con l'intelligenza artificiale

Mentre a livello micro può sembrare che i problemi con l'utilizzo dell'IA da parte degli utenti finali siano limitati al plagio o all'accesso a dati non condivisibili, a livello macro la mancata conformità all'IA causa sfide maggiori.

Le minacce derivanti dall'utilizzo di un sistema di intelligenza artificiale mal costruito possono influire sulla concorrenza leale, sulla sicurezza informatica, sulla protezione dei consumatori e persino sui diritti civili. Pertanto, è fondamentale per le aziende e i governi costruire un modello etico e giusto.

Diritto d'autore

Con l'inizio dell'IA generativa, le aziende hanno iniziato a creare materiale protetto da copyright attraverso la tecnologia. Il problema con questo sta nell'incapacità di capire se i dati sono stati generati con la creatività di un autore o se è l'IA ad essere l'autore.

Per dare a questo una presa di conformità legale, il Copyright Office ha emesso una guida sull'esame e la registrazione di opere contenenti materiale generato dall'intelligenza artificiale. Afferma quanto segue -

- Il diritto d'autore può proteggere solo il materiale prodotto dalla creatività umana.

- Nel caso di opere con materiale basato sull'intelligenza artificiale, si valuterà se i contributi dell'IA derivano da una “riproduzione meccanica” o sono “la concezione originale propria dell'autore, alla quale hanno dato forma visibile attraverso l'IA.

- I richiedenti hanno l'obbligo di rivelare il coinvolgimento di contenuti basati sull'intelligenza artificiale nel materiale inviato per la registrazione.

Leggi anche: Costo per lo sviluppo di uno strumento di rilevamento dei contenuti AI nel 2023

Open source

I generatori di codice basati sull'intelligenza artificiale utilizzano spesso l'intelligenza artificiale per assistere gli sviluppatori nel completamento automatico o per suggerire il codice alla fine dei test o degli input degli sviluppatori. Ecco alcune sfide associate allo sviluppo di modelli di intelligenza artificiale conformi ai generatori di codice:

- L'addestramento di modelli di intelligenza artificiale con codice open source significa violazione?

- Chi è responsabile del rispetto dei criteri di conformità open source: sviluppatore o utente?

- L'utilizzo del codice basato sull'intelligenza artificiale da parte degli sviluppatori che creano nuovo software richiederà che l'applicazione sia concessa in licenza open source?

Violazione della proprietà intellettuale

A livello globale, sono state intentate numerose azioni legali per violazione contro gli strumenti di intelligenza artificiale, accusandoli del fatto che stanno addestrando i loro modelli o generando output sulla base di contenuti protetti da proprietà intellettuale di terze parti.

Pregiudizio etico

Ci sono stati numerosi incidenti in cui la tecnologia di riconoscimento facciale AI ha portato alla discriminazione razziale. Che si tratti del caso in cui nel 2020 i neri sono stati arrestati a causa di un errore del computer o di Google Foto che etichettava i neri come "Gorilla". Indipendentemente da quanto sia intelligente la tecnologia, non si può ignorare che è stata costruita da esseri umani con pregiudizi

Per le aziende che cercano di costruire soluzioni simili, è fondamentale che non permettano a questi pregiudizi di entrare nel sistema.

Conformità al GDPR per i progetti di intelligenza artificiale

Detto questo, è fondamentale capire perché le aziende non riescono a costruire modelli di intelligenza artificiale conformi nonostante le rigide normative. Ci possono essere diverse ragioni alla base di ciò, che vanno dall'incapacità di conoscere la conformità, la mancanza di comprensione da parte degli sviluppatori e talvolta la semplice ignoranza. Tuttavia, ci possono essere anche alcune ragioni funzionali dietro.

Esaminiamone alcuni dalla prospettiva della conformità al GDPR per i progetti di intelligenza artificiale.

Limitazione dello scopo

Il principio GDPR impone alle aziende di informare gli interessati sullo scopo per cui le loro informazioni vengono raccolte ed elaborate. La sfida con questo è che la tecnologia utilizza i dati per trovare modelli e ottenere nuove intuizioni, ma questo potrebbe non essere il vero scopo di quei dati.

Discriminazione

Il GDPR richiede agli sviluppatori di intelligenza artificiale di prendere provvedimenti contro l'impatto discriminatorio che la tecnologia può portare. Sebbene sia un'esigenza etica del momento, per uno sviluppatore che opera in uno scenario sociale in rapida evoluzione, preparare il modello di intelligenza artificiale contro ogni discriminazione e output immorale può diventare una sfida.

Minimizzazione dei dati

Il GDPR afferma che le informazioni raccolte dovrebbero essere "adeguate, limitate e pertinenti". Ciò significa che i team di sviluppo dell'IA dovrebbero prestare molta attenzione quando utilizzano i dati per i loro modelli e devono essere chiari sulla quantità di dati necessari per il loro progetto.

Tuttavia, questo non è prevedibile, quindi i team devono valutare regolarmente il tipo e la quantità di dati di cui hanno bisogno per soddisfare il requisito di minimizzazione dei dati.

Trasparenza

Infine, gli utenti dovrebbero avere voce in capitolo su come i loro dati vengono utilizzati da terze parti, per questo le aziende dovranno essere chiare su quali dati stanno utilizzando e come.

Il problema è che la maggior parte dei modelli di intelligenza artificiale opera in scatole nere e non è chiaro come prendano le decisioni, specialmente quando parliamo di software avanzato.

Anche se questi sono tutti veri problemi tecnici, quando si tratta di etica IT, è fondamentale che le aziende non li usino come scudi per sviluppare un modello di IA difettoso. Per garantire che la pratica non diventi mainstream, sono entrate in vigore diverse leggi sull'IA su scala globale.

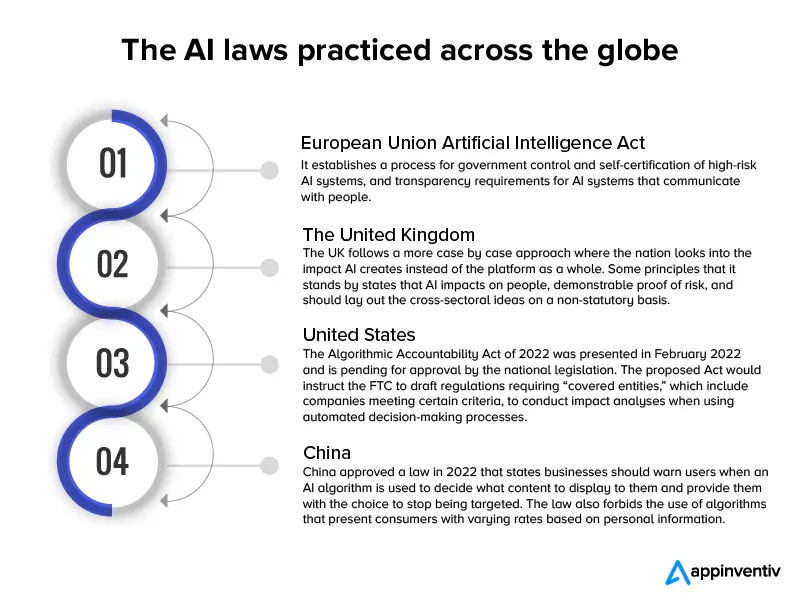

Quasi 60 nazioni hanno introdotto leggi e regolamenti sull'intelligenza artificiale dal 2017, una linea di azione che corrisponde alla velocità con cui vengono implementati i nuovi modelli di intelligenza artificiale.

Ecco un'infografica che offre una breve panoramica di tali leggi.

Ora che abbiamo esaminato le sfide dello sviluppo dell'IA dal punto di vista legale e la bozza delle leggi applicabili a livello globale, passiamo ai modi in cui è possibile creare un'applicazione AI conforme.

Leggi anche: Quanto costa sviluppare un chatbot legalmente conforme come ChatGPT

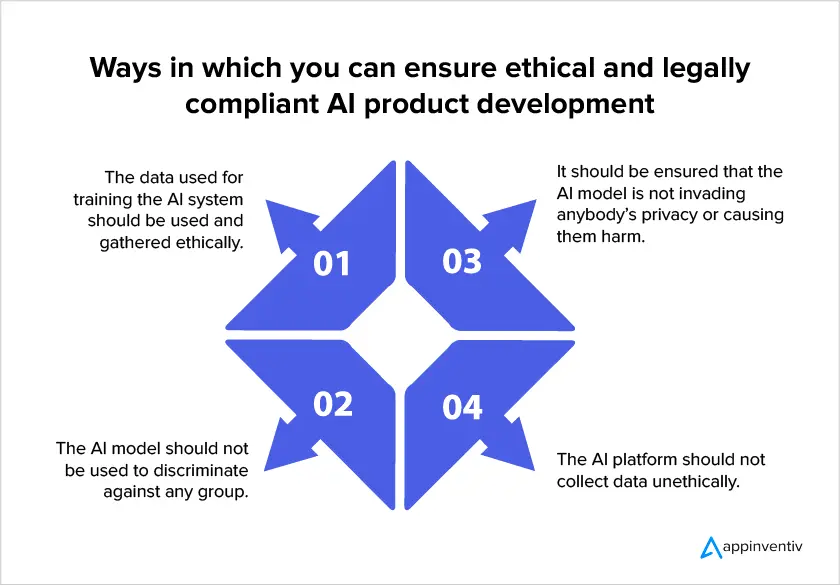

Come sviluppare un modello di intelligenza artificiale compatibile con la conformità

A causa dell'aumento delle normative sull'IA a livello globale, è diventato fondamentale per le aziende concentrarsi sulla conformità legale quando creano modelli di intelligenza artificiale. Ecco alcuni modi in cui le aziende possono garantire che il loro progetto sia legalmente conforme quando investono in servizi di sviluppo AI.

- Assicurati di essere autorizzato a utilizzare i dati

Le conformità AI affermano che la privacy degli utenti dovrebbe essere il principio guida della progettazione del modello. Ciò significa che dovresti mantenere la quantità di dati che devi raccogliere al minimo, specificare il motivo esatto della raccolta dei dati, insieme al tempo fino a quando utilizzerai i loro dati. In definitiva, è importante notare che gli utenti devono dare il proprio consenso alla raccolta dei dati.

- Metodi di intelligenza artificiale spiegabili

Questo approccio aiuta a risolvere l'effetto scatola nera aiutando gli esseri umani a capire cosa c'è all'interno dei sistemi di intelligenza artificiale e come il modello prende le decisioni. Questo, a sua volta, aiuta i ricercatori a conoscere l'esatta quantità di dati di cui avranno bisogno per migliorare l'accuratezza del modello e soddisfare i requisiti di minimizzazione dei dati.

- Tieni traccia dei dati raccolti

Le conformità AI richiedono alle aziende di conoscere la posizione e l'utilizzo delle PII raccolte. La corretta categorizzazione dei dati è necessaria per rispettare il diritto degli utenti a informazioni protette. Inoltre, le aziende devono avere un approccio per sapere quali informazioni sono archiviate in quale set di dati per predisporre misure di sicurezza accurate.

- Comprendere le regole di trasmissione dei dati tra paesi

Quando vi è un trasferimento di dati transfrontaliero in un sistema di intelligenza artificiale, gli sviluppatori dovrebbero considerare le normative che si applicheranno nei paesi riceventi e costruire di conseguenza meccanismi di trasferimento dei dati adeguati. Ad esempio, se il GDPR è applicabile al trattamento dei dati e i dati personali vengono trasferiti in un paese non SEE, dovrebbe essere condotta un'adeguata valutazione dell'impatto del trasferimento.

L'utilizzo di tali approcci durante lo sviluppo di applicazioni di intelligenza artificiale contribuisce notevolmente a garantire che i rischi associati alla tecnologia siano affrontati correttamente. Tuttavia, le aziende e le autorità di regolamentazione dovrebbero essere consapevoli del fatto che è impossibile salvaguardare l'applicazione da ogni potenziale rischio poiché il contesto del settore funziona su un modello caso per caso. Per questo motivo, il ruolo dei gestori del rischio di intelligenza artificiale rimarrà fondamentale in quanto saranno in grado di valutare quando è necessario un intervento.

Ci auguriamo che l'articolo ti abbia aiutato a capire cosa aspettarti dalla struttura legale che circonda la tecnologia IA nei prossimi tempi e i modi per prepararti a un modello IA conforme.

Domande frequenti

D. Ci sono problemi legali con l'intelligenza artificiale?

R. Sì. Possono esserci una serie di problemi legali ed etici associati a un modello di intelligenza artificiale mal costruito.

- Diritto d'autore

- Uso improprio della licenza open source

- Violazione della proprietà intellettuale

- Pregiudizi etici come la discriminazione razziale.

D. Perché è difficile creare un modello di intelligenza artificiale legalmente conforme?

R. Dal punto di vista tecnico, può essere difficile costruire un'intelligenza artificiale conforme alla legge perché mentre la tecnologia utilizza i dati dei clienti per trovare modelli e ottenere nuove informazioni, diventa difficile accertare il vero scopo di tali dati. Successivamente, i team di sviluppo dell'IA non possono mai essere certi della quantità di dati necessari per il loro progetto. Infine, la maggior parte dei modelli di intelligenza artificiale opera in scatole nere e non è chiaro come prendano decisioni, soprattutto quando si parla di software avanzato.

D. Come garantire la conformità legale nell'IA?

R. Sebbene le leggi e le normative sulla conformità legale dell'IA siano in continua evoluzione, ecco alcune cose che puoi fare per assicurarti che il tuo modello sia il più vicino possibile alla conformità:

- Assicurati di essere autorizzato a utilizzare i dati

- Metodi di intelligenza artificiale spiegabili

- Tieni traccia dei dati raccolti

- Comprendere le regole di trasmissione dei dati tra paesi