Jak zrozumiała sztuczna inteligencja może odblokować odpowiedzialny i etyczny rozwój sztucznej inteligencji

Opublikowany: 2023-09-01Dzięki momentom transformacyjnym, które łączą innowację i pomysłowość, takim jak uruchomienie ChatGPT OpenAI w listopadzie 2022 r., wizja sztucznej inteligencji kontrolującej nasze życie nie jest już science fiction.

Przełomowy moment uruchomienia ChatGPT zapoczątkował coś, co branża nazywa „eksplozją kambryjską AI”.

Chodzi jednak o coś więcej niż tylko wykorzystanie sztucznej inteligencji do celów biznesowych, co jest obecnie centralnym punktem tej eksplozji. U podstaw tej ewolucji leży wezwanie do skupienia się na wyjaśnialności sztucznej inteligencji. Dzięki temu postęp w dziedzinie sztucznej inteligencji będzie zarówno skuteczny, jak i przejrzysty, co ma fundamentalne znaczenie dla etycznego rozwoju sztucznej inteligencji.

Sztuczna inteligencja już podejmuje za nas decyzje w wielu dziedzinach. Jednak brak zrozumienia, w jaki sposób sztuczna inteligencja podejmuje te decyzje, pozostaje wąskim gardłem. Jest to jedna z możliwych do wyjaśnienia korzyści związanych ze sztuczną inteligencją, na ignorowanie których przedsiębiorcy i eksperci technologiczni nie mogą sobie pozwolić.

W miarę postępu technologii wyzwanie stojące przed ekspertami technicznymi jest dwojakie: przesuwanie granic tego, co może osiągnąć sztuczna inteligencja, przy jednoczesnym zapewnieniu przejrzystości, odpowiedzialności i etycznego działania jej działania. Podkreśla to rolę wyjaśnialnej sztucznej inteligencji w nowoczesnej technologii.

Potencjał gospodarczy AI

Potencjał generatywnej sztucznej inteligencji w zakresie zrewolucjonizowania produktywności nie jest tylko teoretyczny; będzie to miało wymierne konsekwencje gospodarcze w skali globalnej. Według raportu z czerwca 2023 r. zatytułowanego „The Economic Potencjał generatywnej sztucznej inteligencji: następna granica produktywności” opublikowanego przez McKinsey, generatywna sztuczna inteligencja może wnieść wartość dodaną w wysokości od 2,6 biliona dolarów do 4,4 biliona dolarów rocznie w 63 przeanalizowanych przypadkach użycia. Istnieją również możliwe do wytłumaczenia przypadki użycia sztucznej inteligencji, które mogą przynieść branżom korzyści na wiele nowatorskich sposobów.

Przeczytaj także: Jak generatywna sztuczna inteligencja dla biznesu kształtuje branże

The Washington Post podał, że ponad 11 000 firm skorzystało z narzędzi OpenAI dostarczonych przez dział chmur Microsoftu, podkreślając trendy adopcyjne towarzyszące temu potencjałowi. Liczby te reprezentują możliwości i obowiązki liderów technologicznych poruszających się w tym zmieniającym się krajobrazie.

W miarę jak potencjał transformacyjny sztucznej inteligencji staje się oczywisty, coraz większy nacisk kładzie się na wytłumaczalne zasady sztucznej inteligencji, zapewniające działanie tych potężnych narzędzi z przejrzystością, nadzorem i względami etycznymi. Wyjaśnialne zastosowania sztucznej inteligencji mają stać się kamieniem węgielnym w branży technologicznej.

Jednak zrozumienie możliwych do wyjaśnienia korzyści AI i innych powiązanych aspektów to dopiero początek. Dlatego zanim szczegółowo omówimy niuanse rozwoju Wyjaśnialnej AI, musimy najpierw zrozumieć, dlaczego jest to istotne.

Tajemnica modeli AI: poruszanie się po „czarnej skrzynce”

Podobnie jak w przypadku wszystkich znaczących osiągnięć, sztuczna inteligencja niesie ze sobą wyzwania, niektóre głęboko związane z jej strukturą. Jednym z takich aspektów tej tajemnicy jest „czarna skrzynka”. Reprezentuje zamknięty model operacyjny, który działa, ale nawet programiści czasami nie są w stanie wyjaśnić, jak to działa. Nazywa się to zagadką czarnej skrzynki w branży sztucznej inteligencji.

Ten brak przejrzystości jest dla wielu nie do przyjęcia, zwłaszcza dla osób odpowiedzialnych za kluczowe decyzje biznesowe lub społeczne. Sztuczna inteligencja, która działa bez możliwości wyjaśnienia, stwarza ryzyko podważenia zaufania, zwłaszcza gdy możliwe są straty fizyczne i materialne.

Nieprzewidziane konsekwencje: kiedy sztuczna inteligencja wypada z torów

Konsekwencje niewyjaśnionych decyzji AI mogą sięgać od drobnych nieefektywności po znaczące konsekwencje społeczne. Weźmy pod uwagę sektor finansowy: system sztucznej inteligencji może odmówić danej osobie pożyczki bez podania jasnego uzasadnienia.

Taka decyzja pozbawiona przejrzystości może prowadzić do komplikacji prawnych i utraty reputacji. Na większą skalę, w opiece zdrowotnej, nieprzenikniona sztuczna inteligencja może priorytetowo traktować jednego pacjenta w leczeniu, co może mieć konsekwencje zmieniające lub nawet kończące życie.

Rzeczywiste przykłady nieoczekiwanych wyników i wpadek AI

Kilka incydentów uwydatnia nieprzewidziane konsekwencje sztucznej inteligencji. Tragiczny incydent z 2018 r. z udziałem autonomicznego samochodu Ubera podkreśla tragiczne konsekwencje błędnej interpretacji otoczenia przez sztuczną inteligencję. Znany algorytm opieki zdrowotnej, w którym stwierdzono uprzedzenia rasowe, stanowi wyraźne przypomnienie, że sztuczna inteligencja, niezależnie od tego, jak zaawansowana, może nieumyślnie utrwalić ludzkie uprzedzenia, jeśli nie zostanie odpowiednio zrozumiana i monitorowana.

Lista jest długa, począwszy od Taya Microsoftu, który zamieścił na Twitterze takie rzeczy, jak „Hitler miał rację”, po obywatela amerykańskiego otrzymującego wygórowane rachunki za kartę kredytową. Bez barier ochronnych i możliwości interpretowania decyzji podejmowanych przez sztuczną inteligencję takie przypadki będą się powtarzać, stąd wezwanie do wyjaśnienia.

Uzasadnienie biznesowe: zrozumiałe korzyści AI

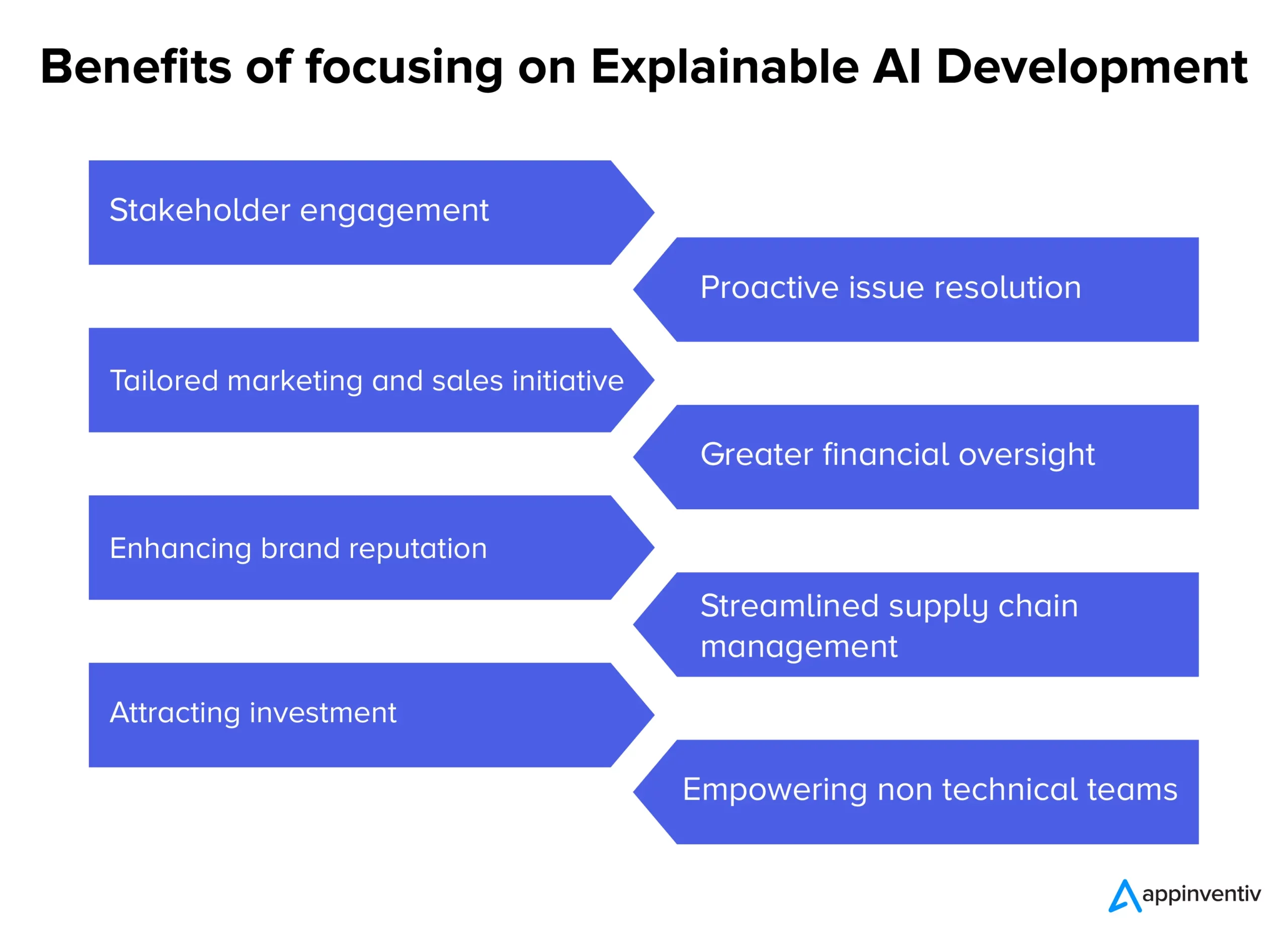

Ponieważ systemy sztucznej inteligencji w coraz większym stopniu napędzają ambicje, ich wrodzona nieprzejrzystość wywołała dyskusje na temat imperatywu przejrzystości. Oprócz dyskursu technicznego istnieje solidne uzasadnienie biznesowe leżące u podstaw przyjęcia zrozumiałej sztucznej inteligencji. Oto różne możliwe do wyjaśnienia korzyści związane ze sztuczną inteligencją dla firm z różnych branż.

- Zaangażowanie i zaufanie interesariuszy: Przejrzyste procesy decyzyjne w zakresie sztucznej inteligencji mogą sprzyjać głębszemu poczuciu zaangażowania i pewności wśród zespołów wewnętrznych i partnerów zewnętrznych.

- Proaktywne rozwiązywanie problemów: zanim problemy nasilą się, możliwa do wyjaśnienia sztuczna inteligencja może wskazać potencjalne obszary budzące wątpliwości, umożliwiając szybkie interwencje i rozwiązania.

- Dostosowane inicjatywy marketingowe i sprzedażowe: firmy mogą tworzyć bardziej spersonalizowane i skuteczne kampanie, rozumiejąc „dlaczego” stojące za spostrzeżeniami konsumentów opartymi na sztucznej inteligencji.

- Lepszy nadzór finansowy: gdy modele finansowe i prognozy oparte na sztucznej inteligencji są przejrzyste, można łatwiej zidentyfikować i wyeliminować potencjalne anomalie lub obszary wzrostu.

- Poprawa reputacji marki: Firmy znane z etycznych i przejrzystych wdrożeń sztucznej inteligencji prawdopodobnie będą cieszyć się lepszą reputacją marki.

- Usprawnione zarządzanie łańcuchem dostaw: dzięki przejrzystym wglądom opartym na sztucznej inteligencji procesy w łańcuchu dostaw można skuteczniej optymalizować, od zarządzania zapasami po logistykę.

- Przyciąganie inwestycji: Dla inwestorów przejrzystość sztucznej inteligencji może oznaczać zaangażowanie firmy w odpowiedzialne innowacje, co czyni ją atrakcyjniejszą propozycją inwestycyjną.

- Wzmacnianie pozycji zespołów nietechnicznych: Wyjaśnialna sztuczna inteligencja gwarantuje, że spostrzeżenia i decyzje oparte na sztucznej inteligencji będą dostępne i wykonalne dla zespołów nieposiadających głębokiej wiedzy technicznej, co sprzyja współpracy między działami.

W miarę jak firmy poruszają się w złożonym krajobrazie epoki nowożytnej, poleganie na rozwiązaniach typu „czarna skrzynka” może być ryzykowne. Zapewnienie przejrzystości procesom AI to nie tylko ulepszenie technologiczne; jest to konieczność biznesowa zapewniająca, że każde działanie wspierane przez sztuczną inteligencję będzie zgodne z szerszymi celami i wartościami organizacyjnymi, co oznacza rolę zrozumiałej sztucznej inteligencji. Są to również możliwe do wytłumaczenia przypadki użycia sztucznej inteligencji, na których zwykle skupiają się przedsiębiorcy i twórcy sztucznej inteligencji.

Projekt wyjaśnialnego modelu sztucznej inteligencji

Teraz, gdy wpływ sztucznej inteligencji na nasze codzienne życie staje się z każdym dniem coraz bardziej widoczny, niezwykle istotne staje się zapewnienie, aby maszyny, którym powierzamy krytyczne decyzje, działały dokładnie i przejrzyście.

Opracowanie wytłumaczalnego modelu sztucznej inteligencji nie polega tylko na kodowaniu; to proces obejmujący planowanie strategiczne, rygorystyczne testowanie i iteracyjne udoskonalanie w oparciu o zrozumiałe zasady sztucznej inteligencji i zrozumiałe narzędzia sztucznej inteligencji. Oto przewodnik krok po kroku i łatwe do wyjaśnienia techniki sztucznej inteligencji, które zapewniają, że opracowywane przez nas modele sztucznej inteligencji są łatwe do wyjaśnienia i interpretacji, a jednocześnie są zgodne z prawem.

- Zrozumienie domeny problemowej: Przed przystąpieniem do opracowywania modelu dokładnie rozumiemy domenę problemu i zaangażowanych interesariuszy. Czego oczekują użytkownicy? Jakie decyzje podejmie sztuczna inteligencja i jaki wpływ będą miały te decyzje, to tylko niektóre z pytań, na które znajdujemy odpowiedzi.

- Wybór odpowiednich danych: Jakość i trafność danych bezpośrednio wpływają na zdolność sztucznej inteligencji do dokładności i wyjaśnienia. Opracowując nasz model sztucznej inteligencji, dbamy o to, aby dane były czyste, różnorodne i wolne od uprzedzeń.

- Wybór odpowiedniego modelu: Podczas gdy niektóre modele, takie jak głębokie sieci neuronowe, są bardziej złożone i trudniejsze do interpretacji, inne, takie jak drzewa decyzyjne lub regresja liniowa, mogą zapewnić większą przejrzystość. Wybierając możliwe do wytłumaczenia modele sztucznej inteligencji, wybieramy równowagę między złożonością a przejrzystością.

- Testowanie iteracyjne: regularnie testujemy model z różnymi zestawami danych, aby zapewnić stałą wydajność. Informacje zwrotne z tych testów mogą pomóc w udoskonaleniach i ulepszeniach.

- Integracja narzędzi wyjaśnialności: Narzędzia takie jak LIME lub SHAP pomagają rozbić przewidywania modelu, oferując wgląd w to, które funkcje wpłynęły na konkretną decyzję.

- Dokumentacja: Obszerna dokumentacja pomaga nam w weryfikacji, walidacji i wdrażaniu modelu. Dzięki temu wszystkie zainteresowane strony, od programistów po użytkowników końcowych, rozumieją działanie i ograniczenia sztucznej inteligencji.

Równoważenie wydajności modelu z możliwością interpretacji

Jednym z najważniejszych wyzwań w tworzeniu wytłumaczalnego oprogramowania AI jest zrównoważenie wydajności modelu i możliwości jego interpretacji. Chociaż złożone modele mogą zapewnić większą dokładność, często dzieje się to kosztem przejrzystości. I odwrotnie, prostsze modele mogą być łatwiejsze do zrozumienia, ale mogą nie skutecznie uchwycić niuanse danych. Aby zachować właściwą równowagę, rozważamy następujące kwestie:

- Prostota a złożoność modelu: Określamy minimalny poziom złożoności wymagany do osiągnięcia zadowalającej wydajności. Jeśli wystarczy prostszy model, może to być lepszy wybór, jeśli chodzi o zapewnienie wyjaśnialności.

- Stosowanie technik wyjaśnialności: Techniki takie jak ranking ważności cech lub metody niezależne od modelu mogą pomóc w ułatwieniu interpretacji złożonych modeli.

- Pętla informacji zwrotnej: utrzymujemy ciągłą komunikację zwrotną z użytkownikami końcowymi, aby dowiedzieć się, czy decyzje AI są jasne i czy można zwiększyć przejrzystość.

Chociaż droga do osiągnięcia zrozumiałej sztucznej inteligencji może wydawać się skomplikowana, jest konieczna. W miarę dalszej integracji sztucznej inteligencji z naszymi systemami i procesami zapewnienie tych wydajnych i przejrzystych modeli będzie miało kluczowe znaczenie dla trwałego zaufania i wydajności.

W jaki sposób Appinventiv może pomóc Ci w opracowywaniu wyjaśnialnych modeli sztucznej inteligencji?

Mając prawie dziewięcioletnie doświadczenie w opracowywaniu produktów AI, w Appinventiv rozumiemy różne zawiłości związane z rozwojem modeli AI i możliwymi do wytłumaczenia korzyściami AI. Po opracowaniu wielu platform i aplikacji opartych na sztucznej inteligencji, w tym Mudra (aplikacja do finansów osobistych opartą na sztucznej inteligencji), nasi inżynierowie posiadają wiedzę branżową i nadzór, aby przejść do wytłumaczalnego rozwoju sztucznej inteligencji.

Niezależnie od tego, jaki jest Twój projekt AI, jako wiodąca firma zajmująca się rozwojem sztucznej inteligencji możemy odblokować możliwość interpretacji i wyjaśnialności Twojego modelu sztucznej inteligencji, dzięki czemu możesz śmiało ufać decyzjom podejmowanym przez modele. Skontaktuj się

już dziś wyruszyć w podróż do odpowiedzialnej sztucznej inteligencji.

Często Zadawane Pytania

P. Czym jest wyjaśnialna sztuczna inteligencja?

A. Wyjaśnialna sztuczna inteligencja to zmiana paradygmatu w rozwoju sztucznej inteligencji, która wymaga opracowywania modeli sztucznej inteligencji w taki sposób, aby można było odtworzyć decyzje podejmowane na jej podstawie, a użytkownicy mogli zrozumieć, w jaki sposób model sztucznej inteligencji podejmuje decyzje.

P. Jak działa wyjaśnialna sztuczna inteligencja?

Odpowiedź. Wyjaśnialna sztuczna inteligencja działa poprzez integrowanie kluczowych elementów wyjaśnialności z modelami sztucznej inteligencji na etapie opracowywania, co może pomóc w określeniu, w jaki sposób model sztucznej inteligencji podjął konkretną decyzję.

P. Dlaczego wyjaśnialna sztuczna inteligencja jest ważna?

Odpowiedź: Wyjaśnialna sztuczna inteligencja jest ważna, ponieważ niezrozumienie, w jaki sposób model sztucznej inteligencji podejmuje za nas decyzje, może prowadzić do tragicznych konsekwencji, a w najgorszych przypadkach może oznaczać wymierną szkodę dla firm lub użytkowników danego modelu sztucznej inteligencji.