Abaixo do código: dissecando os riscos fundamentais da IA e suas contramedidas

Publicados: 2023-09-25As organizações estão mergulhando rapidamente de cabeça no mundo da IA para turbinar seus processos e obter vantagem competitiva. No entanto, é vital compreender que a sua jornada em matéria de IA nem sempre será repleta de raios de sol e arco-íris e poderá ser acompanhada de certos riscos e desafios. À medida que a tecnologia de IA evolui rapidamente a uma velocidade sem precedentes, as organizações devem estar preparadas para se adaptarem globalmente. Para ter sucesso neste ecossistema digital implacável, é crucial compreender as potenciais armadilhas e adotar as melhores práticas para navegar no multiverso da IA.

À medida que a inteligência artificial continua a avançar, há uma preocupação crescente sobre os seus perigos potenciais. Geoffrey Hinton, o “Padrinho da IA”, conhecido pelo trabalho louvável em aprendizagem automática e redes neurais, alertou que os sistemas de IA estão a avançar a um ritmo sem precedentes e podem representar um risco de assumir o controlo, se não forem tratados com a devida supervisão. Ele enfatizou ainda a necessidade vital de abordar estas questões relacionadas de forma proativa.

Noutro caso, Elon Musk também torceu por uma pausa nas experiências de IA em grande escala. Estas preocupações dos líderes mundiais sobre os potenciais riscos da IA reflectem que a comunidade tecnológica precisa de considerar cuidadosamente as implicações e os desafios éticos que podem surgir com o avanço das capacidades da IA.

Agora, à medida que o mundo avança, a IA generativa tende a tornar-se amplamente popular. Uma vez que grandes potências muitas vezes atraem responsabilidades incondicionais, a implementação da IA generativa também acarreta um certo grau de risco ético.

Portanto, como proprietário de uma empresa, é hora de compreender que a IA pode trazer grandes benefícios, mas também traz alguns desafios familiares que surgem ao introduzir qualquer nova tecnologia nas suas operações diárias.

As organizações devem priorizar o uso responsável, garantindo precisão, segurança, honestidade, capacitação e sustentabilidade. Quando confrontados com determinados desafios e riscos, podem confiar nas melhores práticas testadas e comprovadas que se revelaram eficazes na adoção bem-sucedida de outras tecnologias. Essas estratégias podem atuar como uma base sólida para integrar a IA em suas operações comerciais e mitigar os riscos de IA ao longo do caminho.

Este blog irá ajudá-lo a entender tudo relacionado aos riscos da IA para o seu negócio e como mitigá-los. Então, sem mais delongas, vamos direto aos detalhes.

Compreendendo os riscos da IA

De acordo com o AI RMF 1.0, o Quadro de Gestão de Riscos de Inteligência Artificial, divulgado pelo Instituto Nacional de Padrões e Tecnologia (NIST), os riscos de IA abrangem danos potenciais a indivíduos, organizações ou sistemas decorrentes do desenvolvimento e implantação de sistemas de IA. Estes riscos podem resultar de vários fatores, incluindo os dados utilizados para treinar a IA, o algoritmo de IA, a sua utilização para múltiplos fins e as interações com as pessoas. Exemplos de riscos e controles de IA variam de ferramentas de contratação tendenciosas a algoritmos que causam quebras de mercado.

O monitoramento proativo de produtos e serviços baseados em IA é crucial para garantir a segurança dos dados e dos indivíduos. Assim, a organização acredita na utilização de uma solução de gestão de riscos que possa ajudar a fazer a triagem, verificar e mitigar esses riscos de forma eficaz.

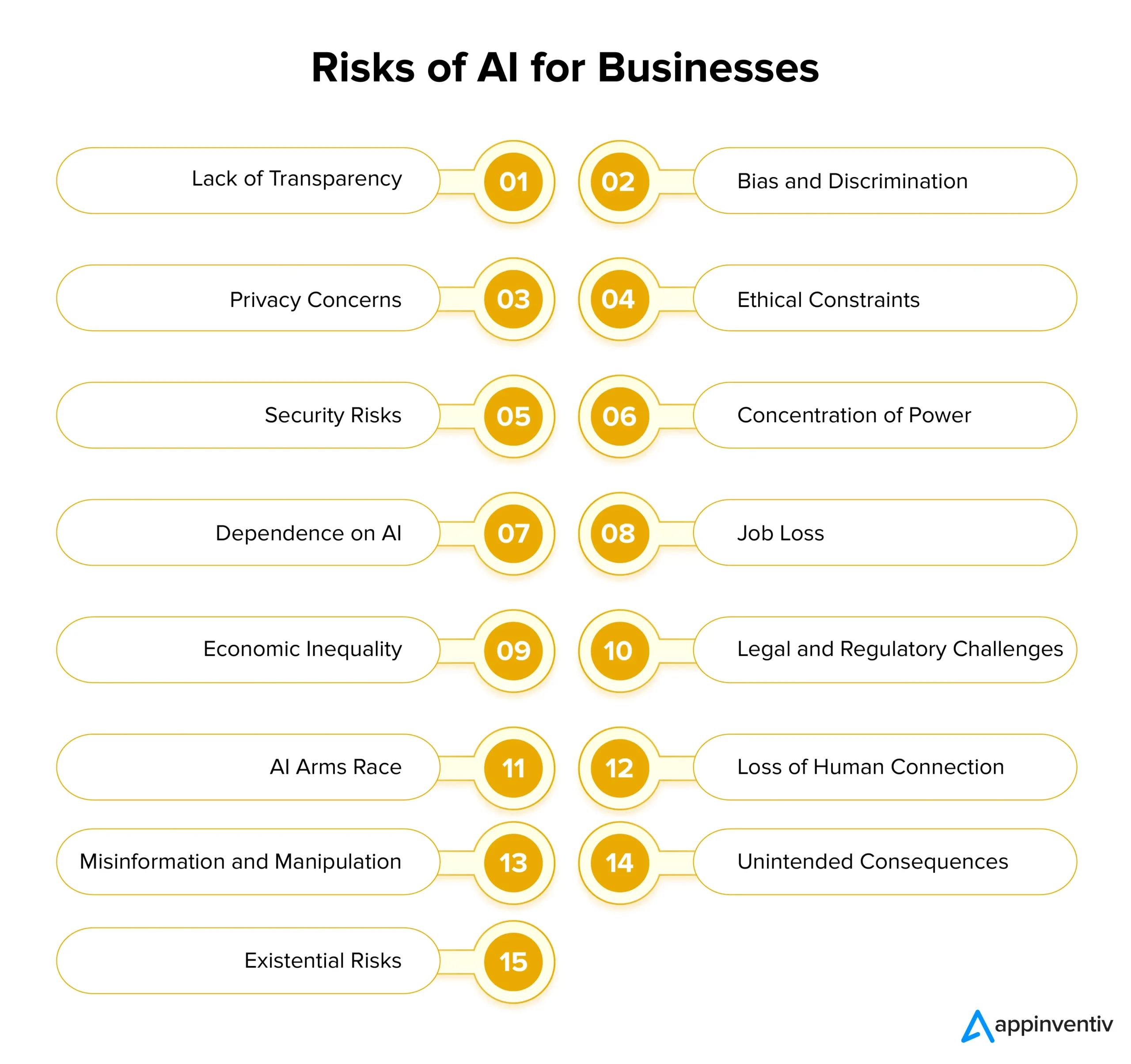

Identificando os riscos e desafios da IA para as empresas

A IA oferece um imenso potencial para as empresas, mas também traz riscos significativos com a sua implementação. Para garantir a adoção responsável da IA, é vital compreender e enfrentar estes desafios no momento certo. Vejamos os riscos e soluções de IA para empresas em detalhes abaixo:

Falta de Transparência

Os sistemas de IA muitas vezes funcionam de forma não transparente, tornando difícil compreender como tomam diversas decisões. Esta falta de transparência pode gerar desconfiança entre os utilizadores e as partes interessadas. Para resolver esta questão, as empresas devem dar prioridade à transparência, concebendo modelos e algoritmos de IA que forneçam informações sobre os seus processos de tomada de decisão.

Isso pode ser facilitado de forma simples usando documentação clara, técnicas de IA explicáveis e ferramentas para visualizar resultados orientados por IA. É importante compreender que a IA transparente aumenta a confiança geral entre as partes e as suas decisões e ajuda na conformidade regulamentar.

Preconceito e discriminação

Os sistemas de IA têm o potencial de manter facilmente os preconceitos sociais encontrados nos seus dados de treino. Isto pode levar a tomadas de decisão tendenciosas, discriminação e tratamento injusto de certos grupos. Para enfrentar estes riscos da IA, as organizações devem priorizar o investimento em dados de formação diversos e representativos que possam analisar.

Além disso, a implementação de algoritmos de detecção e correção de preconceitos e a realização de auditorias regulares aos modelos de IA podem ajudar a identificar e remover os preconceitos dos sistemas existentes. O desenvolvimento ético da IA deve priorizar a justiça e a imparcialidade como princípios fundamentais.

Preocupações com a privacidade

Um dos maiores riscos e desafios da IA é a ameaça à privacidade. A IA exige frequentemente a recolha e análise de grandes quantidades de dados pessoais, levantando preocupações de privacidade e segurança. As empresas devem priorizar a proteção de dados, aderindo a regulamentações rígidas de privacidade, implementando medidas robustas de segurança cibernética e adotando técnicas de criptografia de dados. Isso pode ajudar a proteger a privacidade do usuário e manter a confiança.

Restrições Éticas

Os sistemas de IA envolvidos na tomada de decisões críticas enfrentam frequentemente dilemas éticos que podem ter impactos sociais ainda mais prejudiciais. As organizações devem estabelecer diretrizes e princípios éticos para o desenvolvimento e implantação de IA para enfrentar este risco. As considerações éticas devem ser um dos componentes principais dos projetos de IA, garantindo que a IA esteja alinhada com os valores sociais e as normas éticas.

Riscos de segurança

À medida que as tecnologias de IA avançam, também aumentam os riscos de segurança. As atividades maliciosas podem explorar sistemas de IA e criar ataques cibernéticos mais perigosos, representando uma ameaça significativa para as empresas. As organizações devem implementar medidas de segurança robustas para mitigar os riscos de segurança, incluindo criptografia, protocolos de autenticação e sistemas de detecção de ameaças baseados em IA. A monitorização contínua e as verificações regulares de vulnerabilidades são essenciais para salvaguardar a implantação de sistemas de IA.

Concentração de Poder

Quando apenas algumas grandes empresas e governos controlam o desenvolvimento da IA, isso pode tornar as coisas injustas e reduzir a variedade de utilizações da IA. Para evitar isto, as empresas devem trabalhar para partilhar o desenvolvimento da IA de forma mais ampla entre vários grupos. Eles podem fazer isso apoiando pequenas startups, incentivando novas ideias e ajudando projetos de IA de código aberto. Dessa forma, a IA se torna mais acessível a todos.

Dependência de IA

A dependência excessiva de sistemas de IA pode levar à perda de criatividade, pensamento crítico e intuição humana. É vital encontrar um equilíbrio entre a tomada de decisões assistida por IA e o julgamento humano. Por exemplo, os investigadores destacaram a questão do “colapso do modelo”, onde os modelos generativos de IA que são treinados em dados sintéticos podem produzir resultados de qualidade inferior porque simplesmente priorizam escolhas de palavras comuns em detrimento de alternativas criativas.

As empresas devem formar os seus funcionários para trabalharem em conjunto com a IA, a fim de evitar os riscos potenciais da IA. Incentivar a aprendizagem contínua pode ajudar as organizações a aproveitar o potencial da IA e, ao mesmo tempo, preservar as competências humanas. Além disso, o uso de diversos dados de treinamento e técnicas de regularização também pode ajudar a mitigar esses desafios associados ao colapso do modelo.

Perda de emprego

A automação impulsionada pela IA tem o potencial de substituir empregos em vários setores, sendo os trabalhadores menos qualificados os principais alvos. As organizações devem enfrentar este desafio de forma proativa, proporcionando oportunidades para que a sua força de trabalho aprenda novas medidas e cresça com os avanços tecnológicos. A promoção da aprendizagem ao longo da vida e da adaptabilidade é essencial para mitigar as preocupações relativas à perda de empregos em vários setores.

Desigualdade econômica

A desigualdade económica é outro dos riscos e desafios notáveis da IA dos quais as empresas precisam de estar conscientes. A IA pode potencialmente agravar a desigualdade económica porque muitas vezes beneficia pessoas ricas e grandes empresas. Para tornar a IA mais justa, os decisores políticos e as empresas devem pensar em formas de incluir mais pessoas no desenvolvimento da IA. Eles podem fazer isso criando programas que permitem que mais pessoas usem ferramentas de IA.

Desafios Legais e Regulatórios

A IA introduz novas complexidades jurídicas e regulamentares, incluindo questões de responsabilidade e direitos de propriedade intelectual. Os quadros jurídicos precisam de evoluir para que possam funcionar paralelamente aos avanços tecnológicos. As organizações devem manter-se informadas sobre os regulamentos relacionados com a IA e envolver-se ativamente com os decisores políticos para moldar a governação e práticas responsáveis da IA. As empresas podem usar IA para soluções de risco e conformidade para analisar facilmente grandes quantidades de informações e dados, ao mesmo tempo que identificam potenciais riscos associados à conformidade.

[Leia também: Como evitar violações de conformidade durante o desenvolvimento de produtos de IA]

Corrida armamentista de IA

Quando os países se precipitam numa corrida armamentista de IA, isso pode significar que a tecnologia de IA se desenvolve demasiado rapidamente, e isso pode ser perigoso. Para evitar estes riscos da IA, é importante incentivar o desenvolvimento responsável da IA. Os países devem trabalhar em conjunto e chegar a acordos sobre como a IA pode ser utilizada na defesa. Desta forma, podemos reduzir o risco de a IA causar danos na corrida para ter uma tecnologia mais avançada do que em outros países.

Perda de conexão humana

A crescente dependência da comunicação e das interações baseadas na IA pode levar à diminuição da empatia, das habilidades sociais e das conexões humanas. As organizações devem priorizar o design centrado no ser humano, enfatizando a importância de manter interações humanas significativas, além da integração da IA.

Desinformação e Manipulação

Conteúdo gerado por IA, como deepfakes, representa um risco significativo ao contribuir para a disseminação de informações falsas e para a manipulação da opinião pública. A implementação de ferramentas baseadas em IA para detetar desinformação e campanhas de sensibilização pública pode ajudar a preservar a integridade da informação nesta era digital em rápida evolução.

Consequências não-intencionais

Devido à sua complexidade, os sistemas de IA podem apresentar comportamentos inesperados ou tomar decisões com consequências imprevistas. Testes rigorosos, validação e processos de monitoramento contínuo são essenciais para identificar e resolver esses problemas antes que eles aumentem e causem danos.

Riscos Existenciais

Criar uma inteligência artificial geral (AGI) mais inteligente que os humanos levanta grandes preocupações. As organizações devem garantir que a AGI partilha os seus valores e objetivos para evitar consequências terríveis. Isto requer um planeamento cuidadoso a longo prazo, regras éticas sólidas e trabalho conjunto a nível global para lidar com os grandes riscos que acompanham a AGI.

Depois de analisar os múltiplos desafios e riscos impostos pela tecnologia de IA e como pode ser realizada a gestão de certos riscos de IA, vamos seguir em frente e analisar detalhadamente a governação da IA.

Governança de IA para gerenciamento de riscos

A governação eficaz da IA envolve a identificação e gestão dos riscos da IA através de três abordagens principais:

Princípios: Envolvem diretrizes que facilitam o desenvolvimento de sistemas de IA e sua utilização. Muitas vezes, estes estão alinhados com padrões legislativos e normas sociais.

Processos: Abordar riscos e danos potenciais que surgem de falhas de concepção e estruturas de governação inadequadas.

Consciência Ética: Esta abordagem é impulsionada por um senso do que é certo e bom. Inclui seguir regras, garantir que as coisas sejam feitas corretamente, pensar na reputação de alguém, ser socialmente responsável e corresponder aos valores e crenças da organização.

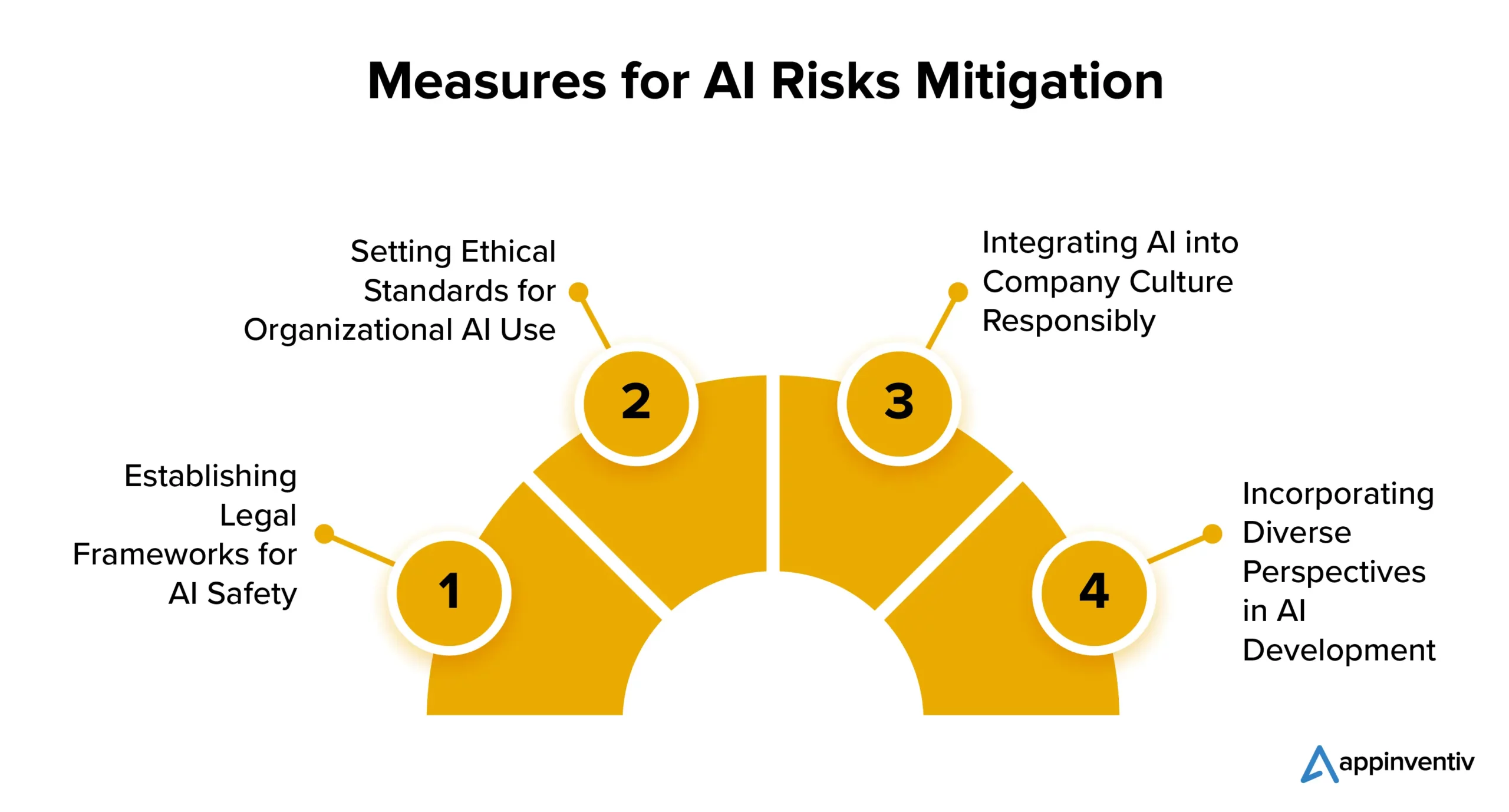

Mitigando riscos de IA: como se manter seguro com inteligência artificial

Aqui estão várias estratégias que as empresas podem realizar para mitigar os riscos da implementação de IA:

Estabelecendo marcos legais para segurança de IA

Muitos países estão se concentrando nas regulamentações de IA. Os EUA e a União Europeia estão a trabalhar num conjunto claro de regras para controlar a propagação e utilização da IA. Embora algumas tecnologias de IA possam enfrentar restrições, isso não deve impedir as empresas de explorar o potencial da IA em seu benefício.

Definindo padrões éticos para uso de IA organizacional

É crucial equilibrar regulamentação com inovação. A IA é vital para o progresso, por isso as organizações devem estabelecer padrões para o desenvolvimento e uso ético da IA. Isto deve incluir a implementação de algoritmos de monitorização, utilizando dados de alta qualidade e sendo transparente sobre as decisões de IA.

Integrando IA na cultura da empresa de forma responsável

Uma das estratégias procuradas para a mitigação dos riscos da IA inclui a introdução da IA na própria cultura da empresa. As empresas podem integrar a IA na sua cultura estabelecendo tecnologias aceitáveis e diretrizes de processos de IA. Isto garante que a IA seja utilizada de forma ética e responsável dentro da organização, mitigando assim os prováveis riscos da IA.

Incorporando diversas perspectivas no desenvolvimento de IA

Os desenvolvedores de IA devem considerar diversas perspectivas, incluindo aquelas de diferentes origens e áreas como direito, filosofia e sociologia. Esta abordagem inclusiva ajuda a criar uma IA responsável que beneficia a todos.

Como a Appinventiv pode ajudar a garantir as melhores práticas para o desenvolvimento de IA

Mesmo que a adoção da IA continue a aumentar, a gestão eficaz dos riscos ainda está atrasada. O desafio reside no facto de as empresas muitas vezes não reconhecerem a necessidade de intervenção, bem como de práticas de desenvolvimento sustentável de IA.

De acordo com um relatório do MIT Sloan Management Review e do Boston Consulting Group, 42% dos entrevistados consideraram a IA como uma prioridade estratégica, enquanto apenas 19% confirmaram que as suas organizações implementaram um programa de IA responsável. Esta lacuna aumenta o risco de fracasso e deixa as empresas vulneráveis a questões regulamentares, financeiras e de reputação causadas pela implementação da IA.

Embora a gestão de riscos de IA possa começar em qualquer fase do projeto, é vital estabelecer uma estrutura de gestão de riscos o mais cedo possível. Isto pode aumentar a confiança e permitir que as empresas cresçam com confiança.

Como uma empresa dedicada ao desenvolvimento de IA, a nossa equipa tem anos de experiência na criação de soluções de IA apoiadas por uma forte ênfase na ética e na responsabilidade. Nosso histórico comprovado em vários domínios da indústria retrata nosso compromisso em alinhar soluções de IA com os valores fundamentais e princípios éticos.

Estamos bem equipados para ajudá-lo na implementação de medidas de justiça para garantir que suas soluções de negócios baseadas em IA tomem decisões imparciais e imparciais de forma consistente.

Recentemente desenvolvemos o YouComm, um aplicativo de saúde baseado em IA que permite que os pacientes se conectem com a equipe do hospital apenas com gestos manuais e comandos de voz. A solução agora está implementada em mais de 5 redes hospitalares nos EUA.

Entre em contato com nossos especialistas para entender completamente o gerenciamento de riscos de IA associados ao seu projeto e como você pode mitigá-los facilmente.

Perguntas frequentes

P. Quais são os riscos da IA?

R. A IA acarreta riscos inerentes, incluindo preconceitos, preocupações com a privacidade, dilemas éticos e ameaças à segurança. Pode também levar à deslocação de empregos, agravar a desigualdade económica e colocar desafios legais e regulamentares. Além disso, o avanço da IA superinteligente levanta preocupações existenciais sobre o alinhamento com os valores humanos. Para garantir uma utilização responsável e benéfica da tecnologia e para evitar os riscos associados à IA, é crucial implementar uma gestão cuidadosa, considerações éticas e medidas regulamentares.

P. Como a IA pode ser usada para mitigar os riscos de IA?

R. A IA desempenha um papel significativo na mitigação dos riscos de IA, facilitando a detecção e correção de preconceitos, análise preditiva, monitoramento de segurança, suporte a decisões éticas, etc. Vejamos em detalhes como podemos ajudar a mitigar os riscos de IA:

- Os algoritmos de IA podem identificar e corrigir distorções nos dados, reduzindo resultados tendenciosos de IA.

- A análise preditiva pode antecipar riscos e permitir medidas preventivas.

- As ferramentas de segurança cibernética baseadas em IA podem detectar e combater ameaças baseadas em IA.

- A IA pode orientar na tomada de escolhas éticas.

- A automação pode garantir a conformidade com as regulamentações, reduzindo os riscos relacionados à conformidade.