Como evitar violações de conformidade ao desenvolver produtos de IA

Publicados: 2023-06-12A inteligência artificial permaneceu como a principal tendência tecnológica por vários anos por meio de suas contribuições em setores intensivos de dados e máquinas, como manufatura, saúde e finanças. No entanto, é apenas nos últimos dois anos que a tecnologia tem testemunhado um grande interesse dos usuários finais. Com aplicativos como geradores de imagem e texto, as pessoas agora podem produzir imagens e textos com um único clique.

Embora pareça que essas plataformas de IA estão produzindo material do zero, esse não é o caso – essas plataformas de IA foram treinadas em trechos de perguntas e data lakes que funcionam processando arquivos de texto e imagens da Internet. Embora útil para os usuários finais, a abordagem vem com riscos legais, como violação de direitos autorais, não adesão a licenças de código aberto e violação de propriedade intelectual, etc. com novas regras e penalidades em torno de modelos antiéticos de IA.

Para uma empresa que se prepara para lançar seu projeto de IA, é fundamental que ela entenda os riscos e construa um sistema que não caia no radar legal por trás dessas questões éticas. Neste artigo, vamos nos aprofundar nas muitas facetas da conformidade com a IA durante o desenvolvimento de software – os tipos de questões legais, formas de se preparar para a regulamentação da IA e os atos de IA seguidos por diferentes regiões.

O que é conformidade com IA?

É um processo que garante que os aplicativos baseados em IA estejam em conformidade com os regulamentos e leis da região em que operam. Aqui estão os diferentes fatores em que a verificação de conformidade com IA consiste:

As questões legais com a inteligência artificial

Embora em um nível micro possa parecer que os problemas com o uso de IA pelos usuários finais estão limitados ao plágio ou acesso a dados não compartilháveis, em um nível macro, a não conformidade com a IA causa desafios maiores.

As ameaças decorrentes do uso de um sistema de IA mal construído podem afetar a concorrência justa, a segurança cibernética, a proteção do consumidor e até mesmo os direitos civis. Portanto, é fundamental que empresas e governos construam um modelo justo e ético.

direito autoral

Com o início da IA generativa, as empresas começaram a criar material protegido por direitos autorais por meio da tecnologia. O problema disso está na incapacidade de entender se os dados foram gerados com a criatividade de um autor ou se é a IA quem é o autor.

Para dar a isso uma conformidade legal, o Copyright Office emitiu orientações sobre o exame e registro de obras que contêm material gerado por IA. Ele afirma o seguinte -

- Os direitos autorais só podem proteger o material produzido pela criatividade humana.

- No caso de trabalhos com material baseado em IA, será considerado se as contribuições de IA resultaram de “reprodução mecânica” ou são “concepção original do próprio autor, à qual deram forma visível por meio de IA.

- Os candidatos têm o dever de divulgar o envolvimento de conteúdo baseado em IA no material submetido para registro.

Leia também: Custo de desenvolvimento de uma ferramenta de detecção de conteúdo de IA em 2023

Código aberto

Os geradores de código orientados por IA geralmente usam IA para ajudar os desenvolvedores no preenchimento automático ou na sugestão de código por trás dos testes ou entradas do desenvolvedor. Aqui estão alguns desafios associados ao desenvolvimento de modelos de IA compatíveis em torno de geradores de código –

- O treinamento de modelos de IA com código aberto significa infração?

- Quem é responsável por atender aos critérios de conformidade de código aberto – desenvolvedor ou usuário?

- O uso de código baseado em IA por desenvolvedores que criam novos softwares exigirá que o aplicativo seja licenciado sob código aberto?

violação de IP

Globalmente, vários processos de violação foram movidos contra ferramentas de IA, acusando-as de treinar seus modelos ou gerar resultados com base em conteúdo protegido por IP de terceiros.

Preconceito ético

Houve inúmeros incidentes em que a tecnologia de reconhecimento facial de IA levou à discriminação racial. Seja o caso em 2020, os negros foram presos por causa de um erro de computador ou o Google Fotos rotulando os negros como “gorila”. Independentemente de quão inteligente seja a tecnologia, não se pode ignorar que ela é construída por humanos com vieses

Para empresas que procuram construir soluções semelhantes, é crucial que não deixem que esses vieses entrem no sistema.

Conformidade com GDPR para projetos de IA

Com isso dito, é crucial entender por que as empresas não conseguem criar modelos de IA compatíveis, apesar dos regulamentos rígidos. Pode haver vários motivos por trás disso, desde a incapacidade de conhecer a conformidade, a falta de compreensão dos desenvolvedores e, às vezes, a simples ignorância. No entanto, pode haver algumas razões funcionais por trás disso também.

Vamos examinar alguns deles do ponto de vista da conformidade com o GDPR para projetos de IA.

Limitação de propósito

O princípio GDPR torna necessário que as empresas informem aos titulares dos dados a finalidade para a qual suas informações são coletadas e processadas. O desafio disso é que a tecnologia usa dados para encontrar padrões e obter novos insights, mas esse pode não ser o objetivo real desses dados.

Discriminação

O GDPR exige que os desenvolvedores de IA tomem medidas contra o impacto discriminatório que a tecnologia pode acarretar. Embora seja uma necessidade ética do momento, para um desenvolvedor que opera em um cenário social em rápida mudança, preparar o modelo de IA contra toda discriminação e saída imoral pode se tornar um desafio.

Minimização de dados

O GDPR diz que as informações coletadas devem ser “adequadas, limitadas e relevantes”. Isso significa que as equipes de desenvolvimento de IA devem ter muito cuidado ao usar dados para seus modelos e devem ter clareza sobre a quantidade de dados necessária para seu projeto.

No entanto, isso não é previsível, portanto, as equipes devem avaliar regularmente o tipo de dados e a quantidade necessária para atender ao requisito de minimização de dados.

Transparência

Por fim, os usuários devem opinar sobre como seus dados estão sendo usados por terceiros, para isso, as empresas precisarão ser claras sobre quais dados estão usando e como.

O problema disso é que a maioria dos modelos de IA opera em caixas pretas e não está claro como eles tomam decisões, especialmente quando falamos de software avançado.

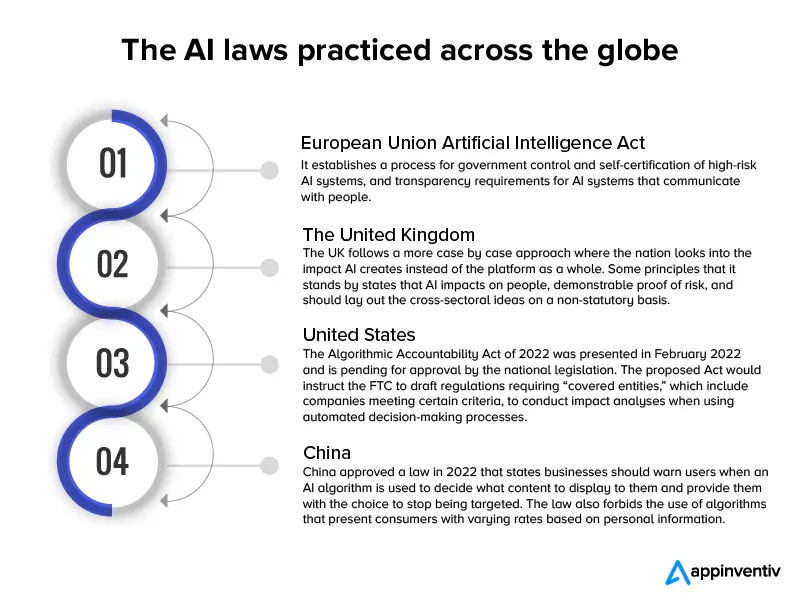

Embora todos esses sejam problemas técnicos genuínos, quando se trata de ética de TI, é fundamental que as empresas não os usem como escudos para desenvolver um modelo de IA defeituoso. Para garantir que a prática não se torne popular, várias leis de IA foram implementadas em escala global.

Quase 60 nações introduziram leis e regulamentos de inteligência artificial desde 2017, uma linha de ação que acompanha a velocidade com que novos modelos de IA são implementados.

Aqui está um infográfico dando uma breve visão dessas leis.

Agora que analisamos os desafios do desenvolvimento de IA do ponto de vista legal e o rascunho das leis aplicáveis em nível global, vamos ver como você pode criar um aplicativo de IA compatível.

Leia também: Quanto custa desenvolver um chatbot legalmente compatível como o ChatGPT

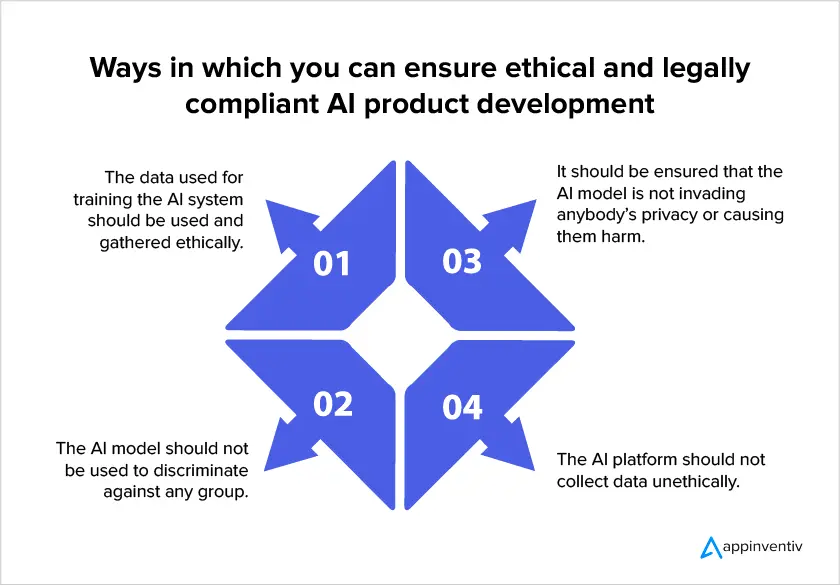

Como desenvolver um modelo de IA compatível com a conformidade

Devido ao aumento das regulamentações de IA em nível global, tornou-se crítico para as empresas focar na conformidade legal ao construir modelos de IA. Aqui estão algumas maneiras pelas quais as empresas podem garantir que seu projeto seja legalmente compatível ao investir em serviços de desenvolvimento de IA.

- Certifique-se de que você tem permissão para usar dados

As conformidades de IA afirmam que a privacidade dos usuários deve ser o princípio orientador do design do modelo. Isso significa que você deve manter a quantidade de dados que precisa coletar no mínimo, especificar o motivo exato da coleta de dados, juntamente com o tempo até quando você estará usando seus dados. Por fim, é importante observar que os usuários devem dar seu consentimento para a coleta de dados.

- Métodos de IA explicáveis

Essa abordagem ajuda a resolver o efeito caixa preta ajudando os humanos a entender o que está dentro dos sistemas de IA e como o modelo toma decisões. Isso, por sua vez, ajuda os pesquisadores a saber a quantidade exata de dados de que precisarão para melhorar a precisão do modelo para atender aos requisitos de minimização de dados.

- Acompanhe os dados coletados

As conformidades de IA exigem que as empresas conheçam a localização e o uso das PII coletadas. A categorização correta dos dados é necessária para cumprir o direito dos usuários à informação protegida. Além disso, as empresas devem ter uma abordagem para saber quais informações são armazenadas em qual conjunto de dados para preparar medidas de segurança precisas.

- Entenda as regras de transmissão de dados entre países

Quando houver transferência de dados transfronteiriça em um sistema de IA, os desenvolvedores devem considerar os regulamentos que serão aplicados nos países receptores e criar mecanismos de transferência de dados apropriados de acordo. Por exemplo, se o GDPR for aplicável ao processamento de dados e os dados pessoais forem transferidos para um país fora do EEE, uma avaliação adequada do impacto da transferência deve ser realizada.

Usar essas abordagens ao desenvolver aplicativos de IA ajuda muito a garantir que os riscos associados à tecnologia sejam tratados adequadamente. No entanto, as empresas e os reguladores devem estar cientes do fato de que é impossível proteger o aplicativo de todos os riscos potenciais, pois o contexto da indústria funciona de acordo com um modelo caso a caso. Por causa disso, o papel dos gerentes de risco de IA permanecerá crítico, pois eles serão capazes de avaliar quando uma intervenção é necessária.

Esperamos que o artigo tenha ajudado você a entender o que esperar da estrutura legal em torno da tecnologia de IA no futuro e as maneiras de se preparar para um modelo de IA compatível.

perguntas frequentes

P. Há algum problema legal com a inteligência artificial?

R. Sim. Pode haver uma série de questões legais e éticas associadas a um modelo de inteligência artificial mal construído.

- direito autoral

- Uso indevido de licença de código aberto

- violação de IP

- Preconceito ético como discriminação racial.

P. Por que é difícil criar um modelo de IA legalmente compatível?

R. Do ponto de vista técnico, pode ser difícil criar uma IA legalmente compatível porque, embora a tecnologia use os dados dos clientes para encontrar padrões e obter novos insights, fica difícil determinar o propósito real desses dados. Em seguida, as equipes de desenvolvimento de IA nunca podem ter certeza da quantidade de dados necessários para o projeto. Por fim, a maioria dos modelos de IA opera em caixas pretas e não está claro como eles tomam decisões, especialmente quando falamos de software avançado.

P. Como garantir a conformidade legal na IA?

R. Embora as leis e regulamentações relacionadas à conformidade legal de IA estejam em constante evolução, aqui estão algumas coisas que você pode fazer para garantir que seu modelo esteja mais próximo da conformidade:

- Certifique-se de que você tem permissão para usar dados

- Métodos de IA explicáveis

- Acompanhe os dados coletados

- Entenda as regras de transmissão de dados entre países