IA Responsável – Enfrentando os Desafios da Adoção com Princípios e Estratégias Orientadoras

Publicados: 2023-09-08Numa era dominada pela adoção generalizada de soluções de IA, tornou-se bastante vital dar prioridade a um processo de desenvolvimento responsável, ao mesmo tempo que respeita os princípios éticos e de segurança. À medida que estes sistemas de IA continuam a crescer em capacidade e a encontrar aplicações em vários nichos industriais, garantir que a sua criação esteja alinhada com medidas de segurança rigorosas deve ser uma das principais prioridades da organização.

Então, como garantir que seus sistemas baseados em IA sejam éticos e não causem consequências indesejadas? A resposta simples para este enigma é a adesão aos princípios da IA Responsável.

IA Responsável (RAI) refere-se a uma estrutura abrangente em inteligência artificial, onde as considerações éticas e o bem-estar social ocupam o centro das atenções. Apresenta o desenvolvimento responsável e a aplicação de sistemas de IA concebidos para se harmonizarem com os princípios fundamentais.

Os Princípios de IA Responsável permitem que as organizações se concentrem fortemente na transparência, permitindo que os usuários e as partes interessadas compreendam o funcionamento interno dos sistemas de IA. Esta transparência abre caminho para uma maior confiança e responsabilização, permitindo que os indivíduos compreendam como são tomadas as decisões sobre IA. A RAI também lida ativamente com o preconceito nos algoritmos de IA, gerenciando dados de forma inteligente e incorporando medidas de justiça para garantir que os resultados sejam imparciais e imparciais.

Este blog irá ajudá-lo a compreender os cinco princípios de IA responsável e como aderi-los a eles pode tornar seu sistema de IA justo e justo para os usuários. Além de analisar os benefícios da adoção de IA responsável para as empresas, também o ajudaremos a compreender os vários desafios que podem ser enfrentados através da adoção de uma abordagem simplificada.

A necessidade de adotar estratégias responsáveis de IA: mitigando os riscos de IA

Em março de 2016, a Microsoft lançou um chatbot de IA chamado Tay no Twitter. O objetivo de Tay era aprender com suas interações com os usuários. Infelizmente, alguns indivíduos começaram a postar conteúdo ofensivo para o bot, resultando na resposta de Tay com linguagem ofensiva. Em poucas horas, Tay se transformou em um bot que promovia discurso de ódio e discriminação. A Microsoft rapidamente colocou Tay offline e pediu desculpas pelos tweets inapropriados do bot. Este incidente é um exemplo claro de como a IA pode dar errado, e muitos casos semelhantes ocorreram desde então.

A IA tem um enorme potencial para beneficiar a sociedade, mas, como diz o tio Ben, “com grande poder vem uma grande responsabilidade”.

Ao usar IA para decisões de negócios importantes que envolvem dados confidenciais, é crucial saber:

- O que a IA está fazendo e por quê?

- É fazer escolhas precisas e justas?

- É respeitar a privacidade das pessoas?

- Você consegue controlar e ficar de olho nesta poderosa tecnologia?

Organizações em todo o mundo estão percebendo a importância das estratégias de IA Responsável, mas estão em pontos diferentes na sua jornada para adotá-las. Abraçar os princípios da IA Responsável (RAI) é a estratégia mais eficaz para mitigar os riscos associados à IA.

Portanto, é hora de avaliar suas práticas atuais e garantir que os dados sejam usados de forma responsável e ética. A adoção precoce do RAI não só reduzirá os riscos associados às práticas, mas também posicionará as organizações à frente dos concorrentes, proporcionando-lhes uma vantagem competitiva que pode ser difícil de superar no futuro.

De acordo com uma pesquisa do MIT Sloan, 52% das empresas estão tomando medidas em direção a práticas responsáveis de IA. No entanto, mais de 79% destas empresas admitem que os seus esforços são limitados em termos de escala e âmbito. O relatório destaca a importância crescente de as empresas enfrentarem os desafios e priorizarem a IA Responsável (RAI), à medida que o papel da IA nas empresas continua a aumentar. Para moldar um futuro sustentável e responsável impulsionado pela IA, estabelecer um quadro ético robusto não é apenas uma escolha, mas essencial.

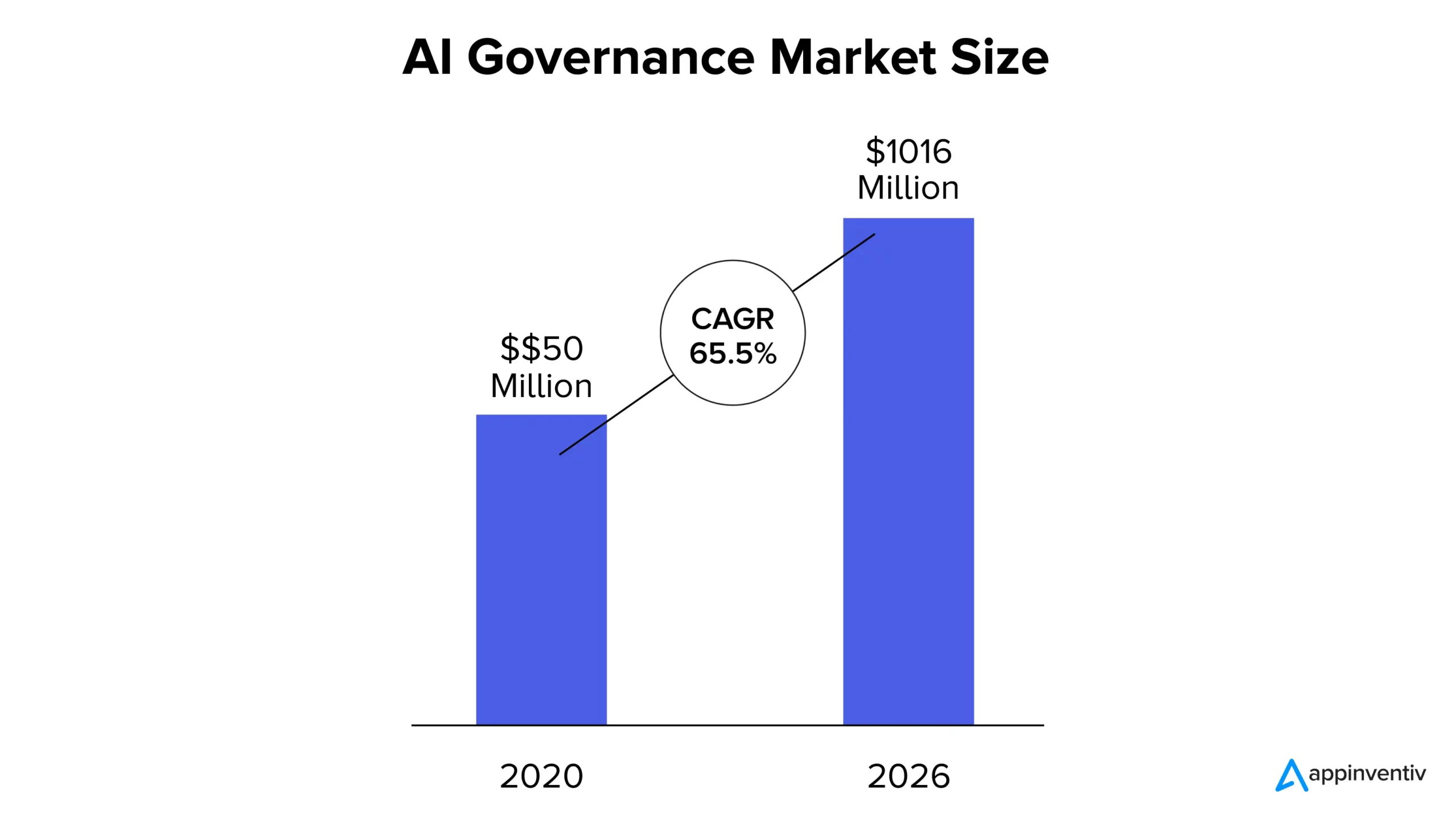

Agora, de acordo com o relatório MarketsandMarkets, o mercado de governança de IA foi avaliado em US$ 50 milhões em 2020 e deverá atingir US$ 1.016 milhões até 2026, testemunhando um CAGR de 65,5%. A crescente participação de mercado pode ser atribuída ao crescente crescimento da transparência nos sistemas de IA, à adesão às conformidades regulamentares e à crescente necessidade de confiança em soluções baseadas em IA.

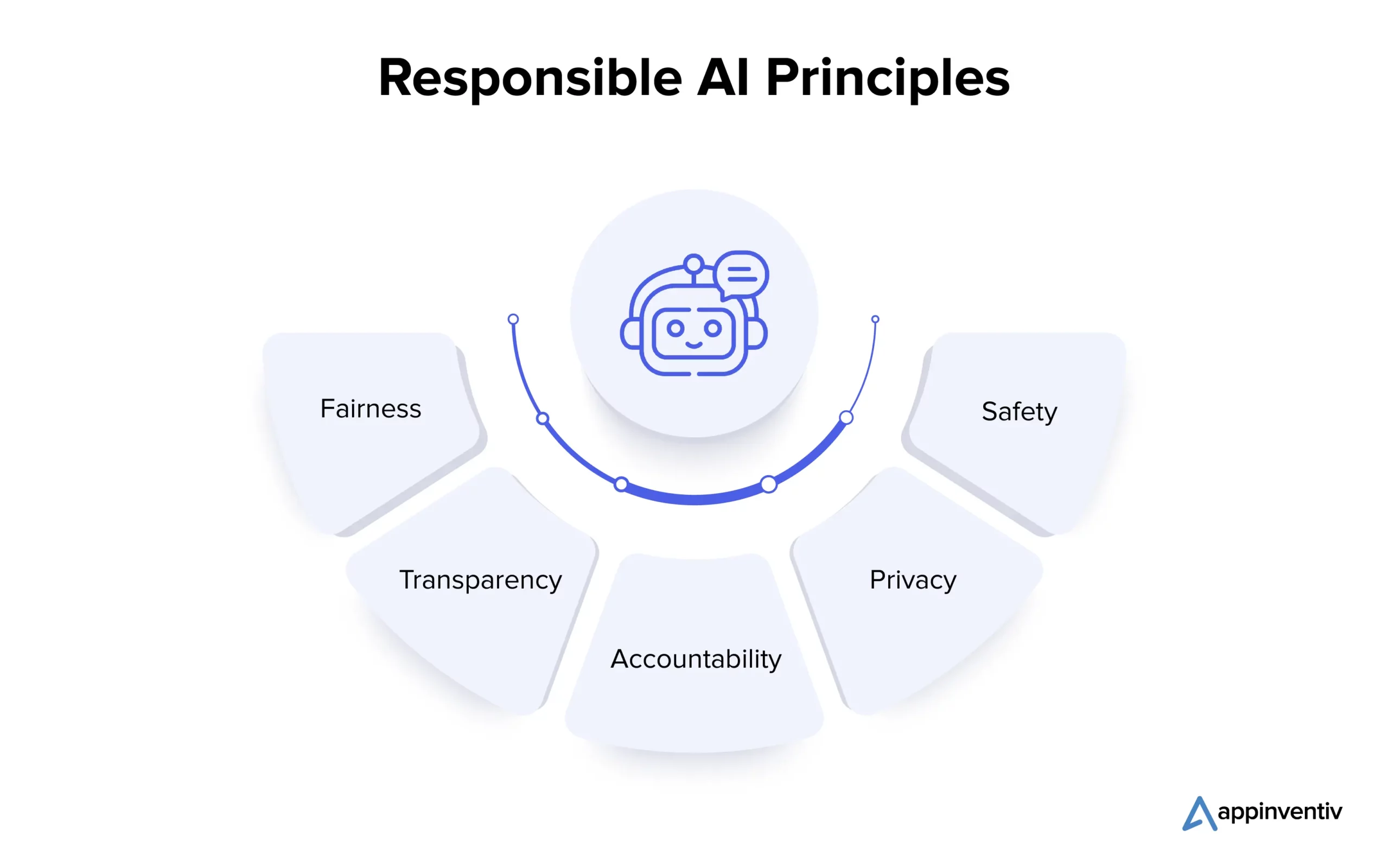

O que são princípios de IA responsável?

Compreender os princípios fundamentais da IA Responsável é vital para as organizações que procuram navegar de forma ética no complexo cenário da IA. Vejamos os vários princípios em detalhes abaixo:

1. Justiça

A justiça na IA é um princípio fundamental que aborda os preconceitos nos sistemas de IA. Vieses podem ocorrer durante a criação do algoritmo ou devido a dados de treinamento mal representados. Os cientistas de dados utilizam técnicas como a análise de dados para detectar e corrigir preconceitos, garantindo que os sistemas de IA tomem decisões imparciais e promovam resultados iguais.

2. Transparência

A transparência na IA envolve documentar e explicar as etapas tomadas no seu desenvolvimento e implantação, tornando-a compreensível para as partes interessadas. Técnicas como a aprendizagem automática interpretável revelam a lógica por detrás das decisões da IA, enquanto a supervisão humana garante o alinhamento ético e a justificação.

3. Responsabilidade

A responsabilização está intimamente ligada à transparência e abrange o estabelecimento de mecanismos para responsabilizar os criadores e utilizadores de IA pelos resultados e impactos dos sistemas de IA. Isto envolve a implementação de diretrizes éticas, o uso de ferramentas de monitoramento e a auditoria realizada. Estas medidas garantem que os sistemas de IA proporcionam os resultados desejados, evitam danos não intencionais e mantêm a fiabilidade.

4. Privacidade

A privacidade é crucial para proteger as informações pessoais dos indivíduos. O ecossistema de IA envolve a obtenção de consentimento para a recolha de dados, a recolha apenas dos dados necessários e a sua utilização apenas para os fins pretendidos. Técnicas de preservação de privacidade, como privacidade diferencial e técnicas criptográficas, são empregadas para proteger dados pessoais durante o desenvolvimento e produção de modelos de IA.

5. Segurança

Os desenvolvedores devem priorizar a segurança na IA responsável, incluindo o bem-estar físico e não físico. Para conseguir isto, as considerações de segurança devem ser integradas em todas as fases do desenvolvimento do sistema de IA. Na fase de concepção, é crucial envolver diversas partes interessadas para identificar e compreender os riscos potenciais. Avaliações de risco, testes sob diferentes condições, supervisão humana e monitoramento e melhoria contínuos durante a produção são essenciais para prevenir danos e manter a confiabilidade dos sistemas de IA.

Depois de examinar os múltiplos princípios da IA Responsável, vamos seguir em frente e compreender os desafios associados à adoção da solução.

Quais são os desafios na adoção de soluções de IA responsáveis?

A adoção da IA Responsável é uma jornada promissora com grandes recompensas para as empresas, mas os seus desafios críticos exigem uma consideração cuidadosa e soluções proativas. Vejamos eles em detalhes abaixo:

Explicabilidade e transparência

Os sistemas de IA devem ser capazes de esclarecer como e por que produzem resultados específicos para manter a confiança. A falta de transparência pode reduzir a confiança nestes sistemas.

Segurança Pessoal e Pública

Sistemas autônomos, como carros autônomos e robôs, podem causar riscos à segurança humana. Garantir o bem-estar humano em tais contextos é crucial.

Automação e Controle Humano

Embora a IA possa aumentar a produtividade, pode reduzir o envolvimento e a experiência humana. Encontrar um equilíbrio para garantir o controlo e a supervisão humana é um desafio.

Preconceito e discriminação

Embora os sistemas de IA sejam concebidos para serem neutros, ainda podem herdar preconceitos dos dados de treino, levando potencialmente a uma discriminação não intencional. Prevenir tais preconceitos é vital.

Responsabilidade e Regulamentação

Com o crescimento da presença global da IA, podem surgir questões de responsabilidade e obrigação. Determinar quem é responsável pelo uso e uso indevido do sistema de IA é complexo.

Segurança e privacidade

A IA requer acesso extensivo aos dados, o que pode levantar ainda mais preocupações sobre a privacidade dos dados e violações de segurança. A salvaguarda dos dados utilizados para formação em IA é essencial para proteger a privacidade geral de um indivíduo.

Agora, a parceria com uma empresa respeitável de desenvolvimento de aplicativos de IA (como a Appinventiv) que adere aos princípios de IA responsável durante o processo de desenvolvimento pode ajudar as empresas a mitigar de forma eficaz os desafios e riscos associados.

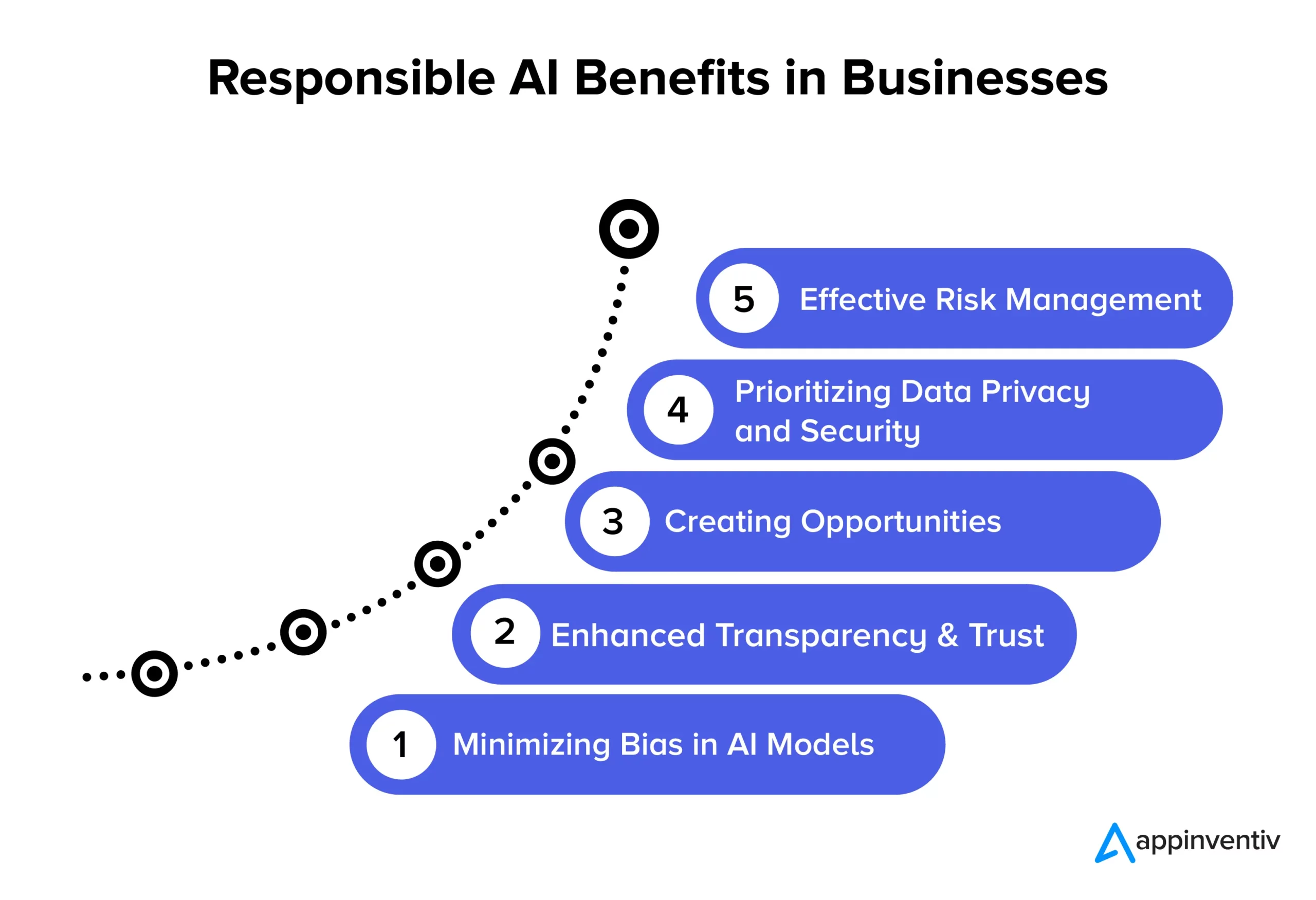

Benefícios da IA Responsável para Empresas

A adoção dos princípios da IA Responsável abre caminho para múltiplas vantagens significativas para as empresas e a sociedade. Vamos explorá-los em detalhes abaixo:

Minimizando preconceitos em modelos de IA

Ao aderir aos princípios da IA Responsável, as empresas podem reduzir eficazmente os preconceitos nos seus modelos de IA e nos dados subjacentes utilizados para os treinar. Esta redução do preconceito garante que os sistemas de IA forneçam resultados mais precisos e justos, que sejam eticamente corretos e reduzam o risco de alterações de dados ao longo do tempo. Além disso, minimizar o preconceito ajuda as organizações a evitar potenciais danos aos utilizadores que possam surgir de resultados tendenciosos do modelo de IA, melhorando a sua reputação e reduzindo a responsabilidade.

Transparência e confiança aprimoradas

Práticas responsáveis de IA melhoram a clareza e a transparência dos modelos de IA. Isso ajuda a fortalecer a confiança entre as empresas e seus clientes. Além disso, a IA torna-se mais disponível e compreensível para um público mais vasto, beneficiando as organizações e os utilizadores finais, permitindo uma gama mais ampla de aplicações e melhorando a utilização eficaz das tecnologias de IA.

Criando oportunidades

A adesão aos princípios de IA responsável permite que desenvolvedores e usuários tenham conversas abertas sobre sistemas de IA. É um dos benefícios de IA responsável mais procurados nas empresas. Cria um espaço onde as pessoas podem expressar as suas dúvidas e preocupações sobre a tecnologia de IA, permitindo que as empresas resolvam estas questões de forma proativa. Esta abordagem colaborativa ao desenvolvimento da IA resulta na criação de soluções de IA eticamente sólidas e socialmente responsáveis, que podem impulsionar a reputação e a competitividade de uma empresa.

Priorizando privacidade e segurança de dados

As soluções de IA responsável permitem que as empresas se concentrem significativamente na proteção da privacidade e segurança dos dados. Isto significa que os dados pessoais ou sensíveis são tratados com cuidado, salvaguardando os direitos dos indivíduos e evitando violações de dados. Quando as empresas seguem os princípios da IA Responsável, elas reduzem as chances de uso indevido de dados, violação de regulamentos e danos à sua reputação. É uma maneira inteligente de manter os dados seguros e a confiança do cliente.

Gestão Eficaz de Riscos

As práticas responsáveis de IA estabelecem regras éticas e legais claras para os sistemas de IA, o que ajuda a reduzir as chances de resultados prejudiciais. Esta redução de risco beneficia múltiplas entidades, como empresas, funcionários e a sociedade. As organizações podem evitar processos judiciais dispendiosos e prejudicar a sua reputação ao abordar possíveis problemas éticos e legais.

Exemplos de implementação bem-sucedida de IA responsável

Aqui estão alguns exemplos notáveis do mundo real de organizações que estão priorizando práticas éticas e imparciais de IA:

Ferramenta confiável de recrutamento de IA da IBM

Uma grande empresa dos EUA colaborou com a IBM para automatizar os processos de contratação e priorizar a justiça nos processos de recrutamento baseados em IA. Seu objetivo era facilitar a diversidade e a inclusão, mantendo intacta a integridade de seus modelos de aprendizado de máquina. Ao utilizar o IBM Watson Studio, uma ferramenta de monitoramento e gerenciamento de IA, eles identificaram e abordaram com sucesso o preconceito de contratação, ao mesmo tempo que obtiveram insights valiosos sobre a tomada de decisões de IA.

Estrutura de IA responsável da State Farm

A State Farm, uma das principais seguradoras dos EUA, incorporou a IA no seu processo de tratamento de sinistros e implementou uma estratégia responsável de IA. Criaram um sistema de governação para atribuir responsabilidades pela IA, resultando numa tomada de decisões mais rápida e informada. O modelo de IA do Dynamic Vehicle Assessment Model (DVAM) da State Farm prevê efetivamente perdas totais e traz transparência ao processamento de sinistros de seguros.

Equipe responsável de IA e lista de verificação do Grupo H&M

O Grupo H&M, um retalhista de moda global, integrou a IA nas suas operações para impulsionar a sustentabilidade, otimizar as cadeias de abastecimento e melhorar as experiências personalizadas dos clientes. A empresa estabeleceu uma equipe dedicada de IA responsável em 2018 para garantir o uso responsável da IA. Esta equipa desenvolveu uma lista de verificação prática que identifica e mitiga potenciais danos relacionados com a IA e adere de todo o coração aos princípios da IA Responsável.

Justiça do Google no aprendizado de máquina

O Google também trabalhou ativamente na inclusão de medidas de justiça na IA e no aprendizado de máquina. Eles desenvolveram ferramentas e recursos para ajudar os desenvolvedores a identificar e mitigar preconceitos em seus modelos de aprendizado de máquina.

GPT-3 da OpenAI

A OpenAI, a empresa por trás do GPT-3, também tem sido uma líder importante na adoção de uma abordagem responsável na implantação de IA. Implementaram mecanismos de ajuste fino para evitar resultados prejudiciais e tendenciosos que comprovam ainda mais o seu compromisso com a IA ética, mesmo em modelos avançados de PNL.

O futuro da IA responsável com Appinventiv

O futuro da IA Responsável é uma jornada contínua, com organizações em vários estágios de desenvolvimento ético em relação à tecnologia e ao uso de dados. É um campo dinâmico focado no estabelecimento de diretrizes padronizadas para diversos setores. Para navegar pelos princípios da IA Responsável para o seu negócio, a parceria com a Appinventiv é a melhor escolha que uma empresa pode fazer. Podemos ajudá-lo a criar soluções de IA éticas, imparciais e precisas, adaptadas às suas necessidades.

Sendo uma empresa dedicada ao desenvolvimento de IA, nossos desenvolvedores possuem anos de experiência no desenvolvimento de soluções de IA, priorizando a ética e a responsabilidade. Com um histórico comprovado de projetos de IA bem-sucedidos abrangendo vários domínios industriais, entendemos a importância de alinhar as soluções de IA com os valores fundamentais e princípios éticos exigidos. Podemos ajudá-lo a implementar medidas de justiça para garantir que suas soluções de negócios baseadas em IA tomem decisões imparciais.

Recentemente desenvolvemos o YouComm, um aplicativo de saúde baseado em IA que conecta pacientes a enfermeiras hospitalares por meio de gestos manuais e comandos de voz. A solução agora está implementada em mais de 5 redes hospitalares nos EUA.

Entre em contato com nossos especialistas em IA para criar soluções de IA que forneçam resultados precisos e sigam padrões éticos.

Perguntas frequentes

P. Quais são alguns exemplos de IA responsável?

A. Aqui estão alguns exemplos de IA responsável em vários domínios industriais:

- Algoritmos Justos: Sistemas de IA projetados para serem justos, reduzindo vieses de decisão.

- AI explicável (XAI): Tornando as decisões de IA compreensíveis.

- Mitigação de preconceito: Monitorando e reduzindo continuamente o preconceito na IA.

- Comitês de Ética em IA: Estabelecendo conselhos internos de revisão para IA ética.

- IA que preserva a privacidade: protege dados confidenciais ao usá-los para IA.

- Relatórios de Transparência: Compartilhando como os sistemas de IA funcionam e tomam decisões.

- Educação responsável em IA: Treinamento de profissionais de IA em ética e responsabilidade.

P. Quais são alguns casos de uso de IA responsável bem-sucedidos?

A. Aqui estão alguns casos de uso de IA responsável bem-sucedidos:

- Diagnóstico de saúde: É usado para aprimorar os resultados médicos com justiça e privacidade do paciente.

- Serviços Financeiros: É capaz de eliminar os riscos associados a fraudes e malware. As soluções responsáveis baseadas em IA podem proteger ainda mais os dados dos clientes e garantir empréstimos equitativos.

- Recrutamento: Ajuda a reduzir preconceitos ao mesmo tempo que abre caminho para a adoção da diversidade e da igualdade de oportunidades entre os usuários.

- Veículos Autônomos: Ajuda a priorizar a segurança e aderir aos padrões éticos.

P. A IA Responsável é um processo contínuo ou as empresas podem implementá-la uma vez e esquecê-la?

R. A IA responsável é um processo contínuo que requer monitoramento, atualização e adaptação contínuos às mudanças nos padrões e regulamentos éticos. Portanto, é aconselhável fazer parceria com uma empresa de desenvolvimento de IA dedicada que possa ajudá-lo a atravessar as águas com cuidado.