Cum poate AI explicabil să deblocheze dezvoltarea responsabilă și etică a inteligenței artificiale

Publicat: 2023-09-01Cu momente de transformare care combină inovația și ingeniozitatea, cum ar fi lansarea ChatGPT al OpenAI în noiembrie 2022, viziunea AI care ne controlează viețile nu mai este science fiction.

Momentul decisiv al lansării ChatGPT a inaugurat ceea ce industria numește „Explozia Cambriană AI”.

Cu toate acestea, este mai mult decât utilizarea AI pentru câștiguri în afaceri, care este punctul central actual al acestei explozii. În centrul acestei evoluții este un apel de a se concentra pe explicabilitatea AI. Acest lucru va asigura că progresele în IA sunt atât puternice, cât și transparente, ceea ce este fundamental pentru dezvoltarea etică a AI.

Inteligența artificială ia deja decizii pentru noi în multe domenii. Dar nu înțelegerea modului în care AI ajunge la aceste decizii rămâne un blocaj. Acesta este un beneficiu explicabil al inteligenței artificiale pe care antreprenorii și experții în tehnologie nu își pot permite să îl ignore.

Pe măsură ce tehnologia progresează, provocarea experților în tehnologie este dublă: să depășească limitele a ceea ce poate realiza AI, asigurându-se în același timp că funcționarea sa este transparentă, responsabilă și solidă din punct de vedere etic. Acest lucru evidențiază rolul AI explicabil în tehnologia modernă.

Potentialul economic al IA

Potențialul AI generativ de a revoluționa productivitatea nu este doar teoretic; este setat să aibă ramificații economice tangibile la scară globală. Potrivit unui raport din iunie 2023 intitulat „Potențialul economic al IA generativă: următoarea frontieră a productivității” publicat de McKinsey, IA generativă ar putea adăuga o valoare cuprinsă între 2,6 trilioane USD și 4,4 trilioane USD anual în cele 63 de cazuri de utilizare analizate. Există, de asemenea, cazuri explicabile de utilizare a AI care pot beneficia industriile în mai multe moduri noi.

Citește și: Cum AI generativă pentru afaceri modelează industriile

Washington Post a raportat că peste 11.000 de companii au folosit instrumentele OpenAI furnizate de divizia cloud a Microsoft, evidențiind tendințele de adoptare care însoțesc acest potențial. Aceste cifre reprezintă oportunități și responsabilități pentru liderii tehnologiei care navighează în acest peisaj în evoluție.

Pe măsură ce potențialul de transformare al inteligenței artificiale devine evident, se pune un accent din ce în ce mai mare pe principiile explicabile ale inteligenței artificiale, asigurându-se că aceste instrumente puternice funcționează cu claritate, supraveghere și considerații etice. Aplicațiile AI explicabile sunt programate să devină o piatră de temelie în industria tehnologiei.

Cu toate acestea, înțelegerea beneficiilor explicabile ale AI și a altor fațete conexe este doar începutul. Prin urmare, înainte de a discuta în detaliu nuanțele dezvoltării Explainable AI, trebuie să înțelegem mai întâi de ce este esențial.

Misterul modelelor AI: navigarea în „Cutia neagră”

Ca și în cazul tuturor progreselor semnificative, AI aduce provocări, unele profund legate de structura sa. O astfel de fațetă a acestui mister este o „cutie neagră”. Reprezentând un model operațional închis care funcționează, dar chiar și dezvoltatorii sunt uneori incapabili să explice cum funcționează. Aceasta este cunoscută sub numele de enigma cutie neagră în industria AI.

Această lipsă de transparență este inacceptabilă pentru mulți, în special pentru cei responsabili de decizii cruciale de afaceri sau societale. O IA care funcționează fără explicabilitate riscă să erodeze încrederea, mai ales atunci când este posibilă pierderea fizică și materială.

Consecințe neprevăzute: atunci când AI iese de pe șine

Consecințele deciziilor inexplicabile ale IA pot varia de la ineficiențe minore până la implicații societale semnificative. Luați în considerare sectorul financiar: un sistem AI ar putea refuza un împrumut unei persoane fără a oferi o justificare clară.

O astfel de decizie, lipsită de transparență, poate duce la complicații juridice și prejudicii reputației. La o scară mai mare, în asistența medicală, o inteligență artificială imperceptibilă ar putea acorda prioritate unui pacient față de altul pentru tratament, cu ramificații care modifică viața sau chiar termină viața.

Exemple din lumea reală de rezultate neașteptate și accidente AI

Mai multe incidente evidențiază consecințele neprevăzute ale IA. Tragicul incident din 2018 care a implicat mașina Uber care se conduce singur subliniază implicațiile îngrozitoare atunci când AI interpretează greșit mediul său. Un algoritm proeminent de asistență medicală care s-a dovedit a avea o prejudecată rasială este un memento clar că AI, oricât de avansată, poate perpetua din neatenție părtinirile umane dacă nu este înțeleasă și monitorizată în mod adecvat.

Lista continuă, de la Tay de la Microsoft, care a postat pe Twitter lucruri precum „Hitler a avut dreptate”, până la un cetățean american care a primit exuberant facturi de card de credit. Fără balustrade și capacitatea de a interpreta deciziile luate de AI, astfel de cazuri se vor întâmpla în continuare, de unde și apelul la explicabilitate.

Cazul de afaceri: beneficii explicabile ale inteligenței artificiale

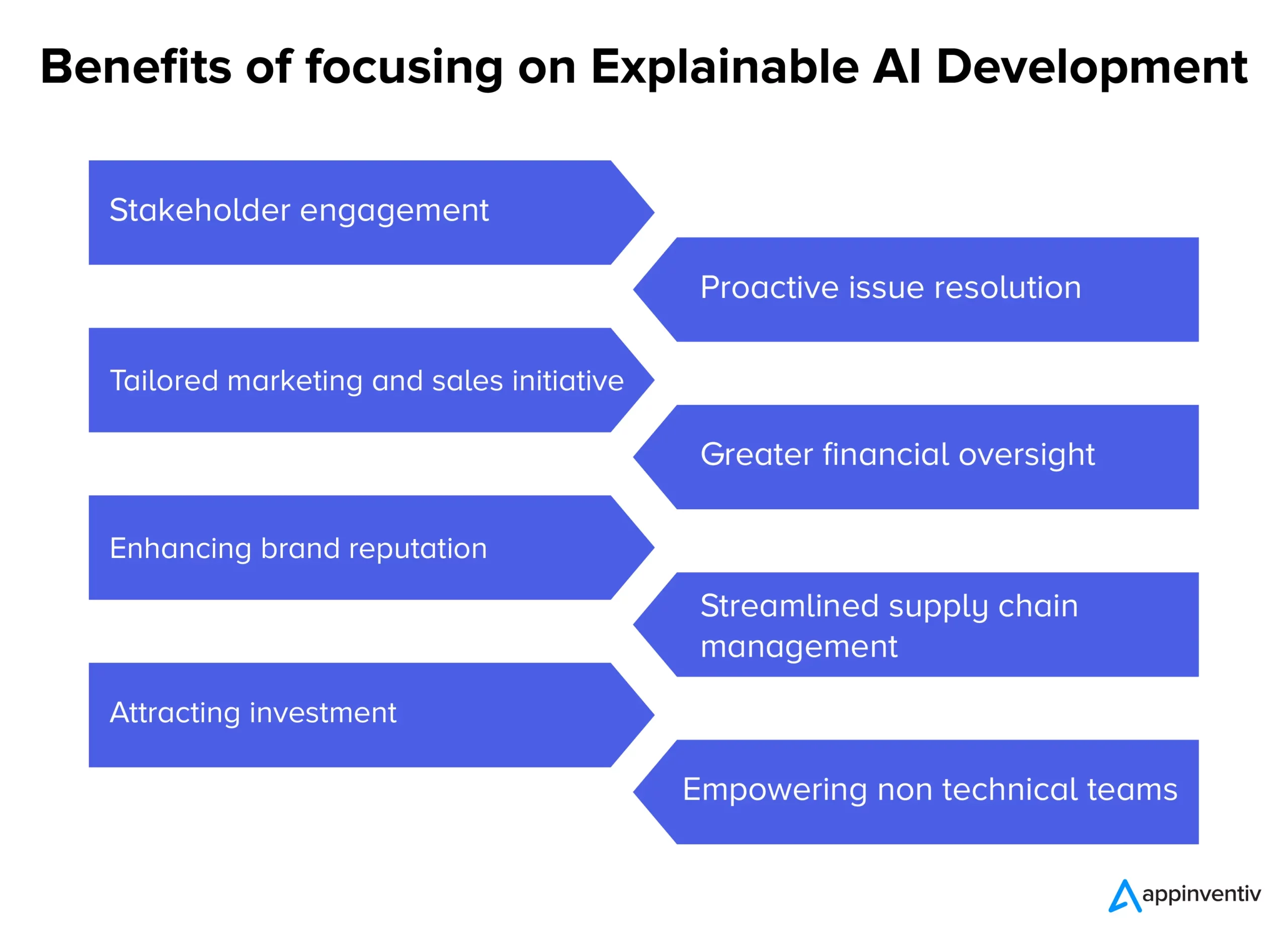

Pe măsură ce sistemele AI generează din ce în ce mai mult ambiții, opacitatea lor inerentă a stârnit conversații despre imperativul transparenței. Dincolo de doar discursul tehnic, există o rațiune solidă de afaceri care susține adoptarea AI explicabilă. Iată diferitele beneficii explicabile ale inteligenței artificiale pentru companii din diverse industrii.

- Implicarea și încrederea părților interesate: procesele transparente de luare a deciziilor AI pot stimula un sentiment mai profund de implicare și asigurare în rândul echipelor interne și al partenerilor externi.

- Rezolvarea proactivă a problemelor: înainte de escaladarea problemelor, inteligența artificială explicabilă poate evidenția zone potențiale de îngrijorare, permițând intervenții și soluții în timp util.

- Inițiative de marketing și vânzări personalizate: companiile pot crea campanii mai personalizate și mai eficiente, înțelegând „de ce” din spatele informațiilor despre consumatori bazate pe inteligență artificială.

- Supraveghere financiară mai mare: atunci când modelele și prognozele financiare bazate pe inteligență artificială sunt transparente, anomaliile potențiale sau zonele de creștere pot fi identificate și abordate mai ușor.

- Îmbunătățirea reputației mărcii: companiile cunoscute pentru implementările AI etice și transparente se vor bucura probabil de o reputație sporită a mărcii.

- Management eficient al lanțului de aprovizionare: Cu informații clare bazate pe inteligență artificială, procesele lanțului de aprovizionare pot fi optimizate mai eficient, de la gestionarea stocurilor la logistică.

- Atragerea investițiilor: pentru investitori, transparența în inteligența artificială poate semnifica angajamentul unei companii față de inovarea responsabilă, făcând-o o propunere de investiții mai atractivă.

- Împuternicirea echipelor non-tehnice: IA explicabilă asigură că perspectivele și deciziile bazate pe inteligență artificială sunt accesibile și acționabile pentru echipele fără expertiză tehnică profundă, încurajând colaborarea între departamente.

Pe măsură ce companiile navighează în peisajul complex al erei moderne, bazarea pe soluții de tip cutie neagră poate fi un joc de noroc. Infuzia de transparență în procesele AI nu este doar o actualizare tehnologică; este o necesitate de afaceri, asigurând că fiecare mișcare susținută de AI se aliniază cu obiectivele și valorile organizaționale mai largi, ceea ce înseamnă rolul AI explicabil. Acestea sunt, de asemenea, cazuri explicabile de utilizare a AI pe care se concentrează de obicei antreprenorii și dezvoltatorii AI.

Planul pentru un model AI explicabil

Acum, că impactul AI în viața noastră de zi cu zi devine tot mai evident pe zi ce trece, devine crucial să ne asigurăm că mașinile în care avem încredere pentru deciziile critice sunt precise și transparente în funcționarea lor.

Dezvoltarea unui model AI explicabil nu se referă doar la codificare; este un proces care implică planificare strategică, testare riguroasă și perfecționare iterativă bazată pe principii AI explicabile și instrumente AI explicabile. Iată un ghid pas cu pas și tehnici AI explicabile care asigură că modelele AI pe care le dezvoltăm sunt explicabile și interpretabile, în același timp fiind conforme din punct de vedere legal.

- Înțelegerea domeniului problemei: înainte de a aborda dezvoltarea modelului, înțelegem clar domeniul problemei și părțile interesate implicate. La ce se așteaptă utilizatorii? Ce decizii va lua AI și ce impact vor avea aceste decizii sunt câteva dintre întrebările la care găsim răspunsuri.

- Selectarea datelor adecvate: calitatea și relevanța datelor influențează direct capacitatea AI de a fi exacte și explicabile. În dezvoltarea modelului nostru AI, ne asigurăm că datele sunt curate, diverse și lipsite de părtiniri.

- Alegerea modelului potrivit: în timp ce unele modele, cum ar fi rețelele neuronale profunde, sunt mai complexe și mai greu de interpretat, altele, cum ar fi arborii de decizie sau regresia liniară, pot oferi mai multă transparență. Alegem un echilibru între complexitate și claritate în timp ce dezvoltăm modele AI explicabile.

- Testare iterativă: testăm în mod regulat modelul cu seturi variate de date pentru a asigura performanță constantă. Feedback-ul de la aceste teste poate informa perfecționări și îmbunătățiri.

- Integrarea instrumentelor de explicabilitate: instrumente precum LIME sau SHAP ajută la defalcarea predicțiilor modelului, oferind informații despre caracteristicile care au influențat o anumită decizie.

- Documentație: documentația cuprinzătoare ne ajută în verificarea, validarea și implementarea modelului. Se asigură că toate părțile interesate înțeleg funcționarea și limitările AI, de la dezvoltatori până la utilizatorii finali.

Echilibrarea performanței modelului cu interpretabilitatea

Una dintre cele mai semnificative provocări în dezvoltarea de software AI explicabil este echilibrarea performanței și interpretabilitatea unui model. În timp ce modelele complexe ar putea oferi o precizie mai mare, adesea o fac cu prețul transparenței. În schimb, modelele mai simple ar putea fi mai ușor de înțeles, dar ar putea să nu captureze în mod eficient nuanțele din date. Pentru a găsi echilibrul corect, luăm în considerare următoarele:

- Simplitatea modelului vs. Complexitate: Determinăm nivelul minim de complexitate necesar pentru a obține o performanță satisfăcătoare. Dacă un model mai simplu este suficient, ar putea fi o alegere mai bună pentru a asigura explicabilitatea.

- Utilizarea tehnicilor de explicabilitate: Tehnici precum clasarea importanței caracteristicilor sau metodele agnostice de model pot ajuta modelele complexe mai interpretabile.

- Bucla de feedback: menținem o buclă de feedback continuă cu utilizatorii finali pentru a înțelege dacă deciziile AI sunt clare și dacă există loc pentru îmbunătățirea transparenței.

Deși călătoria către obținerea unei IA explicabile poate părea complicată, este necesară. Pe măsură ce integrăm în continuare AI în sistemele și procesele noastre, asigurarea acestor modele de înaltă performanță și transparente va fi crucială pentru încredere și eficiență susținută.

Cum vă poate ajuta Appinventiv să dezvoltați modele explicabile de inteligență artificială?

Având aproape nouă ani de experiență în dezvoltarea de produse AI, noi cei de la Appinventiv înțelegem diferitele complexități legate de dezvoltarea modelelor AI și beneficiile explicabile ale AI. După ce au dezvoltat numeroase platforme și aplicații bazate pe inteligență artificială, inclusiv Mudra (o aplicație de finanțare personală bazată pe inteligență artificială), inginerii noștri au expertiza în domeniu și supravegherea pentru a se îndrepta către dezvoltarea inteligenței artificiale explicabile.

Oricare ar fi proiectul dvs. de AI, noi, în calitate de companie lider de dezvoltare AI, putem debloca interpretabilitatea și explicabilitatea modelului dvs. de AI, astfel încât să aveți încredere în deciziile luate de modele. Intrați în legătură

astăzi pentru a porni în călătoria către IA responsabilă.

Întrebări frecvente

Î. Ce este IA explicabilă?

A. AI explicabilă este o schimbare de paradigmă în dezvoltarea AI care necesită dezvoltarea modelelor AI astfel încât deciziile luate de modelul AI să poată fi retras și utilizatorii să poată înțelege modul în care modelul AI ia decizii.

Î. Cum funcționează AI explicabil?

A. IA explicabilă funcționează prin integrarea elementelor cheie de explicabilitate în modelele AI în timpul dezvoltării, care pot ajuta la determinarea modului în care un model AI a ajuns la o anumită decizie.

Î. De ce este importantă IA explicabilă?

A. Intelegerea artificială explicabilă este importantă deoarece neînțelegerea modului în care un model de inteligență artificială ia decizii pentru noi poate duce la unele consecințe grave și, în cele mai grave cazuri, poate însemna un prejudiciu tangibil pentru companii sau utilizatori ai modelului de inteligență artificială în cauză.