AI responsabilă – Abordarea provocărilor privind adopția cu principii și strategii directoare

Publicat: 2023-09-08Într-o eră dominată de adoptarea pe scară largă a soluțiilor AI, a devenit destul de vital să acordăm prioritate unui proces de dezvoltare responsabil, respectând în același timp principiile de siguranță și etice. Pe măsură ce aceste sisteme AI continuă să crească în capacitate și să găsească aplicații în diverse nișe industriale, asigurarea faptului că crearea lor se aliniază cu măsurile de siguranță riguroase trebuie să fie una dintre prioritățile de top ale organizației.

Deci, cum se poate asigura că sistemele lor bazate pe inteligență artificială sunt etice și nu vor provoca consecințe nedorite? Răspunsul simplu la această enigmă este aderarea la principiile IA responsabilă.

IA responsabilă (RAI) se referă la un cadru cuprinzător în inteligența artificială, în care considerentele etice și bunăstarea societății ocupă centrul atenției. Prezintă dezvoltarea și aplicarea responsabilă a sistemelor AI concepute pentru a se armoniza cu principiile fundamentale.

Principles of Responsible AI permite organizațiilor să se concentreze puternic pe transparență, permițând utilizatorilor și părților interesate să înțeleagă funcționarea interioară a sistemelor AI. Această transparență deschide calea pentru o mai mare încredere și responsabilitate, permițând indivizilor să înțeleagă cum sunt luate deciziile AI. RAI gestionează, de asemenea, în mod activ părtinirile din cadrul algoritmilor AI, gestionând în mod inteligent datele și încorporând măsuri de corectitudine pentru a se asigura că rezultatele sunt imparțiale și impartiale.

Acest blog vă va ajuta să înțelegeți cele cinci principii responsabile ale AI și modul în care aderarea la acestea poate face sistemul dvs. AI echitabil și corect pentru utilizatori. Pe lângă faptul că ne uităm la beneficiile adoptării unei inteligențe artificiale responsabile pentru companii, vă vom ajuta și să înțelegeți diferitele provocări care pot fi abordate prin adoptarea unei abordări simplificate.

Necesitatea adoptării de strategii responsabile de IA: atenuarea riscurilor AI

În martie 2016, Microsoft a lansat un chatbot AI numit Tay pe Twitter. Scopul lui Tay a fost să învețe din interacțiunile sale cu utilizatorii. Din păcate, unele persoane au început să posteze conținut ofensator pe bot, ceea ce a făcut ca Tay să răspundă cu un limbaj jignitor. În câteva ore, Tay s-a transformat într-un bot care promova discursul instigator la ură și discriminarea. Microsoft l-a scos rapid pe Tay offline și și-a cerut scuze pentru tweet-urile nepotrivite ale botului. Acest incident este un exemplu clar al modului în care AI poate merge prost și multe cazuri similare au avut loc de atunci.

Inteligența artificială are un potențial enorm de a beneficia societatea, dar, așa cum spune unchiul Ben, „cu o mare putere vine o mare responsabilitate”.

Când utilizați inteligența artificială pentru decizii de afaceri importante care implică date sensibile, este esențial să știți:

- Ce face AI și de ce?

- Faceți alegeri corecte și corecte?

- Este respectarea vieții private a oamenilor?

- Puteți controla și urmăriți această tehnologie puternică?

Organizațiile de pe tot globul realizează importanța strategiilor responsabile de inteligență artificială, dar se află în momente diferite ale călătoriei lor de a le adopta. Îmbrățișarea principiilor IA responsabilă (RAI) este cea mai eficientă strategie pentru a atenua riscurile asociate cu IA.

Astfel, este timpul să vă evaluați practicile curente și să vă asigurați că datele sunt utilizate în mod responsabil și etic. Adoptarea timpurie a RAI nu numai că va reduce riscurile asociate cu practicile, dar va poziționa și organizațiile înaintea concurenților, oferindu-le un avantaj competitiv care poate fi dificil de depășit în viitor.

Potrivit unui sondaj MIT Sloan, 52% dintre companii iau pași către practici responsabile de IA. Cu toate acestea, peste 79% dintre aceste companii recunosc că eforturile lor sunt limitate în ceea ce privește amploarea și amploarea. Raportul subliniază importanța tot mai mare pentru companii de a aborda provocările și de a acorda prioritate IA responsabilă (RAI), deoarece rolul AI în companii continuă să crească. Pentru a modela un viitor sustenabil și responsabil bazat pe inteligența artificială, stabilirea unui cadru etic robust nu este doar o alegere, ci este esențială.

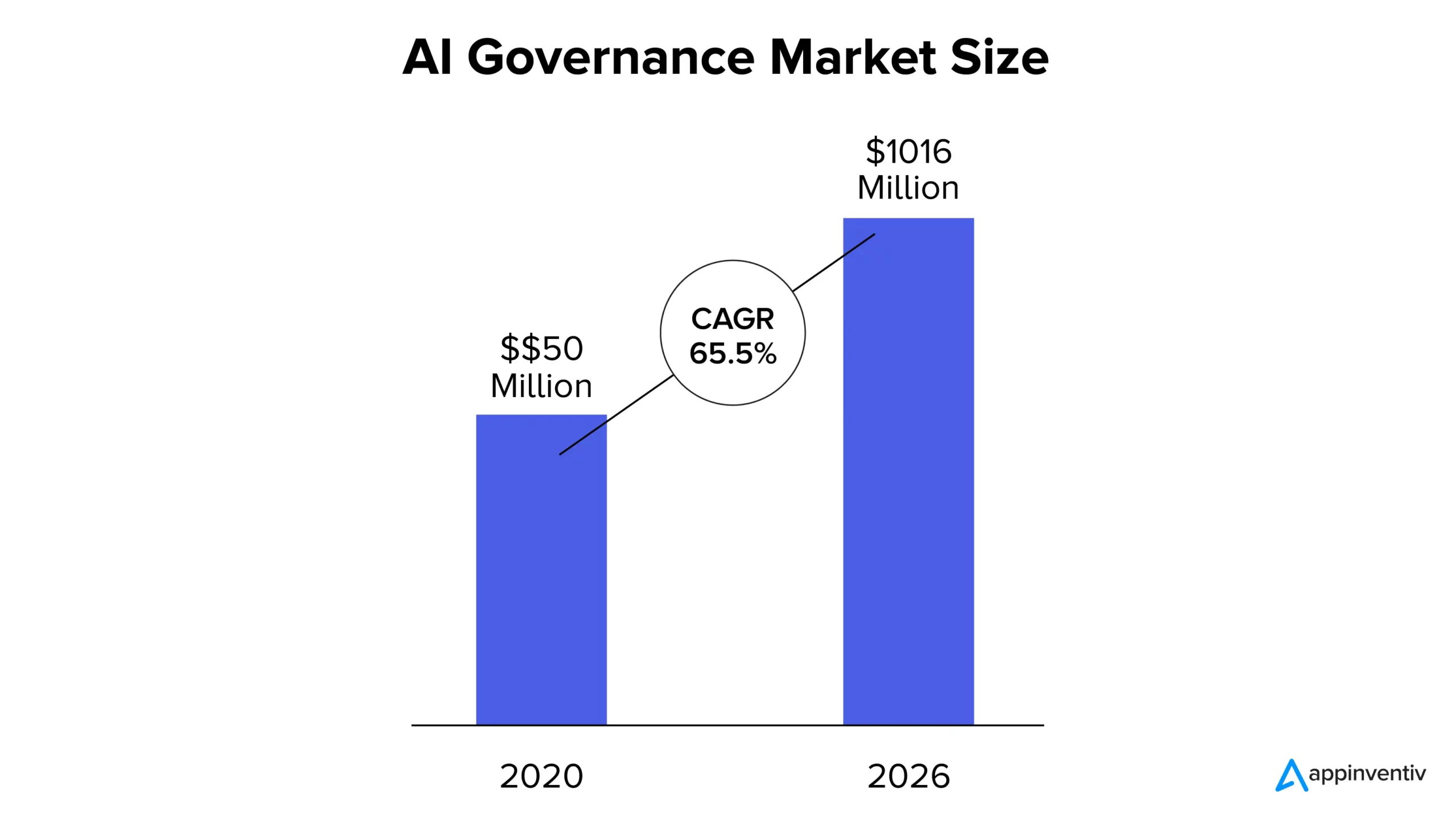

Acum, conform raportului MarketsandMarkets, piața de guvernanță AI a fost evaluată la 50 de milioane de dolari în 2020 și este de așteptat să ajungă la 1.016 de milioane de dolari până în 2026, martorii unui CAGR de 65,5%. Creșterea cotei de piață poate fi atribuită creșterii în creștere a transparenței în sistemele AI, respectarea conformității cu reglementările și nevoii tot mai mari de încredere în soluțiile bazate pe AI.

Ce sunt principiile AI responsabile?

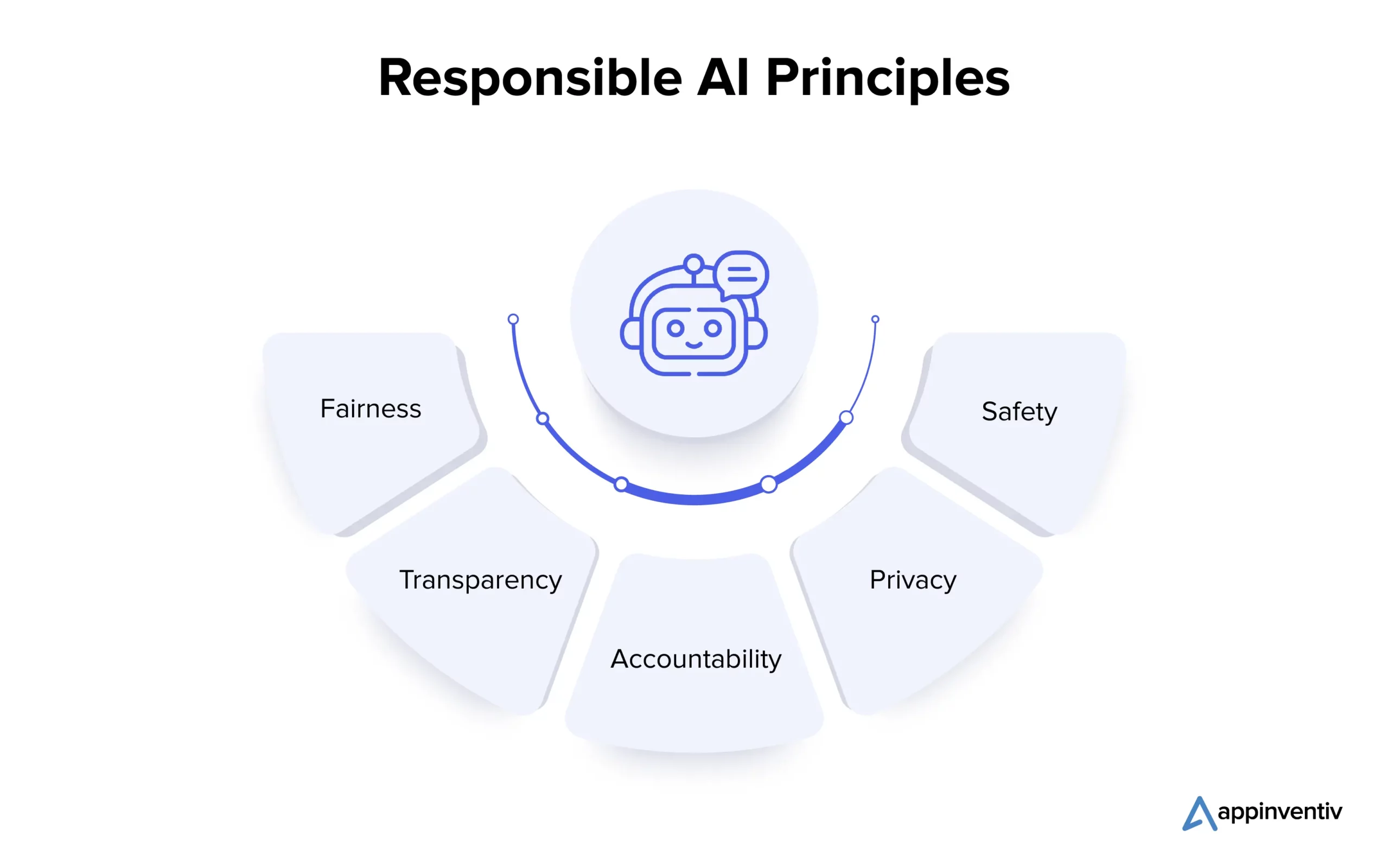

Înțelegerea principiilor de bază ale IA responsabilă este vitală pentru organizațiile care doresc să navigheze etic în peisajul complex al AI. Să ne uităm mai jos la multiplele principii în detaliu:

1. Corectitudine

Corectitudinea în IA este un principiu fundamental care abordează părtinirile din sistemele AI. Prejudiciile pot apărea în timpul creării algoritmului sau din cauza datelor de antrenament denaturate. Oamenii de știință de date folosesc tehnici precum analiza datelor pentru a detecta și corecta părtinirea, asigurându-se că sistemele AI iau decizii imparțiale și promovează rezultate egale.

2. Transparență

Transparența în IA implică documentarea și explicarea pașilor parcurși în dezvoltarea și implementarea acesteia, făcându-l ușor de înțeles pentru părțile interesate. Tehnici precum învățarea automată interpretabilă dezvăluie logica din spatele deciziilor AI, în timp ce supravegherea umană asigură alinierea etică și justificarea.

3. Responsabilitate

Responsabilitatea este strâns legată de transparență și include stabilirea de mecanisme care să tragă la răspundere dezvoltatorii și utilizatorii AI pentru rezultatele și impactul sistemelor AI. Aceasta implică implementarea ghidurilor etice, utilizarea instrumentelor de monitorizare și auditul efectuat. Aceste măsuri asigură că sistemele AI oferă rezultatele dorite, previn daunele neintenționate și mențin încrederea.

4. Confidențialitate

Confidențialitatea este crucială pentru protejarea informațiilor personale ale persoanelor. Ecosistemul AI implică obținerea consimțământului pentru colectarea datelor, colectarea numai a datelor necesare și utilizarea acestora exclusiv în scopurile prevăzute. Tehnicile de păstrare a confidențialității, cum ar fi confidențialitatea diferențială și tehnicile criptografice, sunt folosite pentru a proteja datele personale în timpul dezvoltării și producerii modelelor AI.

5. Siguranță

Dezvoltatorii trebuie să acorde prioritate siguranței în IA responsabilă, inclusiv bunăstarea fizică și non-fizică. Pentru a realiza acest lucru, considerentele de siguranță ar trebui integrate în fiecare etapă a dezvoltării sistemului AI. În faza de proiectare, angajarea diverselor părți interesate pentru a identifica și înțelege riscurile potențiale este crucială. Evaluările riscurilor, testarea în diferite condiții, supravegherea umană și monitorizarea și îmbunătățirea continuă în timpul producției sunt esențiale pentru a preveni daunele și pentru a menține fiabilitatea sistemelor AI.

După ce ne uităm la multiplele principii ale IA responsabilă, haideți să mergem mai departe și să înțelegem provocările asociate cu adoptarea soluției.

Care sunt provocările în adoptarea de soluții responsabile de inteligență artificială?

Adoptarea IA responsabilă este o călătorie promițătoare, cu recompense mari pentru companii, dar provocările sale critice necesită o analiză atentă și soluții proactive. Să le privim în detaliu mai jos:

Explicabilitate și transparență

Sistemele AI trebuie să fie capabile să clarifice cum și de ce produc rezultate specifice pentru a menține încrederea. Lipsa de transparență poate reduce încrederea în aceste sisteme.

Siguranța personală și publică

Sistemele autonome, cum ar fi mașinile cu conducere autonomă și roboții, pot cauza riscuri pentru siguranța umană. Asigurarea bunăstării umane în astfel de contexte este crucială.

Automatizare și control uman

Deși AI poate crește productivitatea, poate reduce implicarea umană și expertiza. Găsirea unui echilibru pentru a asigura controlul uman și supravegherea este o provocare.

Prejudecăți și discriminare

Chiar dacă sistemele AI sunt concepute pentru a fi neutre, ele pot moșteni în continuare părtiniri din datele de antrenament, ceea ce poate duce la o discriminare neintenționată. Prevenirea unor astfel de părtiniri este vitală.

Responsabilitate și reglementare

Odată cu creșterea prezenței generale a IA, pot apărea probleme de responsabilitate și răspundere. Determinarea cine răspunde pentru utilizarea și utilizarea necorespunzătoare a sistemului AI este complexă.

Securitate și confidențialitate

AI necesită un acces extins la date, care poate ridica și mai mult îngrijorări cu privire la confidențialitatea datelor și încălcările securității. Protecția datelor utilizate pentru instruirea AI este esențială pentru a proteja confidențialitatea generală a unei persoane.

Acum, parteneriatul cu o firmă de dezvoltare de aplicații AI de renume (cum ar fi Appinventiv) care aderă la principiile IA responsabilă în timpul procesului de dezvoltare poate ajuta companiile să atenueze în mod eficient provocările și riscurile asociate.

Beneficiile AI responsabil pentru companii

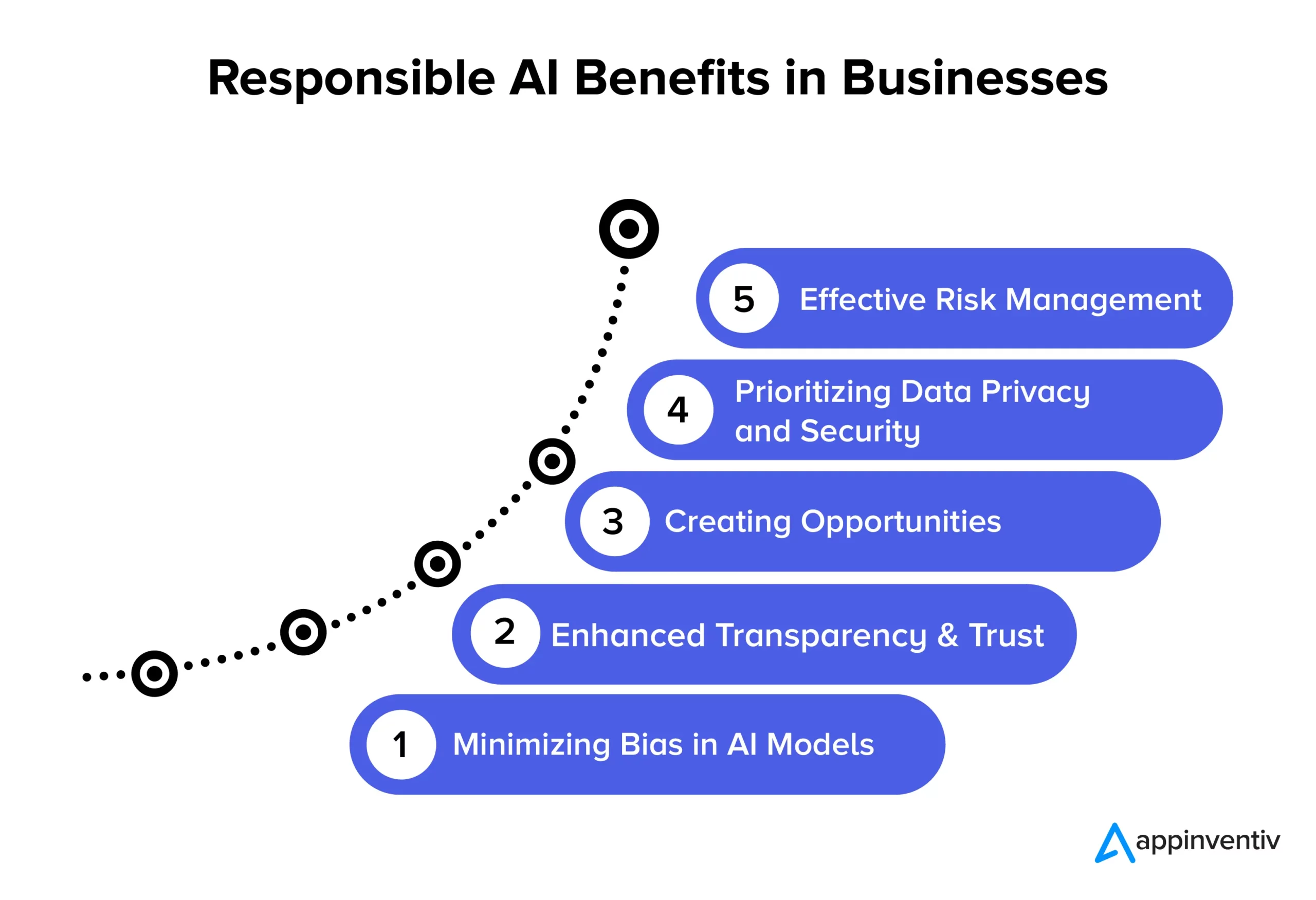

Adoptarea principiilor AI responsabile deschide calea pentru multiple avantaje semnificative pentru afaceri și societate. Să le explorăm în detaliu mai jos:

Minimizarea părtinirii în modelele AI

Prin aderarea la principiile IA responsabilă, companiile pot reduce în mod eficient părtinirile modelelor lor de IA și datele de bază folosite pentru a le instrui. Această reducere a părtinirii asigură că sistemele AI oferă rezultate mai precise și mai corecte, care sunt corecte din punct de vedere etic și reduc riscul modificărilor datelor în timp. În plus, minimizarea părtinirii ajută organizațiile să evite potențialele prejudicii aduse utilizatorilor care pot apărea din rezultatele părtinitoare ale modelului AI, sporindu-le reputația și reducând răspunderea.

Transparență și încredere sporite

Practicile responsabile AI sporesc claritatea și transparența modelelor AI. Acest lucru ajută la consolidarea încrederii între companii și clienții lor. În plus, AI devine mai disponibilă și mai ușor de înțeles pentru un public mai larg, avantajând organizațiile și utilizatorii finali, permițând o gamă mai largă de aplicații și îmbunătățind utilizarea eficientă a tehnologiilor AI.

Crearea de oportunitati

Aderarea la principiile IA responsabilă le dă dezvoltatorilor și utilizatorilor posibilitatea de a avea conversații deschise despre sistemele AI. Este unul dintre cele mai căutate beneficii responsabile de AI în afaceri. Creează un spațiu în care oamenii își pot exprima întrebările și îngrijorările cu privire la tehnologia AI, permițând companiilor să abordeze aceste probleme în mod proactiv. Această abordare colaborativă a dezvoltării AI are ca rezultat crearea de soluții AI solide din punct de vedere etic și responsabile din punct de vedere social, care pot spori reputația și competitivitatea unei companii.

Prioritizarea confidențialității și securității datelor

Soluțiile AI responsabile permit companiilor să se concentreze în mod semnificativ pe protejarea confidențialității și securității datelor. Aceasta înseamnă că datele personale sau sensibile sunt tratate cu grijă, salvând drepturile persoanelor și prevenind încălcarea datelor. Atunci când companiile urmează principiile IA responsabilă, ele reduc șansele de a folosi greșit datele, de a încălca reglementările și de a le deteriora reputația. Este o modalitate inteligentă de a păstra datele în siguranță și de a menține încrederea clienților.

Management eficient al riscului

Practicile responsabile AI stabilesc reguli etice și legale clare pentru sistemele AI, ceea ce ajută la reducerea șanselor de rezultate dăunătoare. Această reducere a riscului aduce beneficii mai multor entități, cum ar fi întreprinderile, angajații și societatea. Organizațiile pot evita procese costisitoare și pot deteriora reputația lor atunci când abordează posibile probleme etice și juridice.

Exemple de implementare responsabilă cu succes a AI

Iată câteva exemple demne de remarcat din lumea reală de organizații care acordă prioritate practicilor AI etice și impartiale:

Instrumentul IBM de încredere AI de recrutare

O mare corporație din SUA a colaborat cu IBM pentru a automatiza procesele de angajare și pentru a acorda prioritate corectitudinii în procesele de recrutare bazate pe inteligență artificială. Scopul lor a fost de a facilita diversitatea și incluziunea, păstrând în același timp intactă integritatea modelelor lor de învățare automată. Utilizând IBM Watson Studio, un instrument de monitorizare și management AI, aceștia au identificat și abordat cu succes prejudecățile legate de angajare, obținând în același timp informații valoroase asupra procesului decizional AI.

Cadrul AI responsabil al State Farm

State Farm, o companie de asigurări de top din SUA, a încorporat AI în procesul său de gestionare a daunelor și a implementat o strategie responsabilă de AI. Ei au creat un sistem de guvernanță pentru a atribui responsabilitatea pentru IA, rezultând într-o luare a deciziilor mai rapidă și mai informată. Modelul AI al modelului de evaluare dinamică a vehiculelor State Farm (DVAM) prezice efectiv pierderile totale și aduce transparență procesării daunelor de asigurare.

Echipa responsabilă de inteligență artificială și lista de verificare a H&M Group

H&M Group, un retailer global de modă, a integrat inteligența artificială în operațiunile sale pentru a stimula sustenabilitatea, a optimiza lanțurile de aprovizionare și a îmbunătăți experiențele personalizate ale clienților. Compania a înființat o echipă de IA responsabilă dedicată în 2018 pentru a asigura utilizarea responsabilă a IA. Această echipă a dezvoltat o listă de verificare practică care identifică și atenuează potențialele daune legate de IA și aderă cu toată inima la principiile AI responsabilă.

Corectitudinea Google în învățarea automată

De asemenea, Google a lucrat activ la includerea unor măsuri de corectitudine în AI și învățarea automată. Ei au dezvoltat instrumente și resurse pentru a ajuta dezvoltatorii să identifice și să atenueze părtinirea modelelor lor de învățare automată.

GPT-3 de la OpenAI

OpenAI, firma din spatele GPT-3, a fost, de asemenea, un lider cheie în adoptarea unei abordări responsabile a implementării AI. Ei au implementat mecanisme de reglare fină pentru a evita rezultatele dăunătoare și părtinitoare care dovedesc și mai mult angajamentul lor față de IA etică, chiar și în modelele avansate de NLP.

Viitorul AI responsabil cu Appinventiv

Viitorul Responsible AI este o călătorie continuă, cu organizații aflate în diferite stadii de dezvoltare etică în ceea ce privește utilizarea tehnologiei și a datelor. Este un domeniu dinamic axat pe stabilirea de linii directoare standardizate pentru diverse industrii. Pentru a naviga prin principiile IA responsabilă pentru afacerea dvs., parteneriatul cu Appinventiv este cea mai bună alegere pe care o poate face o companie. Vă putem ajuta să creați soluții AI etice, imparțiale și precise, adaptate nevoilor dvs.

Fiind o companie dedicată dezvoltării AI, dezvoltatorii noștri au ani de experiență în dezvoltarea de soluții AI, acordând prioritate eticii și responsabilității. Având o experiență dovedită de proiecte AI de succes care acoperă numeroase domenii industriale, înțelegem importanța alinierii soluțiilor AI cu valorile de bază și principiile etice necesare. Vă putem ajuta să implementați măsuri de corectitudine pentru a vă asigura că soluțiile dvs. de afaceri bazate pe inteligență artificială iau decizii imparțiale.

Recent, am dezvoltat YouComm, o aplicație de asistență medicală bazată pe inteligență artificială, care conectează pacienții cu asistentele din spital cu gesturi ale mâinilor și comenzi vocale. Soluția este acum implementată în peste 5 lanțuri de spitale din SUA.

Luați legătura cu experții noștri AI pentru a construi soluții AI care oferă rezultate precise și respectă standardele etice.

Întrebări frecvente

Î. Care sunt câteva exemple de IA responsabilă?

A. Iată câteva exemple de IA responsabilă în mai multe domenii industriale:

- Algoritmi echitabili: sisteme AI concepute pentru a fi corecte, reducând prejudecățile decizionale.

- AI explicabilă (XAI): luarea deciziilor AI ușor de înțeles.

- Atenuarea părtinirii: monitorizarea continuă și reducerea părtinirii în IA.

- Comitete de etică AI: stabilirea de comitete interne de evaluare pentru IA etică.

- AI pentru păstrarea confidențialității: protejează datele sensibile în timp ce le folosești pentru AI.

- Rapoarte de transparență: Împărtășirea modului în care funcționează sistemele AI și iau decizii.

- Educație responsabilă în inteligență artificială: instruirea profesioniștilor în inteligență artificială în materie de etică și responsabilitate.

Î. Care sunt unele cazuri de utilizare de succes a IA responsabilă?

A. Iată câteva cazuri de utilizare de succes a IA responsabilă:

- Diagnosticare medicală: este utilizat pentru a îmbunătăți rezultatele medicale cu corectitudine și confidențialitatea pacientului.

- Servicii financiare: este capabil să elimine riscurile asociate cu frauda și malware. Soluțiile responsabile bazate pe inteligență artificială pot proteja în continuare datele clienților și pot asigura împrumuturi echitabile.

- Recrutare: ajută la reducerea părtinirii, în timp ce deschide calea pentru adoptarea diversității și a șanselor egale în rândul utilizatorilor.

- Vehicule autonome: ajută la prioritizarea siguranței și la respectarea standardelor etice.

Î. Este IA responsabilă un proces continuu sau pot companiile să-l implementeze o dată și să uite de el?

A. IA responsabilă este un proces continuu care necesită monitorizare continuă, actualizare și adaptare la standardele și reglementările etice în schimbare. Prin urmare, este recomandabil să colaborați cu o firmă de dezvoltare AI dedicată, care vă poate ajuta să traversați apele cu atenție.