ใต้โค้ด: วิเคราะห์ความเสี่ยงพื้นฐานของ AI และมาตรการรับมือ

เผยแพร่แล้ว: 2023-09-25องค์กรต่างๆ ต่างมุ่งหน้าเข้าสู่โลกของ AI อย่างรวดเร็วเพื่อเร่งกระบวนการและสร้างความได้เปรียบทางการแข่งขัน อย่างไรก็ตาม จำเป็นอย่างยิ่งที่จะต้องเข้าใจว่าการเดินทางด้วย AI ของพวกเขาจะไม่ใช่แสงแดดและสายรุ้งเสมอไป และอาจมาพร้อมกับความเสี่ยงและความท้าทายบางอย่างด้วย เนื่องจากเทคโนโลยี AI พัฒนาอย่างรวดเร็วอย่างรวดเร็วอย่างที่ไม่เคยมีมาก่อน องค์กรต่างๆ จึงต้องเตรียมพร้อมปรับตัวในระดับโลก เพื่อที่จะประสบความสำเร็จในระบบนิเวศดิจิทัลที่ล้ำหน้านี้ จำเป็นอย่างยิ่งที่จะต้องเข้าใจข้อผิดพลาดที่อาจเกิดขึ้นและยอมรับแนวทางปฏิบัติที่ดีที่สุดในการนำทาง AI multiverse

ในขณะที่ปัญญาประดิษฐ์ยังคงก้าวหน้าต่อไป จึงมีความกังวลมากขึ้นเกี่ยวกับอันตรายที่อาจเกิดขึ้น Geoffrey Hinton “เจ้าพ่อแห่ง AI” ซึ่งเป็นที่รู้จักจากผลงานที่น่ายกย่องในด้านการเรียนรู้ของเครื่องและโครงข่ายประสาทเทียม ได้เตือนว่าระบบ AI กำลังก้าวหน้าไปอย่างรวดเร็วอย่างที่ไม่เคยมีมาก่อน และอาจมีความเสี่ยงในการควบคุม หากไม่ได้รับการจัดการด้วยการควบคุมดูแลที่เหมาะสม นอกจากนี้เขายังเน้นย้ำถึงความจำเป็นที่สำคัญในการแก้ไขปัญหาที่เกี่ยวข้องเหล่านี้ในเชิงรุก

ในอีกกรณีหนึ่ง Elon Musk ยังได้หยุดการทดลอง AI ขนาดใหญ่ไว้ชั่วคราว ข้อกังวลเหล่านี้จากผู้นำโลกเกี่ยวกับความเสี่ยงที่อาจเกิดขึ้นจาก AI สะท้อนให้เห็นว่าชุมชนเทคโนโลยีจำเป็นต้องพิจารณาผลกระทบและความท้าทายด้านจริยธรรมอย่างรอบคอบที่อาจเกิดขึ้นกับความก้าวหน้าในขีดความสามารถด้าน AI

ในปัจจุบัน ในขณะที่โลกก้าวหน้า Generative AI มีแนวโน้มที่จะได้รับความนิยมอย่างกว้างขวาง เนื่องจากพลังอันยิ่งใหญ่มักจะดึงดูดความรับผิดชอบที่ไม่มีเงื่อนไข การใช้ Generative AI จึงมาพร้อมกับระดับความเสี่ยงด้านจริยธรรมด้วย

ดังนั้น ในฐานะเจ้าของธุรกิจ ถึงเวลาแล้วที่จะต้องเข้าใจว่า AI สามารถนำมาซึ่งประโยชน์มากมาย แต่ยังมาพร้อมกับความท้าทายที่คุ้นเคยซึ่งจะปรากฏขึ้นเมื่อคุณแนะนำเทคโนโลยีใหม่ในการดำเนินงานประจำวันของคุณ

องค์กรต้องจัดลำดับความสำคัญการใช้งานอย่างรับผิดชอบโดยรับรองความถูกต้อง ความปลอดภัย ความซื่อสัตย์ การเพิ่มขีดความสามารถ และความยั่งยืน เมื่อเผชิญกับความท้าทายและความเสี่ยง พวกเขาสามารถพึ่งพาแนวทางปฏิบัติที่ดีที่สุดที่ผ่านการทดลองและทดสอบแล้ว ซึ่งพิสูจน์แล้วว่ามีประสิทธิภาพในการนำเทคโนโลยีอื่นๆ มาใช้อย่างประสบความสำเร็จ กลยุทธ์เหล่านี้สามารถทำหน้าที่เป็นรากฐานที่มั่นคงในการบูรณาการ AI เข้ากับการดำเนินธุรกิจของคุณ และลดความเสี่ยงด้าน AI ไปพร้อมกัน

บล็อกนี้จะช่วยให้คุณเข้าใจทุกสิ่งที่เกี่ยวข้องกับความเสี่ยงของ AI สำหรับธุรกิจของคุณ และวิธีลดความเสี่ยง ดังนั้นเพื่อไม่ให้เสียเวลา เรามาเจาะลึกรายละเอียดกันดีกว่า

ทำความเข้าใจความเสี่ยงของ AI

ตาม AI RMF 1.0 ซึ่งเป็นกรอบการจัดการความเสี่ยงด้านปัญญาประดิษฐ์ ซึ่งเผยแพร่โดยสถาบันมาตรฐานและเทคโนโลยีแห่งชาติ (NIST) ความเสี่ยงด้าน AI ครอบคลุมถึงอันตรายที่อาจเกิดขึ้นกับบุคคล องค์กร หรือระบบที่เกิดจากการพัฒนาและปรับใช้ระบบ AI ความเสี่ยงเหล่านี้อาจเป็นผลมาจากปัจจัยต่างๆ รวมถึงข้อมูลที่ใช้ในการฝึก AI อัลกอริธึม AI การใช้งานเพื่อวัตถุประสงค์หลายประการ และการโต้ตอบกับผู้คน ตัวอย่างของความเสี่ยงและการควบคุม AI นั้นแตกต่างกันไปตั้งแต่เครื่องมือการจ้างงานที่มีอคติไปจนถึงอัลกอริธึมที่ทำให้ตลาดล่ม

การตรวจสอบเชิงรุกของผลิตภัณฑ์และบริการที่ใช้ AI ถือเป็นสิ่งสำคัญในการรับรองความปลอดภัยและความปลอดภัยของข้อมูลและบุคคล ดังนั้น องค์กรจึงเชื่อในการใช้โซลูชันการบริหารความเสี่ยงที่สามารถช่วยคัดแยก ตรวจสอบ และลดความเสี่ยงเหล่านี้ได้อย่างมีประสิทธิภาพ

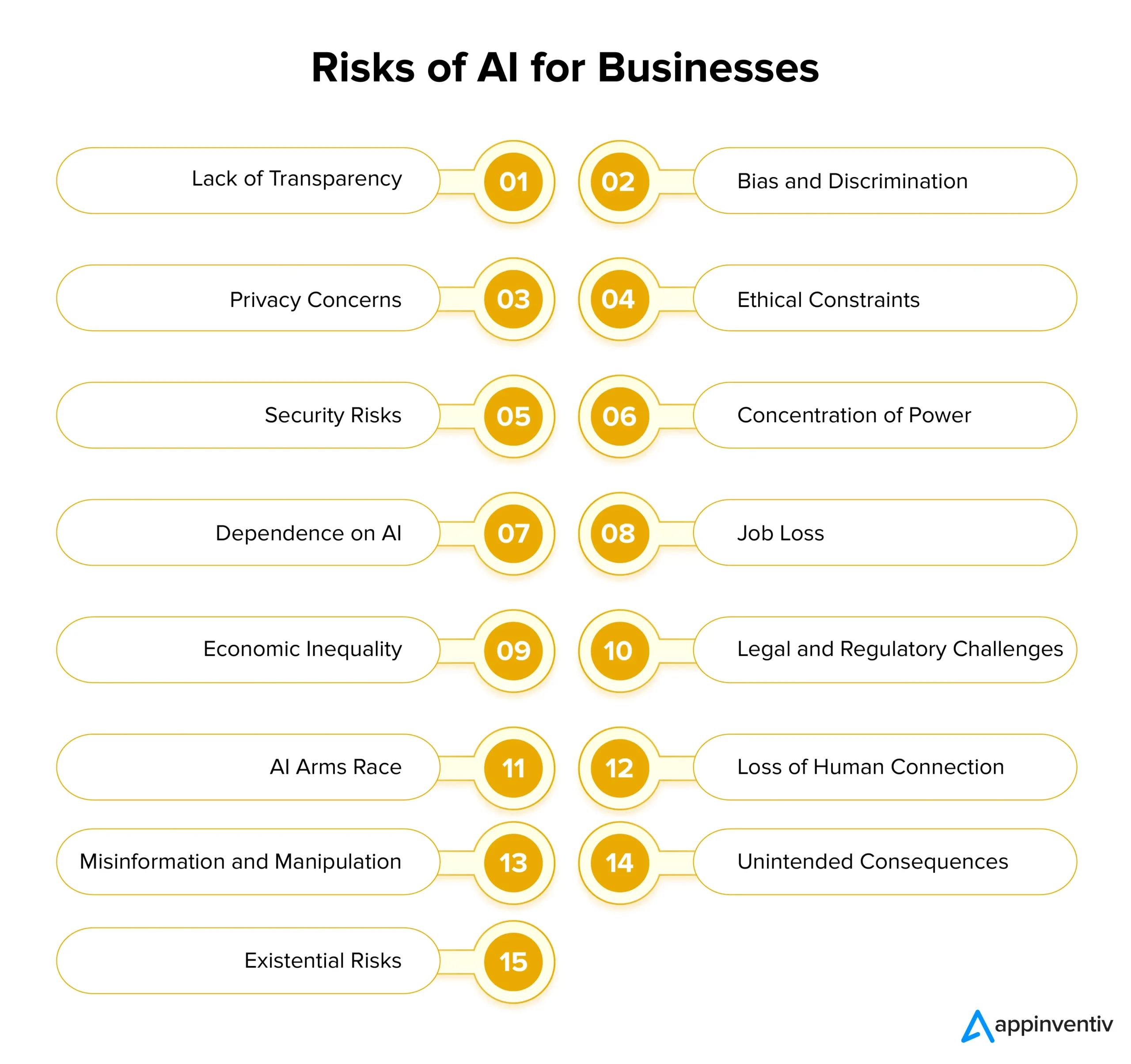

การระบุความเสี่ยงและความท้าทายด้าน AI สำหรับธุรกิจ

AI นำเสนอศักยภาพอันมหาศาลให้กับธุรกิจ แต่ยังนำมาซึ่งความเสี่ยงที่สำคัญในการนำไปปฏิบัติด้วย เพื่อให้มั่นใจว่าการนำ AI มาใช้อย่างมีความรับผิดชอบ จำเป็นอย่างยิ่งที่จะต้องเข้าใจและจัดการกับความท้าทายเหล่านี้ในเวลาที่เหมาะสม ให้เราดูความเสี่ยงและโซลูชัน AI สำหรับธุรกิจโดยละเอียดด้านล่าง:

ขาดความโปร่งใส

ระบบ AI มักจะทำงานไม่โปร่งใส ทำให้เป็นเรื่องยากที่จะเข้าใจว่าระบบเหล่านี้ตัดสินใจอย่างไร การขาดความโปร่งใสนี้อาจนำไปสู่ความไม่ไว้วางใจระหว่างผู้ใช้และผู้มีส่วนได้ส่วนเสีย เพื่อแก้ไขปัญหานี้ ธุรกิจควรจัดลำดับความสำคัญของความโปร่งใสโดยการออกแบบโมเดล AI และอัลกอริธึมที่ให้ข้อมูลเชิงลึกเกี่ยวกับกระบวนการตัดสินใจของตน

สิ่งนี้สามารถอำนวยความสะดวกได้ง่ายๆ โดยใช้เอกสารที่ชัดเจน เทคนิค AI ที่อธิบายได้ และเครื่องมือเพื่อแสดงภาพผลลัพธ์ที่ขับเคลื่อนด้วย AI สิ่งสำคัญคือต้องเข้าใจว่า AI ที่โปร่งใสช่วยเพิ่มความไว้วางใจโดยรวมระหว่างฝ่ายต่างๆ รวมถึงการตัดสินใจของพวกเขา และช่วยในการปฏิบัติตามกฎระเบียบ

อคติและการเลือกปฏิบัติ

ระบบ AI มีศักยภาพในการรักษาอคติทางสังคมที่พบในข้อมูลการฝึกอบรมได้อย่างง่ายดาย ซึ่งอาจนำไปสู่การตัดสินใจอย่างลำเอียง การเลือกปฏิบัติ และการปฏิบัติที่ไม่เป็นธรรมต่อคนบางกลุ่ม เพื่อจัดการกับความเสี่ยงเหล่านี้ของ AI องค์กรควรจัดลำดับความสำคัญของการลงทุนในข้อมูลการฝึกอบรมที่หลากหลายและเป็นตัวแทนซึ่งสามารถวิเคราะห์ได้

นอกจากนี้ การใช้อัลกอริธึมการตรวจจับและแก้ไขอคติและการตรวจสอบโมเดล AI เป็นประจำสามารถช่วยระบุและกำจัดอคติออกจากระบบที่มีอยู่ได้ การพัฒนา AI อย่างมีจริยธรรมจะต้องให้ความสำคัญกับความยุติธรรมและความเป็นกลางเป็นหลักการสำคัญ

ข้อกังวลด้านความเป็นส่วนตัว

ความเสี่ยงและความท้าทายด้าน AI ที่ยิ่งใหญ่ที่สุดประการหนึ่งคือภัยคุกคามต่อความเป็นส่วนตัว AI มักต้องการการรวบรวมและวิเคราะห์ข้อมูลส่วนบุคคลจำนวนมหาศาล ทำให้เกิดความกังวลเรื่องความเป็นส่วนตัวและความปลอดภัย ธุรกิจต้องจัดลำดับความสำคัญในการปกป้องข้อมูลโดยปฏิบัติตามกฎระเบียบด้านความเป็นส่วนตัวที่เข้มงวด การใช้มาตรการรักษาความปลอดภัยทางไซเบอร์ที่แข็งแกร่ง และการนำเทคนิคการเข้ารหัสข้อมูลมาใช้ วิธีนี้สามารถช่วยปกป้องความเป็นส่วนตัวของผู้ใช้และรักษาความไว้วางใจได้

ข้อจำกัดทางจริยธรรม

ระบบ AI ที่เกี่ยวข้องกับการตัดสินใจอย่างมีวิจารณญาณมักเผชิญกับประเด็นขัดแย้งด้านจริยธรรมที่อาจส่งผลกระทบเสียหายต่อสังคมอีกด้วย องค์กรควรกำหนดแนวทางและหลักการทางจริยธรรมสำหรับการพัฒนาและการใช้งาน AI เพื่อจัดการกับความเสี่ยงนี้ การพิจารณาด้านจริยธรรมควรเป็นหนึ่งในองค์ประกอบหลักของโครงการ AI เพื่อให้มั่นใจว่า AI สอดคล้องกับค่านิยมทางสังคมและบรรทัดฐานทางจริยธรรม

ความเสี่ยงด้านความปลอดภัย

เมื่อเทคโนโลยี AI ก้าวหน้า ความเสี่ยงด้านความปลอดภัยก็เช่นกัน กิจกรรมที่เป็นอันตรายสามารถใช้ประโยชน์จากระบบ AI และสร้างการโจมตีทางไซเบอร์ที่เป็นอันตรายมากขึ้น ซึ่งก่อให้เกิดภัยคุกคามที่สำคัญต่อธุรกิจ องค์กรควรใช้มาตรการรักษาความปลอดภัยที่แข็งแกร่งเพื่อลดความเสี่ยงด้านความปลอดภัย รวมถึงการเข้ารหัส โปรโตคอลการตรวจสอบสิทธิ์ และระบบตรวจจับภัยคุกคามที่ขับเคลื่อนด้วย AI การตรวจสอบอย่างต่อเนื่องและการตรวจสอบช่องโหว่เป็นประจำถือเป็นสิ่งสำคัญในการปกป้องการปรับใช้ระบบ AI

ความเข้มข้นของพลัง

เมื่อมีบริษัทขนาดใหญ่และรัฐบาลเพียงไม่กี่แห่งควบคุมการพัฒนา AI ก็อาจทำให้สิ่งต่างๆ ไม่ยุติธรรมและลดการใช้ AI ที่หลากหลายได้ เพื่อป้องกันสิ่งนี้ ธุรกิจควรทำงานเพื่อแบ่งปันการพัฒนา AI ในวงกว้างมากขึ้นในหลายกลุ่ม พวกเขาสามารถทำได้โดยการสนับสนุนสตาร์ทอัพขนาดเล็ก สนับสนุนแนวคิดใหม่ๆ และช่วยเหลือโครงการ AI แบบโอเพ่นซอร์ส ด้วยวิธีนี้ ทุกคนจึงสามารถเข้าถึง AI ได้มากขึ้น

ขึ้นอยู่กับเอไอ

การพึ่งพาระบบ AI มากเกินไปอาจทำให้สูญเสียความคิดสร้างสรรค์ การคิดเชิงวิพากษ์ และสัญชาตญาณของมนุษย์ สิ่งสำคัญคือต้องสร้างสมดุลระหว่างการตัดสินใจที่ได้รับความช่วยเหลือจาก AI และการตัดสินของมนุษย์ ตัวอย่างเช่น นักวิจัยได้เน้นย้ำถึงปัญหาของ "การล่มสลายของโมเดล" ซึ่งโมเดล AI เชิงสร้างสรรค์ที่ได้รับการฝึกเกี่ยวกับข้อมูลสังเคราะห์อาจให้ผลลัพธ์ที่มีคุณภาพต่ำลง เนื่องจากพวกมันเพียงจัดลำดับความสำคัญของการเลือกคำทั่วไปมากกว่าทางเลือกที่สร้างสรรค์

ธุรกิจต้องฝึกอบรมพนักงานให้ทำงานเคียงข้าง AI เพื่อหลีกเลี่ยงความเสี่ยงที่อาจเกิดขึ้นจาก AI การส่งเสริมการเรียนรู้อย่างต่อเนื่องสามารถช่วยให้องค์กรต่างๆ ควบคุมศักยภาพของ AI ในขณะเดียวกันก็รักษาทักษะของมนุษย์ไปพร้อมๆ กัน นอกจากนี้ การใช้ข้อมูลการฝึกอบรมที่หลากหลายและเทคนิคการทำให้เป็นมาตรฐานสามารถช่วยบรรเทาความท้าทายเหล่านี้ที่เกี่ยวข้องกับการล่มสลายของโมเดลได้

การสูญเสียงาน

ระบบอัตโนมัติที่ขับเคลื่อนด้วย AI มีศักยภาพที่จะเข้ามาแทนที่งานในอุตสาหกรรมต่างๆ โดยแรงงานที่มีทักษะต่ำเป็นเป้าหมายสูงสุด องค์กรจะต้องจัดการกับความท้าทายนี้ในเชิงรุกด้วยการให้โอกาสแก่พนักงานในการเรียนรู้มาตรการใหม่ๆ และเติบโตไปพร้อมกับความก้าวหน้าทางเทคโนโลยี การส่งเสริมการเรียนรู้ตลอดชีวิตและการปรับตัวถือเป็นสิ่งสำคัญในการบรรเทาความกังวลเกี่ยวกับการสูญเสียงานในหลายภาคส่วน

ความไม่เท่าเทียมกันทางเศรษฐกิจ

ความไม่เท่าเทียมกันทางเศรษฐกิจเป็นอีกความเสี่ยงและความท้าทายด้าน AI ที่โดดเด่นที่ธุรกิจจำเป็นต้องตระหนัก AI อาจทำให้ความไม่เท่าเทียมกันทางเศรษฐกิจแย่ลง เนื่องจากมักจะเป็นประโยชน์ต่อคนรวยและบริษัทขนาดใหญ่ เพื่อให้ AI ยุติธรรมมากขึ้น ผู้กำหนดนโยบายและธุรกิจควรคิดถึงวิธีที่จะรวมผู้คนในการพัฒนา AI มากขึ้น พวกเขาสามารถทำได้โดยการสร้างโปรแกรมที่ให้ผู้คนใช้เครื่องมือ AI มากขึ้น

ความท้าทายทางกฎหมายและข้อบังคับ

AI นำเสนอความซับซ้อนทางกฎหมายและกฎระเบียบใหม่ๆ รวมถึงปัญหาความรับผิดและสิทธิในทรัพย์สินทางปัญญา กรอบกฎหมายจำเป็นต้องพัฒนาเพื่อให้สามารถดำเนินการควบคู่ไปกับความก้าวหน้าทางเทคโนโลยี องค์กรควรรับทราบข้อมูลเกี่ยวกับกฎระเบียบที่เกี่ยวข้องกับ AI และมีส่วนร่วมอย่างแข็งขันกับผู้กำหนดนโยบายเพื่อกำหนดแนวทางการกำกับดูแลและแนวทางปฏิบัติของ AI ที่มีความรับผิดชอบ ธุรกิจต่างๆ สามารถใช้ AI สำหรับโซลูชันด้านความเสี่ยงและการปฏิบัติตามกฎระเบียบ เพื่อวิเคราะห์ข้อมูลและข้อมูลจำนวนมหาศาลได้อย่างง่ายดาย ในขณะเดียวกันก็ระบุความเสี่ยงที่เกี่ยวข้องกับการปฏิบัติตามกฎระเบียบที่อาจเกิดขึ้นได้

[อ่านเพิ่มเติม: วิธีหลีกเลี่ยงการละเมิดการปฏิบัติตามข้อกำหนดในขณะที่พัฒนาผลิตภัณฑ์ AI]

การแข่งขันอาวุธ AI

เมื่อประเทศต่าง ๆ เร่งรีบในการแข่งขันด้านอาวุธของ AI อาจหมายความว่าเทคโนโลยี AI พัฒนาเร็วเกินไปและอาจเป็นอันตรายได้ เพื่อป้องกันความเสี่ยงเหล่านี้ของ AI สิ่งสำคัญคือต้องส่งเสริมการพัฒนา AI อย่างรับผิดชอบ ประเทศต่างๆ ควรทำงานร่วมกันและทำข้อตกลงว่า AI สามารถนำมาใช้ในการป้องกันประเทศได้อย่างไร ด้วยวิธีนี้เราสามารถลดความเสี่ยงของ AI ที่ก่อให้เกิดอันตรายต่อการแข่งขันให้มีเทคโนโลยีที่ล้ำหน้ากว่าประเทศอื่น ๆ

การสูญเสียการเชื่อมต่อของมนุษย์

การเพิ่มการพึ่งพาการสื่อสารและการโต้ตอบที่ขับเคลื่อนด้วย AI อาจทำให้ความเห็นอกเห็นใจ ทักษะทางสังคม และความสัมพันธ์ของมนุษย์ลดลง องค์กรควรจัดลำดับความสำคัญของการออกแบบที่เน้นมนุษย์เป็นศูนย์กลาง โดยเน้นความสำคัญของการรักษาปฏิสัมพันธ์ของมนุษย์ที่มีความหมาย นอกเหนือจากการบูรณาการ AI

ข้อมูลที่ผิดและการจัดการ

เนื้อหาที่สร้างโดย AI เช่น Deepfakes ก่อให้เกิดความเสี่ยงที่สำคัญโดยมีส่วนช่วยในการเผยแพร่ข้อมูลเท็จและบิดเบือนความคิดเห็นของประชาชน การใช้เครื่องมือที่ขับเคลื่อนด้วย AI เพื่อตรวจจับข้อมูลที่ไม่ถูกต้องและแคมเปญการรับรู้ของสาธารณะสามารถช่วยรักษาความสมบูรณ์ของข้อมูลในยุคดิจิทัลที่พัฒนาอย่างรวดเร็วนี้

ผลที่ตามมาโดยไม่ตั้งใจ

เนื่องจากความซับซ้อน ระบบ AI อาจมีพฤติกรรมที่ไม่คาดคิดหรือทำการตัดสินใจโดยมีผลกระทบที่ไม่คาดคิด กระบวนการทดสอบ การตรวจสอบความถูกต้อง และการติดตามอย่างต่อเนื่องอย่างเข้มงวดถือเป็นสิ่งสำคัญในการระบุและแก้ไขปัญหาเหล่านี้ ก่อนที่จะบานปลายและก่อให้เกิดอันตราย

ความเสี่ยงที่มีอยู่

การสร้างปัญญาประดิษฐ์ทั่วไป (AGI) ที่ชาญฉลาดกว่ามนุษย์ทำให้เกิดความกังวลอย่างมาก องค์กรต้องตรวจสอบให้แน่ใจว่า AGI แบ่งปันคุณค่าและเป้าหมายของตนเพื่อหลีกเลี่ยงผลกระทบร้ายแรง สิ่งนี้จำเป็นต้องมีการวางแผนระยะยาวอย่างรอบคอบ กฎเกณฑ์ทางจริยธรรมที่เข้มงวด และการทำงานร่วมกันทั่วโลกเพื่อจัดการกับความเสี่ยงใหญ่ที่มาพร้อมกับ AGI

หลังจากดูความท้าทายและความเสี่ยงหลายประการที่กำหนดโดยเทคโนโลยี AI และวิธีจัดการความเสี่ยงของ AI บางอย่างแล้ว ให้เราก้าวไปข้างหน้าและดูรายละเอียดการกำกับดูแลของ AI

การกำกับดูแล AI สำหรับการบริหารความเสี่ยง

การกำกับดูแล AI ที่มีประสิทธิภาพเกี่ยวข้องกับการระบุและจัดการความเสี่ยงของ AI ผ่านแนวทางหลักสามประการ:

หลักการ: สิ่งเหล่านี้เกี่ยวข้องกับแนวทางที่อำนวยความสะดวกในการพัฒนาระบบ AI และการใช้งาน สิ่งเหล่านี้มักสอดคล้องกับมาตรฐานทางกฎหมายและบรรทัดฐานทางสังคม

กระบวนการ: จัดการกับความเสี่ยงและอันตรายที่อาจเกิดขึ้นจากข้อบกพร่องด้านการออกแบบและโครงสร้างการกำกับดูแลที่ไม่เพียงพอ

จิตสำนึกด้านจริยธรรม: แนวทางนี้ขับเคลื่อนโดยความรู้สึกว่าอะไรถูกและดี รวมถึงการปฏิบัติตามกฎ การตรวจสอบให้แน่ใจว่าสิ่งต่าง ๆ ถูกต้อง การคำนึงถึงชื่อเสียงของตนเอง ความรับผิดชอบต่อสังคม และการจับคู่ค่านิยมและความเชื่อขององค์กร

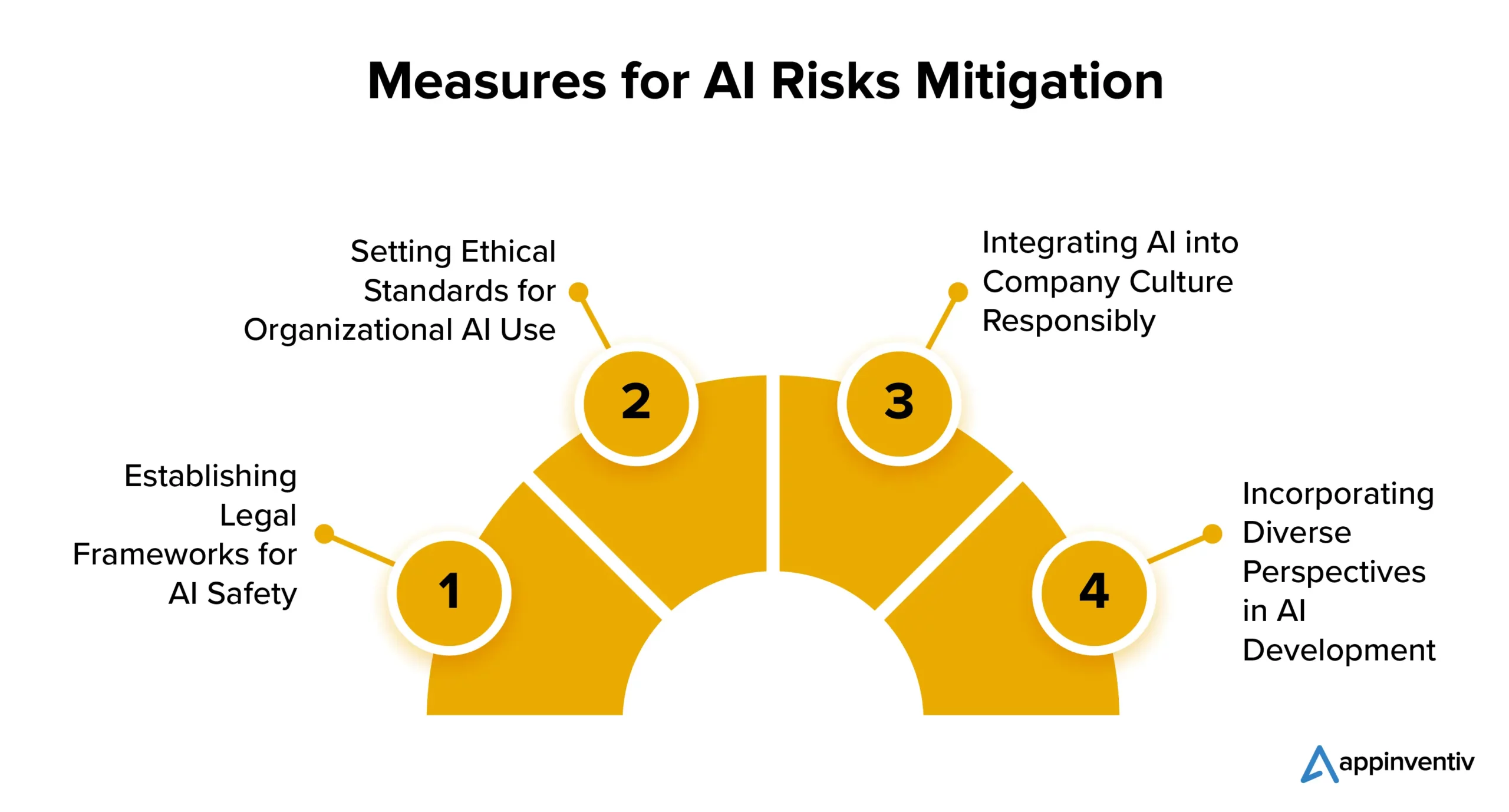

การลดความเสี่ยงด้าน AI: วิธีรักษาความปลอดภัยด้วยปัญญาประดิษฐ์

ต่อไปนี้เป็นกลยุทธ์หลายประการที่ธุรกิจสามารถทำได้เพื่อลดความเสี่ยงของการนำ AI ไปใช้:

การสร้างกรอบทางกฎหมายเพื่อความปลอดภัยของ AI

หลายประเทศกำลังมุ่งเน้นไปที่กฎระเบียบด้าน AI สหรัฐอเมริกาและสหภาพยุโรปกำลังทำงานเพื่อกำหนดกฎเกณฑ์ที่ชัดเจนเพื่อควบคุมการแพร่กระจายและการใช้ AI แม้ว่าเทคโนโลยี AI บางอย่างอาจเผชิญกับข้อจำกัด แต่ก็ไม่ควรหยุดธุรกิจจากการสำรวจศักยภาพของ AI เพื่อผลประโยชน์ของพวกเขา

การกำหนดมาตรฐานทางจริยธรรมสำหรับการใช้งาน AI ในองค์กร

สิ่งสำคัญคือต้องสร้างสมดุลระหว่างการควบคุมกับนวัตกรรม AI มีความสำคัญต่อความก้าวหน้า ดังนั้นองค์กรควรกำหนดมาตรฐานสำหรับการพัฒนาและการใช้งาน AI อย่างมีจริยธรรม ซึ่งควรรวมถึงการใช้อัลกอริธึมการตรวจสอบ การใช้ข้อมูลคุณภาพสูง และความโปร่งใสเกี่ยวกับการตัดสินใจของ AI

บูรณาการ AI เข้ากับวัฒนธรรมองค์กรอย่างมีความรับผิดชอบ

หนึ่งในกลยุทธ์ที่เป็นที่ต้องการสำหรับการลดความเสี่ยงด้าน AI ได้แก่ การแนะนำ AI ในวัฒนธรรมของบริษัท บริษัทต่างๆ สามารถบูรณาการ AI เข้ากับวัฒนธรรมของตนได้โดยการสร้างเทคโนโลยี AI และแนวทางกระบวนการที่เป็นที่ยอมรับ สิ่งนี้ทำให้มั่นใจได้ว่า AI จะถูกนำไปใช้อย่างมีจริยธรรมและความรับผิดชอบภายในองค์กร ซึ่งจะช่วยลดความเสี่ยงด้าน AI ที่อาจเกิดขึ้นได้

การผสมผสานมุมมองที่หลากหลายในการพัฒนา AI

นักพัฒนา AI ควรพิจารณามุมมองที่หลากหลาย รวมถึงมุมมองจากภูมิหลังและสาขาต่างๆ เช่น กฎหมาย ปรัชญา และสังคมวิทยา แนวทางที่ครอบคลุมนี้ช่วยสร้าง AI ที่มีความรับผิดชอบซึ่งเป็นประโยชน์ต่อทุกคน

Appinventiv สามารถช่วยรับรองแนวทางปฏิบัติที่ดีที่สุดสำหรับการพัฒนา AI ได้อย่างไร

แม้ว่าการนำ AI มาใช้ยังคงเพิ่มขึ้น แต่การบริหารความเสี่ยงที่มีประสิทธิผลยังคงล่าช้า ความท้าทายอยู่ที่บริษัทต่างๆ มักไม่ตระหนักถึงความจำเป็นในการแทรกแซงและแนวปฏิบัติในการพัฒนา AI ที่ยั่งยืน

ตามรายงานจาก MIT Sloan Management Review และ Boston Consulting Group ผู้ตอบแบบสอบถาม 42% มองว่า AI เป็นลำดับความสำคัญเชิงกลยุทธ์สูงสุด ในขณะที่มีเพียง 19% เท่านั้นที่ยืนยันว่าองค์กรของตนได้จัดทำโปรแกรม AI ที่มีความรับผิดชอบ ช่องว่างนี้เพิ่มความเสี่ยงต่อความล้มเหลว และทำให้บริษัทต่างๆ เสี่ยงต่อปัญหาด้านกฎระเบียบ การเงิน และชื่อเสียงที่เกิดจากการนำ AI ไปใช้

แม้ว่าการบริหารความเสี่ยงของ AI จะสามารถเริ่มต้นได้ในขั้นตอนใดก็ได้ของโครงการ แต่การกำหนดกรอบการบริหารความเสี่ยงให้เร็วกว่าในภายหลังก็เป็นสิ่งสำคัญ สิ่งนี้สามารถเพิ่มความไว้วางใจและทำให้องค์กรต่างๆ ขยายขนาดได้อย่างมั่นใจ

ในฐานะบริษัทพัฒนา AI โดยเฉพาะ ทีมงานของเรามีความเชี่ยวชาญหลายปีในการสร้างโซลูชัน AI ที่ได้รับการสนับสนุนจากการเน้นย้ำเรื่องจริยธรรมและความรับผิดชอบ ประวัติที่ได้รับการพิสูจน์แล้วของเราในขอบเขตอุตสาหกรรมต่างๆ แสดงให้เห็นถึงความมุ่งมั่นของเราในการปรับโซลูชัน AI ให้สอดคล้องกับค่านิยมหลักและหลักการทางจริยธรรม

เรามีความพร้อมที่จะช่วยคุณในการใช้มาตรการเพื่อความเป็นธรรมเพื่อให้แน่ใจว่าโซลูชันธุรกิจที่ใช้ AI ของคุณจะทำการตัดสินใจอย่างเป็นกลางและเป็นกลางอย่างสม่ำเสมอ

เมื่อเร็วๆ นี้เราได้พัฒนา YouComm ซึ่งเป็นแอปการดูแลสุขภาพที่ใช้ AI ซึ่งช่วยให้ผู้ป่วยเชื่อมต่อกับเจ้าหน้าที่ของโรงพยาบาลได้ด้วยเพียงท่าทางมือและคำสั่งเสียง ขณะนี้โซลูชันดังกล่าวได้รับการติดตั้งแล้วในเครือข่ายโรงพยาบาลมากกว่า 5 แห่งทั่วสหรัฐอเมริกา

ติดต่อผู้เชี่ยวชาญของเราเพื่อทำความเข้าใจการจัดการความเสี่ยง AI ที่เกี่ยวข้องสำหรับโครงการของคุณอย่างครบถ้วน และวิธีที่คุณสามารถบรรเทาได้อย่างง่ายดาย

คำถามที่พบบ่อย

ถาม ความเสี่ยงของ AI มีอะไรบ้าง?

A. AI มีความเสี่ยงโดยธรรมชาติ รวมถึงอคติ ข้อกังวลด้านความเป็นส่วนตัว ประเด็นขัดแย้งด้านจริยธรรม และภัยคุกคามด้านความปลอดภัย นอกจากนี้ยังสามารถนำไปสู่การย้ายงาน ทำให้ความไม่เท่าเทียมกันทางเศรษฐกิจแย่ลง และก่อให้เกิดความท้าทายทางกฎหมายและกฎระเบียบ นอกจากนี้ ความก้าวหน้าของ AI อัจฉริยะขั้นสูงยังทำให้เกิดความกังวลเกี่ยวกับการปฏิบัติตามค่านิยมของมนุษย์อีกด้วย เพื่อให้มั่นใจว่ามีการใช้เทคโนโลยีอย่างมีความรับผิดชอบและเป็นประโยชน์ และเพื่อหลีกเลี่ยงความเสี่ยงที่เกี่ยวข้องกับ AI การนำการจัดการอย่างรอบคอบ การพิจารณาด้านจริยธรรม และมาตรการด้านกฎระเบียบมาใช้เป็นสิ่งสำคัญ

ถาม AI สามารถใช้เพื่อลดความเสี่ยงจาก AI ได้อย่างไร

A. AI มีบทบาทสำคัญในการลดความเสี่ยงของ AI โดยการอำนวยความสะดวกในการตรวจจับและแก้ไขอคติ การวิเคราะห์เชิงคาดการณ์ การตรวจสอบความปลอดภัย การสนับสนุนการตัดสินใจอย่างมีจริยธรรม ฯลฯ ให้เรามาดูกันว่าเราสามารถช่วยลดความเสี่ยงของ AI โดยละเอียดได้อย่างไร:

- อัลกอริธึม AI สามารถระบุและแก้ไขความเอนเอียงในข้อมูล ช่วยลดผลลัพธ์ AI ที่มีอคติ

- การวิเคราะห์เชิงคาดการณ์สามารถคาดการณ์ความเสี่ยงและเปิดใช้มาตรการป้องกันได้

- เครื่องมือรักษาความปลอดภัยทางไซเบอร์ที่ขับเคลื่อนด้วย AI สามารถตรวจจับและตอบโต้ภัยคุกคามจาก AI ได้

- AI สามารถชี้แนะในการตัดสินใจเลือกอย่างมีจริยธรรม

- ระบบอัตโนมัติสามารถรับประกันการปฏิบัติตามกฎระเบียบ ซึ่งช่วยลดความเสี่ยงที่เกี่ยวข้องกับการปฏิบัติตามข้อกำหนด