Yapay Zeka Modelinin Çökmesini Önleme: Sentetik Veri Kümelerinin Doğal Riskinin Ele Alınması

Yayınlanan: 2023-10-05Yapay Zeka (AI), yayın platformlarında kişiselleştirilmiş içerik önererek ve akıllı telefonlarda dijital asistanları etkinleştirerek günlük yaşamlarımızı önemli ölçüde değiştirdi. Artık bu ilerlemeler, büyük miktarda veriden öğrenen gelişmiş yapay zeka modelleri sayesinde mümkün oluyor.

Çeşitli raporlara göre, yapay zeka tarafından oluşturulan içerik internette giderek daha yaygın hale geliyor ve önümüzdeki yıllarda çevrimiçi bilgilerin %90'ını oluşturma potansiyeli var.

Böylesine bir bilgi akışıyla, günümüzün veri açısından zengin dünyasında yapay zekanın benzersiz bir zorlukla karşı karşıya olduğu ve bunun veri bolluğunu boğduğu kolaylıkla söylenebilir.

Raporlar ayrıca, yapay zeka tarafından üretilen bu içeriğin önemli miktarının, insanları aşırı bilgiyle bunaltabileceğini ve neyin güvenilir ve insan tarafından oluşturulduğunu belirlemelerini zorlaştırabileceğini öne sürüyor. Ayrıca sanat, gazetecilik ve yazarlık gibi yaratıcı alanlarda potansiyel iş kaybıyla ilgili endişeler de var; bunun nedeni, yapay zekanın geleneksel olarak insanlar tarafından oluşturulan içeriği üretme konusunda daha yetenekli hale gelmesi.

Yapay zeka sistemlerine gelince, büyük veri kümeleri üzerinde eğitilen yapay zeka modellerinin, yaratıcı alternatifler yerine ortak kelime seçimlerine öncelik vererek daha düşük kaliteli çıktılar üretmesi sorununu ifade eden "Model Çöküşü" gibi ortaya çıkan sorunlar var. "Model Otofaji Bozukluğu" veya "Habsburg AI", diğer AI modellerinin çıktıları üzerinde aşırı derecede eğitilmiş AI sistemlerinin istenmeyen özellikler sergileyebileceği veya önyargılara sahip olabileceği başka bir endişe kaynağıdır.

Bu zorluklar, yapay zeka tarafından oluşturulan içeriğin kalitesine ve güvenilirliğine potansiyel olarak zarar verebilir, bu tür sistemlere olan güveni yok edebilir ve aşırı bilgi yükünü daha da kötüleştirebilir.

Blogumuz, yapay zeka modelinin çökmesini önlemeye yönelik her şeyi anlamanıza yardımcı olacaktır. Üretken yapay zeka devrimi ilerledikçe çevrimiçi bilgi ortamı için önemli zorlukları ve belirsizlikleri de beraberinde getiriyor. O halde doğrudan ayrıntılara dalalım.

Yapay Zeka Modelinin Çöküşünü Anlamak

Makine öğreniminde "model çöküşü", yapay zeka modelinin çeşitli yararlı çıktılar sağlayamadığı durumu ifade eder. Bunun yerine, dar bir dizi tekrarlayan veya düşük kaliteli sonuçlar üretir. Bu sorun çeşitli modellerde ortaya çıkabilir ancak genellikle üretken rakip ağlar (GAN'ler) gibi karmaşık modellerin eğitimi sırasında gözlemlenir. Modelin çökmesi, modelin çeşitli ve değerli çıktılar üretme yeteneğini engelleyerek genel performansını etkileyebilir.

Bir model çöküşü örneğini açıklayalım. Zebra resimleri oluşturmakla görevlendirilen yapay zeka modelimizi temsil eden son derece hevesli bir sanat öğrencisinin hayal edin. Başlangıçta eserleri etkileyici ve belirgin bir şekilde zebralara benziyor. Ancak resimleri devam ettikçe zebralara olan benzerliklerini giderek kaybediyor ve kalite düşüyor. Bu, yapay zeka modelinin, tıpkı sanat öğrencimiz gibi, başlangıçta iyi performans gösterdiği, ancak daha sonra gerçekleştirmek üzere tasarlandığı temel özellikleri korumakta zorlandığı makine öğrenimindeki "model çöküşüne" benzer.

Yapay zekadaki son gelişmelere göre araştırmacılar, konu görüntü ve metin oluşturmak olduğunda yeni yapay zeka modellerini eğitmek için yapay veya sentetik verileri kullanmakla çok ilgilenmeye başladılar. Ancak 'Model Otofaji Bozukluğu' (MAD) adı verilen bir kavram, bu süreci kendi kendini yok eden bir döngüye benzetiyor.

Düzenli olarak yeni gerçek dünya verileri eklemediğimiz sürece, sentetik veriler kullanarak oluşturduğumuz yapay zeka modellerinin kalitesi ve çeşitliliği zamanla kötüleşebilir. Bu nedenle yapay zeka modellerinin iyi performans göstermesini sağlamak için sentetik ve gerçek veriler arasında bir denge kurmak önemlidir.

Bu denge, öğrenmeye devam ettikçe modellerin kalitesinin ve çeşitliliğinin azalmasını önlemek için çok önemlidir. Üretken yapay zekanın gelişimi ve sentetik verilerin kullanımı söz konusu olduğunda, yapay zeka modelinin çökmesini önlemek için sentetik verilerin nasıl etkili bir şekilde kullanılacağını bulmak, süregelen bir zorluktur.

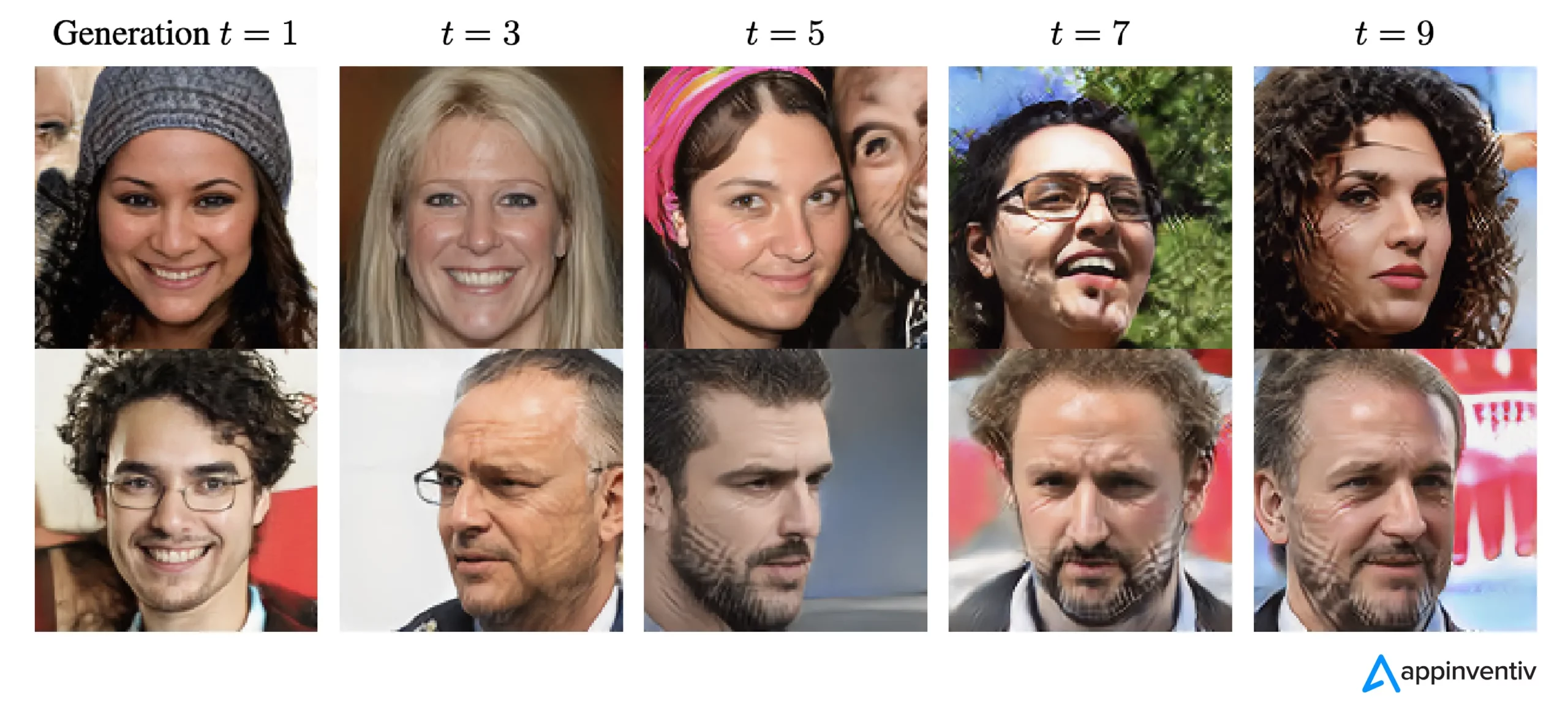

The New Yorker'a göre, eğer ChatGPT, bir fotoğrafı sıkıştıran bir JPEG dosyasına benzer şekilde internetin kompakt bir versiyonu olarak kabul edilirse, o zaman gelecekteki chatbot'ları ChatGPT'nin sonuçları üzerinde eğitmek, dijital olarak, tıpkı fotokopilerin fotokopilerinin tekrar tekrar yapılmasına eşdeğerdir. eski günler. Basitçe, görüntü kalitesinin her yinelemede daha da kötüleşmesi kaçınılmazdır.

Bu nedenle, bu zorluğun üstesinden gelmek için kuruluşların, bu üretken yapay zeka ürünlerinin bu dijital ortamda doğru yanıtlar vermeye devam etmesini sağlamak için yaklaşımlarını geliştirmeye odaklanmaları gerekiyor.

[Ayrıca Okuyun: Sorumlu Yapay Zeka – Evlat Edinme Zorluklarını Yol Gösterici İlkeler ve Stratejilerle Ele Alma]

Yapay Zeka Modelinin Çöküşü Nasıl Olur?

Model çökmesi, yeni yapay zeka modelleri eski modeller tarafından oluşturulan veriler kullanılarak eğitildiğinde ortaya çıkar. Bu yeni modeller, oluşturulan verilerde görülen kalıplara dayanmaktadır. Model çöküşü, üretken modellerin önceden öğrendikleri kalıpları tekrarlama eğiliminde olduğu ve bu kalıplardan elde edebilecekleri bilgilerin bir sınırı olduğu fikrine dayanmaktadır.

Modelin çökmesi durumunda, gerçekleşmesi muhtemel olaylar abartılırken, daha az muhtemel olaylar hafife alınır. Birden fazla nesil boyunca, olası olaylar verilere hakim olur ve verilerin daha az yaygın olan ancak yine de önemli olan kuyruk adı verilen kısımları azalır. Bu kuyruklar, modelin çıktılarının doğruluğunu ve çeşitliliğini korumak için gereklidir. Nesiller ilerledikçe hatalar verileri ele geçirir ve model verileri giderek daha fazla yanlış yorumlar.

Araştırmaya göre iki tür model çöküşü var: erken ve geç. Erken model çöküşü, modelin nadir olaylarla ilgili bilgileri kaybetmesini içerir. Geç modelin çöküşünde, model verilerdeki farklı kalıpları bulanıklaştırır ve sonuçta orijinal verilere çok az benzeyen çıktılar elde edilir.

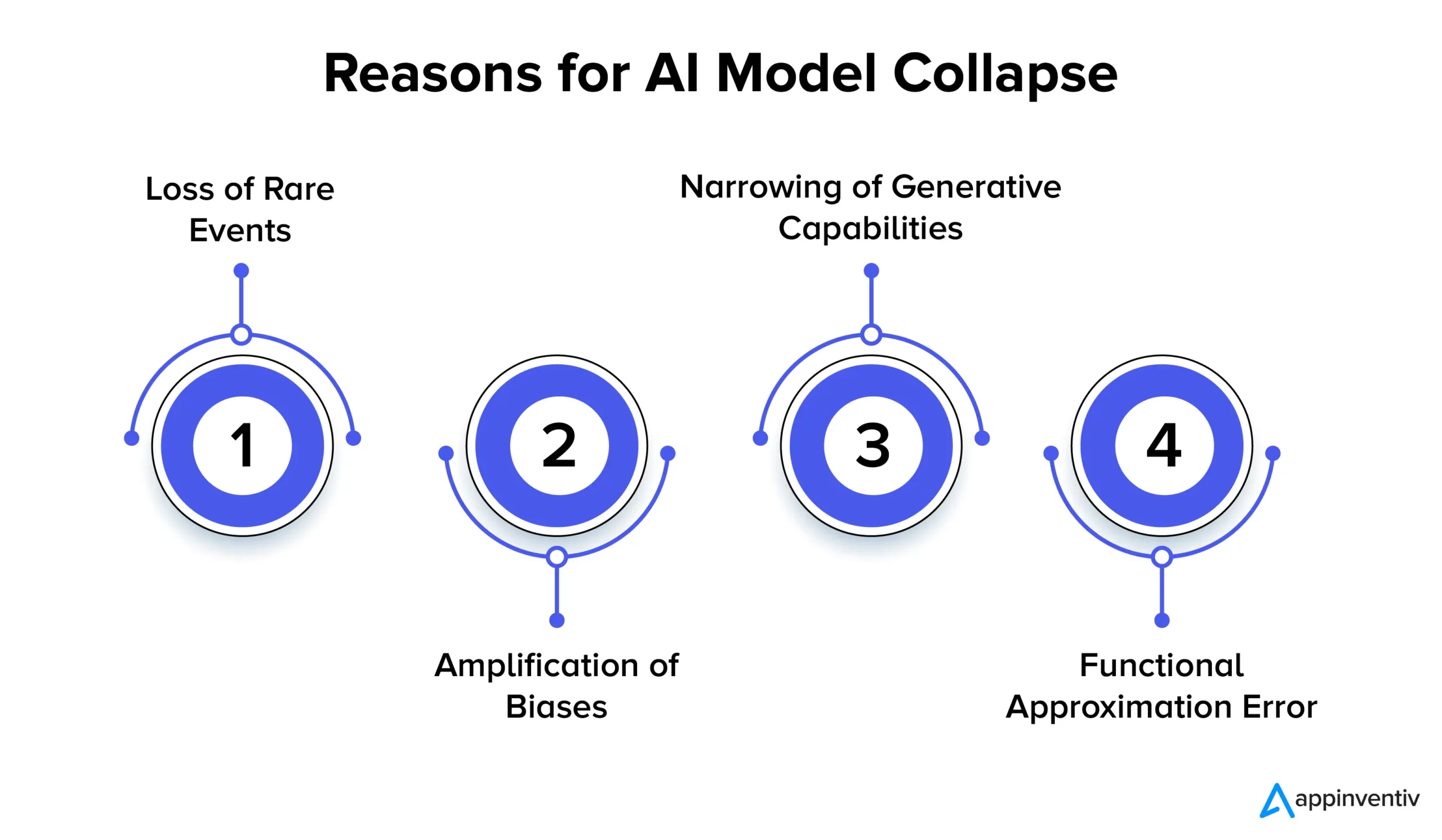

Yapay zeka modelinin çökmesinin çeşitli nedenlerine aşağıda ayrıntılı olarak bakalım:

Nadir Olayların Kaybı

Yapay zeka modelleri, önceki sürümleri tarafından oluşturulan veriler üzerinde tekrar tekrar eğitildiğinde, ortak kalıplara odaklanmaya ve nadir olayları unutmaya çalışırlar. Bu durum modellerin uzun süreli hafızasını kaybetmesine benzer. Üretim süreçlerindeki anormalliklerin belirlenmesi veya hileli işlemlerin tespit edilmesi gibi nadir olaylar genellikle büyük önem taşır. Örneğin, dolandırıcılık tespiti söz konusu olduğunda, belirli dil kalıpları dolandırıcılık davranışının sinyalini verebilir ve bu nadir kalıpların saklanması ve öğrenilmesi hayati önem taşır.

Önyargıların Arttırılması

Yapay zeka tarafından oluşturulan veriler üzerindeki her eğitim yinelemesi, eğitim verilerindeki mevcut önyargıları güçlendirebilir. Modelin çıktısı genellikle üzerinde eğitim verildiği verileri yansıttığından, bu verilerdeki sapmalar zamanla abartılabilir. Bu, çeşitli yapay zeka uygulamalarında önyargının artmasına yol açabilir. Örneğin, sonuçlar ayrımcılık, ırksal önyargı ve taraflı sosyal medya içeriği gibi sorunlara yol açabilir. Bu nedenle, önyargıyı tespit etmek ve azaltmak için kontrollerin uygulanması son derece önemlidir.

Üretken Yeteneklerin Daraltılması

Yapay zeka modelleri, oluşturulan verilerden öğrenmeye devam ettikçe üretken yetenekleri daralabilir. Model, gerçeklikle ilgili kendi yorumlarından oldukça etkileniyor ve çeşitlilikten ve nadir olayların temsilinden yoksun, giderek daha benzer içerikler üretiyor. Bu özgünlüğün kaybolmasına neden olabilir. Örneğin, Büyük Dil Modelleri (LLM'ler) söz konusu olduğunda, çeşitlilik her yazara veya sanatçıya farklı bir ton ve stil kazandırır.

Araştırmalar, eğitim süreci sırasında düzenli olarak yeni veriler eklenmezse gelecekteki yapay zeka modellerinin zamanla daha az doğru hale gelebileceğini veya daha az çeşitli sonuçlar üretebileceğini öne sürüyor.

Fonksiyonel Yaklaşım Hatası

Modelde kullanılan fonksiyon yaklaştırıcıları yeterince açıklayıcı olmadığında fonksiyonel bir yaklaşım hatası ortaya çıkabilir. Bu hata, daha etkileyici modeller kullanılarak azaltılabilirken, aynı zamanda gürültüye neden olabilir ve aşırı uyuma yol açabilir. Modelin ifade gücü ile gürültü kontrolü arasında doğru dengeyi yakalamak bu hataları önlemek açısından çok önemlidir.

Model Çöküşünün Sonuçları: Yapay Zeka Modelinin Kararlılığı Neden Önemlidir?

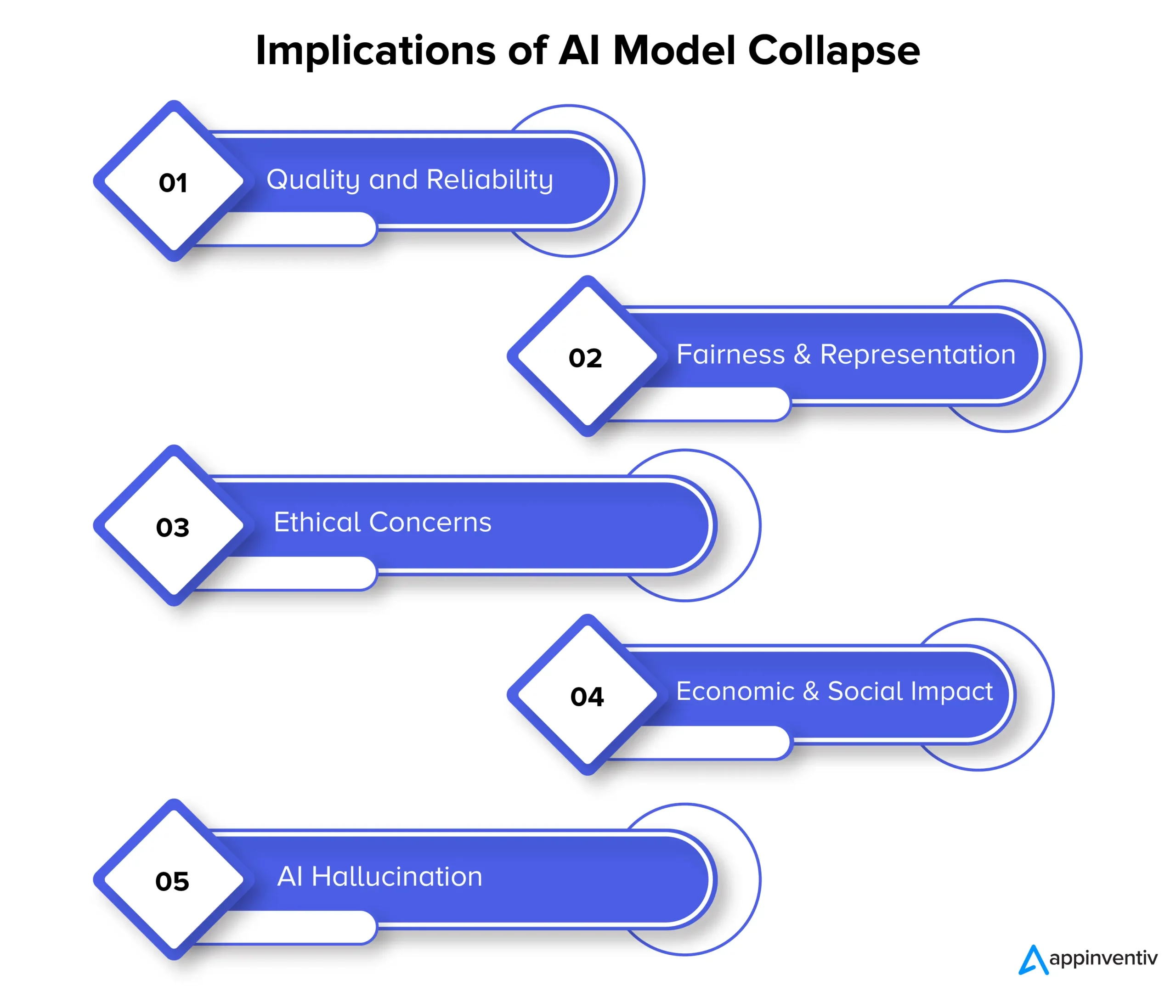

Modelin çökmesi sonuçta yapay zeka tarafından oluşturulan içeriğin kalitesini, güvenilirliğini ve adilliğini etkileyebilir ve bu da kuruluşlar için çeşitli riskler oluşturabilir. Aşağıda model çöküşünün sonuçlarına ayrıntılı olarak bakalım:

Kalite ve Güvenilirlik

Yapay zeka modelleri öğrenme süreçlerinde bozulma yaşadıkça ürettikleri içerik daha az güvenilir hale geliyor ve kaliteleri düşüyor. Bu durum, modeller orijinal veri dağıtımından ayrılıp kendi gerçeklik yorumlarına daha fazla dayandığında meydana gelir. Örneğin, haber üretimi için tasarlanmış bir yapay zeka modeli, hatalı ve hatta tamamen uydurma haber makaleleri üretebilir.

Adillik ve Temsil

Modelin çöküşü, oluşturulan içeriğin adaleti ve temsili açısından da endişe kaynağıdır. Modeller nadir olayları unutup üretken yeteneklerini sınırladığında, daha az yaygın konularla ilgili içerik yetersiz şekilde temsil edilebilir. Bu durum önyargılara, stereotiplere ve belirli bakış açılarının dışlanmasına yol açmaktadır.

Etik kaygılar

Modelin çöküşü, özellikle yapay zeka tarafından oluşturulan içeriğin karar almayı etkileme gücüne sahip olduğu durumlarda, önemli etik kaygılar doğurur. Modelin çöküşünün sonuçları arasında, insanların hayatlarını, fikirlerini ve fırsatlara erişimini önemli ölçüde etkileyebilecek önyargılı ve yanlış içeriğin yayılması yer alıyor.

Ekonomik ve Sosyal Etki

Ekonomik ve sosyal ölçekte, modelin çöküşü güveni ve yapay zeka teknolojilerinin benimsenmesini etkileyebilir. Yapay zeka tarafından oluşturulan içeriğe güvenilmezse işletmeler ve tüketiciler bu teknolojileri benimsemekte tereddüt edebilir. Bunun ekonomik sonuçları olabilir ve yapay zeka teknolojilerine duyulan güven sonuç olarak engellenebilir.

Yapay Zeka Halüsinasyonu

Yapay zeka halüsinasyonu, yapay zeka modellerinin gerçeklerle uyuşmayan veya hiçbir şekilde tutarlı olmayan, yaratıcı veya gerçekçi olmayan içerikler oluşturmasıdır. Bu, yanlış bilgilere yol açabilir ve potansiyel olarak yanlış bilgiye veya kafa karışıklığına neden olabilir. Doğruluk ve güvenilirliğin son derece hayati olduğu haber üretme, tıbbi durumları teşhis etme veya yasal belgeler oluşturma gibi uygulamalarda oldukça sorunludur.

Bağlamı bir yapay zeka halüsinasyonu örneğiyle açıklayalım. Hayvan resimleri oluşturmak üzere eğitilmiş bir yapay zeka modelinin olduğunu varsayalım. Artık bir hayvan resmi istendiğinde model, zebra ile at melezi bir "zebroid" resmi üretebiliyor. Bu görüntü görsel olarak gerçekçi görünse de gerçek dünyada böyle bir hayvan bulunmadığından bunun yalnızca yapay zeka modelinin hayal gücünün bir ürünü olduğunu anlamak hayati önem taşıyor.

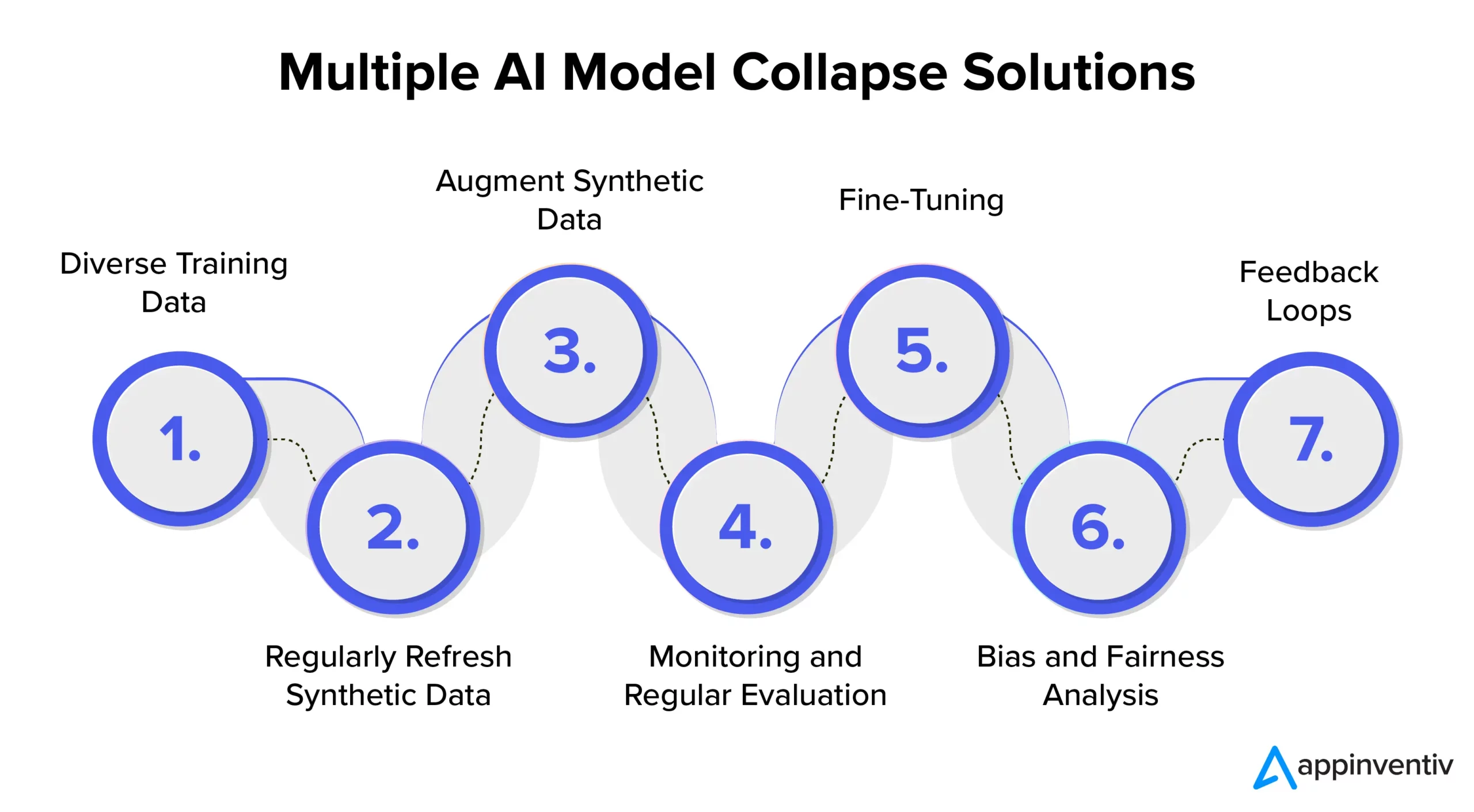

Yapay Zeka Modeli Çökmesini Önleme: Yapay Zeka Modeli Çökme Çözümlerini Anlamak

Yapay zeka modelinin istikrarını ve güvenilirliğini sağlamak için, yapay zeka modelinin çökmesini önlemeyi etkili bir şekilde ele almaya yönelik stratejileri ve en iyi uygulamaları araştırmak önemlidir. Bu nedenle, yapay zeka sistemlerinizin sürekli olarak yüksek kaliteli sonuçlar vermesini sağlarken bu önleyici önlemlerin uygulanmasında uzmanlık ve rehberlik sağlayabilecek Appinventiv gibi özel bir yapay zeka geliştirme firmasıyla ortaklık kurmanız önerilir.

Çeşitli Eğitim Verileri

Yapay zeka modelinin çöküşünü etkili bir şekilde ele almak ve istenmeyen çıktıları önlemek için çeşitli veri kaynakları ve türlerini içeren bir eğitim veri kümesinin düzenlenmesi çok önemlidir. Bu veri kümesi hem model tarafından oluşturulan sentetik verilerden hem de sorunun karmaşıklığını doğru bir şekilde temsil eden gerçek dünya verilerinden oluşmalıdır. Bu veri kümesini yeni ve ilgili bilgilerle düzenli olarak güncellemek önemlidir. Model, çeşitli eğitim verilerinin dahil edilmesiyle çok çeşitli modellere maruz bırakılır. Bu, veri durgunluğunun önlenmesine yardımcı olur.

Sentetik Verileri Düzenli Olarak Yenileyin

Yapay zeka modelleri büyük ölçüde kendi oluşturdukları verilere dayandığında modelin çökmesi bir risktir. Yapay zekada riskin etkili bir şekilde azaltılması için yeni, orijinal, gerçek dünya verilerinin eğitim hattına düzenli olarak dahil edilmesi önemlidir. Bu uygulama, modelin uyarlanabilir kalmasını sağlar ve tekrarlanan bir döngüde sıkışıp kalmayı önler. Bu, çeşitli ve ilgili çıktıların üretilmesine yardımcı olabilir.

Sentetik Verileri Artırma

Veri artırma teknikleriyle sentetik verilerin geliştirilmesi, modelin çökmesini önleme konusunda kanıtlanmış bir yöntemdir. Bu teknikler, gerçek dünya verilerindeki doğal varyasyonları kullanarak sentetik verilere değişkenlik katar. Oluşturulan verilere kontrollü gürültü eklemek, modelin daha geniş bir kalıp yelpazesini öğrenmesini teşvik ederek tekrarlayan çıktılar üretme şansını azaltır.

İzleme ve Düzenli Değerlendirme

Yapay zeka modeli performansının düzenli olarak izlenmesi ve değerlendirilmesi, model çöküşünün erken tespiti açısından çok önemlidir. Bir MLOps çerçevesinin uygulanması, sürekli izlemeyi ve bir kuruluşun hedefleriyle uyumlaşmayı sağlar, böylece zamanında müdahalelere ve ayarlamalara olanak tanır.

[Ayrıca Okuyun: Yapay Zeka Ürünleri Geliştirilirken Uyumluluk İhlallerinden Nasıl Kaçınılır]

İnce ayar

Model stabilitesini korumak ve çökmeyi önlemek için ince ayar stratejilerinin uygulanmasının dikkate alınması önemlidir. Yapay zeka modelinin başarısızlığını önlemeye yönelik bu stratejiler, modelin önceki bilgilerini korurken yeni verilere uyum sağlamasına olanak tanır.

Önyargı ve Adillik Analizi

Modelin çökmesini ve etik sorunları önlemede titiz önyargı ve adalet analizi çok önemlidir. Modelin çıktılarındaki önyargıları tanımlamak ve ele almak önemlidir. Bu endişeleri aktif bir şekilde ele alarak güvenilir ve tarafsız model çıktılarını koruyabilirsiniz.

Geribildirim döngüleri

Kullanıcı geri bildirimlerini içeren geri bildirim döngülerinin uygulanması, modelin çökmesini önlemede çok önemlidir. Kullanıcı içgörülerini tutarlı bir şekilde toplayarak modelin çıktılarında bilinçli ayarlamalar yapılabilir. Bu iyileştirme süreci, modelin ilgili, güvenilir ve kullanıcı beklentileriyle uyumlu kalmasını garanti eder.

Appinventiv Yapay Zeka Modellerinde Risk Azaltma Konusunda Nasıl Yardımcı Olabilir?

Yapay zekanın gelişen ortamında, model çöküşünün yarattığı zorluklar hem teknoloji devleri hem de yenilikçiler için endişe kaynağı olmuştur. Dil modeli veri kümelerinin uzun vadede bozulması ve içeriğin manipülasyonu bu dijital ekosisteme damgasını vurdu.

Yapay zeka ilerledikçe, yapay olarak oluşturulan veriler ile insan tarafından oluşturulan içerik arasında ayrım yapmak hayati önem taşıyor. Gerçek içerik ile makine tarafından üretilenler arasındaki çizgi giderek bulanıklaşıyor.

Şimdi, bu zorlukların ortasında ve yapay zeka modelinin başarısızlığını önlerken, Appinventiv gibi özel bir yapay zeka geliştirme şirketiyle ortaklık yapmak size çok ihtiyaç duyduğunuz teselliyi sağlayabilir. Yapay zeka modeli geliştirmedeki uzmanlığımız ve etik yapay zeka uygulamalarına olan özel bağlılığımızla, yapay zeka sistemlerinizin güvenilirliğini ve bütünlüğünü sağlarken yapay zekanın karmaşıklıklarında gezinmenize yardımcı olabiliriz.

Uzmanlarımız yapay zeka modelinin çökmesini önleme konusunu etkili bir şekilde ele almak, şeffaflığı teşvik etmek ve insan tarafından oluşturulan içeriğin orijinalliğinden ödün vermeyen özgün içerikle bir gelecek inşa etmek için sizinle birlikte çalışabilir.

Yapay zeka modellerini yeni ve çeşitli verilerle eğitmenin, model bozulmasını önlemek için gerekli olduğunu anlıyoruz. Yapay zeka modeli değerlendirmesi, performansı değerlendirmek, zayıf yönleri belirlemek ve geleceğe yönelik etkili tahminler sağlamak için ölçümler kullanan model geliştirme sürecimizde önemli bir adımdır.

Uzman ekibimiz, yapay zeka sistemlerinizin öğrenmeye ve gelişen dijital ortama uyum sağlamaya devam etmesini sağlamaya yardımcı olabilir. Model çökmesiyle ilişkili riskleri azaltmak ve bunların etkinliğini sağlamak için uzmanlarımızla iletişime geçin.

SSS

S. Yapay zeka modelinin çöküşü nedir?

A. Makine öğreniminde Yapay Zeka Modelinin çöküşü, yapay zeka modelinin çeşitli yararlı çıktılar üretmedeki başarısızlığını ifade eder. Bunun yerine tekrarlayan veya düşük kaliteli sonuçlar üretir. Bu sorun farklı model türlerinde ortaya çıkabilir, ancak özellikle üretken çekişmeli ağlar (GAN'ler) gibi karmaşık modellerin eğitimi sırasında gözlemlenir.

S. Yapay zeka modelinin çökmesinin yaygın nedenleri nelerdir?

C. Yapay zeka modelinin çökmesinin yaygın nedenleri arasında nadir olayların kaybı, önyargıların artması, üretken yeteneklerin daralması, işlevsel yaklaşım hataları vb. yer alır. Bu faktörler, modellerin optimal olmayan çıktılar üretmesine yol açabilir.

S. Yapay zeka modelinin çökmesini nasıl önleyebilirim?

C. Yapay zeka modelinin çökmesinin etkili bir şekilde önlenmesi için, farklı ve gerçek dünyaya benzer eğitim verilerinin kullanılması, verilerin sürekli olarak izlenmesi ve değerlendirilmesi, önyargıların düzeltilmesi ve sıkı test ve kalite kontrolün uygulanması hayati öneme sahiptir. Appinventiv'deki yapay zeka uzmanlarıyla ortaklık kurmak, model çökme risklerini azaltmak için size değerli bilgiler ve çözümler sunabilir.