Sorumlu Yapay Zeka – Benimseme Zorluklarının Yol Gösterici İlkeler ve Stratejilerle Ele Alınması

Yayınlanan: 2023-09-08Yapay zeka çözümlerinin yaygın olarak benimsendiği bir çağda, güvenlik ve etik ilkelere bağlı kalarak sorumlu bir geliştirme sürecine öncelik vermek oldukça hayati hale geldi. Bu yapay zeka sistemlerinin yetenekleri büyümeye ve çeşitli endüstriyel alanlarda uygulamalar bulmaya devam ettikçe, bunların oluşturulmasının sıkı güvenlik önlemleriyle uyumlu olmasını sağlamak kuruluşun en önemli önceliklerinden biri olmalıdır.

Peki yapay zeka tabanlı sistemlerinin etik olduğundan ve istenmeyen sonuçlara neden olmayacağından nasıl emin olunabilir? Bu bilmecenin basit cevabı Sorumlu Yapay Zeka ilkelerine bağlılıktır.

Sorumlu Yapay Zeka (RAI), yapay zekada etik kaygıların ve toplumsal refahın merkezde yer aldığı kapsamlı bir çerçeveyi ifade eder. Temel ilkelerle uyum sağlayacak şekilde tasarlanmış yapay zeka sistemlerinin sorumlu bir şekilde geliştirilmesini ve uygulanmasını sağlar.

Sorumlu Yapay Zeka İlkeleri, kuruluşların şeffaflığa güçlü bir şekilde odaklanmasına olanak tanıyarak kullanıcıların ve paydaşların yapay zeka sistemlerinin iç işleyişini anlamalarını sağlar. Bu şeffaflık, artan güven ve hesap verebilirliğin önünü açarak bireylerin yapay zeka kararlarının nasıl alındığını anlamalarına olanak tanır. RAI ayrıca, sonuçların tarafsız ve önyargısız olmasını sağlamak için verileri akıllıca yöneterek ve adalet önlemlerini dahil ederek yapay zeka algoritmaları içindeki önyargıyı aktif olarak ele alır.

Bu blog, beş sorumlu yapay zeka ilkesini ve bunlara bağlı kalmanın yapay zeka sisteminizi kullanıcılar için nasıl adil ve adil hale getirebileceğini anlamanıza yardımcı olacaktır. İşletmeler için sorumlu yapay zekayı benimsemenin yararlarına bakmanın yanı sıra, basitleştirilmiş yaklaşımı benimseyerek üstesinden gelinebilecek çeşitli zorlukları anlamanıza da yardımcı olacağız.

Sorumlu Yapay Zeka Stratejilerini Benimseme İhtiyacı: Yapay Zeka Risklerini Azaltma

Mart 2016'da Microsoft, Twitter'da Tay adında bir AI sohbet robotu başlattı. Tay'ın amacı kullanıcılarla olan etkileşimlerinden bir şeyler öğrenmekti. Ne yazık ki bazı kişiler botta saldırgan içerik yayınlamaya başladı ve bu da Tay'ın saldırgan bir dille yanıt vermesine neden oldu. Tay, birkaç saat içinde nefret söylemini ve ayrımcılığı teşvik eden bir bota dönüştü. Microsoft, Tay'ı hızla çevrimdışına aldı ve botun uygunsuz tweet'leri için özür diledi. Bu olay yapay zekanın nasıl yanlış gidebileceğinin açık bir örneği ve o zamandan bu yana pek çok benzer vaka yaşandı.

Yapay zeka, topluma fayda sağlama konusunda muazzam bir potansiyele sahip ancak Ben Amca'nın belirttiği gibi, "Büyük güç, büyük sorumluluğu beraberinde getirir."

Hassas verileri içeren önemli iş kararları için yapay zekayı kullandığınızda şunları bilmeniz çok önemlidir:

- Yapay zeka ne yapıyor ve neden?

- Doğru ve adil seçimler mi yapıyor?

- İnsanların mahremiyetine saygı mı var?

- Bu güçlü teknolojiyi kontrol edip gözetleyebilir misiniz?

Dünyanın dört bir yanındaki kuruluşlar Sorumlu Yapay Zeka stratejilerinin öneminin farkına varıyor ancak bunu benimseme yolculuklarında farklı noktalardalar. Sorumlu Yapay Zeka (RAI) ilkelerini benimsemek, yapay zeka ile ilişkili riskleri azaltmak için en etkili stratejidir.

Bu nedenle mevcut uygulamalarınızı değerlendirmenin ve verilerin sorumlu ve etik bir şekilde kullanıldığından emin olmanın zamanı geldi. RAI'nin erken benimsenmesi yalnızca uygulamalarla ilgili riskleri azaltmakla kalmayacak, aynı zamanda kuruluşları rakiplerin önünde konumlandıracak ve onlara gelecekte aşılması zor olabilecek bir rekabet avantajı sağlayacaktır.

MIT Sloan Anketine göre şirketlerin %52'si sorumlu yapay zeka uygulamalarına yönelik adımlar atıyor. Ancak bu şirketlerin %79'undan fazlası çalışmalarının ölçek ve kapsam açısından sınırlı olduğunu kabul ediyor. Rapor, yapay zekanın şirketlerdeki rolü artmaya devam ederken, işletmelerin zorlukların üstesinden gelmesinin ve Sorumlu Yapay Zeka'ya (RAI) öncelik vermesinin artan önemini vurguluyor. Sürdürülebilir ve sorumlu bir yapay zeka destekli geleceği şekillendirmek için sağlam bir etik çerçeve oluşturmak yalnızca bir seçim değil aynı zamanda şarttır.

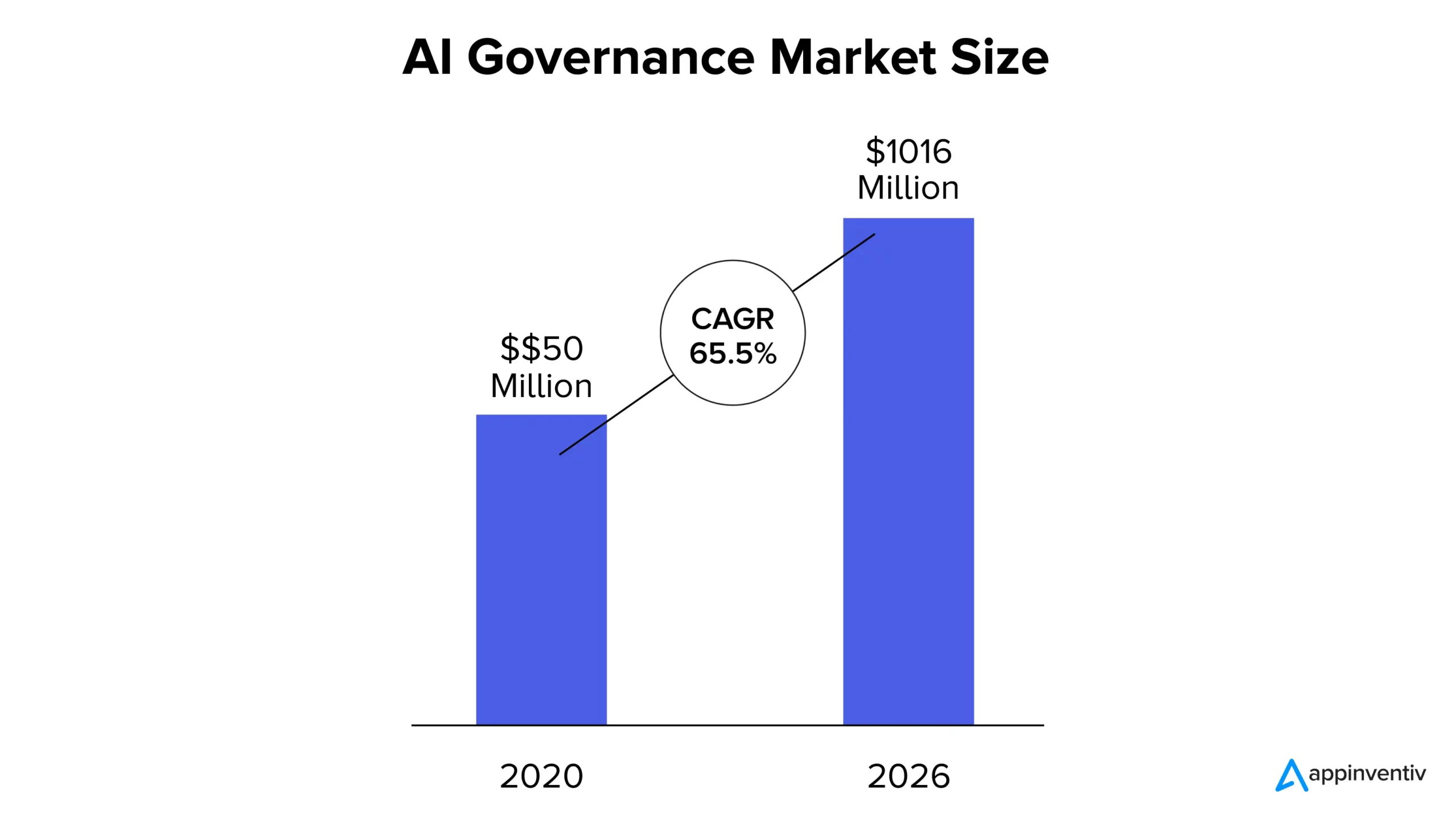

MarketsandMarkets raporuna göre, yapay zeka yönetişim pazarının değeri 2020 yılında 50 milyon dolar olarak belirlendi ve 2026 yılına kadar %65,5'lik bir Bileşik Büyüme Oranı ile 1.016 milyon dolara ulaşması bekleniyor. Artan pazar payı, yapay zeka sistemlerinde şeffaflığın artan büyümesine, düzenleyici uyumluluklara bağlı kalınmasına ve yapay zeka tabanlı çözümlere duyulan güven ihtiyacının artmasına bağlanabilir.

Sorumlu Yapay Zeka İlkeleri Nelerdir?

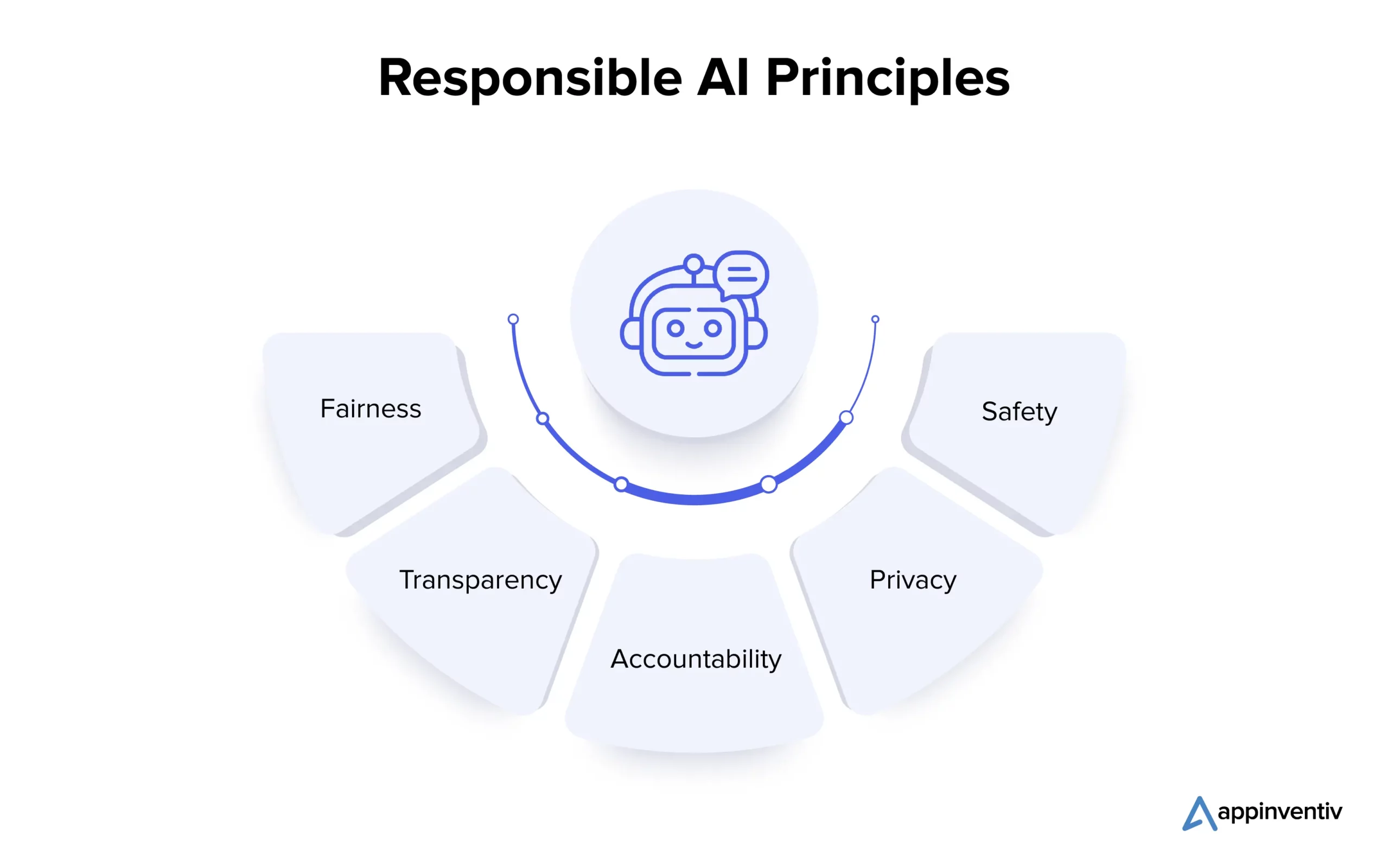

Sorumlu Yapay Zeka'nın temel ilkelerini anlamak, karmaşık Yapay Zeka ortamında etik olarak ilerlemek isteyen kuruluşlar için hayati öneme sahiptir. Aşağıda birden fazla ilkeye ayrıntılı olarak bakalım:

1. Adillik

Yapay zekada adalet, yapay zeka sistemlerindeki önyargıları ele alan temel bir ilkedir. Algoritma oluşturma sırasında veya yanlış sunulan eğitim verileri nedeniyle önyargılar meydana gelebilir. Veri bilimcileri, önyargıyı tespit etmek ve düzeltmek için veri analizi gibi teknikler kullanarak yapay zeka sistemlerinin tarafsız kararlar almasını ve eşit sonuçları teşvik etmesini sağlar.

2. Şeffaflık

Yapay zekada şeffaflık, geliştirilmesinde ve devreye alınmasında atılan adımların belgelenmesini ve açıklanmasını, böylece paydaşlar için anlaşılır olmasını içerir. Yorumlanabilir makine öğrenimi gibi teknikler, yapay zeka kararlarının ardındaki mantığı ortaya koyarken insan gözetimi, etik uyum ve haklılık sağlar.

3. Sorumluluk

Hesap verebilirlik şeffaflıkla yakından bağlantılıdır ve yapay zeka geliştiricilerini ve kullanıcılarını yapay zeka sistemlerinin sonuçları ve etkilerinden sorumlu tutacak mekanizmaların oluşturulmasını kapsar. Bu, etik kuralların uygulanmasını, izleme araçlarının kullanımını ve yürütülen denetimi içerir. Bu önlemler, yapay zeka sistemlerinin istenen sonuçları vermesini, istenmeyen zararları önlemesini ve güvenilirliği sürdürmesini sağlar.

4. Gizlilik

Gizlilik, bireylerin kişisel bilgilerinin korunması açısından çok önemlidir. Yapay zeka ekosistemi, veri toplama için izin almayı, yalnızca gerekli verileri toplamayı ve bunları yalnızca amaçlanan amaçlarla kullanmayı içerir. Yapay zeka modelinin geliştirilmesi ve üretilmesi sırasında kişisel verileri korumak için diferansiyel gizlilik ve kriptografik teknikler gibi gizliliği koruyan teknikler kullanılır.

5. Güvenlik

Geliştiriciler, fiziksel ve fiziksel olmayan sağlık da dahil olmak üzere sorumlu yapay zekada güvenliğe öncelik vermelidir. Bunu başarmak için güvenlik hususlarının yapay zeka sistemi geliştirmenin her aşamasına entegre edilmesi gerekir. Tasarım aşamasında potansiyel riskleri belirlemek ve anlamak için çeşitli paydaşların katılımını sağlamak çok önemlidir. Yapay zeka sistemlerinde zararın önlenmesi ve güvenilirliğin sürdürülmesi için risk değerlendirmeleri, farklı koşullar altında testler, insan gözetimi ve üretim sırasında sürekli izleme ve iyileştirme esastır.

Sorumlu Yapay Zekanın çeşitli ilkelerine göz attıktan sonra, devam edelim ve çözümün benimsenmesiyle ilgili zorlukları anlayalım.

Sorumlu Yapay Zeka Çözümlerini Benimsemedeki Zorluklar Nelerdir?

Sorumlu yapay zekayı benimsemek, işletmeler için büyük ödülleri olan umut verici bir yolculuktur, ancak kritik zorluklar dikkatli değerlendirme ve proaktif çözümler gerektirir. Aşağıda bunlara ayrıntılı olarak bakalım:

Açıklanabilirlik ve Şeffaflık

Yapay zeka sistemleri, güveni sürdürmek için nasıl ve neden belirli sonuçları ürettiklerini açıklığa kavuşturabilmelidir. Şeffaflığın olmaması bu sistemlere olan güveni azaltabilir.

Kişisel ve Kamu Güvenliği

Kendi kendine giden arabalar ve robotlar gibi otonom sistemler insan güvenliği açısından risk oluşturabilir. Bu tür bağlamlarda insanın refahını sağlamak çok önemlidir.

Otomasyon ve İnsan Kontrolü

Yapay zeka üretkenliği artırabilirken insan katılımını ve uzmanlığını azaltabilir. İnsan kontrolünü ve gözetimini sağlamak için denge kurmak zorlu bir iştir.

Önyargı ve Ayrımcılık

Yapay zeka sistemleri tarafsız olacak şekilde tasarlanmış olsa da eğitim verilerinden önyargılar devralabilir ve bu da potansiyel olarak istenmeyen ayrımcılığa yol açabilir. Bu tür önyargıların önlenmesi hayati önem taşıyor.

Sorumluluk ve Düzenleme

Yapay zekanın genel varlığının artmasıyla birlikte sorumluluk ve yükümlülük soruları ortaya çıkabilir. Yapay zeka sisteminin kullanımı ve kötüye kullanımından kimin sorumlu olduğunu belirlemek karmaşıktır.

Güvenlik ve Gizlilik

Yapay zeka, veri gizliliği ve güvenlik ihlalleriyle ilgili endişeleri daha da artırabilecek kapsamlı veri erişimi gerektirir. Yapay zeka eğitimi için kullanılan verilerin korunması, bireyin genel gizliliğinin korunması açısından önemlidir.

Artık, geliştirme süreci sırasında Sorumlu Yapay Zeka ilkelerine bağlı kalan saygın bir Yapay Zeka uygulama geliştirme firmasıyla (Appinventiv gibi) ortaklık kurmak, işletmelerin ilgili zorlukları ve riskleri etkili bir şekilde azaltmalarına yardımcı olabilir.

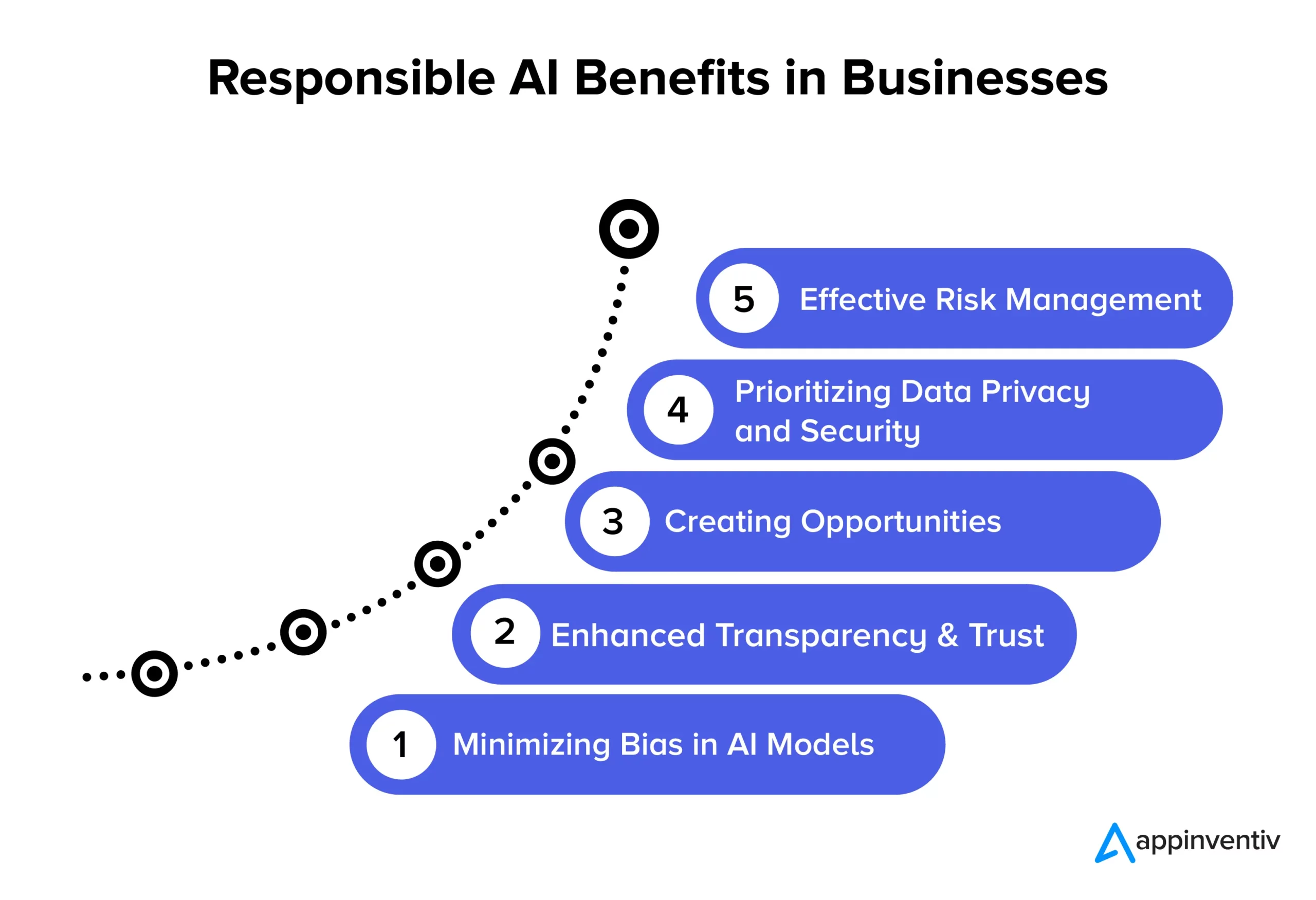

Sorumlu Yapay Zekanın İşletmeler İçin Faydaları

Sorumlu Yapay Zeka ilkelerini benimsemek, işletmeler ve toplum için çok sayıda önemli avantajın yolunu açıyor. Bunları aşağıda ayrıntılı olarak inceleyelim:

Yapay Zeka Modellerinde Önyargıyı En Aza İndirme

İşletmeler Sorumlu Yapay Zeka ilkelerine bağlı kalarak yapay zeka modellerindeki ve onları eğitmek için kullanılan temel verilerdeki önyargıları etkili bir şekilde azaltabilir. Önyargıdaki bu azalma, yapay zeka sistemlerinin etik açıdan doğru olan ve zaman içinde veri değişikliği riskini azaltan daha doğru ve adil sonuçlar sunmasını sağlar. Ayrıca önyargının en aza indirilmesi, kuruluşların önyargılı yapay zeka modeli sonuçlarından kaynaklanabilecek kullanıcılara yönelik potansiyel zararlardan kaçınmasına, itibarlarının artırılmasına ve sorumlulukların azaltılmasına yardımcı olur.

Gelişmiş Şeffaflık ve Güven

Sorumlu yapay zeka uygulamaları, yapay zeka modellerinin netliğini ve şeffaflığını artırır. Bu, işletmeler ve müşterileri arasındaki güvenin güçlendirilmesine yardımcı olur. Buna ek olarak, yapay zeka daha geniş bir kitle için daha erişilebilir ve anlaşılır hale geliyor, daha geniş bir uygulama yelpazesine olanak tanıyarak ve yapay zeka teknolojilerinin etkili kullanımını artırarak kuruluşlara ve son kullanıcılara fayda sağlıyor.

Fırsatlar Yaratmak

Sorumlu Yapay Zeka ilkelerine bağlı kalmak, geliştiricilere ve kullanıcılara yapay zeka sistemleri hakkında açık konuşmalar yapma gücü verir. İşletmelerde en çok aranan sorumlu yapay zeka faydalarından biridir. İnsanların yapay zeka teknolojisiyle ilgili sorularını ve endişelerini dile getirebilecekleri bir alan yaratarak işletmelerin bu sorunları proaktif bir şekilde ele almasına olanak tanıyor. Yapay zeka gelişimine yönelik bu işbirlikçi yaklaşım, bir şirketin itibarını ve rekabet gücünü artırabilecek etik açıdan sağlam ve sosyal açıdan sorumlu yapay zeka çözümlerinin yaratılmasıyla sonuçlanır.

Veri Gizliliği ve Güvenliğine Öncelik Verme

Sorumlu yapay zeka çözümleri, işletmelerin veri gizliliğini ve güvenliğini korumaya önemli ölçüde odaklanmasına olanak tanır. Bu, kişisel veya hassas verilerin dikkatle ele alındığı, bireylerin haklarının korunduğu ve veri ihlallerinin önlendiği anlamına gelir. İşletmeler Sorumlu Yapay Zeka ilkelerini takip ettiğinde verileri kötüye kullanma, düzenlemeleri ihlal etme ve itibarlarına zarar verme olasılığını azaltırlar. Verileri güvende tutmanın ve müşteri güvenini korumanın akıllı bir yoludur.

Etkin Risk Yönetimi

Sorumlu AI uygulamaları, AI sistemleri için zararlı sonuçların olasılığını azaltmaya yardımcı olan açık etik ve yasal kurallar belirler. Bu risk azaltımı işletmeler, çalışanlar ve toplum gibi birden fazla kuruluşa yarar sağlar. Kuruluşlar olası etik ve hukuki sorunları ele alırken pahalı davalardan kaçınabilir ve itibarlarına zarar verebilirler.

Başarılı Sorumlu Yapay Zeka Uygulama Örnekleri

Etik ve tarafsız yapay zeka uygulamalarına öncelik veren kuruluşların gerçek dünyadan dikkate değer birkaç örneğini burada bulabilirsiniz:

IBM'in Güvenilir Yapay Zeka İşe Alma Aracı

Büyük bir ABD şirketi, işe alım süreçlerini otomatikleştirmek ve yapay zeka destekli işe alım süreçlerinde adalete öncelik vermek için IBM ile işbirliği yaptı. Amaçları, makine öğrenimi modellerinin bütünlüğünü korurken çeşitliliği ve katılımı kolaylaştırmaktı. Bir yapay zeka izleme ve yönetim aracı olan IBM Watson Studio'yu kullanarak, işe alım önyargılarını başarılı bir şekilde belirleyip ele alırken, yapay zekayla karar alma sürecine ilişkin değerli bilgiler elde ettiler.

State Farm'ın Sorumlu Yapay Zeka Çerçevesi

ABD'nin önde gelen sigorta şirketlerinden biri olan State Farm, yapay zekayı hasar ele alma sürecine dahil etti ve sorumlu bir yapay zeka stratejisi uyguladı. Yapay zekaya sorumluluk atamak için bir yönetişim sistemi oluşturdular, bu da daha hızlı ve daha bilinçli karar alma olanağı sağladı. State Farm'ın Dinamik Araç Değerlendirme Modeli (DVAM) yapay zeka modeli, toplam kayıpları etkili bir şekilde tahmin eder ve sigorta taleplerinin işlenmesine şeffaflık getirir.

H&M Grubunun Sorumlu Yapay Zeka Ekibi ve Kontrol Listesi

Küresel bir moda perakendecisi olan H&M Group, sürdürülebilirliği artırmak, tedarik zincirlerini optimize etmek ve kişiselleştirilmiş müşteri deneyimlerini geliştirmek için yapay zekayı operasyonlarına entegre etti. Şirket, sorumlu yapay zeka kullanımını sağlamak için 2018 yılında özel bir Sorumlu Yapay Zeka Ekibi kurdu. Bu ekip, Yapay Zeka ile ilgili potansiyel zararları tanımlayan ve azaltan ve Sorumlu Yapay Zeka ilkelerine tüm kalbiyle bağlı kalan pratik bir kontrol listesi geliştirdi.

Google'ın Makine Öğreniminde Adilliği

Google ayrıca yapay zeka ve makine öğrenimine adalet önlemlerinin dahil edilmesi üzerinde de aktif olarak çalıştı. Geliştiricilerin makine öğrenimi modellerindeki önyargıları belirlemelerine ve azaltmalarına yardımcı olacak araçlar ve kaynaklar geliştirdiler.

OpenAI'nin GPT-3'ü

GPT-3'ün arkasındaki firma olan OpenAI, aynı zamanda yapay zeka dağıtımına sorumlu bir yaklaşım benimseme konusunda da önemli bir lider olmuştur. Gelişmiş NLP modellerinde bile etik yapay zekaya bağlılıklarını daha da kanıtlayan, zararlı ve önyargılı sonuçlardan kaçınmak için ince ayar mekanizmaları uyguladılar.

Appinventiv ile Sorumlu Yapay Zekanın Geleceği

Sorumlu Yapay Zekanın geleceği, teknoloji ve veri kullanımına ilişkin etik gelişimin farklı aşamalarındaki kuruluşlarla devam eden bir yolculuktur. Çeşitli endüstriler için standartlaştırılmış yönergeler oluşturmaya odaklanan dinamik bir alandır. İşletmeniz için Sorumlu Yapay Zeka ilkelerini takip etmek için Appinventiv ile ortaklık yapmak bir işletmenin yapabileceği en iyi seçimdir. İhtiyaçlarınıza uygun, etik, tarafsız ve doğru yapay zeka çözümleri oluşturmanıza yardımcı olabiliriz.

Özel bir yapay zeka geliştirme şirketi olan geliştiricilerimiz, etik ve sorumluluğa öncelik vererek yapay zeka çözümleri geliştirme konusunda uzun yıllara dayanan deneyime sahiptir. Çok sayıda endüstriyel alanı kapsayan başarılı yapay zeka projelerinin kanıtlanmış geçmişiyle, yapay zeka çözümlerini gerekli temel değerler ve etik ilkelerle uyumlu hale getirmenin önemini anlıyoruz. Yapay zeka tabanlı iş çözümlerinizin tarafsız kararlar almasını sağlamak için adalet önlemlerini uygulamanıza yardımcı olabiliriz.

Yakın zamanda hastaları hastane hemşireleriyle el hareketleri ve sesli komutlarla buluşturan yapay zeka tabanlı bir sağlık uygulaması olan YouComm'u geliştirdik. Çözüm şu anda ABD genelinde 5'ten fazla hastane zincirinde uygulanıyor.

Doğru sonuçlar veren ve etik standartlara uygun yapay zeka çözümleri oluşturmak için yapay zeka uzmanlarımızla iletişime geçin.

SSS

S. Sorumlu Yapay Zeka Örneklerinden Bazıları Nelerdir?

C. Birden fazla endüstriyel alandaki bazı Sorumlu Yapay Zeka örneklerini burada bulabilirsiniz:

- Adil Algoritmalar: Adil olacak şekilde tasarlanmış yapay zeka sistemleri, karar önyargılarını azaltır.

- Açıklanabilir Yapay Zeka (XAI): Yapay Zeka kararlarını anlaşılır kılmak.

- Önyargı Azaltma: Yapay zekadaki önyargıyı sürekli olarak izliyor ve azaltıyoruz.

- Yapay Zeka Etik Komiteleri: Etik yapay zeka için dahili inceleme kurullarının kurulması.

- Gizliliği Koruyan Yapay Zeka: Yapay zeka için kullanırken hassas verileri korur.

- Şeffaflık Raporları: Yapay zeka sistemlerinin nasıl çalıştığını ve karar verdiğini paylaşıyoruz.

- Sorumlu Yapay Zeka Eğitimi: Yapay zeka profesyonellerini etik ve sorumluluk konusunda eğitmek.

S. Başarılı Sorumlu Yapay Zeka kullanım örnekleri nelerdir?

C. İşte bazı başarılı Sorumlu Yapay Zeka kullanım örnekleri:

- Sağlık Hizmeti Teşhisleri: Tıbbi sonuçları adil bir şekilde ve hasta mahremiyetiyle geliştirmek için kullanılır.

- Finansal Hizmetler: Dolandırıcılık ve kötü amaçlı yazılımlarla ilişkili riskleri ortadan kaldırabilir. Sorumlu yapay zeka tabanlı çözümler, müşteri verilerini daha da koruyabilir ve adil kredilendirme sağlayabilir.

- İşe Alım: Kullanıcılar arasında çeşitliliğin ve fırsat eşitliğinin benimsenmesinin önünü açarken önyargının azaltılmasına yardımcı olur.

- Otonom Araçlar: Güvenliğin ön planda tutulmasına ve etik standartlara bağlı kalınmasına yardımcı olur.

S. Sorumlu Yapay Zeka devam eden bir süreç midir, yoksa işletmeler bunu bir kez uygulayıp unutabilir mi?

A. Sorumlu yapay zeka, sürekli izlemeyi, güncellemeyi ve değişen etik standartlar ve düzenlemelere uyum sağlamayı gerektiren devam eden bir süreçtir. Bu nedenle, suları dikkatli bir şekilde geçmenize yardımcı olabilecek özel bir yapay zeka geliştirme firmasıyla ortaklık kurmanız tavsiye edilir.