有偏见的广告的商业影响(以及如何解决它)

已发表: 2022-10-29我们都有偏见,好的和坏的,其中许多态度是无意识的,即使它们告诉甚至决定我们做什么。 但是,当这些无意识的偏见渗透到营销中时会发生什么?

有几种方法可以发生这种情况; 最著名的是广告活动中的实际信息传递和创意,无论是摄影缺乏多样性,还是缺乏对特定词语或措辞的文化敏感性意识。 但无意识的偏见也在我们用来开展这些活动的技术中发挥作用。

这种影响可能是隐蔽的,并且经常被忽视,但广告偏见会对您的业务产生重大的负面影响,从品牌健康到未能实现扩大新受众的机会。 从长远来看,这些偏见会在更广阔的世界中延续某些刻板印象,并对人们造成重大伤害。

为确保您的品牌不会意外落入偏见陷阱,您需要了解偏见来自何处、它如何影响广告,以及您可以采取哪些步骤来创建更具包容性的活动,以反映和与更广泛的受众交流。

什么是营销中的无意识偏见?

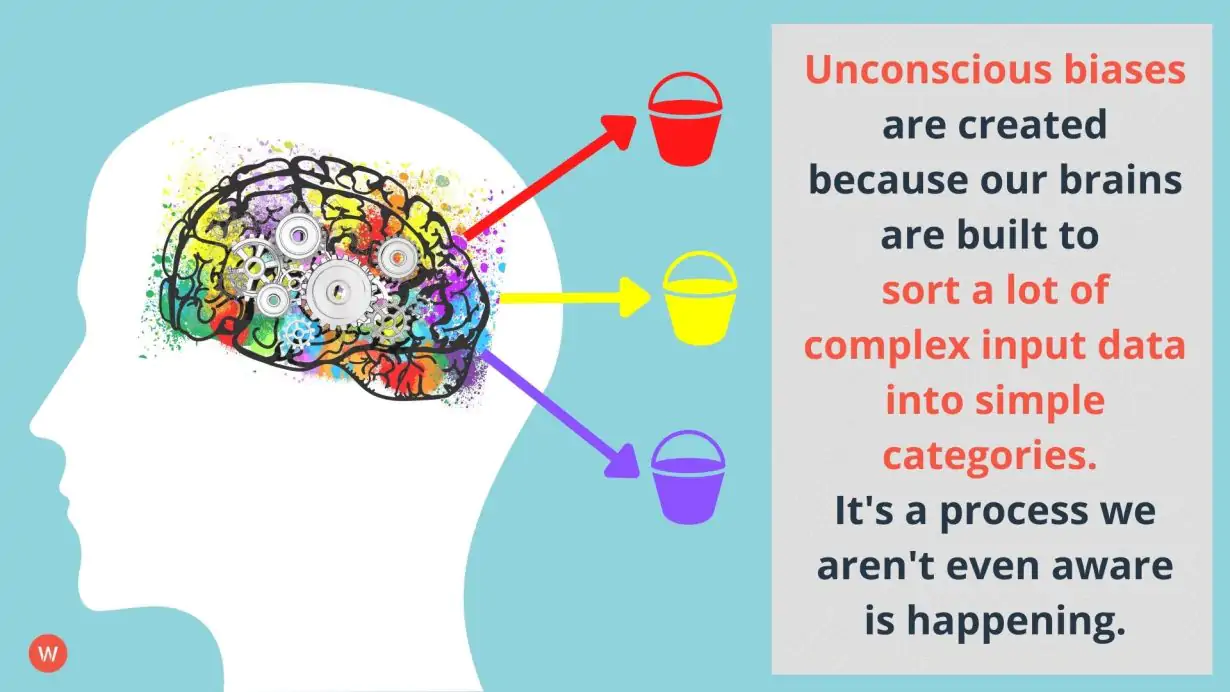

无意识偏见或隐性偏见被定义为人们基于年龄、社会经济地位、体重、性别、种族或性取向等各种因素在不知不觉中做出的各种社会刻板印象和判断。

我们的大多数行为都是在没有有意识地思考的情况下发生的; 这就是我们每天如何做出数以百万计的决定才能正常生活的方式。 但是因为这个过程非常依赖于我们的大脑做出很多我们可能没有意识到的判断,所以无意识的偏见会对我们的行为和行为产生巨大的影响。

这些偏见源于终生接触文化态度、规范、传统和其他影响我们如何看待性别、种族、年龄、民族、宗教、经济阶层、性取向、残疾和国籍(以及其他群体)的因素。特征)。 这就是为什么它们很难识别、挑战或解决。

在营销中,这可以通过几种不同的方式表现出来:受众群体、人口统计决策、信息传递、摄影、文化典故等等。 广告偏见仅仅意味着我们依靠无意识的假设来决定我们的品牌向谁营销,我们想说什么来吸引这些消费者等等。

营销人员通常希望纠正这些假设,但就像个人一样,他们并不总是意识到这些偏见是如何表现出来的,或者它们何时会影响策略。

有偏见的广告对业务有何影响?

识别和纠正无意识的偏见是营销团队职责的关键部分,因为这些假设的影响可能对您的业务和整个社会都非常有害。

在 IRI 和 SEEHer 使用 SEEHER 性别平等测量 (GEM) 的研究中,这是一种数据驱动的开源方法,可识别广告和节目中基于性别的偏见,结果是决定性的:销售提升最高的广告具有最高GEM 得分,而销售提升最低的广告的 GEM 得分最低。

资料来源:IRI & SEEHER

广告偏见仍然是一个问题的主要原因之一是,基于人口统计受众细分的活动可以为更个性化的广告提供捷径,从而推动短期业绩增长。

但长期影响是严重的,并有可能造成不可逆转的损害。 依赖与这些无意识偏见相关的广告将排除新受众,从而极大地限制您的品牌增长潜力,如果您在品牌创意和信息传递中依赖刻板印象,可能会对您的品牌形象造成重大损害。

广告中的无意识偏见是什么样的?

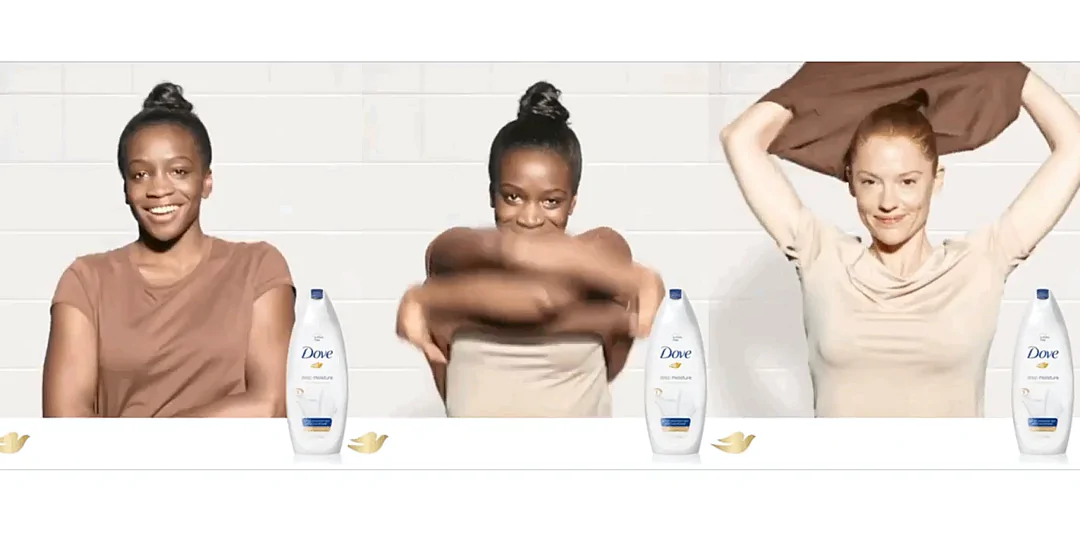

在一个特别令人震惊(和臭名昭著)的例子中,Dove 广受批评的广告活动中,一位黑人女性在使用 Dove 肥皂后变成了一位白人女性。 多芬在竞选活动中的定位完全是关于纯洁,这以广告创意中的白人为代表,这一想法立即被认定为公然的种族主义,即使是无意的。

资料来源:世界经济论坛

看一个这样的例子很容易,如果你的品牌从来没有做过如此可怕的事情,那么你就很清楚了。 但是无意识偏见在广告中所起的作用的例子无处不在,即使它们不那么明显。

想想您用于广告、网站、演示文稿等的图像。无论您是否意识到,您的摄影选择都会成为您业务的代表。 例如,如果你试图选择一张股票照片来代表专业,而你脑海中的画面是一群穿着西装的白人围在会议桌旁,那很可能是无意识偏见的结果。

营销人员在识别这种偏见方面已经做得更好了,尽管它仍然经常抬头(女人一边吃沙拉一边笑,有人吗?)。

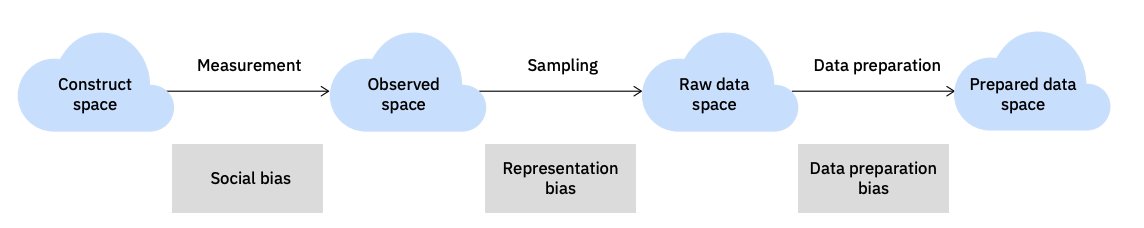

但下一个前沿是自动化,这也是我们刚刚开始了解无意识偏见对广告的影响的地方。 人工智能和广告定位等机器学习工具实际上可以强化负面偏见,部分原因是这些系统架构师的隐含偏见。 由于参数是使用数据段构建的,因此广告商正在为自动化系统打开闸门,以使负面刻板印象永久化。

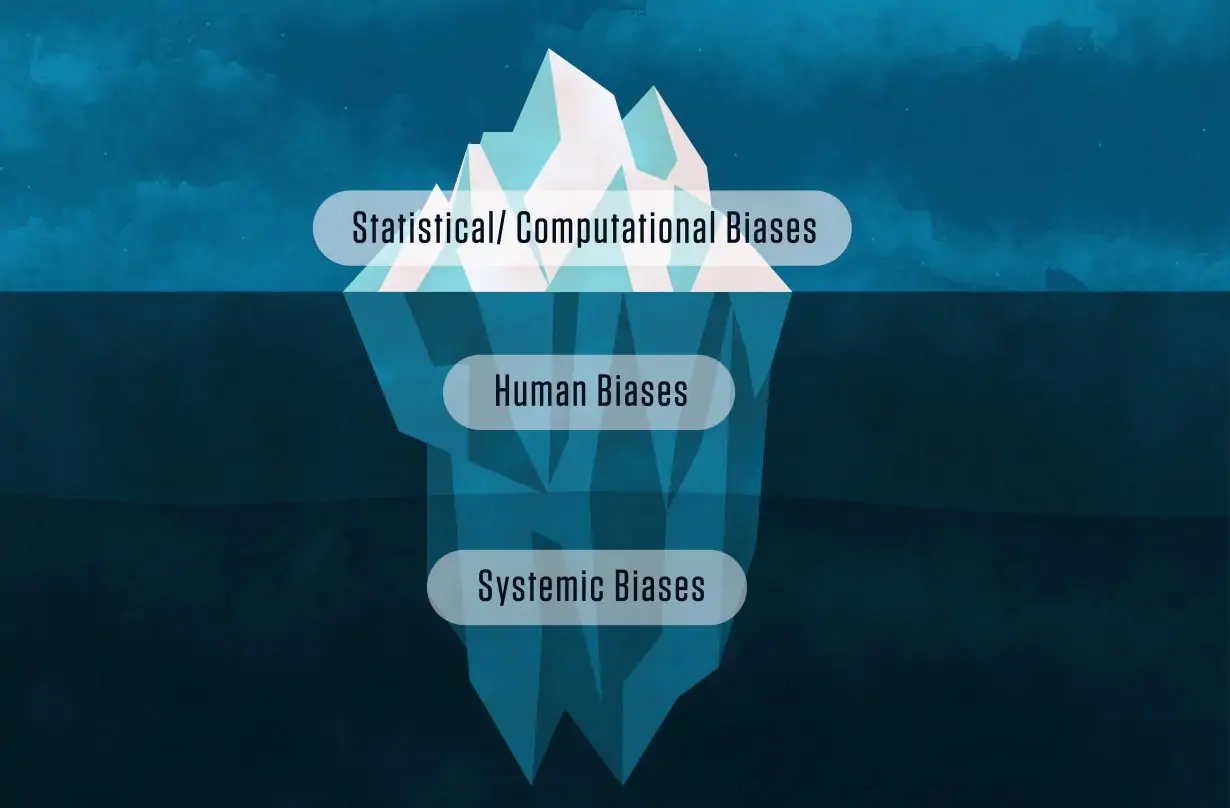

不同自动化过程产生的不同偏差

资料来源:Varshney,值得信赖的机器学习,2022

IBM Watson Advertising 于 2022 年 1 月根据 The Ad Council 的活动数据发布了新的研究结果,该数据明确表明,基于对倡导 COVID 疫苗接种的活动的不同投入的无意识偏见正在影响 AI 算法,该算法针对收入水平和政治等多个特征传播该活动信念。

“最重要的观察之一是:用于数字广告的数据和算法中可能存在偏见,而且人眼并不总是可以立即观察到这种偏见。”

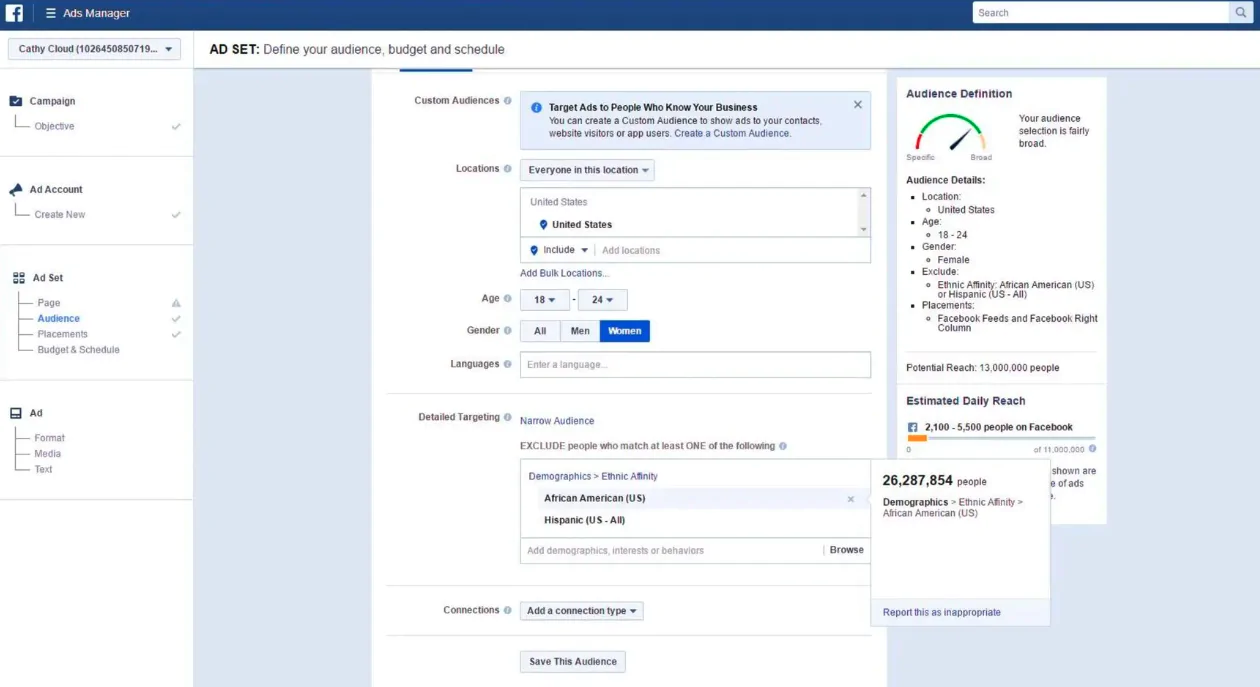

这不仅仅是理论上的; Facebook 最近与美国国家公平住房联盟 (NFHA) 和美国通信工作者 (CWA) 就 Facebook 广告平台上预先填充的列表达成和解,该列表允许广告商投放住房、就业和信贷广告,这些广告可能会排除非洲等受保护群体美国人、西班牙裔美国人和亚裔美国人。 有针对性的广告列表没有以同样的方式排除“白人”,这违反了要求以公平和平等的方式为受保护群体做广告的民权法。

资料来源:纽约时报

当人类认知偏差或数据偏差在不知不觉中被编码到系统中并大规模分布时,就会发生技术偏差。 这些无意识的偏见可能会成为系统性问题,复杂到可能无法检测到,尤其是在广告生态系统内的数据和信号交互中。

资料来源:美国国家标准与技术研究院 (NIST)

虽然可能很难发现广告、定位和消息传递中反映了哪些偏见,但营销团队有责任意识到这个问题,积极挑战我们的假设,并优先考虑寻找解决方案。

你如何打击有偏见的广告?

不管过去的广告活动有什么效果,现在是时候挺身而出,做出一些重大改变,以确保您的品牌采取包容性的方法并处理潜在的偏见。

当涉及到您的整体创作过程时,请确保您:

- 在流程的每个阶段,从最初的构思到执行再到测量,将不同的观点作为利益相关者带到桌面上

- 检查您的定位标准是否存在偏见,不要害怕根据算法决策提出有关输入和任何结果的问题

- 不要只是将多样性、公平和包容性 (DEI) 添加到您的创意过程中,与来自服务欠缺社区的观众一起工作,并将他们的观点带入与您的品牌的双向对话中

- 创建一个测试框架,通过向新受众和不同的信息和创意开放您的品牌来挑战您的一些假设

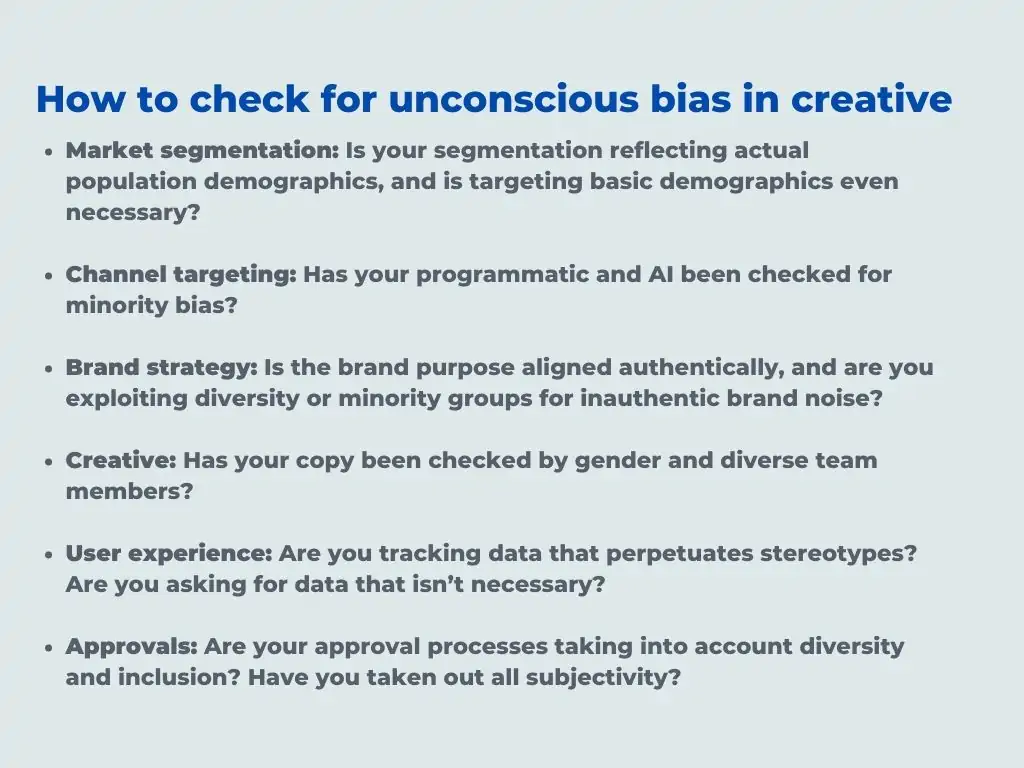

出版物 CMO 提出了一个有用的清单,您应该将其包括在您的创意质量控制中:

资料来源:首席营销官

当谈到算法偏差时,解决方案要复杂一些。 随着人工智能变得越来越复杂,该领域的专家呼吁提高不同模型和服务开发方式的透明度。

具有讽刺意味的是,技术往往是反驳和质疑我们建立的模型的答案,这些模型可能会产生这些有缺陷的、有偏见的结果。 查看这些旨在帮助发现和减轻广告中隐含偏见的工具:

- AI 公平性:这个开源工具包可以帮助用户在整个 AI 应用程序生命周期中检查、报告和减轻机器学习模型中的歧视和偏见。

- IBM Watson:通过扫描偏见,用于广告的人工智能可以帮助发现对人类隐藏的子群体之间的潜在联系,以便制定更好的策略来公平地解决每个群体的问题。

- IBM FactSheets:FactSheet 是有关创建和部署 AI 模型或服务的相关信息(事实)的集合。 FactSheet 项目的目标是通过提高透明度和加深对 AI 的创建和部署方式的理解来培养对 AI 的信任,从而对 AI 的使用方式进行一定程度的治理和控制。

今天的消费者对他们选择与之互动的品牌有更多期望。 为您的消费者提供优质的产品或服务已经不够了; 你的客户希望你把你的价值观放在首位。 随着消费者对广告的了解越来越多,请花时间对您向世界投放的内容进行直觉检查。