有偏見的廣告的商業影響(以及如何解決它)

已發表: 2022-10-29我們都有偏見,好的和壞的,其中許多態度是無意識的,即使它們告訴甚至決定我們做什麼。 但是,當這些無意識的偏見滲透到營銷中時會發生什麼?

有幾種方法可以發生這種情況; 最著名的是廣告活動中的實際信息傳遞和創意,無論是攝影缺乏多樣性,還是缺乏對特定詞語或措辭的文化敏感性意識。 但無意識的偏見也在我們用來開展這些活動的技術中發揮作用。

這種影響可能是隱蔽的,並且經常被忽視,但廣告偏見會對您的業務產生重大的負面影響,從品牌健康到未能實現擴大新受眾的機會。 從長遠來看,這些偏見會在更廣闊的世界中延續某些刻板印象,並對人們造成重大傷害。

為確保您的品牌不會意外落入偏見陷阱,您需要了解偏見來自何處、它如何影響廣告,以及您可以採取哪些步驟來創建更具包容性的活動,以反映和與更廣泛的受眾交流。

什麼是營銷中的無意識偏見?

無意識偏見或隱性偏見被定義為人們基於年齡、社會經濟地位、體重、性別、種族或性取向等各種因素在不知不覺中做出的各種社會刻板印象和判斷。

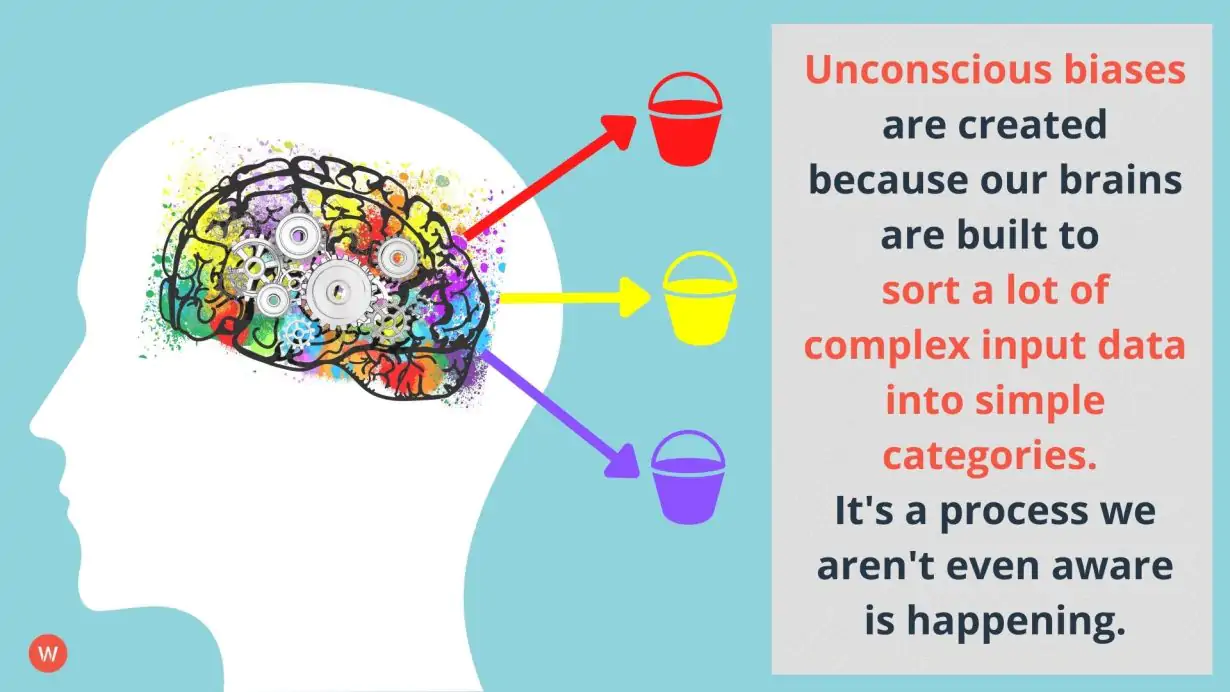

我們的大多數行為都是在沒有有意識地思考的情況下發生的; 這就是我們每天如何做出數以百萬計的決定才能正常生活的方式。 但是因為這個過程非常依賴於我們的大腦做出很多我們可能沒有意識到的判斷,所以無意識的偏見會對我們的行為和行為產生巨大的影響。

這些偏見源於終生接觸文化態度、規範、傳統和其他影響我們如何看待性別、種族、年齡、民族、宗教、經濟階層、性取向、殘疾和國籍(以及其他群體)的因素。特徵)。 這就是為什麼它們很難識別、挑戰或解決。

在營銷中,這可以通過幾種不同的方式表現出來:受眾群體、人口統計決策、信息傳遞、攝影、文化典故等等。 廣告偏見僅僅意味著我們依靠無意識的假設來決定我們的品牌向誰營銷,我們想說什麼來吸引這些消費者等等。

營銷人員通常希望糾正這些假設,但就像個人一樣,他們並不總是意識到這些偏見是如何表現出來的,或者它們何時會影響策略。

有偏見的廣告對業務有何影響?

識別和糾正無意識的偏見是營銷團隊職責的關鍵部分,因為這些假設的影響可能對您的業務和整個社會都非常有害。

在 IRI 和 SEEHer 使用 SEEHER 性別平等測量 (GEM) 的研究中,這是一種數據驅動的開源方法,可識別廣告和節目中基於性別的偏見,結果是決定性的:銷售提升最高的廣告具有最高GEM 得分,而銷售提升最低的廣告的 GEM 得分最低。

資料來源:IRI & SEEHER

廣告偏見仍然是一個問題的主要原因之一是,基於人口統計受眾細分的活動可以為更個性化的廣告提供捷徑,從而推動短期業績增長。

但長期影響是嚴重的,並有可能造成不可逆轉的損害。 依賴與這些無意識偏見相關的廣告將排除新受眾,從而極大地限制您的品牌增長潛力,如果您在品牌創意和信息傳遞中依賴刻板印象,可能會對您的品牌形象造成重大損害。

廣告中的無意識偏見是什麼樣的?

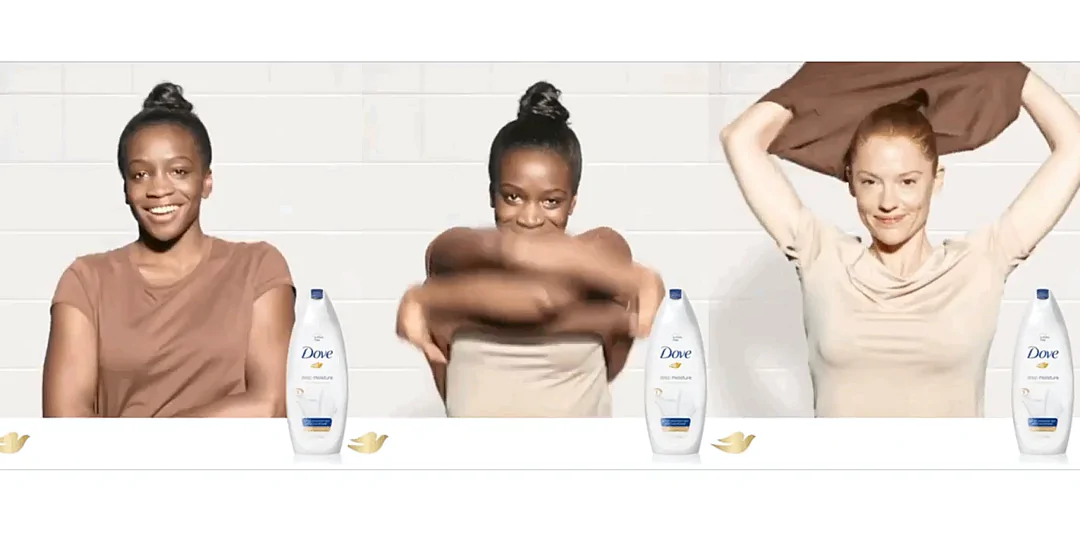

在一個特別令人震驚(和臭名昭著)的例子中,Dove 廣受批評的廣告活動中,一位黑人女性在使用 Dove 肥皂後變成了一位白人女性。 多芬在競選活動中的定位完全是關於純潔,這以廣告創意中的白人為代表,這一想法立即被認定為公然的種族主義,即使是無意的。

資料來源:世界經濟論壇

看一個這樣的例子很容易,如果你的品牌從來沒有做過如此可怕的事情,那麼你就很清楚了。 但是無意識偏見在廣告中所起的作用的例子無處不在,即使它們不那麼明顯。

想想您用於廣告、網站、演示文稿等的圖像。無論您是否意識到,您的攝影選擇都會成為您業務的代表。 例如,如果你試圖選擇一張股票照片來代表專業,而你腦海中的畫面是一群穿著西裝的白人圍在會議桌旁,那很可能是無意識偏見的結果。

營銷人員在識別這種偏見方面已經做得更好了,儘管它仍然經常抬頭(女人一邊吃沙拉一邊笑,有人嗎?)。

但下一個前沿是自動化,這也是我們剛剛開始了解無意識偏見對廣告的影響的地方。 人工智能和廣告定位等機器學習工具實際上可以強化負面偏見,部分原因是這些系統架構師的隱含偏見。 由於參數是使用數據段構建的,因此廣告商正在為自動化系統打開閘門,以使負面刻板印象永久化。

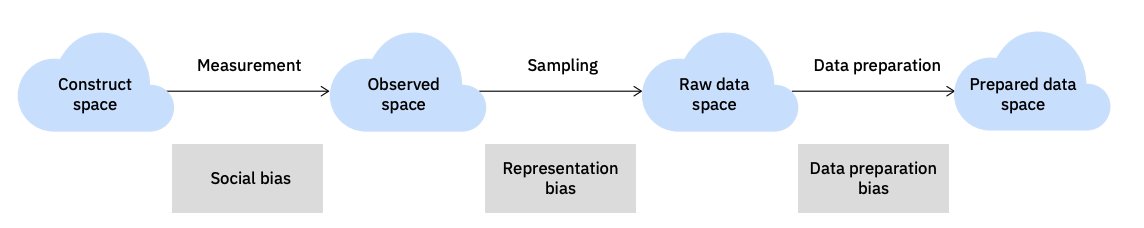

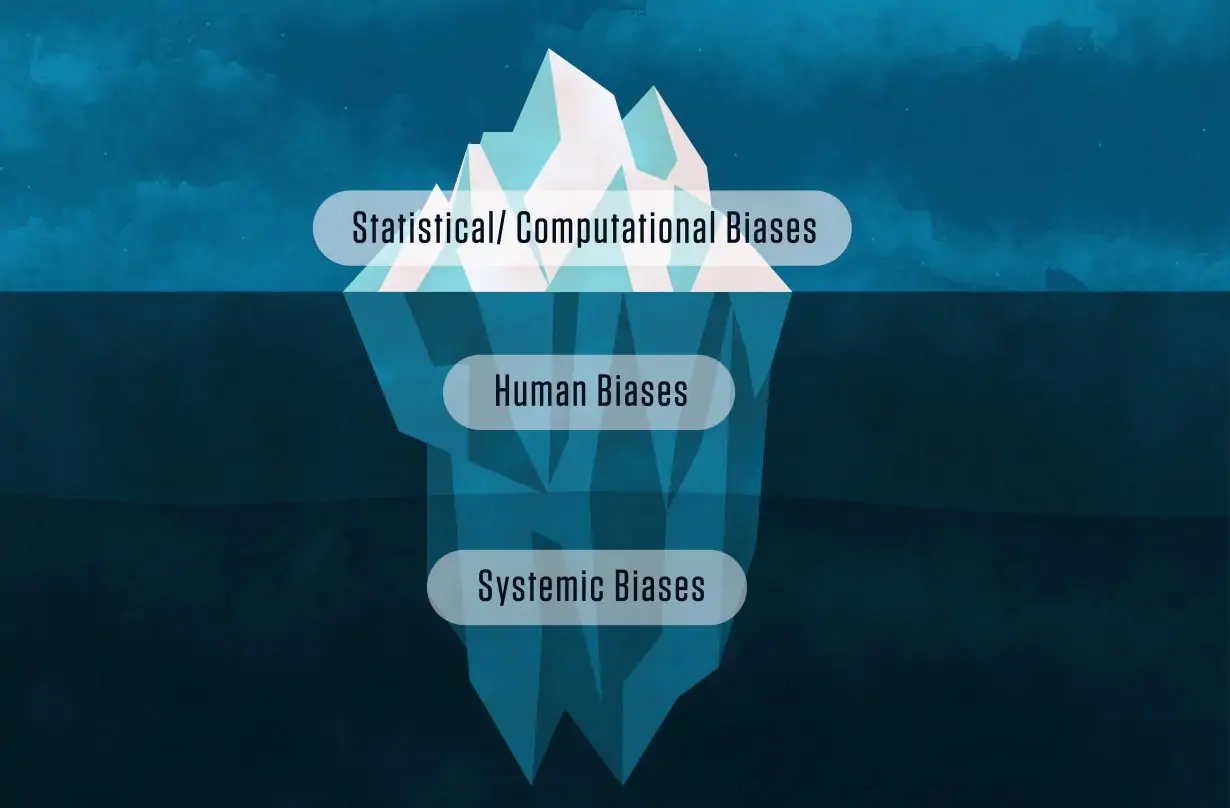

不同自動化過程產生的不同偏差

資料來源:Varshney,值得信賴的機器學習,2022

IBM Watson Advertising 於 2022 年 1 月根據 The Ad Council 的活動數據發布了新的研究結果,該數據明確表明,基於對倡導 COVID 疫苗接種的活動的不同投入的無意識偏見正在影響 AI 算法,該算法針對收入水平和政治等多個特徵傳播該活動信念。

“最重要的觀察之一是:用於數字廣告的數據和算法中可能存在偏見,而且人眼並不總是可以立即觀察到這種偏見。”

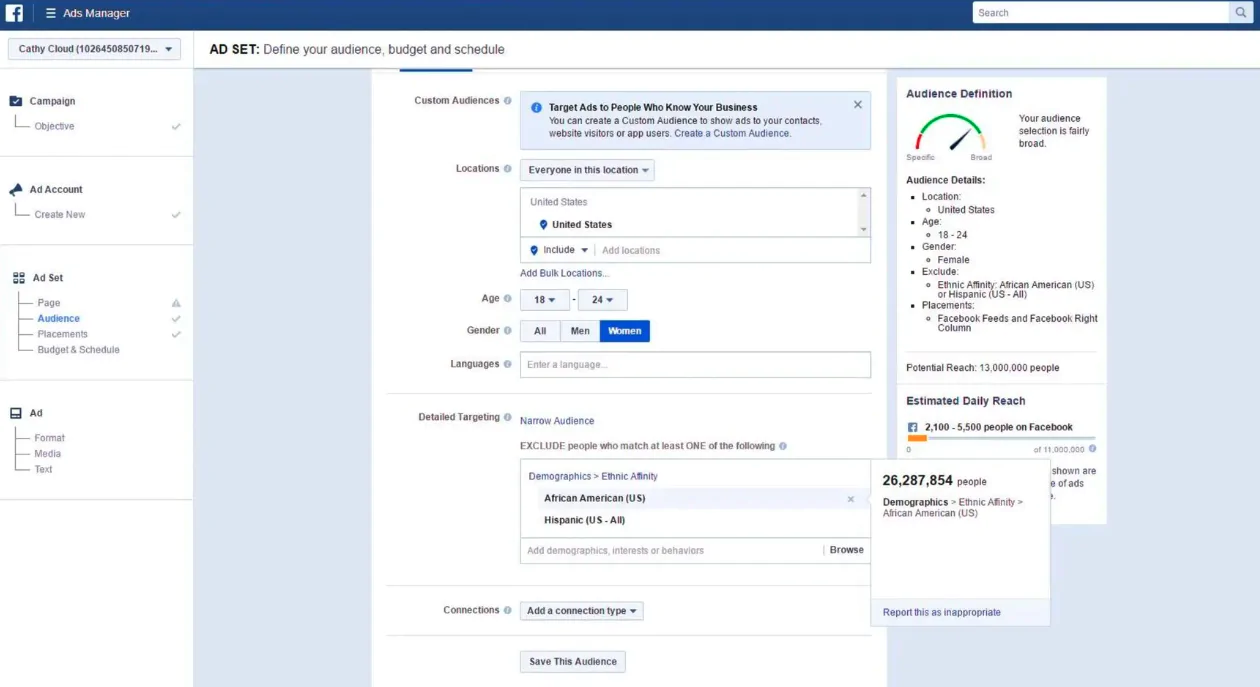

這不僅僅是理論上的; Facebook 最近與美國國家公平住房聯盟 (NFHA) 和美國通信工作者 (CWA) 就 Facebook 廣告平台上預先填充的列表達成和解,該列表允許廣告商投放住房、就業和信貸廣告,這些廣告可能會排除非洲等受保護群體美國人、西班牙裔美國人和亞裔美國人。 有針對性的廣告列表沒有以同樣的方式排除“白人”,這違反了要求以公平和平等的方式為受保護群體做廣告的民權法。

資料來源:紐約時報

當人類認知偏差或數據偏差在不知不覺中被編碼到系統中並大規模分佈時,就會發生技術偏差。 這些無意識的偏見可能會成為系統性問題,複雜到可能無法檢測到,尤其是在廣告生態系統內的數據和信號交互中。

資料來源:美國國家標準與技術研究院 (NIST)

雖然可能很難發現廣告、定位和消息傳遞中反映了哪些偏見,但營銷團隊有責任意識到這個問題,積極挑戰我們的假設,並優先考慮尋找解決方案。

你如何打擊有偏見的廣告?

不管過去的廣告活動有什麼效果,現在是時候挺身而出,做出一些重大改變,以確保您的品牌採取包容性的方法並處理潛在的偏見。

當涉及到您的整體創作過程時,請確保您:

- 在流程的每個階段,從最初的構思到執行再到測量,將不同的觀點作為利益相關者帶到桌面上

- 檢查您的定位標準是否存在偏見,不要害怕根據算法決策提出有關輸入和任何結果的問題

- 不要只是將多樣性、公平和包容性 (DEI) 添加到您的創意過程中,與來自服務欠缺社區的觀眾一起工作,並將他們的觀點帶入與您的品牌的雙向對話中

- 創建一個測試框架,通過向新受眾和不同的信息和創意開放您的品牌來挑戰您的一些假設

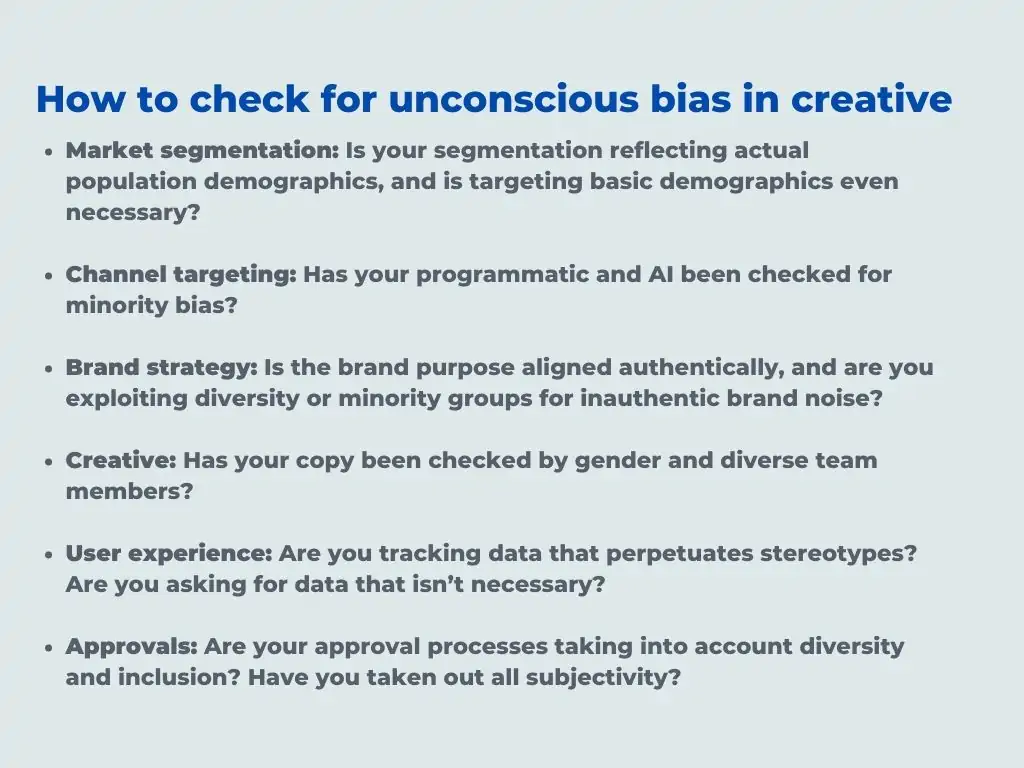

出版物 CMO 提出了一個有用的清單,您應該將其包括在您的創意質量控制中:

資料來源:首席營銷官

當談到算法偏差時,解決方案要復雜一些。 隨著人工智能變得越來越複雜,該領域的專家呼籲提高不同模型和服務開發方式的透明度。

具有諷刺意味的是,技術往往是反駁和質疑我們建立的模型的答案,這些模型可能會產生這些有缺陷的、有偏見的結果。 查看這些旨在幫助發現和減輕廣告中隱含偏見的工具:

- AI 公平性:這個開源工具包可以幫助用戶在整個 AI 應用程序生命週期中檢查、報告和減輕機器學習模型中的歧視和偏見。

- IBM Watson:通過掃描偏見,用於廣告的人工智能可以幫助發現對人類隱藏的子群體之間的潛在聯繫,以便制定更好的策略來公平地解決每個群體的問題。

- IBM FactSheets:FactSheet 是有關創建和部署 AI 模型或服務的相關信息(事實)的集合。 FactSheet 項目的目標是通過提高透明度和加深對 AI 的創建和部署方式的理解來培養對 AI 的信任,從而對 AI 的使用方式進行一定程度的治理和控制。

今天的消費者對他們選擇與之互動的品牌有更多期望。 為您的消費者提供優質的產品或服務已經不夠了; 你的客戶希望你把你的價值觀放在首位。 隨著消費者對廣告的了解越來越多,請花時間對您向世界投放的內容進行直覺檢查。